✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,matlab项目合作可私信。

🍎个人主页:Matlab科研工作室

🍊个人信条:格物致知。

更多Matlab仿真内容点击👇

⛄ 内容介绍

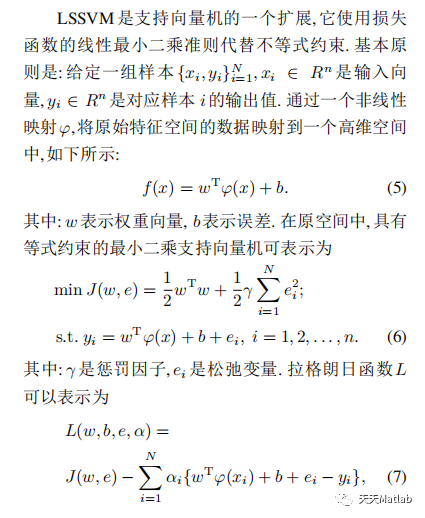

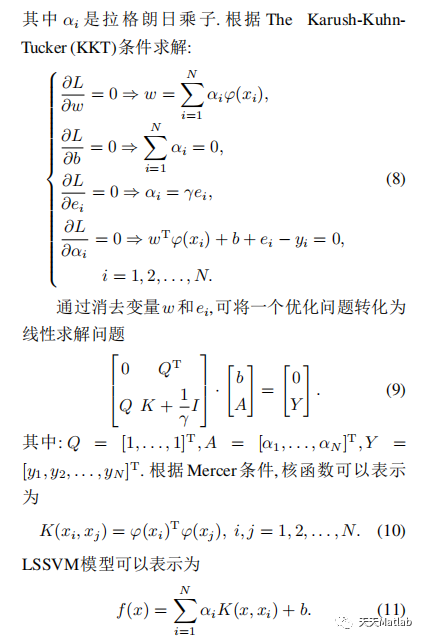

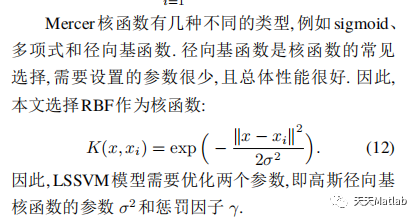

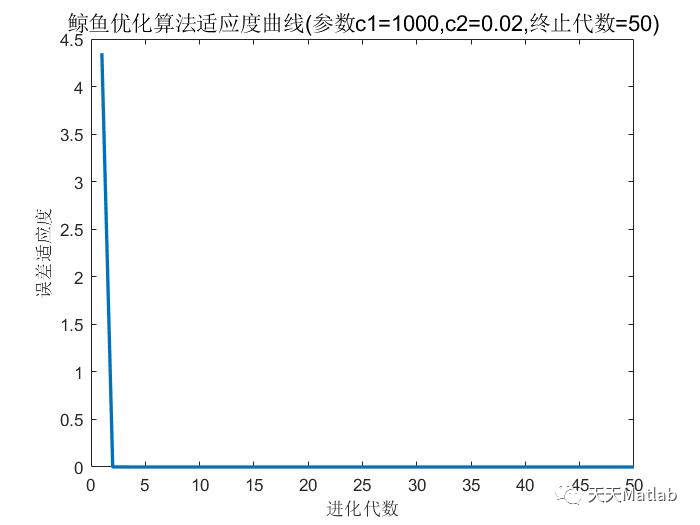

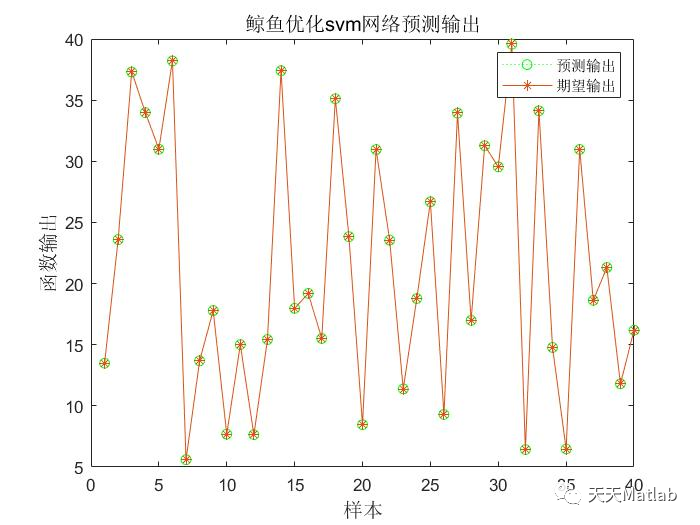

井下动液面是抽油井的一个重要生产参数,能够反映抽油井的生产效率.采用基于时间序列分析的方法对动液面进行预测,首先由最小二乘支持向量机(LSSVM)方法建立预测模型,对其中的正则化参数和核函数参数采用鲸鱼算法(WOA)进行优化选取.实例验证了本文所提出算法的有效性.

⛄ 部分代码

while t<Max_iter

t

for i=1:size(Positions,1)

% Return back the search agents that go beyond the boundaries of the search space

Flag4ub=Positions(i,:)>ub;

Flag4lb=Positions(i,:)<lb;

Positions(i,:)=(Positions(i,:).*(~(Flag4ub+Flag4lb)))+ub.*Flag4ub+lb.*Flag4lb;

% Calculate objective function for each search agen

gam=Positions(i,1);

sig2=Positions(i,2);

model=initlssvm(train_x,train_yy,type,gam,sig2,kernel,proprecess);

model=trainlssvm(model);

%求出训练集和测试集的预测值

[train_predict_y,zt,model]=simlssvm(model,train_x);

[test_predict_y,zt,model]=simlssvm(model,test_x);

%预测数据反归一化

train_predict=postmnmx(train_predict_y ,miny,maxy);%预测输出

test_predict=postmnmx(test_predict_y ,miny,maxy); %测试集预测值

%计算均方差

trainmse=sum((train_predict-train_y).^2)/length(train_y);

testmse=sum((test_predict-test_y).^2)/length(test_y);

fitness=trainmse; %以测试集的预测值计算的均方差为适应度值

% Update the leader

if fitness<Leader_score % Change this to > for maximization problem

Leader_score=fitness; % Update alpha

Leader_pos=Positions(i,:);%最佳参数

YPred_best=test_predict;

end

end

a=-t*((2)/Max_iter); % a decreases linearly fron 2 to 0 in Eq. (2.3)

% a2 linearly dicreases from -1 to -2 to calculate t in Eq. (3.12)

a2=t*((-1)/Max_iter);

% Update the Position of search agents

for i=1:size(Positions,1)

r1=rand(); % r1 is a random number in [0,1]

r2=rand(); % r2 is a random number in [0,1]

A=2*a*r1-a; % Eq. (2.3) in the paper

C=2*r2; % Eq. (2.4) in the paper

b=1; % parameters in Eq. (2.5)

l=(a2-1)*rand+1; % parameters in Eq. (2.5)

p = rand(); % p in Eq. (2.6)

for j=1:size(Positions,2)

if p<0.5

if abs(A)>=1

rand_leader_index = floor(SearchAgents_no*rand()+1);

X_rand = Positions(rand_leader_index, :);

D_X_rand=abs(C*X_rand(j)-Positions(i,j)); % Eq. (2.7)

Positions(i,j)=X_rand(j)-A*D_X_rand; % Eq. (2.8)

elseif abs(A)<1

D_Leader=abs(C*Leader_pos(j)-Positions(i,j)); % Eq. (2.1)

Positions(i,j)=Leader_pos(j)-A*D_Leader; % Eq. (2.2)

end

elseif p>=0.5

distance2Leader=abs(Leader_pos(j)-Positions(i,j));

% Eq. (2.5)

Positions(i,j)=distance2Leader*exp(b.*l).*cos(l.*2*pi)+Leader_pos(j);

end

end

end

t=t+1;

Convergence_curve(t)=Leader_score;

% [t Leader_score]

end

⛄ 运行结果

⛄ 参考文献

[1]郑威迪, 李志刚, 贾涵中,等. 基于改进型鲸鱼优化算法和最小二乘支持向量机的炼钢终点预测模型研究[J]. 电子学报, 2019, 47(3):700-706.

⛄ Matlab代码关注

❤️部分理论引用网络文献,若有侵权联系博主删除

❤️ 关注我领取海量matlab电子书和数学建模资料

649

649

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?