目录

什么是svm

既可以分类也可以回归

分成红色可能会好,降低了模型的泛化能力

Hard Margin

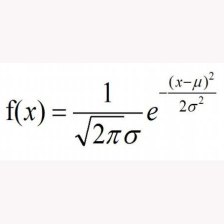

Theta 为n+1维 theta0x0 = b 截距

w为n维向量,计算后为一个数,d 也是一个数且为正数

2*x + y = 0

4*x + 2*y = 0

为了便于简写,可以写为

只是符号代替上面的数,现在有两个式子,可以化为

优化目标

s.t. = such that

与之前的不同,这个是有条件的最优化问题,求解比较复杂

之前的是全局最优化问题,只需要求导

这是hard margin前提是线性可分,但实际的数据不一定线性可分

Soft Margin 和SVM的正则化

本质是

求解后很有可能

虽然分开了,但其泛化能力可能buxing

能够有一定的容错能力,

下面无法线性可分

具有容错能力的svm即soft margin svm

不一定所有的点在线之外,可以有一些点在两条边界线之间

对于每一个样本都一个yita,每一个都会有一个容错空间,希望有容错空间但不能太大

现存两者占的比例一样,正则化知识可知不一定

yita是正数不要| |

yita与之前的正则化中的theta几何意义不同

C之前是在前面的公式中,现在在后面

但C的表意是一样,C越大则容错空间越小

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?