<网页blog已经上线,一大波干货即将来袭:https://faiculty.com/>

/* 版权声明:可以任意转载,转载时请务必标明文章原始出处和作者信息 .*/

faiculty: 机器学习、计算机视觉交流群:451429116

微信公众号、知乎专栏、简书,请搜索: faiculty

本专栏主要为学习记录,可能综合了网上各类文章或博客,如有侵权请联系本人进行删除。

QQ:769412850.

非常期待各位同学投稿,一起学习。

logistic 回归

1.问题:

在上面讨论回归问题时,讨论的结果都是连续类型,但如果要求做分类呢?即讨论结果为离散型的值。

2.解答:

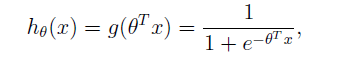

假设:

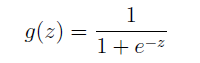

其中:

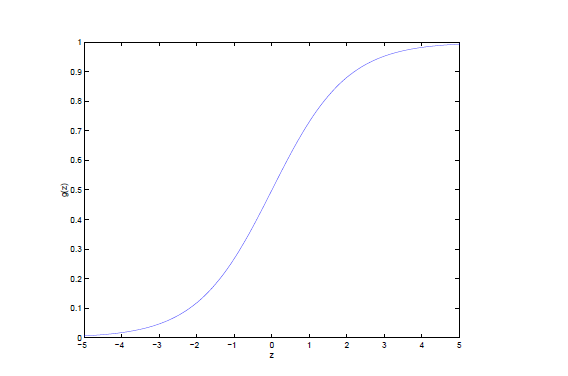

g(z) g ( z ) 的图形如下:

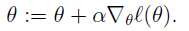

由此可知:当 hθ(x) h θ ( x ) <0.5时我们可以认为为0,反之为1,这样就变成离散型的数据了。推导迭代式:

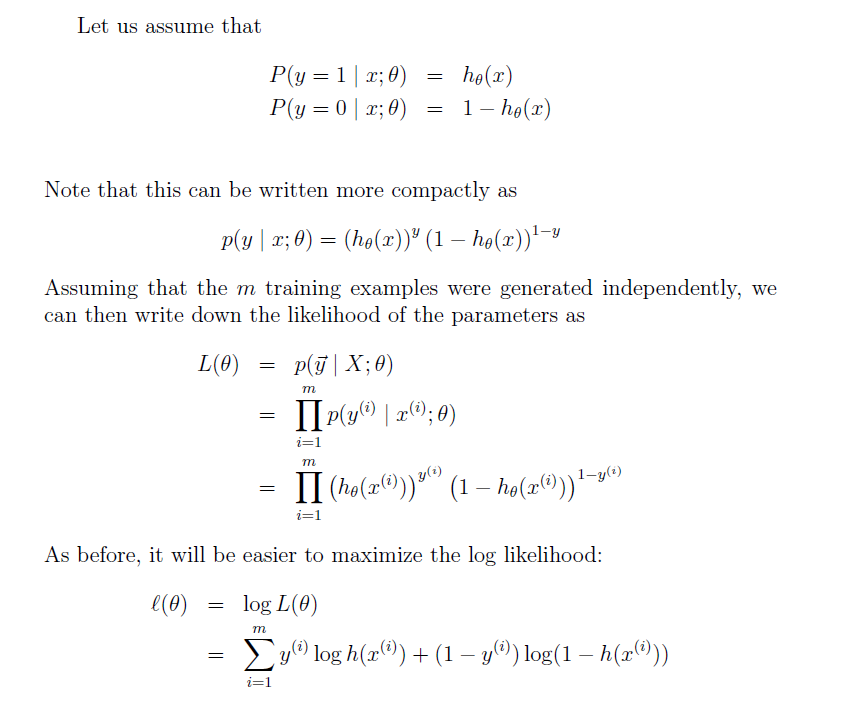

- 利用概率论进行推导,找出样本服从的分布类型,利用最大似然法求出相应的 θ θ

- 因此:

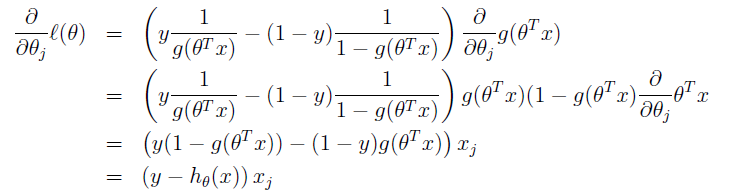

结果:

注意:这里的迭代式增量迭代法

Newton迭代法:

1.问题:

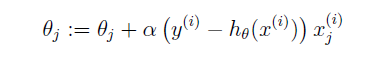

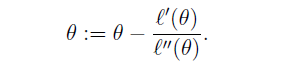

上述迭代法,收敛速度很慢,在利用最大似然法求解的时候可以运用Newton迭代法,即 θ θ := θ−f(θ)f′(θ) θ − f ( θ ) f ′ ( θ )

2.解答:

推导:

- Newton迭代法是求 θ θ ,且 f(θ)=0 f ( θ ) = 0 ,刚好: l′(θ)=0 l ′ ( θ ) = 0

- 所以可以将Newton迭代法改写成:

定义:

- 其中:

本文详细介绍了Logistic回归在0、1分类问题中的应用,包括手动设定迭代次数和使用fminunc函数求解。此外,还探讨了多元分类问题的one_vs_all策略,并通过实例展示了如何利用Newton迭代法改进分类器的收敛速度。最后,补充了正则化Logistic回归和前馈神经网络的相关内容。

本文详细介绍了Logistic回归在0、1分类问题中的应用,包括手动设定迭代次数和使用fminunc函数求解。此外,还探讨了多元分类问题的one_vs_all策略,并通过实例展示了如何利用Newton迭代法改进分类器的收敛速度。最后,补充了正则化Logistic回归和前馈神经网络的相关内容。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2087

2087

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?