1 简介

论文题目:GATE: Graph Attention Transformer Encoder for Cross-lingual Relation and Event Extraction

论文来源:AAAI 2021

论文链接:https://arxiv.org/pdf/2010.03009.pdf

代码链接:https://github.com/wasiahmad/GATE

1.1 动机

- GCN 缺乏对长期依赖或依赖树中不连贯的词的建模。

1.2 创新

- 提出一个图注意力Transformer编码器(捕捉远距离依赖和忽略词序),进行英语、汉语、阿拉伯语的跨语言迁移,完成关系抽取和论元抽取(触发词被提供)。

2 背景知识

跨语言迁移方法分为下面4步:

- 使用通用的依赖解析(如UDPipe),将输入句子转换为语言通用的树结构。

- 编码句子中的词到共享的多语义空间,拼接词性编码、依赖关系、实体类型编码。

- 使用提出的GATE结构(利用句法距离)编码输入的句子。

- 对关系和论元角色进行分类。

3 方法

3.1 图注意力Transformer编码器

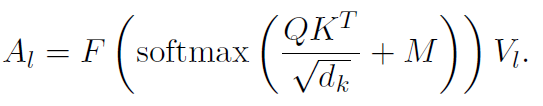

对transformer编码器中的attention进行修改,使其利用句法结构,公式如下( Z i = ∑ j P i j D i j Z_i=\sum_j\frac{P_{ij}}{D_{ij}} Zi=∑jDijPij),使用矩阵M为句法距离,F函数使GATE更关注解析树中距离较近的token,而较少关注离得很远的标记。

|

|

|

3.2 关系抽取

对实体和句子编码进行max-pooling,然后进行拼接分类,Loss函数如下:

3.3 事件抽取

对候选论元、触发词和句子编码进行max-pooling,然后进行拼接分类,Loss函数如下:

4 实验

单资源迁移的实验结果如下图:

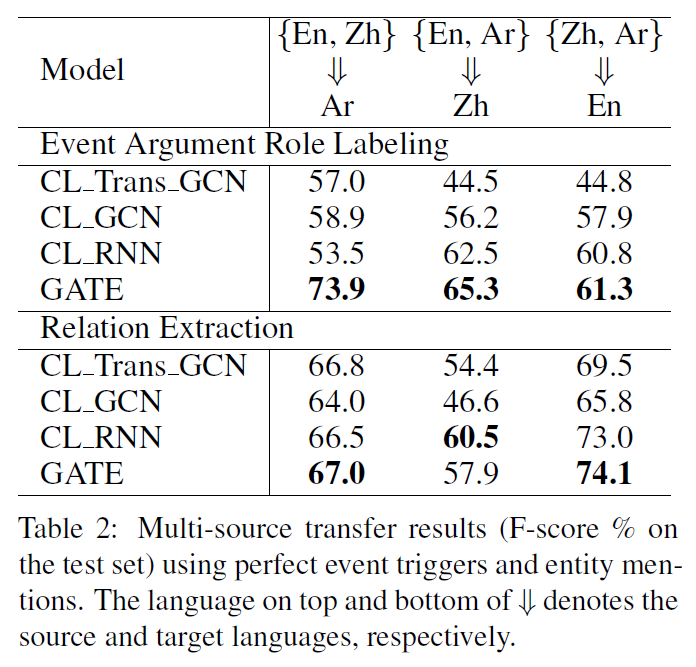

多资源迁移的实验结果如下图:

对比编码依赖结构和编码句子结构:

验证对源语言的敏感度(将目标语言翻译为源语言):

消融实验:

872

872

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?