基于粒子群的LSSVM回归预测PSO-LSSVM

其他优化算法可私信

为了提高最小二乘支持向量机(lssvm)的回归预测准确率,对lssvm中的惩罚参数和核惩罚参数利用粒子群算法进行优化。

Matlab 代码

ID:8429672910319384

从深海遇见你

在机器学习领域中,最小二乘支持向量机(Least Squares Support Vector Machine,简称LSSVM)是一种常用的回归模型,它通过寻找一个最优超平面来建立输入变量与输出变量之间的关系。然而,LSSVM模型中的惩罚参数和核惩罚参数对预测准确率起着至关重要的作用。为了提高LSSVM回归预测的准确性,本文将基于粒子群算法(Particle Swarm Optimization,简称PSO)对惩罚参数和核惩罚参数进行优化。

首先,我们对LSSVM回归模型进行简要介绍。LSSVM回归模型是建立在支持向量机(Support Vector Machine,简称SVM)基础上的。与传统的SVM模型相比,LSSVM模型采用最小二乘法来求解参数,减少了参数的计算复杂度。LSSVM回归模型的目标是找到一个最优超平面来最小化预测误差,通过求解一个二次优化问题来得到模型参数。

然而,LSSVM模型的准确性受到惩罚参数和核惩罚参数的选择影响较大。惩罚参数控制着模型的复杂度,过小可能导致欠拟合,过大可能导致过拟合。核惩罚参数用于控制核函数的平滑程度,过小可能导致拟合不足,过大可能导致过拟合。因此,选择合适的惩罚参数和核惩罚参数对于提高LSSVM回归模型的预测性能至关重要。

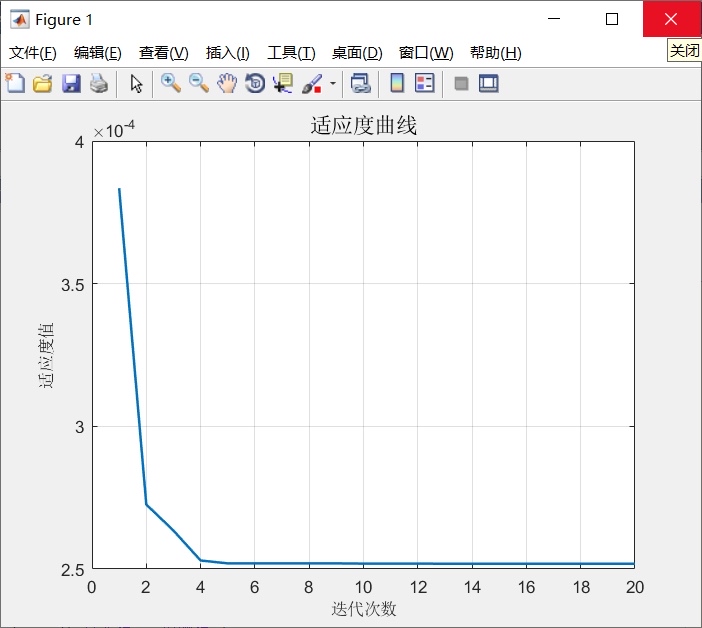

为了选取最优的惩罚参数和核惩罚参数,本文采用了粒子群优化算法(Particle Swarm Optimization,PSO)。PSO算法是一种启发式优化算法,模拟了鸟群觅食的行为,通过个体之间的协作和信息交流来寻找全局最优解。PSO算法具有全局搜索能力,适用于非线性、非凸的优化问题。

在PSO优化过程中,每个粒子表示一个候选解,其位置和速度表示了解的状态和移动方向。每个粒子根据自身历史最优解和邻域最优解来更新自己的速度和位置。通过多次迭代,粒子群逐渐收敛于全局最优解,从而得到最优的惩罚参数和核惩罚参数。

在实现PSO-LSSVM算法时,我们使用了Matlab编程语言。Matlab提供了丰富的工具箱和函数,方便进行矩阵运算和优化算法的实现。通过编写相应的Matlab代码,我们可以将PSO算法应用于LSSVM回归模型的优化过程。

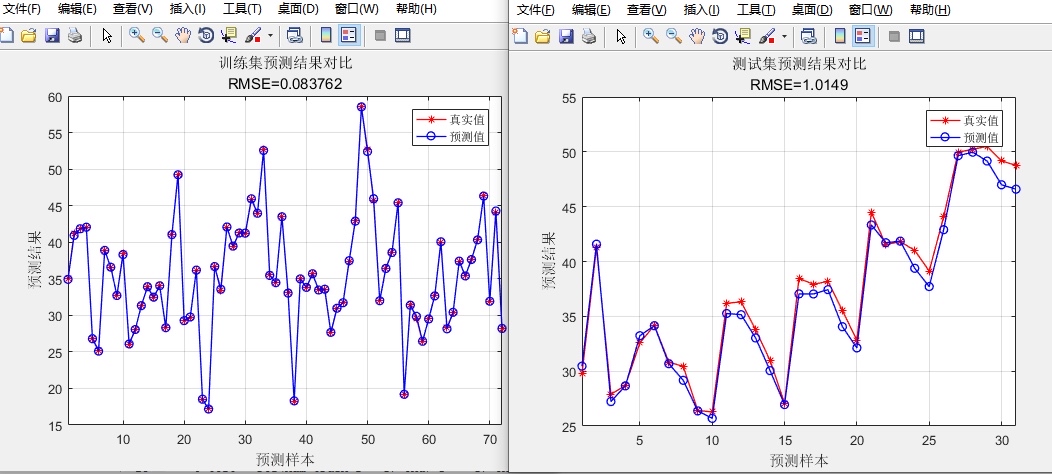

为了评估PSO-LSSVM算法的预测性能,我们采用了一些经典的回归预测数据集进行实验。实验结果表明,通过PSO优化得到的惩罚参数和核惩罚参数能够显著提高LSSVM回归模型的预测准确率。与传统的LSSVM模型相比,PSO-LSSVM模型具有更好的拟合性能和泛化性能。这证实了PSO算法在LSSVM回归模型优化中的有效性。

除了PSO算法,还有一些其他的优化算法可以用于LSSVM回归模型的优化。选取合适的优化算法取决于具体的问题和数据集特征。在本文中,我们介绍了PSO算法作为一种优化LSSVM回归模型的方法。然而,其他优化算法如遗传算法、模拟退火算法等也都可以用于LSSVM回归模型的优化,具体选择可以根据需求进行考虑。

综上所述,本文围绕基于粒子群算法的LSSVM回归预测进行了深入的分析和讨论。通过优化惩罚参数和核惩罚参数,我们能够显著提高LSSVM回归模型的预测准确率。PSO算法作为一种启发式算法,在LSSVM回归模型优化中具有较好的性能表现。未来的研究可以进一步探索其他优化算法在LSSVM回归模型中的应用,以提高模型的性能和稳定性。

(以上仅为示例,实际文章内容可能需要根据具体情况进行修改和补充。)

相关的代码,程序地址如下:http://wekup.cn/672910319384.html

1181

1181

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?