论文阅读笔记

去年在ECCV上发表的《Mask TextSpotter v3: Segmentation Proposal Network for Robust Scene Text Spotting》这篇文章,在好几个公众号上都看到过,而且称是史上最强的端到端文本识别模型。这次借着刚刚开始读论文的机会,打算好好的读下这篇文章。有可能的话,自己水平够的话,就尽量复现下。

该内容采用: 摘录重点部分+提出问题的方式,来阅读该篇论文。 后面会逐一的解答提出来的的问题。

make decision

- 论文名称:Mask TextSpotter v3: Segmentation Proposal Network for Robust Scene Text Spotting

中文翻译过来就是 用于鲁棒场景文本识别的分割建议网络, 这表明该网络针对复杂场景下的不同文本有更强的鲁棒性

- 作者:Minghui Liao, Guan Pang, Jing Huang, Tal Hassner, Xiang Bai

- 机构:华中科技大学;Facebook AI

- 是否精读:是

- 做出决定日期:2021-4-10

step1:提出读过摘要后的问题

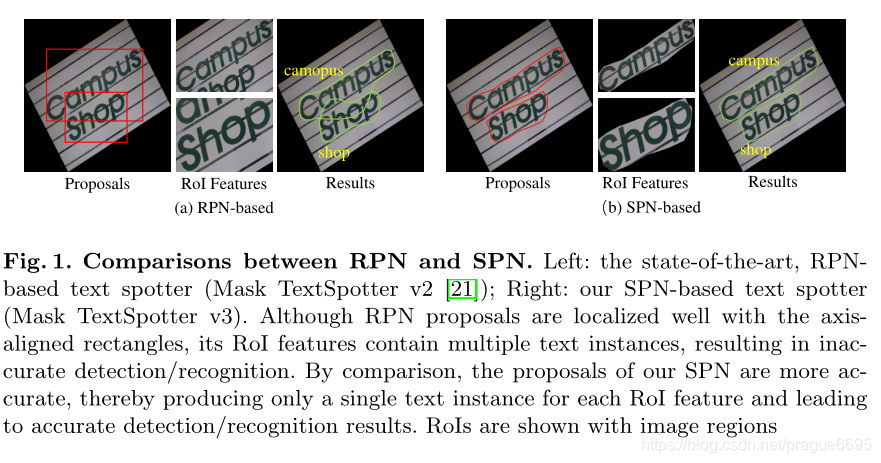

RPN在很大程度上依赖于手工设计的anchors(这样操作对于处理极端长宽比以及不规则的文本实例时存在困难),而且它的目标建议框用轴向对齐的矩形来表示(对于密集文本,会存在一个目标建议框会存在多个相邻实例),基于以上问题作者团队提出了Mask TestSpotter v3,很明显,作者提出的分割建议网络(Segmentation Proposal Network, SPN)就是解决RPN存在的问题,SPN是自由的anchor,可以准确的表示任意形状的目标建议框。

- Q1: SPN中的 masked RoI features 中的masked是怎么理解的?他是怎样解耦SPN产生的精确建议框相邻的文本实例的?

step2:读Introduction

引言开头介绍端到端场景文本识别定义,说白了就是 文本检测和文本识别两种任务的结合。

然后介绍了场景文本检测的三大挑战:文本不同方向,极端纵横比和不同形状。各个鲁棒性是精确的场景文本定位是必须的,这也是为什么题目会有鲁棒性robust这个单词。

又提到了Mask TextSpotter的v1,v2版本,虽然他们可以处理不同方向和不同形状的分散文本实例,但是他们都是采用RPN来生成目标建议框。存在摘要里所说的两大缺点。

这里展示了基于RPN和基于SPN两种生成目标建议框的对比, 很明显,spn生成的目标建议框更准确。作者就是将SPN引入到Mask TextSpotter v2中,提出了Mask TextSpotter v3。

- Q2: SPN具体是怎么工作的呢?它相比于RPN结构上有什么不同?

在引言的最后,作者总结了他们的贡献主要有三方面:

- 提出了SPN分割提案网络结构,这是首个端到端可训练文本识别的任意形状目标建议框生成器

- 提出了将多边形建议框应用于RoI特征的hard RoI masking

- 所提出的Mask TextSpotter v3网络显著提高了旋转,长宽比和形状的鲁棒性。

- Q3: hard RoI masking 是如何理解的?怎样实现的?

step3:读 Conclusion

还是在强调在三大挑战中具有鲁棒性。在不同选中角度的ICDAR 2013数据集,和具有长文本行的MARA-TD500数据集和具有不同文本形状的总文本数据集上,对Mask TextSpotter v3的旋转、纵横比和形状变化具有鲁棒性。而且,在IC15数据集上的结果表明,本文提出的TextSpotter v3对小文本实例的检测和识别也具有鲁棒性。

step4:读 Related works

场景文本检测能够分为两类:two-stage和end-to-end,然后分别介绍了这两类领域中现阶段的相关算法。

然后开始介绍Mask TextSpotter v1是第一款端到端可训练的任意形状场景文本识别的方法。它是基于Mask RCNN的检测模块和用于识别的字符分割模块组成。Mask TextSpotter v2 通过应用空间注意模块进行识别,缓解了在Mask TextSpotter v1中存在的字符级标注问题,显著提高了性能。

- Q4:之前没有接触过,在这里弱弱提一问,Mask RCNN的是什么样的网络结构?

- Q5:Mask TextSpotter v2 中的空间注意模块,是怎么样组成的?

最后介绍了基于分割的场景文本检测框器,与以往的基于分割的场景文本检测器采用多个额外模块进行检测任务相比,作者的方法侧重于使用分割网络生成建议框,以实现端到端场景文本识别模型

step5:读 Methodology

从第一段我们得知 Mask TextSpotter v3由 backbone为resNet-50,用于生成目标建议框的SPN、用于refining proposals的Fast-RCNN,用于准确检测的文本实例分割模块、用于识别的字符分割模块和用于识别的空间注意模块组成。如下图所示,它为proposals提供了多边形表示,并消除了RoI特征的附加特征,从而实现了准确的检测和识别结果

- Q6: 该网络是怎样对目标建议框提供了多边形表示,并消除了RoI特征的附加特征的

图中F代表的是为了进行分割的融合特征图(将不同的尺度特征融合为特征图F),

- Q7:其实从上图中看的不是很清楚, 该模型的各个模块无法准确的对应到图中。

3.1 Segmentation proposal network

SPN采用U-net结构,使其对尺度具有鲁棒性。 与基于FPN(特征金字塔)的RPN从多个阶段产生不同尺度的目标建议框不同, SPN从 segmentation masks 产生proposals,从连接了各种尺度的特征映射的融合特征映射F中进行预测。

F的大小为(H和W为原图像的高度和宽度)

H 4 × W 4 \frac{H}{4} ×\frac{W}{4} 4H×<

本文是关于《Mask TextSpotter v3》论文的阅读笔记,探讨了用于鲁棒场景文本识别的分割建议网络(SPN),解决了RPN在处理复杂文本实例时的局限性。作者提出了SPN、Hard RoI masking等创新技术,增强了模型在旋转、长宽比和形状变化下的鲁棒性。通过深入解读模型结构和工作原理,揭示了SPN如何提高文本检测和识别的准确性。

本文是关于《Mask TextSpotter v3》论文的阅读笔记,探讨了用于鲁棒场景文本识别的分割建议网络(SPN),解决了RPN在处理复杂文本实例时的局限性。作者提出了SPN、Hard RoI masking等创新技术,增强了模型在旋转、长宽比和形状变化下的鲁棒性。通过深入解读模型结构和工作原理,揭示了SPN如何提高文本检测和识别的准确性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

480

480

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?