前言

之前写了如何通过 Ollama 实现大模型本地化,本次将通过代码实现 Ollama + DeepSeek 实现本地大模型的联网回答能力。

代码实现

实现本地大模型联网实际上并不复杂,核心思路就是通过搜索引擎的 API 获取查询结果,然后再通过爬虫抓取网页内容,最终将这些信息提交给 AI 进行分析和回答。本次实现的方式是通过 Google Search API 来完成联网搜索的能力。在开始之前,需要先申请 Google 搜索的 API Key,具体方法可以参考我之前写的文章 《AnythingLLM 接入 Web Search》,这里不再赘述。

封装 Ollama 请求

首先,需要在本地安装 Ollama,并通过 Ollama 下载 DeepSeek 模型。如果还没有完成,可以参考之前的文章 《Ollama 部署本地大模型与使用》,拉取模型时可以根据本地配置选择 deepseek-r1:7b 或者 deepseek-r1:14b。

安装好 Ollama 后,我们可以使用 npm 安装 ollama 这个库,以简化 API 调用。然后,我们可以封装一个 generateResponse 方法来处理 AI 生成的响应。

import { Ollama } from 'ollama';

const ollama = new Ollama({ host: "http://localhost:11434" });

export async function generateResponse(prompt, params = {}) {

try {

const response = await ollama.generate({

prompt,

model: process.env.MODEL_NAME || 'deepseek-r1:14b',

stream: false,

...params

});

return response?.response || null;

} catch (error) {

console.error("generateResponse: 请求失败", error);

return null;

}

}

封装 Google Search 请求

接下来,需要封装一个 Google 搜索的请求方法,以便后续调用。Google 搜索 API 的使用方式较为简单,只需要调用一个接口,在请求时传入 cx(Google 搜索 ID)、key(Google 搜索密钥),以及 q(搜索内容)即可。封装的方法如下:

import axios from 'axios';

export async function searchGoogle(query, params) {

const { GOOGLE_SEARCH_ID, GOOGLE_SEARCH_KEY } = process.env;

try {

const response = await axios.get('https://www.googleapis.com/customsearch/v1', {

params: {

cx: GOOGLE_SEARCH_ID,

key: GOOGLE_SEARCH_KEY,

q: query,

...params,

},

});

return response.data || null;

} catch (error) {

console.error("searchGoogle: 搜索请求失败", {

message: error.message,

status: error.response?.status,

data: error.response?.data

});

return null;

}

}

封装网页抓取方法

Google 搜索 API 返回的结果包含页面的各种信息,例如 URL、标题、内容片段等。但通常搜索引擎提供的内容片段并不足以让 AI 进行深度理解,因此需要进一步抓取网页内容,以获取完整的正文内容。

在 Node.js 生态中,cheerio 是一个非常常用的爬虫库,它可以将 HTML 字符串解析成类似 jQuery 的对象,使得在 Node.js 中操作 DOM 变得更加方便。由于大部分文章的字数通常较多,同时 AI 模型存在 Token 限制,因此在抓取内容时,我们需要对其进行截取,避免超出限制。

import axios from 'axios';

import * as cheerio from 'cheerio';

export async function fetchWebContent(url) {

try {

const response = await axios.get(url);

const $ = cheerio.load(response.data);

const text = $('body').text().replace(/\s+/g, ' ').trim();

return text.slice(0, 5000);

} catch (error) {

console.error(`抓取失败: ${url}`, error.message);

return null;

}

}

实现主方法

在实现主方法之前,还需要封装一个用于获取所有页面内容的方法。Google 搜索 API 返回的结果是一个包含多个页面链接的列表,因此我们需要将这些链接转换为请求任务,并发执行。同时,并不需要所有请求都成功,因此可以使用 Promise.allSettled 代替 Promise.all,只保留成功的请求结果。

function getAllPageContent(items) {

const allRequest = items.map(({ link }) => fetchWebContent(link));

return new Promise((resolve) => {

Promise.allSettled(allRequest).then((results) => {

const fulfilledResults = results.filter(({ status }) => status === 'fulfilled');

resolve(fulfilledResults.map(({ value }, idx) => ({ ...items[idx], content: value })));

});

})

}

主方法的核心逻辑是首先让 AI 根据用户的问题拆分出搜索关键词,这样可以避免用户输入较长的问题时搜索引擎无法提供有效结果的情况。拿到搜索关键词后,调用 Google 搜索 API 获取搜索结果,并使用 getAllPageContent 方法抓取内容。最后,将问题和相关内容提交给 AI,让 AI 进行分析并生成回答。

async function main() {

const question = process.argv.slice(2).join(' ').trim();

console.log(`问题: ${question}`);

const questionPrompt = `请根据以下内容总结用于 Google 搜索的关键词:${question},并以加号分隔关键词,例如:关键词1 + 关键词2 + 关键词3。只返回关键词,不要自行扩展,不要包含其他内容。`;

try {

const searchPrompt = await generateResponse(questionPrompt);

const search = searchPrompt.trim().split('\n').pop();

console.log(`搜索关键词: ${search}`);

const searchResult = await searchGoogle(search);

if (!searchResult?.items || searchResult.items.length === 0) {

console.error('未找到相关搜索结果');

return;

}

const results = await getAllPageContent(searchResult.items);

const webContent = results.map(({ content }) => content).filter(Boolean).join('\n');

const answerPrompt = `基于以下网络搜索结果回答问题:\n${webContent}\n问题:${question} \n答案:`;

const response = await generateResponse(answerPrompt);

console.log('回答:', response.trim());

} catch (error) {

console.error('发生错误:', error.message);

}

}

main();

实现效果

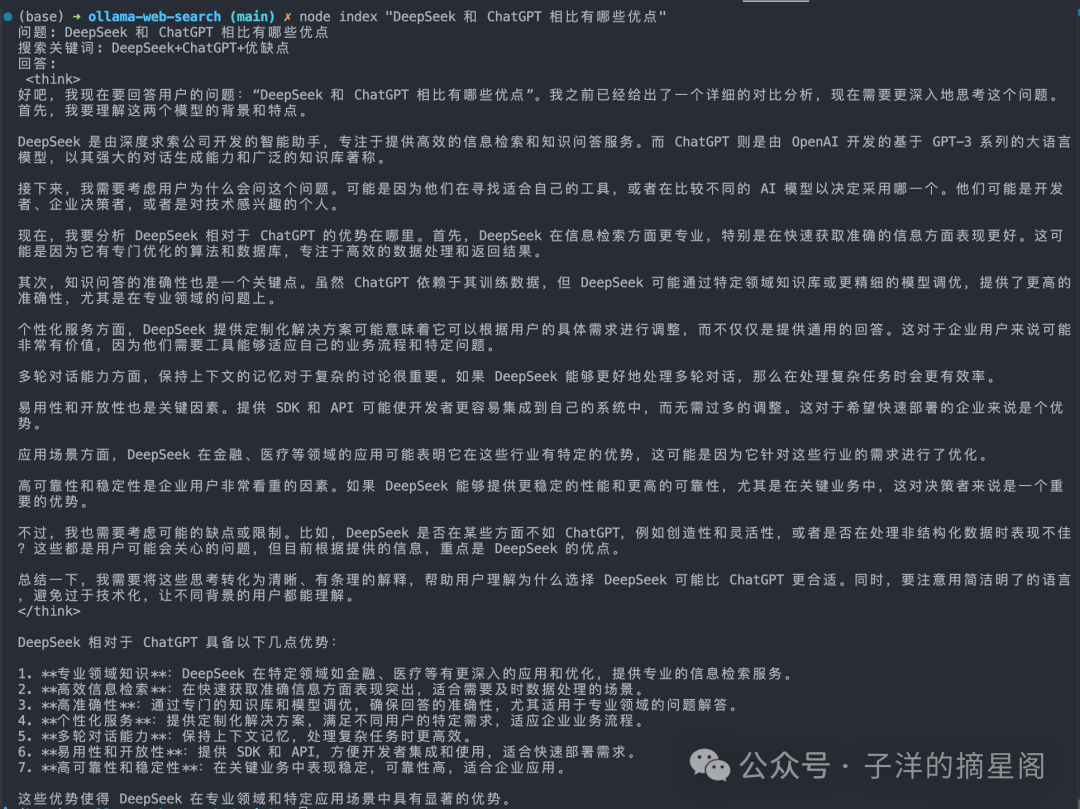

通过 node index "问题内容" 进行联网检索

node index "DeepSeek 和 ChatGPT 相比有哪些优点"

由于我之前已经问过一次了,可以从这次回答的思考中看出来,这次回答是对上次回答的补充,不过我有些奇怪,使用 ollama 的 generate 接口也会有之前的聊天记忆吗。

结语

本文介绍了 Ollama + DeepSeek 实现本地大模型联网的方法,完整代码已上传至 Github。如果要提升 AI 回答的精确度,还需要进一步结合向量数据库,将完整的文章内容转换为向量后再进行搜索,才能提高检索的准确性。

Demo 项目地址:https://github.com/Alessandro-Pang/ollama-web-search

DeepSeek无疑是2025开年AI圈的一匹黑马,在一众AI大模型中,DeepSeek以低价高性能的优势脱颖而出。DeepSeek的上线实现了AI界的又一大突破,各大科技巨头都火速出手,争先抢占DeepSeek大模型的流量风口。

DeepSeek的爆火,远不止于此。它是一场属于每个人的科技革命,一次打破界限的机会,一次让普通人也能逆袭契机。

DeepSeek的优点

掌握DeepSeek对于转行大模型领域的人来说是一个很大的优势,目前懂得大模型技术方面的人才很稀缺,而DeepSeek就是一个突破口。现在越来越多的人才都想往大模型方向转行,对于想要转行创业,提升自我的人来说是一个不可多得的机会。

那么应该如何学习大模型

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

大模型岗位需求越来越大,但是相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把都打包整理好,希望能够真正帮助到大家。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【

保证100%免费】

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?