今天我们来聊聊当下最火的五款国产AI大模型——DeepSeek、豆包、Kimi、智谱清言和通义千问。

它们各有千秋,有的擅长专业分析,有的专攻娱乐互动,还有的靠“长文本”出圈……究竟谁更适合我们的需求?看完这篇就懂了!

一、DeepSeek:高性价比推理强者

DeepSeek是深度求索推出的大语言模型,堪称2025年AI界的“黑马”。它推理能力超强,表现和GPT-4不相上下。春节期间的爆火,使其成为史上用户增速最快的AI应用。

1、特点

语义理解能力强:

能吃透问题,给出精准答案。比如搞学术研究,我们问专业领域的复杂问题,它可以快速翻找资料,整理出关键信息,条理清晰地解答,帮我们省下不少时间。写论文时,还能帮着生成大纲、分析文献综述。

开源与本地化支持:

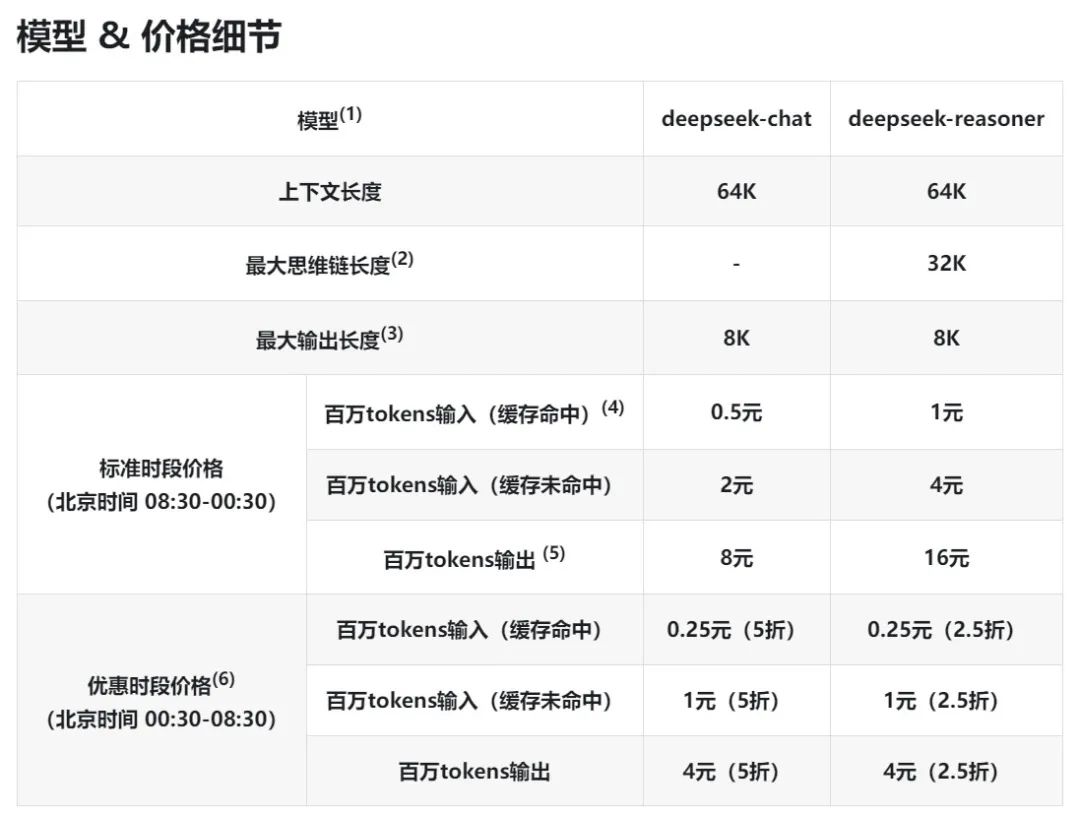

完全开源,支持本地部署,用户可以根据需求定制模型,同时完全掌控数据隐私。 其API服务价格亲民,输入/输出每百万tokens的成本分别为2元和8元,适合中小企业和个人开发者使用。

高性能与低成本:

在多项基准测试中,DeepSeek的表现接近甚至超越了Claude-Sonnet和GPT-4o等国际顶尖模型。其训练成本仅为557万美元,远低于GPT-4o的1亿美元。其推理成本也极具竞争力,每百万tokens的输入/输出成本仅为Sonnet-3.5的1/10。

2、发展

DeepSeek深耕专业领域,特别是在科技、金融、数据分析等领域,可能推出更多垂直行业解决方案,吸引企业用户。同时,进一步优化模型的性能和成本,提升用户体验。

二、豆包:字节跳动的多面手

豆包是字节跳动开发的通用大模型,融合了自然语言处理、计算机视觉和语音识别等技术。靠着字节跳动的技术优势,豆包能快速写出论文框架、活动通知,语音识别很准,日常聊天也特别流畅。

1、特点

功能全面:

提供聊天机器人、写作助手以及英语学习助手等功能,可以回答各种问题并进行对话;支持网页、客户端、APP、插件等形式。

基于豆包大模型,字节跳动打造了AI对话助手“豆包”、AI应用开发平台“扣子”、互动娱乐应用“猫箱”,以及星绘、即梦等AI创作工具。 并把大模型接入抖音、番茄小说、飞书、巨量引擎等50余个业务,用以提升效率和优化产品体验。

多模态能力:

豆包不仅在文本处理上表现出色,还具备强大的多模态交互能力。并且支持多风格、多比例的一致性多镜头生成,可应用在电商营销、动画教育、城市文旅、微剧本等领域。

高效推理与低成本:

通过字节跳动内部50+业务场景实践验证,每日千亿级tokens大使用量,使得豆包在推理效率和成本控制上具有明显优势。

2、发展

豆包背靠字节流量,继续拓展社交娱乐功能,比如虚拟偶像互动。风险是过度依赖抖音生态,可能陷入“工具化”瓶颈。

三、Kimi:长文本处理“学术助手”

Kimi主打超长文本处理与深度推理能力,其创始团队由清华、卡内基梅隆等顶尖学府人才组成。Kimi从最初支持20万汉字输入,升级至200万字无损上下文处理能力,成为全球长文本赛道的标杆产品。

1、特点

Mooncake解耦架构:

采用以KVCache为中心的创新架构,分离预填充与解码集群,充分利用GPU资源,推理吞吐量最高提升525%,响应速度提升3倍。这一技术支撑了Kimi处理百万字文档的高效性。

长文本与多模态融合:

200万字无损上下文,可一次性解析长篇论文、法律合同,支持PDF、Word、Excel等文件格式。 多模态升级,支持图文联合推理(如解析含数学公式的图片)、语音输入/播报功能,并开发浏览器插件实现网页划线提问和摘要生成。

深度推理与AIAgent:

2024年10月推出的Kimi探索版具备自主搜索能力,一次搜索可精读500个页面,结合思维链(CoT)技术实现复杂问题拆解与多步推理。例如律师用Kimi分析合同时,它能识别风险条款并给出法律建议。

2、发展

需要强化多模态能力,数学推理较弱,准确性低于其他竞品,例如解答数学题时常出现细节错误,还需要解决长文本处理的算力成本问题。

四、智谱清言:知识图谱的专家

智谱清言是由清华大学实验室与智谱AI联合开发的千亿级参数大模型,技术源自清华团队。专注于知识图谱,在知识抽取、融合等方面有优势,知识的系统性和准确性较高。

1、特点

知识图谱构建:

智谱清言通过构建大规模的知识图谱,将海量的信息进行结构化处理,使得模型能够更好地理解和运用知识,为用户提供更准确、更有深度的回答。

专业领域应用:

在一些专业领域,如法律、金融等,智谱清言能够基于其知识图谱,提供专业的咨询和建议,帮助用户解决复杂的问题。

2、发展

2025年计划开源最新系列模型,包括端侧推理模型和多模态Agent框架;联合硬件厂商,开发智能家居控制中枢和车载语音助手,拓展物联网场景。

五、通义千问:阿里云“行业全能手”

通义千问基于Transformer架构,通过创新的训练方法(如动态NTK感知插值、LogN-Scaling、窗口注意力机制)扩展上下文长度。

其千亿级参数规模(Qwen2.5-Max版本)结合混合专家模型(MoE)架构,在自然语言处理、多模态理解等任务中表现出色。

1、特点

通用性强:

通义千问适用于多种自然语言处理任务,包括文本生成、问答系统、机器翻译、文本分类等,在各个领域都能提供出色的表现。

多模态融合:

整合图文生成(通义万相)、音视频理解(通义星尘),支持PDF、Excel等多格式文件分析。

企业级服务闭环:

阿里云生态整合,无缝对接电商、物流、金融等行业解决方案(如天猫精灵智能客服)。私有化部署,支持本地服务器数据隔离,满足金融、政务等敏感场景需求。

开源影响力:

Qwen系列模型下载量突破1.8亿,衍生模型数达9万,超越Meta的Llama系列。

2、发展

推理模型升级,基于Qwen2.5-Max开发专用推理引擎,降低企业部署成本;多模态深度整合,推出支持4K视频生成、3D建模的“全能模型”(Omni-Models);AI-Agent生态,与Manus等平台合作开发智能体,实现复杂任务自动化。

六、横向对比:谁更适合你?

1、能力维度

智能度: DeepSeek≈通义千问>Kimi>智谱清言>豆包

响应速度: 豆包≈Kimi>通义千问>DeepSeek>智谱清言

准确率: DeepSeek(专业领域)>智谱清言(学术)>通义千问(行业)>Kimi(长文本)>豆包(日常)

2、适用场景

企业用户: 选DeepSeek(技术文档、金融分析)或通义千问(行业定制)。

学术党: Kimi读论文、智谱清言写报告,双剑合璧。

日常用户: 豆包聊天、追热点,Kimi整理资料,轻松搞定。

3、用户群体

技术开发者: DeepSeek的开源属性和低成本是首选。

学生/研究员: 智谱清言+Kimi,一个查资料一个写综述。

内容创作者: 豆包的抖音生态整合能力无敌。

写作最后:按需选择才是王道

要专业: DeepSeek、通义千问。

要好玩: 豆包。

要学术: Kimi、智谱清言。

要性价比: 豆包(日常)、DeepSeek(企业)。

686

686

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?