协同过滤itembase增量计算Spark实现

Controller

1. 数据统计

user count:=========>8239237

itemCode count:=====>7421567

spark result distinct count ======>5826484

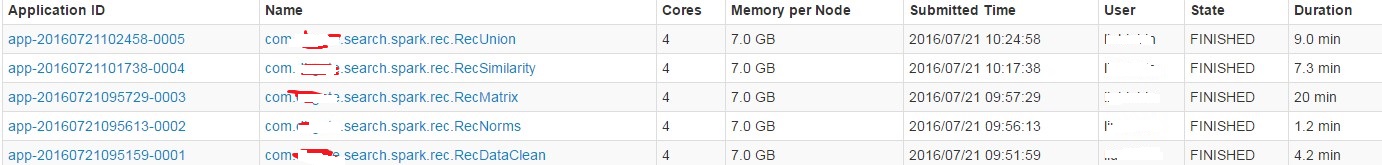

2. 运行子任务

倒叙

3. Spark集群信息

Spark初始化采用硬资源分配,计算过程中动态进行资源分配。

协同过滤为大数据依赖型,需大内存,cpu要求一般

4. 参数配置

| sparkConf.set("spark.executor.memory","7G"); sparkConf.set("spark.executor.cores","1"); sparkConf.set("spark.executor.heartbeatInterval","20s"); sparkConf.set("spark.kryoserializer.buffer.max","256m"); sparkConf.set("spark.speculation","true"); sparkConf.set("spark.worker.timeout","500"); sparkConf.set("spark.core.connection.ack.wait.timeout","600"); sparkConf.set("spark.cores.max", "4"); |

5. 输出文件命名规则

本文详细介绍了在Spark上实现协同过滤itembase增量计算的过程,包括Controller、recDataClean、recNorms、recMatrix、recSimilarity和union等步骤。文中提到的数据统计、参数配置以及Spark集群信息对理解计算过程至关重要。通过对各阶段的Spark DAG图描述,展示了如何处理增量数据并更新共生矩阵、相似度矩阵,最后讨论了union操作的关键点。

本文详细介绍了在Spark上实现协同过滤itembase增量计算的过程,包括Controller、recDataClean、recNorms、recMatrix、recSimilarity和union等步骤。文中提到的数据统计、参数配置以及Spark集群信息对理解计算过程至关重要。通过对各阶段的Spark DAG图描述,展示了如何处理增量数据并更新共生矩阵、相似度矩阵,最后讨论了union操作的关键点。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

610

610

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?