前言

b站刘洪普老师的pytorch入门课笔记。记录学习。

本文内容为逻辑斯蒂回归示例。

方法

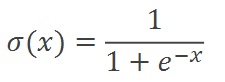

逻辑斯蒂回归函数为:

虽然它的名字中带有回归,但事实上它并不是一种回归算法,而是一种分类算法。它的优点是,它是直接对分类的可能性进行建模的,无需事先假设数据分布,这样就避免了假设分布不准确所带来的问题,因为它是针对于分类的可能性进行建模的,所以它不仅能预测出类别,还可以得到属于该类别的概率。

关于激活函数

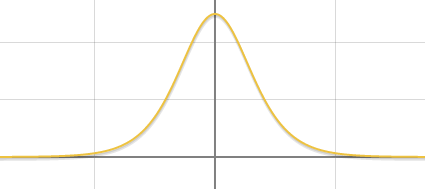

一个函数是否是激活函数需要看三点,而逻辑斯蒂曲线就是典型的激活函数。

1、范围[-1,1]

2、单调增

3、饱和函数

饱和函数即其导数符合这样的曲线

jupyter record

与线性回归不同的地方是,前馈过程需要经过一次逻辑斯蒂激活函数将数据归到[0,1]范围内,且这里使用的损失是BCELoss,即交叉熵损失。

import torch

import torch.nn.functional as F

# 第一步,准备数据集

x_data = torch.Tensor([[1.0],[2.0],[3.0]])

y_data = torch.Tensor([[0],[0],[1]])

# 第二步,使用类设计模型,继承自nn.Module

class LogisticRegressionModel(torch.nn.Module):

def __init__(self):

super(LogisticRegressionModel,self).__init__()

self.linear = torch.nn.Linear(1,1)

def forward(self,x):

y_pred = F.sigmoid(self.linear(x))

return y_pred

model = LogisticRegressionModel()

# 第三步,构建损失和优化器

criterion = torch.nn.BCELoss(size_average = False)

optimizer = torch.optim.SGD(model.parameters(),lr = 0.01)

# 第四步,训练阶段:前馈,反馈,更新

for epoch in range(1000):

y_pred = model(x_data)

loss = criterion(y_pred,y_data)

print(epoch,loss.item())

optimizer.zero_grad()

loss.backward()

optimizer.step()

0 2.870121955871582

1 2.852933168411255

2 2.836561918258667

3 2.8209731578826904

4 2.8061323165893555

5 2.7920048236846924

6 2.778557300567627

7 2.765756130218506

8 2.7535696029663086

9 2.7419652938842773

…

991 1.173973560333252

992 1.1733458042144775

993 1.17271888256073

994 1.1720927953720093

995 1.1714673042297363

996 1.1708428859710693

997 1.1702193021774292

998 1.1695961952209473

999 1.1689739227294922

总结

以上就是逻辑斯蒂回归的示例了,其中的四个步骤可以作为一个框架来学习。

1415

1415

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?