1. 引言

极限学习机(extreme learning machine)ELM是一种简单易用、有效的单隐层前馈神经网络SLFNs学习算法。2004年由南洋理工大学黄广斌副教授提出。传统的神经网络学习算法(如BP算法)需要人为设置大量的网络训练参数,并且很容易产生局部最优解。极限学习机只需要设置网络的隐层节点个数,在算法执行过程中不需要调整网络的输入权值以及隐元的偏置,并且产生唯一的最优解,因此具有学习速度快且泛化性能好的优点。

其主要思想是:输入层与隐藏层之间的权值参数,以及隐藏层上的偏置向量参数是 once for all 的(不需要像其他基于梯度的学习算法一样通过迭代反复调整刷新),求解很直接,只需求解一个最小范数最小二乘问题(最终化归成求解一个矩阵的 Moore Penrose广义逆问题)。因此,该算法具有训练参数少、速度非常快等优点。接下来的若干年,黄教授带领的团队在此基础上又做了更多的发展,例如,将ELM推广到复数域,提出基于 ELM 的在线时序算法等等。

2. 基本描述

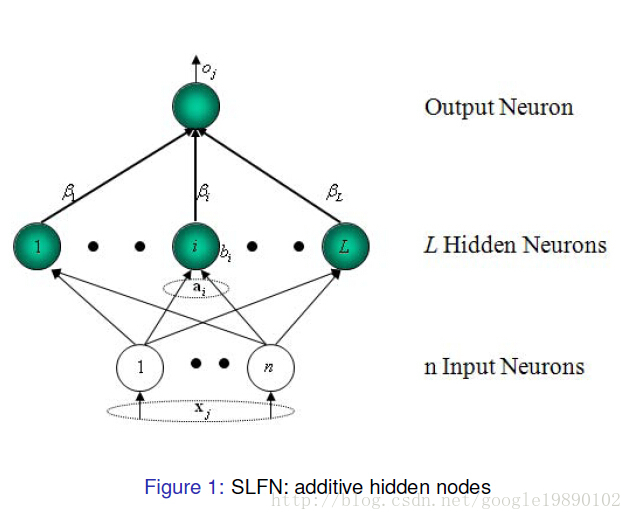

对于一个单隐层前馈神经网络(Single-hidden Layer Feedforward Networks, SLFNs),结构如下图所示

为描述方便,引入以下记号:

- N :训练样本总数

-

- n,m :输入和输出层的维度(即输入和输出向量的长度)

- (xj,tj),j=1,2,...,N :训练样本(要求它们是distinct的),其中

将所有输出向量按行拼接起来,可得到整体输出矩阵

极限学习机(ELM)是一种单隐层前馈神经网络算法,由黄广斌副教授于2004年提出。与传统神经网络不同,ELM不需要迭代调整输入权重和偏置,只需一次性设置隐藏层节点数,通过最小范数最小二乘问题求解,实现快速训练和良好泛化性能。ELM避免了BP算法的局部最优、过拟合和耗时问题,但在多层结构中应用受限。

极限学习机(ELM)是一种单隐层前馈神经网络算法,由黄广斌副教授于2004年提出。与传统神经网络不同,ELM不需要迭代调整输入权重和偏置,只需一次性设置隐藏层节点数,通过最小范数最小二乘问题求解,实现快速训练和良好泛化性能。ELM避免了BP算法的局部最优、过拟合和耗时问题,但在多层结构中应用受限。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2996

2996

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?