1. 使用Cherry Studio部署,适合小白

简介

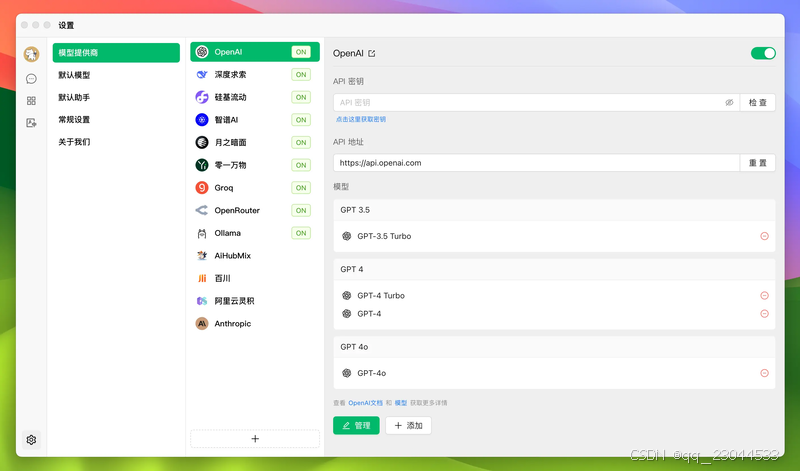

Cherry Studio 内置了很多服务商,集成了超过 300 多个大语言模型。在使用过程中,你可以随意切换模型来回答问题,充分利用各个大模型的优势解决问题。目前,已经集成的常用服务商

下载链接:客户端下载 | CherryStudio (cherry-ai.com)

大模型配置

选择自己使用的大模型,配置api秘钥(需要去各自官网申请“点击这里获取秘钥”),deepSeek api地址:https://api.deepseek.com

2.使用LM Studio部署,适合小白

简介

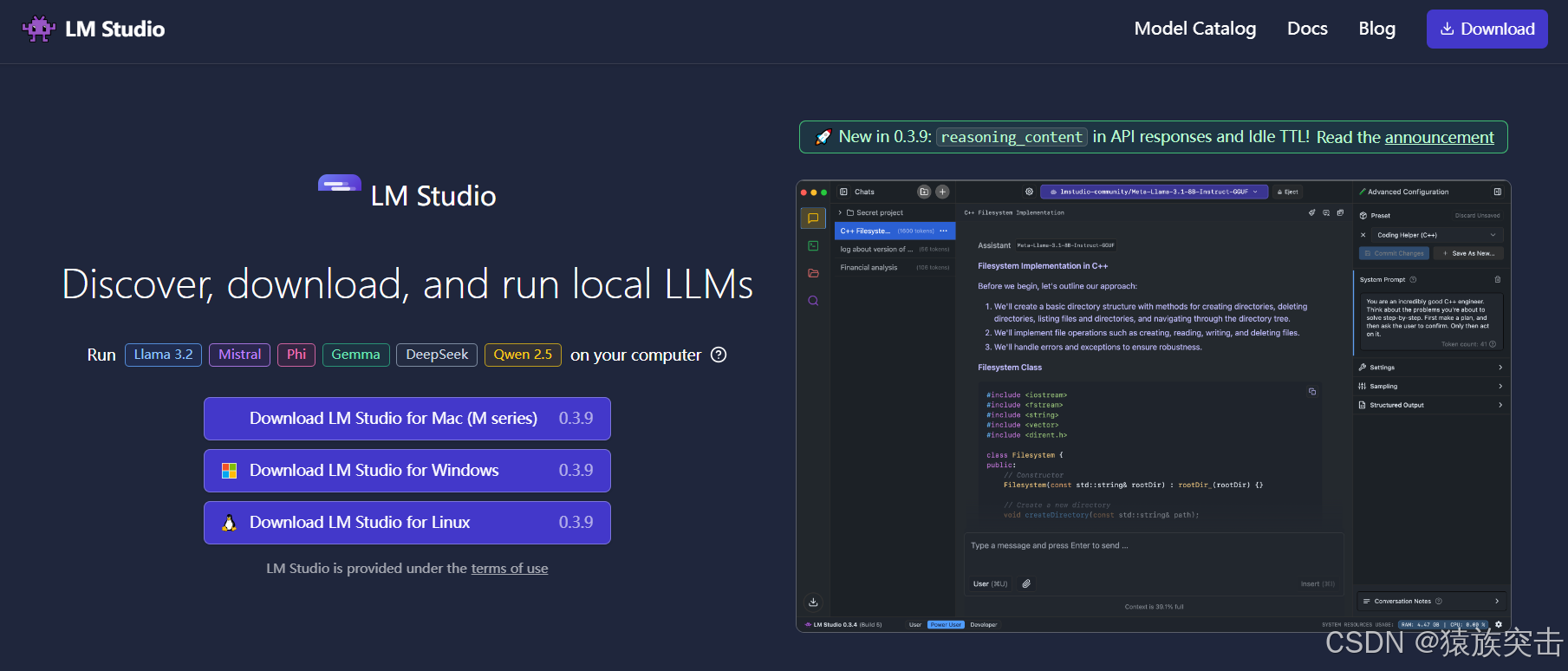

LM Studio 是一款用于在您的电脑上开发和实验LLMs的桌面应用程序。

下载链接:Download LM Studio - Mac, Linux, Windows

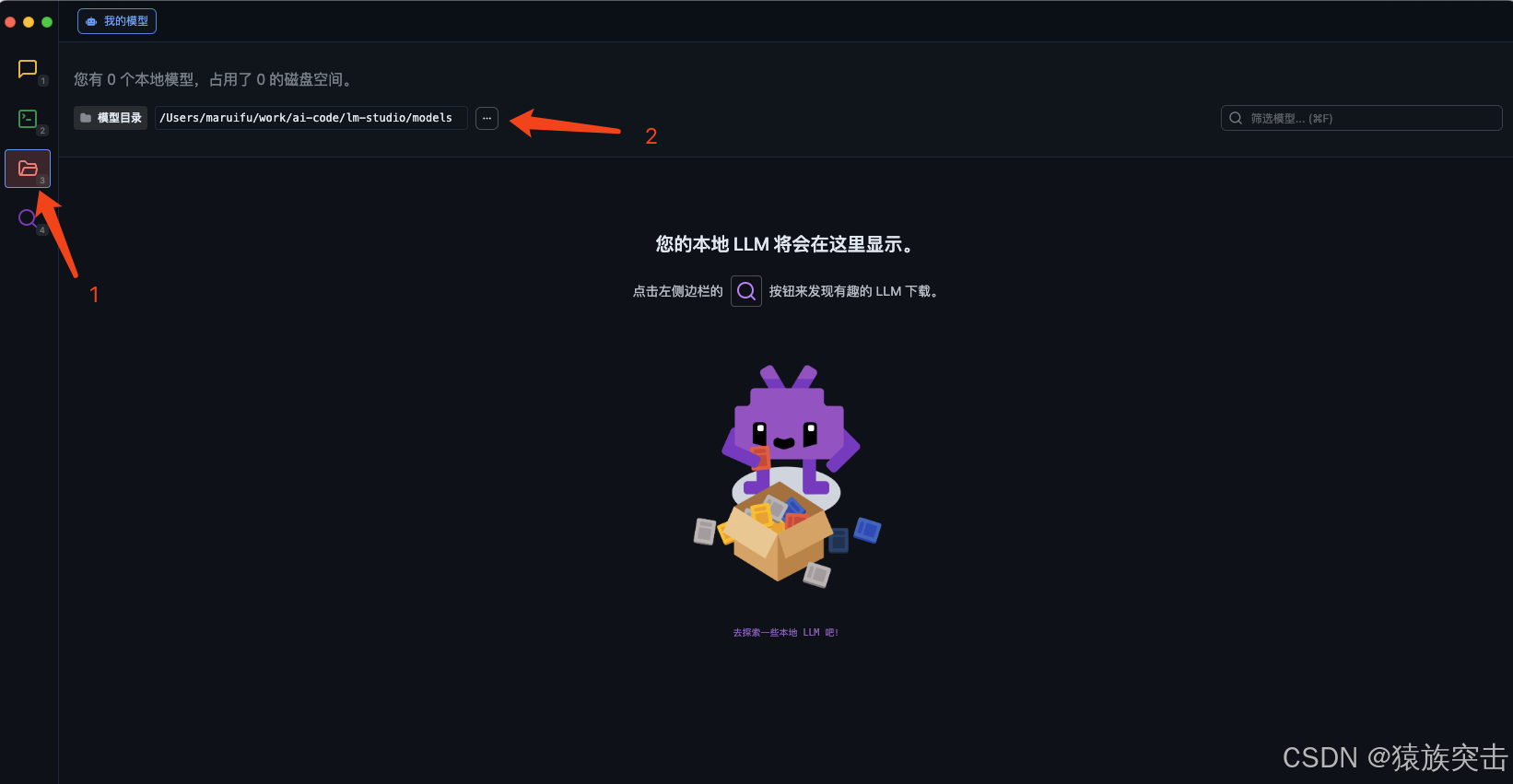

设置模型目录

模型目录最好不要有中文特殊符号,最好是英文字母

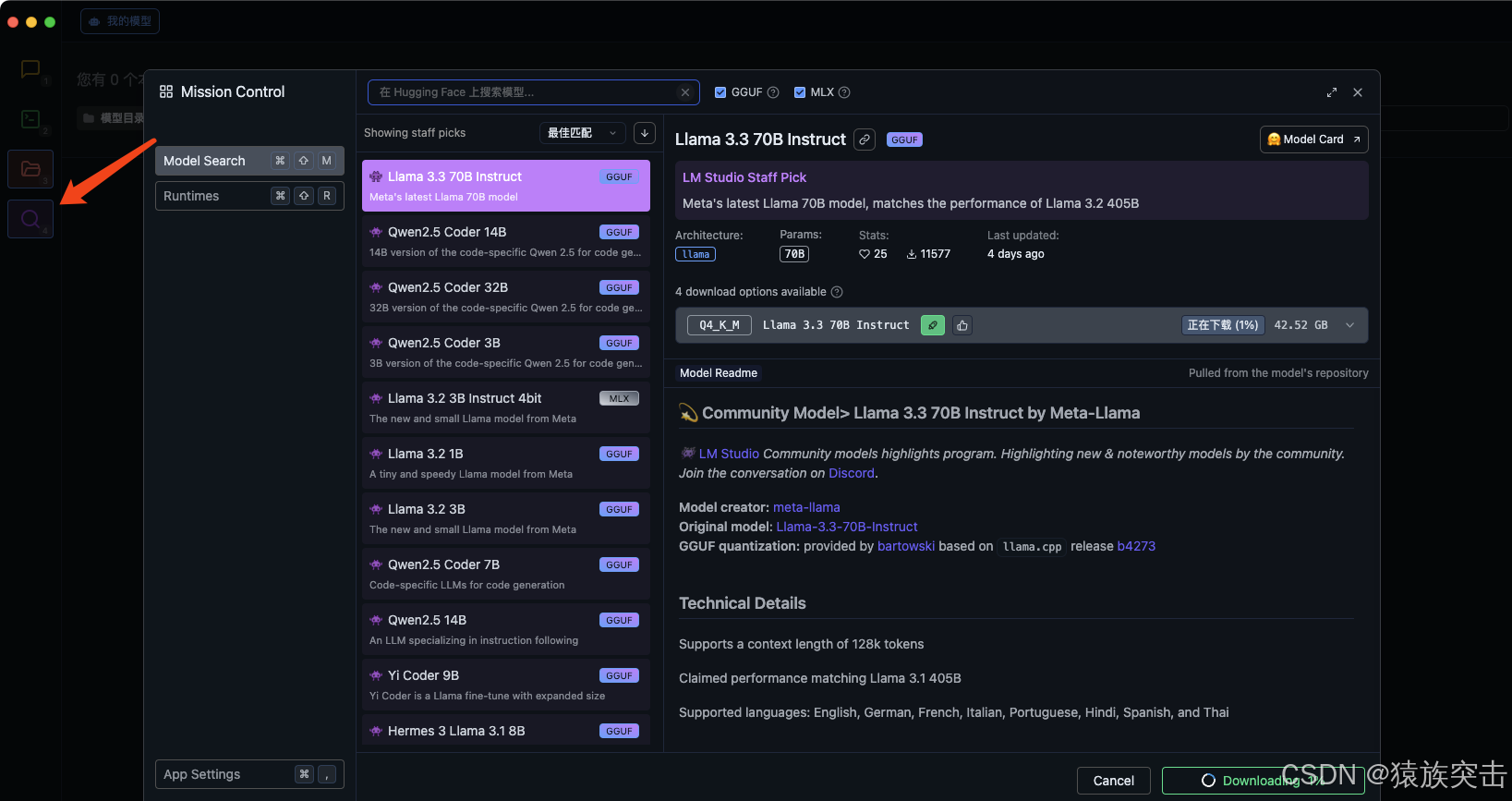

下载模型

如果可以访问国外网站

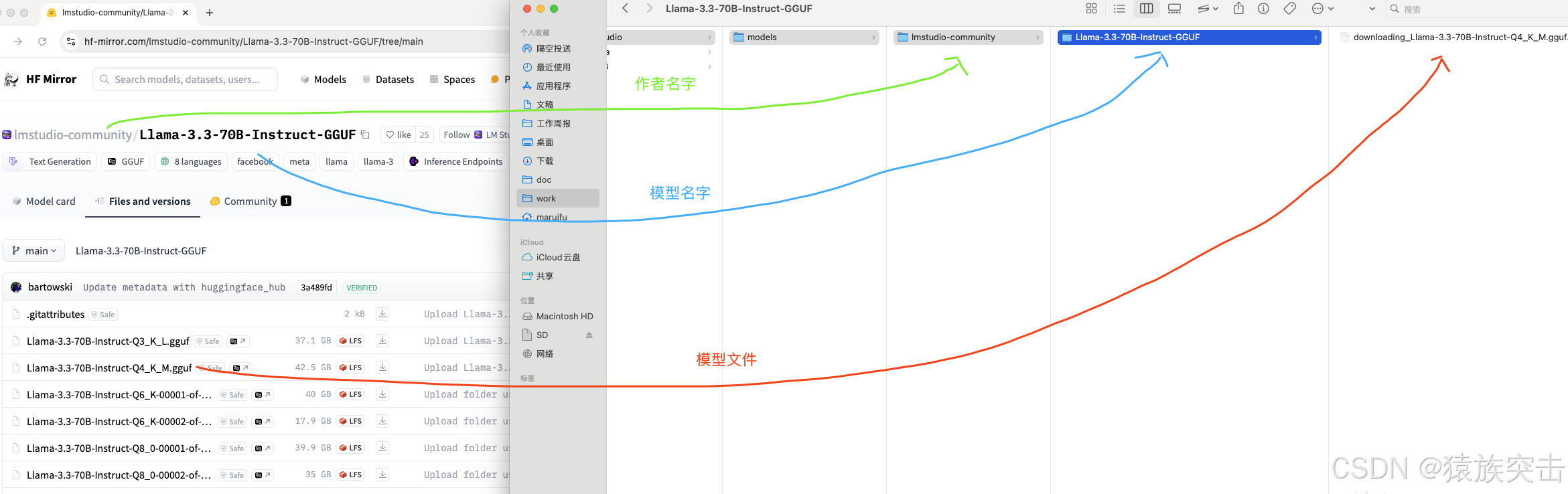

镜像网站下载

https://hf-mirror.com/

下载gguf模型放到前面设置的模型目录里面

3.使用Ollama部署,适合有一定大模型操作基础

简介

Ollama 是一款在本地环境中运行和管理大型语言模型(LLMs)的开源工具。它为开发者、研究人员和爱好者提供了一个高效、易用的平台,能够快速实验、管理和部署最新的大语言模型。

下载链接:Download Ollama on Windows

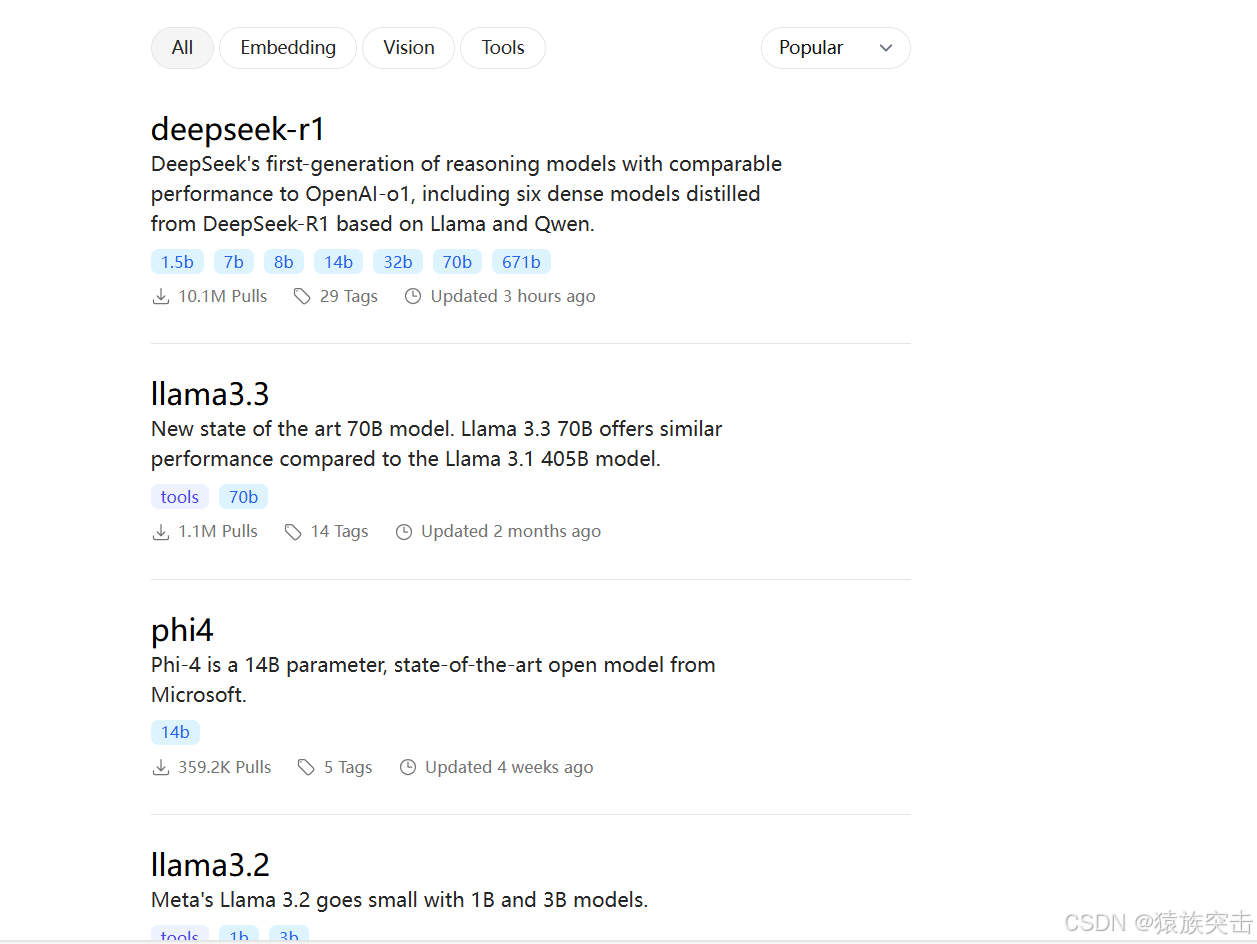

下载模型

支持主流以及最新大模型

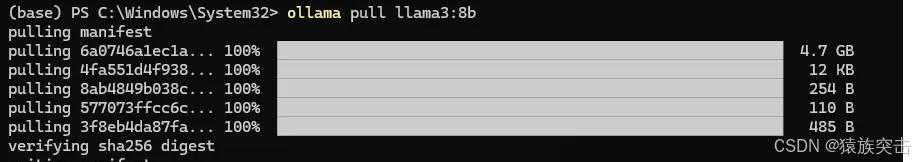

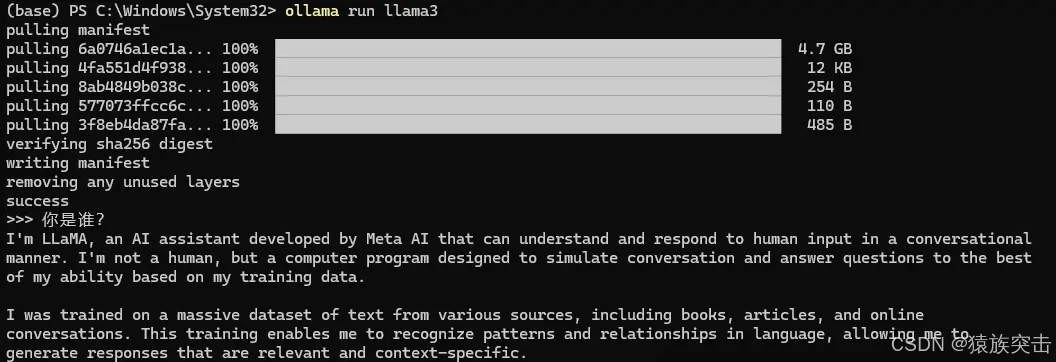

安装模型

下载llama3:8b,冒号前面为模型名称,冒号后面型号,也是模型参数大小。

ollama pull llama3:8b

运行模型

ollama run llam3

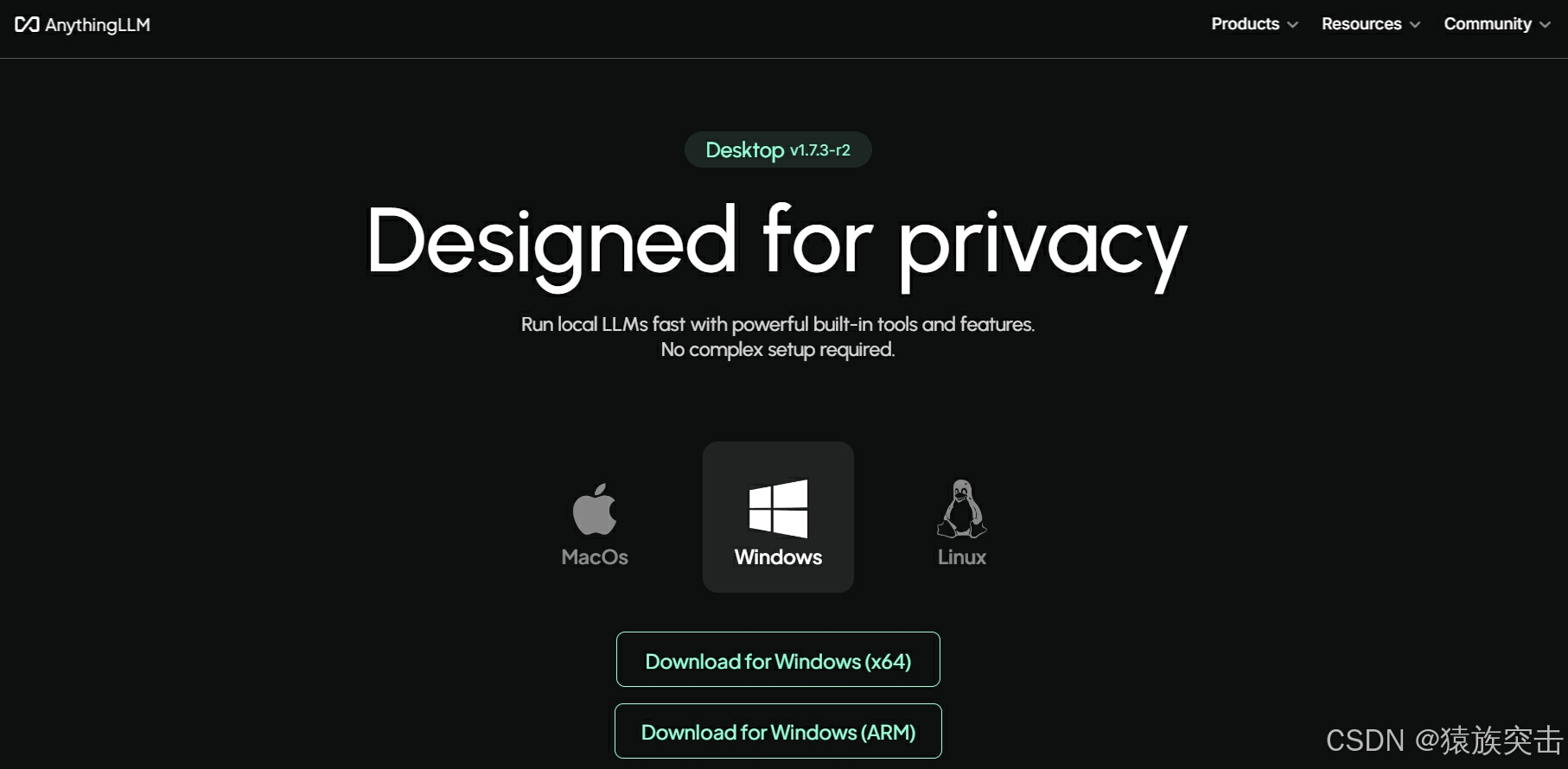

4.使用AnythingLLM部署,适合小白

简介

AnythingLLM 是 Mintplex Labs Inc. 开发的一款开源 ChatGPT 等效工具,用于在安全的环境中与文档等进行聊天,专为想要使用现有文档进行智能聊天或构建知识库的任何人而构建。

AnythingLLM 能够把各种文档、资料或者内容转换成一种格式,让LLM(如ChatGPT)在聊天时可以引用这些内容。然后你就可以用它来和各种文档、内容、资料聊天,支持多个用户同时使用,还可以设置谁能看或改哪些内容。支持的多种LLM、嵌入器和向量数据库。

下载地址:Download AnythingLLM for Desktop

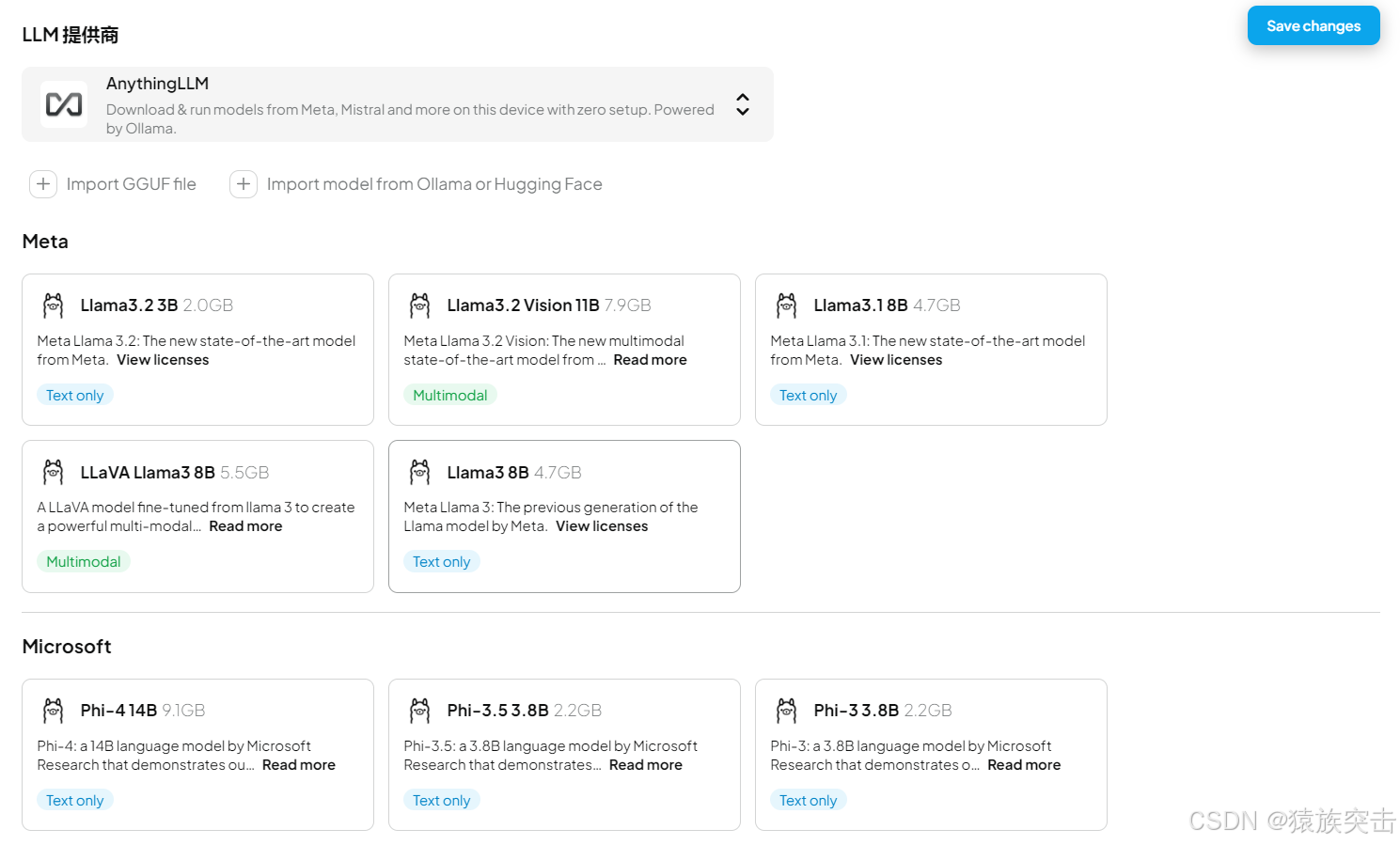

下载模型

也可以Import model from Ollama or Hugging Face ,接受更丰富的大模型;

还可以搜索想要的大模型

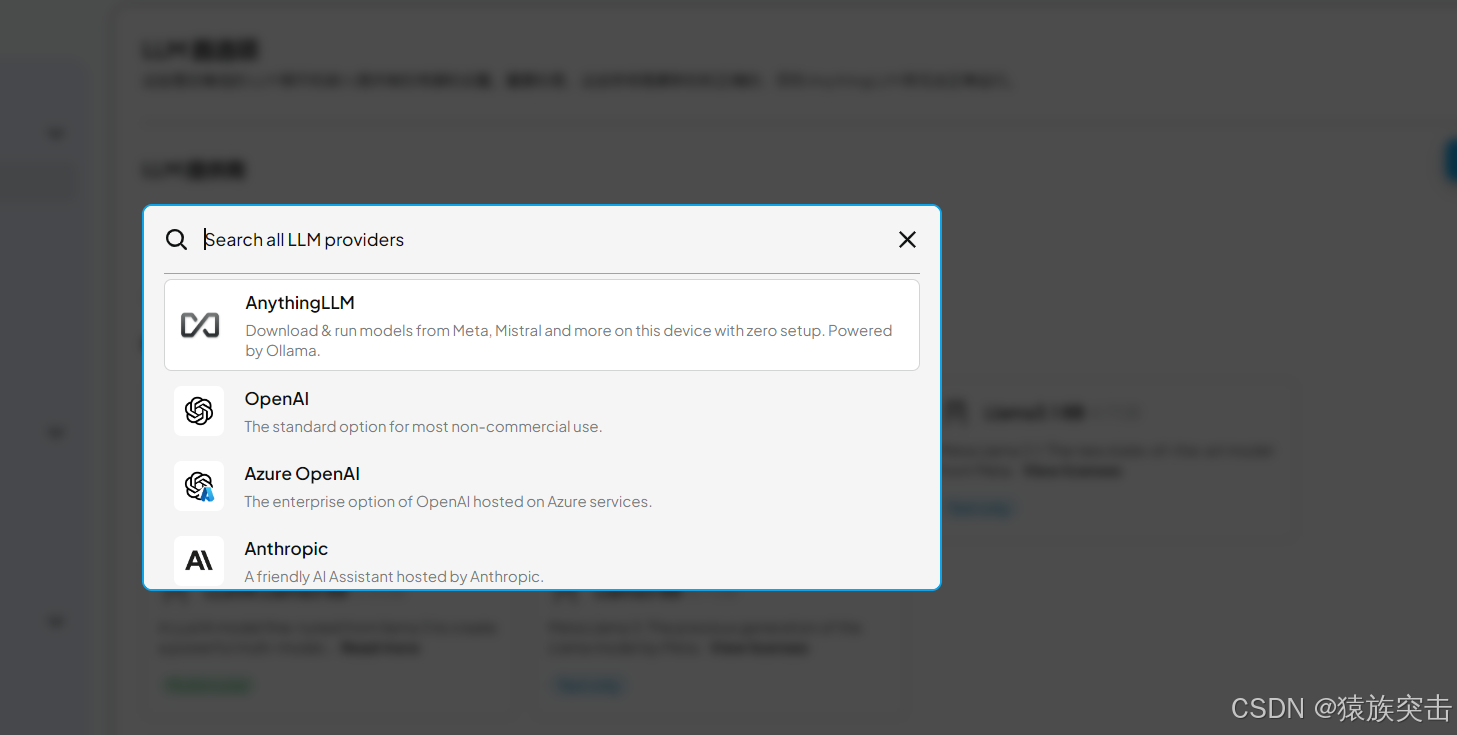

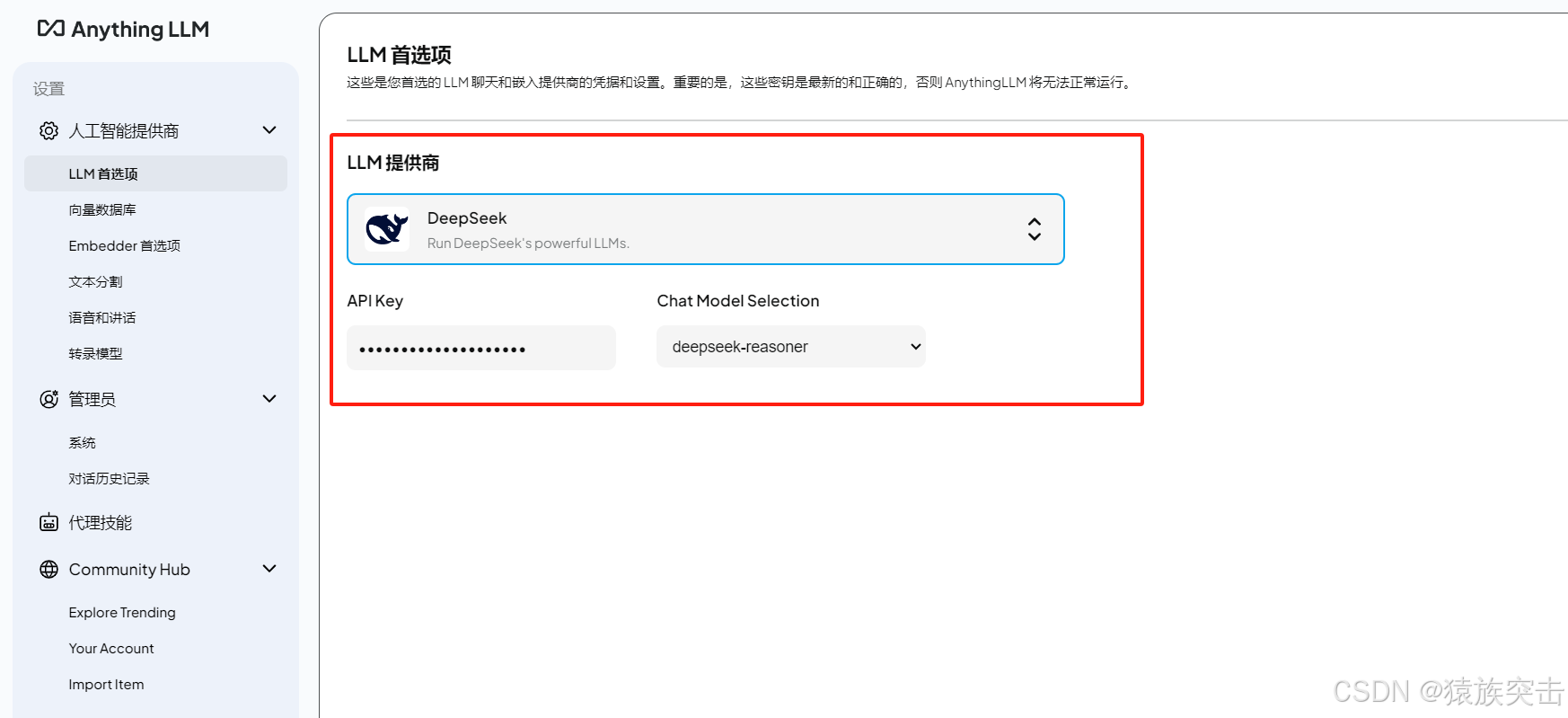

大模型配置

有些大模型需要API Key,那就要区对应官网申请;有些不需要API Key,直接选择使用即可

向量数据库和Embedder首选项 可以使用默认的,不需要改

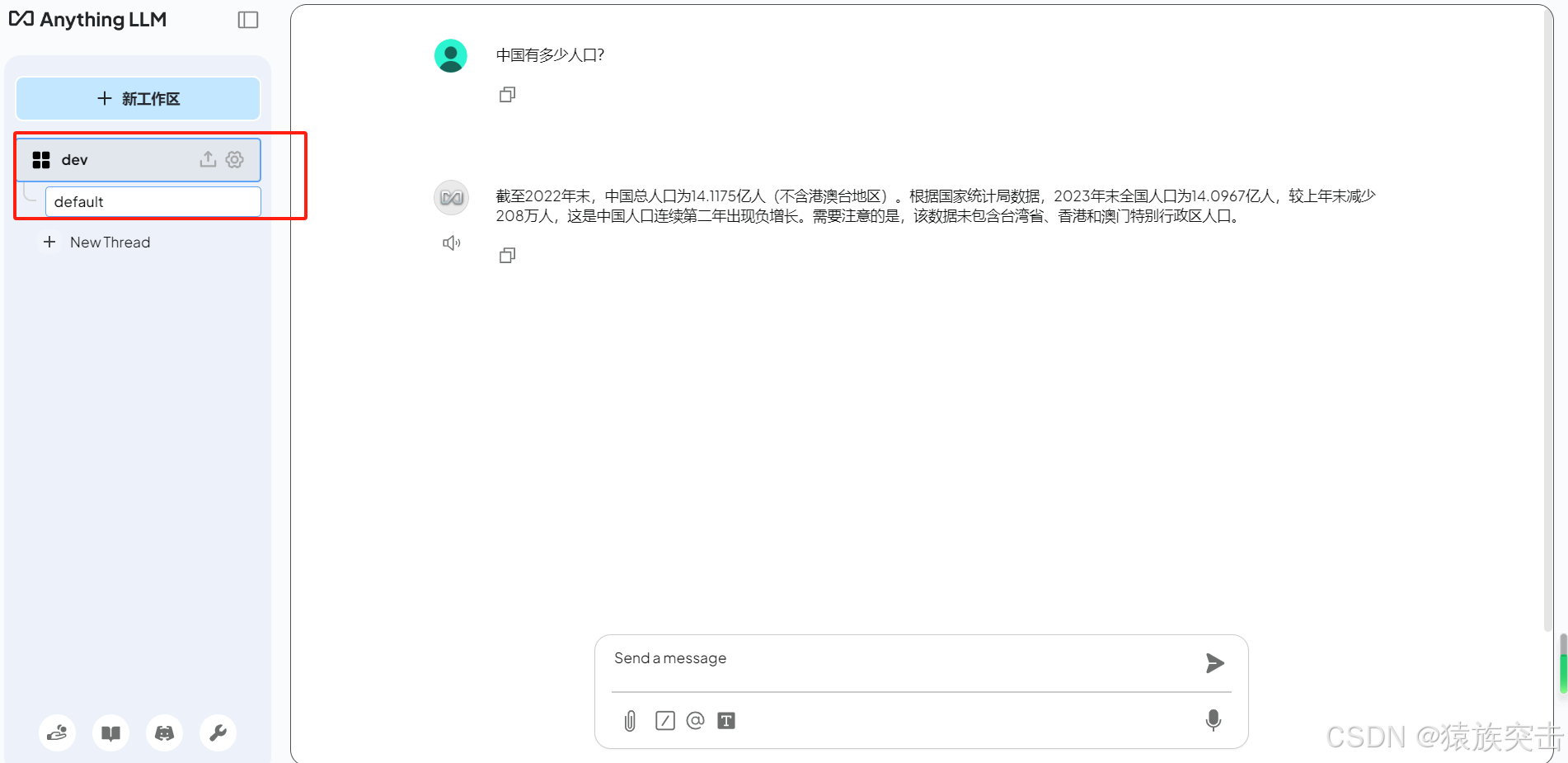

设置工作区

新建工作,名字自拟,这样就可以聊天了;

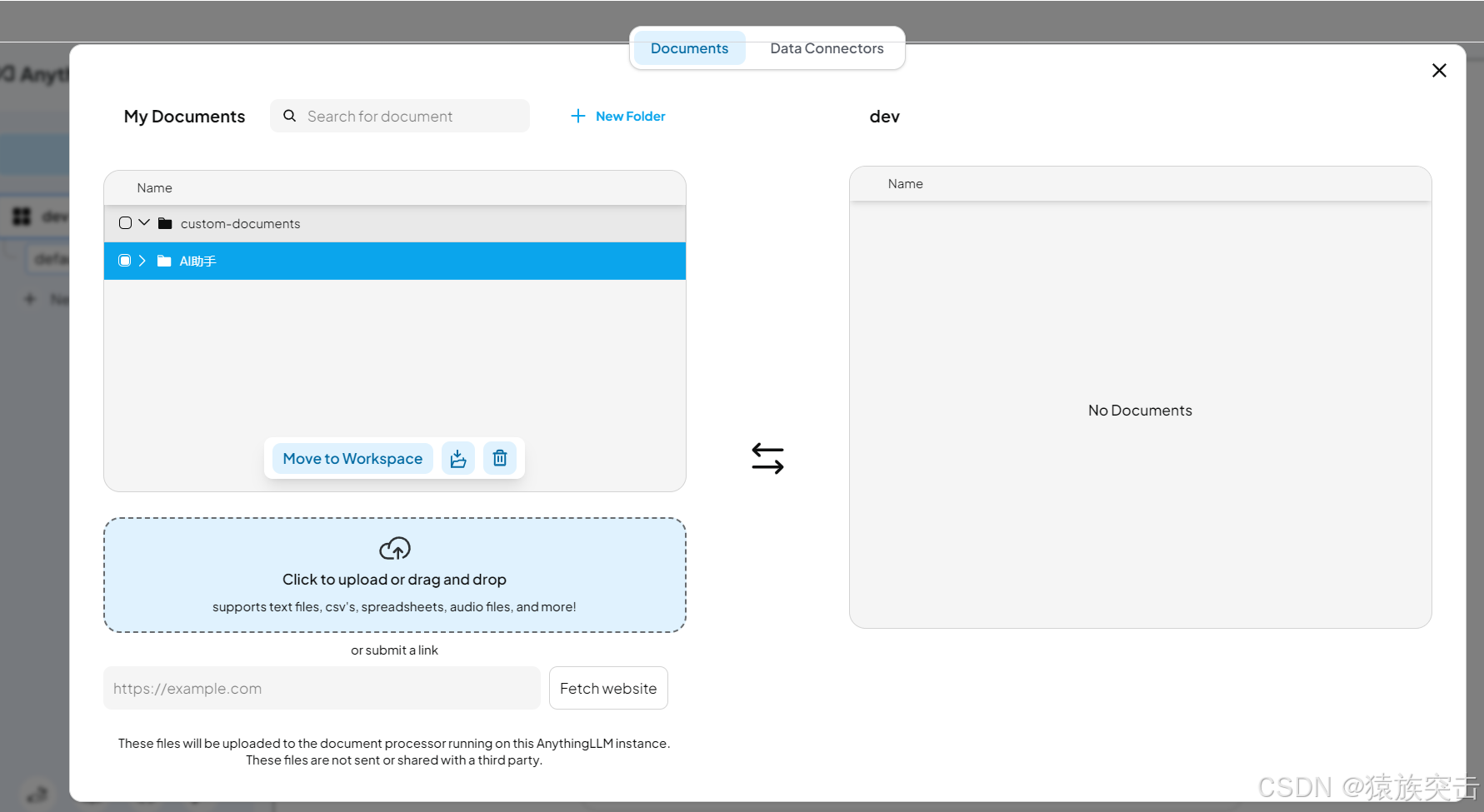

也可以添加训练文本,这样可以构建自己的知识库

1598

1598

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?