完全中文注释的Transformer,附数据处理及运行模拟

学习Transformer时走了非常多的弯路,这里制作了一个pytorch版本图-文-注释-代码对照的Transformer,每个结构都进行了完全的注释,并且还附加了一个中译英的单样本样例分析

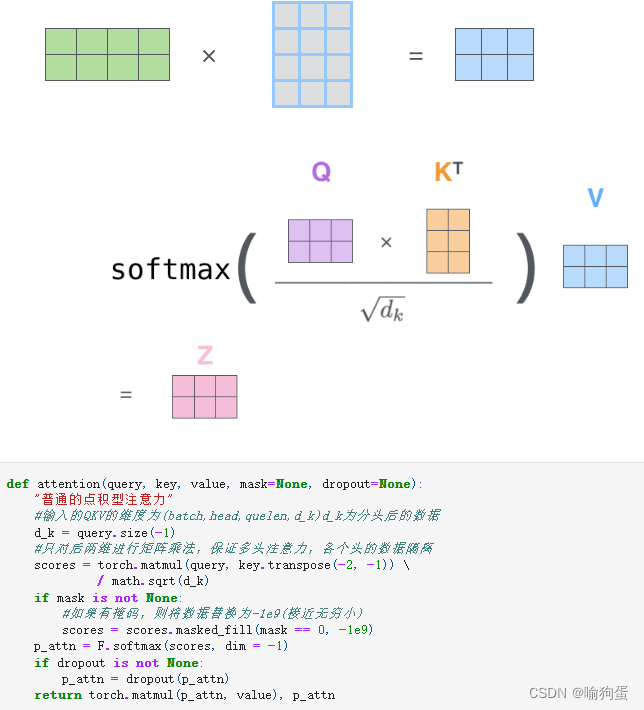

这里是部分截图,重要结构都配了示意图,每个结构都有对应的介绍,代码里还有数据运行时的形状注释

并且附上了一个中译英一个样本的数据流程和对应数据集

还没有写批量训练的代码,有些地方还没想通,如:句子长度不同decoder的输入batch的大小也就不同,那么训练时会不会影响训练速度呢?我想这就是教学版代码的局限性吧,真正训练还是用pytorch提供的Transformer吧,那个更方便一些。这个只是方便学习的

github链接

请一定帮我点星星,真的是非常累,用了两周才制作完成

感谢哈佛贡献的精简且易懂的代码 以下为网址

哈佛Transformer教学代码

感谢知乎 迷途小书僮 的中文注释,在我学习时帮助了很多,我重写了注释和文档,并加入自己的理解

知乎Transformer注释

如果觉得不妥,请一定联系我

258

258

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?