每天给你送来NLP技术干货!

来自:浙大KG

论文题目:Robust Triple Extraction with Cascade Bidirectional Capsule Network

本文作者:张宁豫(浙江大学)、邓淑敏(浙江大学)、叶宏彬(浙江大学)、张伟(阿里巴巴),陈华钧(浙江大学)

接收期刊:Expert Systems With Applications

论文链接:https://www.sciencedirect.com/science/article/pii/S095741742101174X

一、研究背景

三元组抽取,即从自然语言文本中,抽取出特定的事实三元组信息, 这些信息通常包括实体(entity)、关系(relation)。一般来说,实体关系抽取采用基于管道的方法,也就是采用两个模型分别抽取实体和实体之间的关系。由于管道的方法存在误差传递,学者们又提出了诸多端到端的实体关系抽取方法,如PURE[1]、CasRel[2]、TPLinker[3]、CopyRE[4]、CopyMTL[5]、CGT[6],更加详细的方法分类可以查看[7]。

二、动机

我们在分析端到端实体关系抽取错误案例的时候发现,大多数错误可以被归类为以下两种类型。首先,我们发现大多数被被误判的关系是由于上下文存在较大的歧义性。例如,对于关系cities_of_residence和 countries_of_residence,由于这两类关系的上下文非常类似,仅仅是头尾实体类型有略微的区别(city和country)。这些语义相似的上下文容易引起模型的误判,进而抽取出错误的三元组。其次,我们发现模型会犯一些低级错误,抽取出违反既定schema的三元组知识。例如,has_religion关系的头实体和尾实体必须分别是人和信仰而不能是其他类型的实体。一般来说,实体关系之间存在一定的约束,实体的类型能促进关系的判别,而关系的类型也能约束实体的抽取。

三、方法

基于以上发现,我们提出了级联双向胶囊网络(CBCapsule)来进行实体关系三元组抽取。我们的模型主要通过多个胶囊网络层进行不同粒度(词、实体、关系)的信息聚合,并通过双向信息传递机制来隐式建模实体关系之间的约束。我们的模型主要分为词胶囊层、实体胶囊层和关系胶囊层。词胶囊层通过编码器的向量进行重组编码,并构建若干词胶囊作为实体胶囊层的输入。实体胶囊层由不同的细粒度实体类型构成,每个胶囊都代表了一种类型的细粒度实体。关系胶囊层由不同的关系组成。模型在不同的胶囊层之间存在双向的信息传递。一方面,会基于动态路由算法将信息由词胶囊层传递到实体胶囊层进而传递到关系胶囊层。另一方面,为了通过关系类型约束实体信息,模型增加了一个反向的信息链路来通用关系胶囊层来约束词胶囊层。下图是模型的总体架构:

四、实验

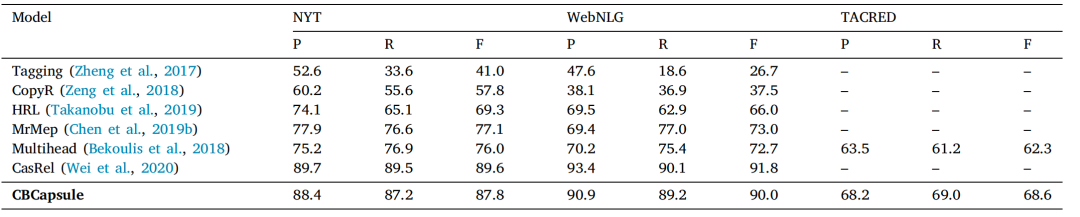

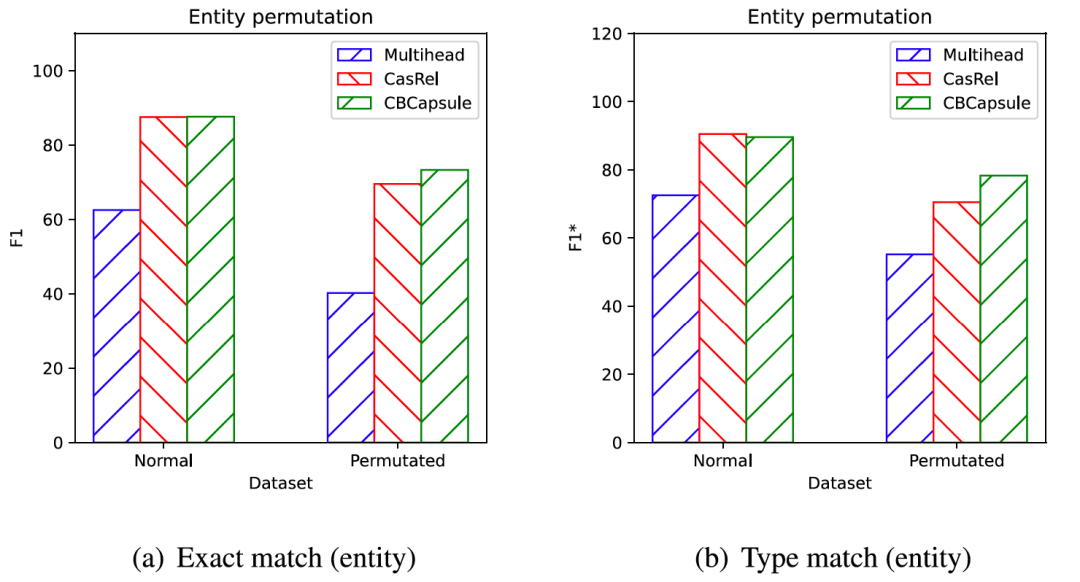

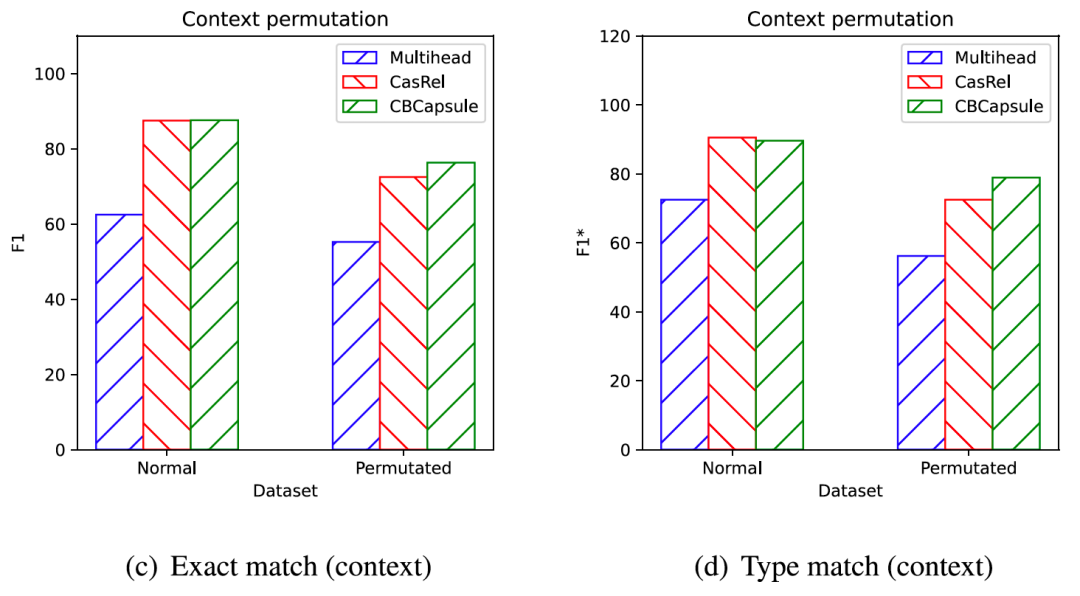

我们分别对三个基准数据集进行了实验:NYT,WebNLG和TACRED。我们在三个数据集上都取得了较好和可比的效果。此外我们还进行了鲁棒性实验。我们将测试集中的实体随机替换成其他类型的实体(Entity permutation),或将实体间的上下文进行扰动(Context permutation)分析。实验结果表明,我们的模型具备一定程度的鲁棒性。

详细的技术细节可以阅读我们的论文。

[1]A Frustratingly Easy Approach for Joint Entity and Relation Extraction

[2]A Novel Cascade Binary Tagging Framework for Relational Triple Extraction

[3]TPLinker : Single-stage Joint Extraction of Entities and Relations Through Token Pair Linking

[4]Extracting Relational Facts by an End-to-end Neural Model with Copy Mechanism

[5]CopyMTL: Copy Mechanism for Joint Extraction of Entities and Relations with Multi-Task Learning

[6]Contrastive Triple Extraction with Generative Transformer

[7]NLP中的实体关系抽取方法总结https://zhuanlan.zhihu.com/p/77868938

投稿或交流学习,备注:昵称-学校(公司)-方向,进入DL&NLP交流群。

方向有很多:机器学习、深度学习,python,情感分析、意见挖掘、句法分析、机器翻译、人机对话、知识图谱、语音识别等。

记得备注呦

整理不易,还望给个在看!

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?