近年来,以ChatGPT为代表的LLM不仅改变了人机交互方式,更催生了新一代「智能代理」(AI Agent)。它们不再是简单的问答机器,而是能主动规划、协作、甚至自我进化的「数字员工」。

论文:Large Language Model Agent: A Survey on Methodology, Applications and Challenges

论文:Large Language Model Agent: A Survey on Methodology, Applications and Challenges

链接:https://arxiv.org/pdf/2503.21460

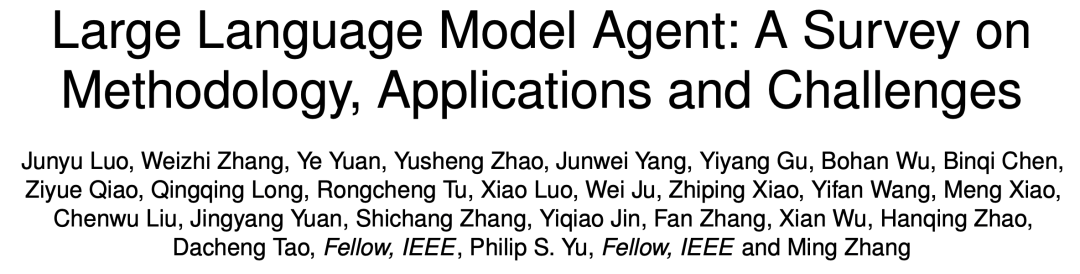

这篇综述系统梳理了LLM代理的核心技术、应用场景与挑战,堪称「AI代理百科全书」。论文提出一个关键观点:LLM代理可能是通向通用人工智能(AGI)的关键路径。

本文将从下面四个方面进行一一展开:

方法篇

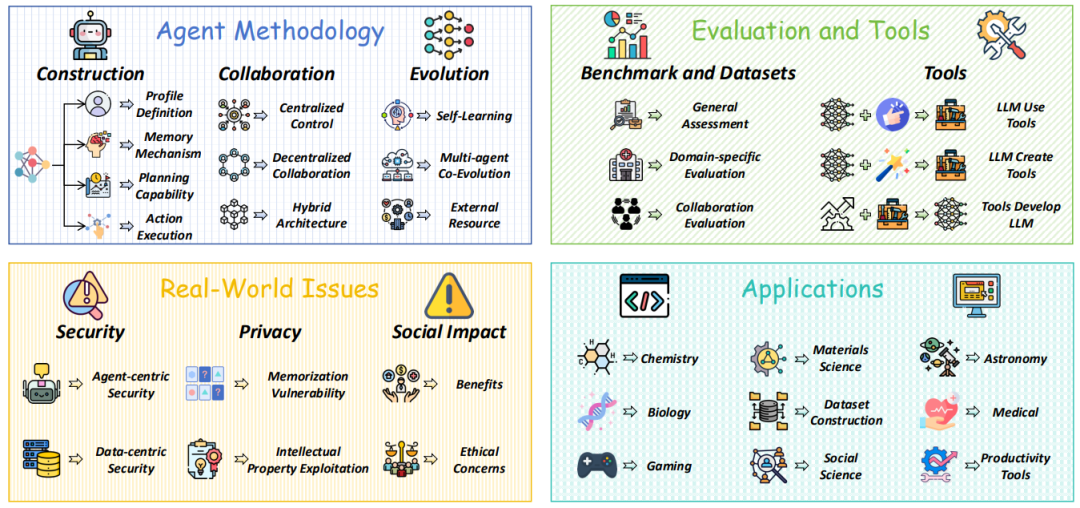

核心四件套:

核心四件套:

角色定义:像给员工分配岗位一样,为AI设定身份(如程序员、医生),甚至批量生成不同性格的「数字社会」。

记忆机制:短期记忆处理当下任务(如对话记录),长期记忆积累经验(如代码库),还能调用外部知识库「现学现卖」。

规划能力:把复杂任务拆解成小目标,像人类一样「试错修正」,甚至用蒙特卡洛树搜索优化决策。

行动执行:调用计算器、搜索引擎等工具,或操控机器人完成物理动作。

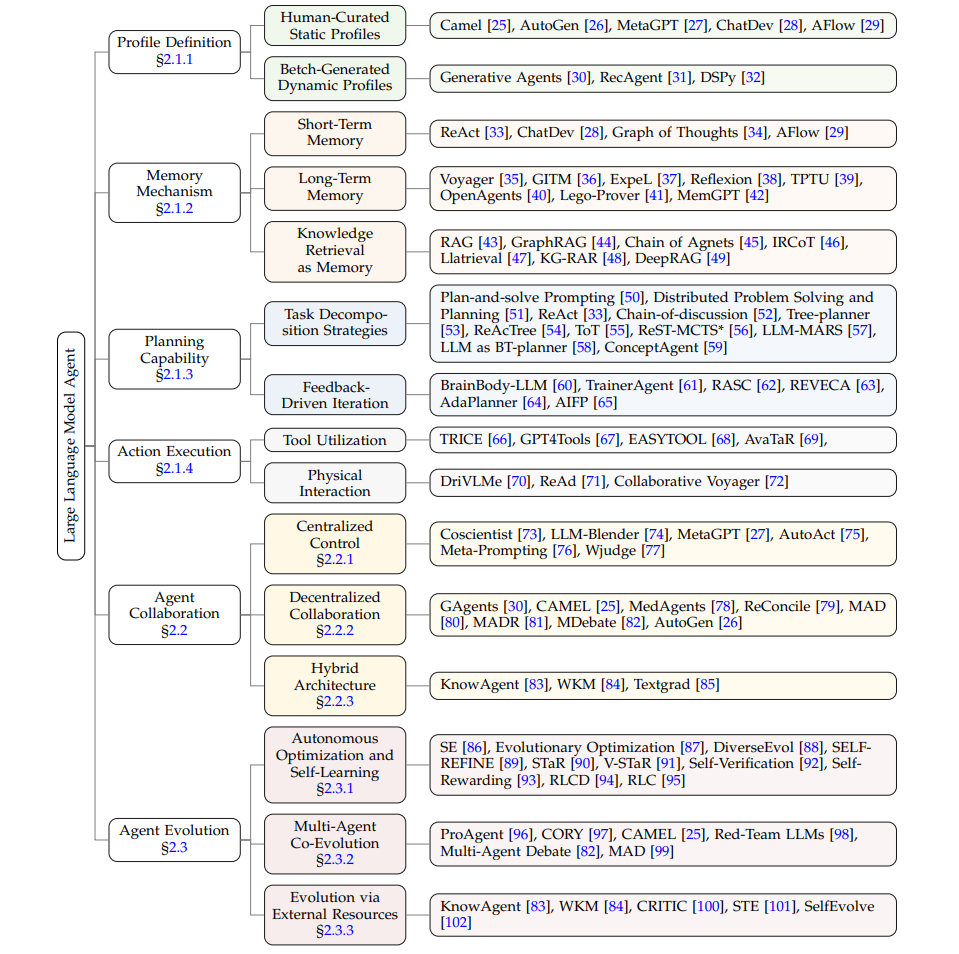

协作篇

中央指挥部:一个「主管」AI指挥分工,适合流程严谨的场景(如药物研发)。

自由辩论模式:多个AI互相质疑修正,像人类开会一样达成共识。

混合架构:动静结合,比如MetaGPT用「管理层」定战略,基层AI灵活执行。

进化篇

自我学习:通过反思错误、生成奖励信号,像学生刷题一样提升能力。

多代理协同进化:AI之间既合作又竞争,比如让「红队」AI专门挑刺,迫使主模型更严谨。

外部资源驱动:结合知识图谱、人类反馈,让AI「站在巨人肩膀上」。

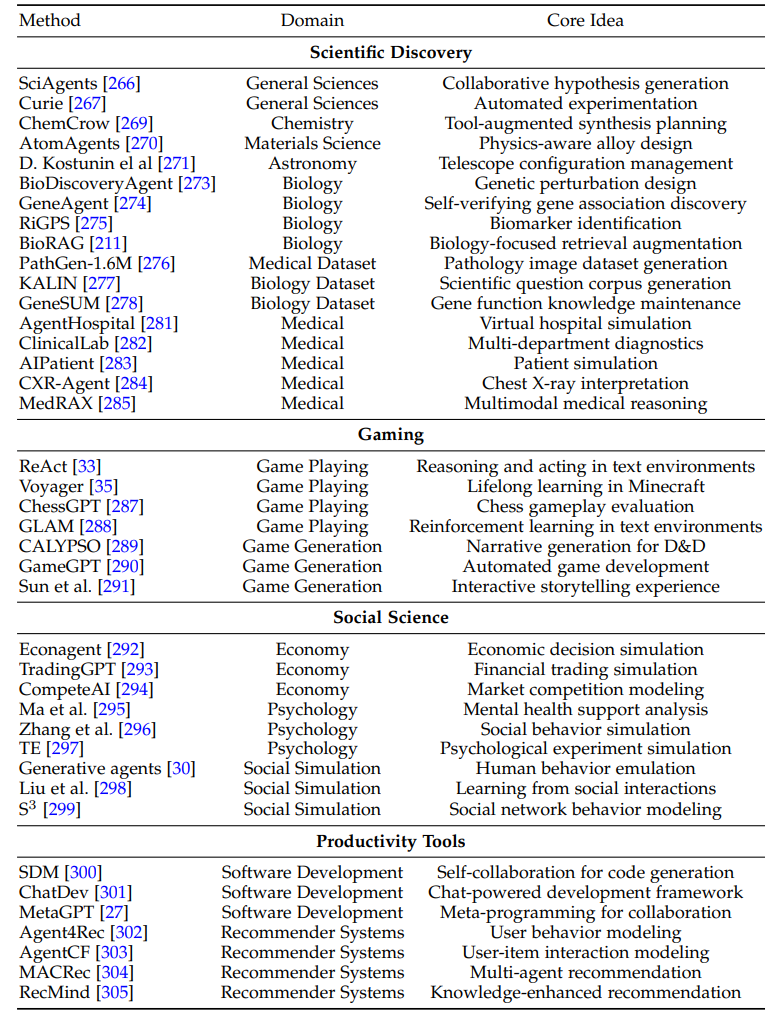

5. 落地应用:从科研到游戏

科学发现:化学代理设计分子合成路径,天文学代理管理望远镜数据库。

医疗诊断:虚拟医院中,AI医生问诊、开检查单,甚至模拟患者行为。

游戏开发:AI自动生成剧情关卡,玩家在《我的世界》里遇见「终身学习型NPC」。

生产力工具:自动写代码、做推荐,替代重复性脑力劳动。

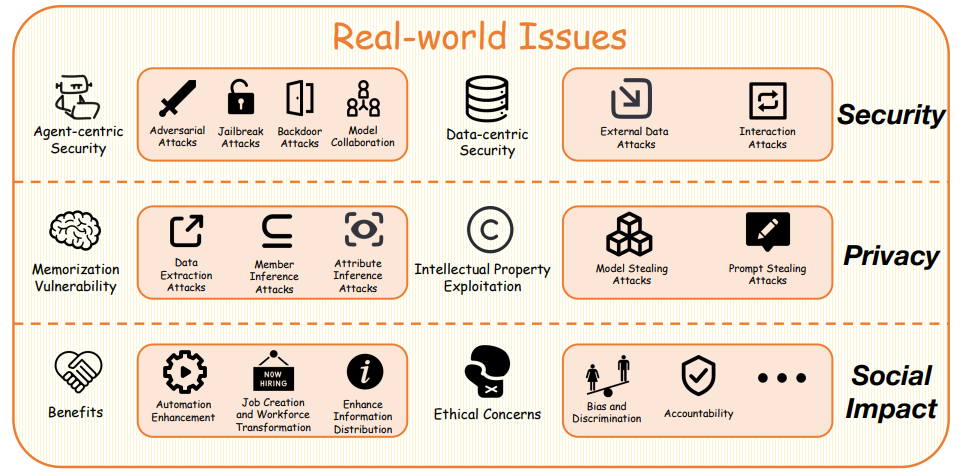

现实挑战:安全、隐私与伦理的「暗流」

安全攻击:提示词注入、越狱攻击、模型后门,黑客能让AI输出危险内容。

隐私泄露:AI可能「记住」训练数据中的个人信息,甚至被反向提取模型参数。

伦理争议:偏见放大、版权纠纷、职业替代,社会如何平衡AI效率与风险?

论文提到一个惊悚案例:通过污染知识库,攻击者能间接操控AI决策。

未来展望

更高效协作:分层架构让AI「大兵团」作战,解决复杂任务。

更可靠推理:知识图谱验证、人类审核介入,减少AI「幻觉」。

更人性化:模拟社会心理,让AI理解人类价值观。

作者预言:未来的agent可能成为人类的「超级同事」,但需建立全球监管框架。

备注:昵称-学校/公司-方向/会议(eg.ACL),进入技术/投稿群

id:DLNLPer,记得备注呦

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?