之前的博客的例子都是Regression (回归)问题。 分类和回归的区别在于输出变量的类型上。 通俗理解定量输出是回归,或者说是连续变量预测; 定性输出是分类,或者说是离散变量预测。如预测房价这是一个回归任务; 把东西分成几类, 比如猫狗猪牛,就是一个分类任务。

要做分类学习就需要准备数据MNIST,MNIST是一个入门级的计算机视觉数据集,它包含各种手写数字图片

tensorflow提供了一份python源代码用于自动下载和安装这个数据集。你可以下载 input_data

然后导入文件

import input_data

mnist = input_data.read_data_sets('MNIST_data', one_hot=True)

MNIST是一个入门级的计算机视觉数据集,它包含各种手写数字图片

它也包含每一张图片对应的标签,告诉我们这个是数字几。比如,上面这四张图片的标签分别是5,0,4,1

数据中包含55000张训练图片,每张图片的分辨率是28×28,所以我们的训练网络输入应该是28×28=784个像素数据

每一个MNIST数据单元有两部分组成:一张包含手写数字的图片和一个对应的标签。我们把这些图片设为“xs”,把这些标签设为“ys”

训练数据集和测试数据集都包含xs和ys,比如训练数据集的图片是 mnist.train.images ,训练数据集的标签是 mnist.train.labels

xs = tf.placeholder(tf.float32,[None,784])#28x28

每张图片都表示一个数字,所以我们的输出是数字0到9,共10类。

ys = tf.placeholder(tf.float32,[None,10])

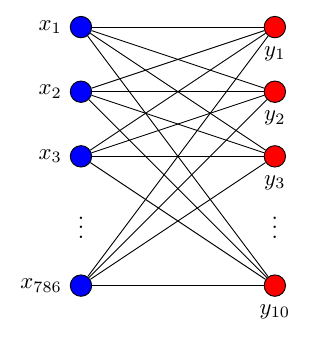

调用上篇博客中的add_layer函数搭建一个最简单的训练网络结构,只有输入层和输出层。

prediction = add_layer(xs, 784, 10, activation_function=tf.nn.softmax)#输入数据是784个特征,输出数据是10个特征,激励采用softmax函数

更多的关于Softmax函数的信息,可以参考Michael Nieslen的书里面的这个部分,其中有关于softmax的可交互式的可视化解释

网络结构图大概就是这样子的

loss函数选用交叉熵函数。交叉熵用来衡量预测值和真实值的相似程度,如果完全相同,它们的交叉熵等于零。

cross_entropy = tf.reduce_mean(-tf.reduce_sum(ys * tf.log(prediction),reduction_indices=[1])) # loss

训练采用梯度下降法

train_step = tf.train.GradientDescentOptimizer(0.1).minimize(cross_entropy)

开始训练

with tf.Session() as sess:

sess.run(init)

for i in range(1000):

#提取出一部分的数据

batch_x_input ,batch_y_input= mnist.train.next_batch(100)

sess.run(train_step, feed_dict={x_input:batch_x_input,y_input:batch_y_input})

if i% 400:

print compute_accuracy(mnist.test.images, mnist.test.labels)

定义compute_accuracy函数

def compute_accuracy(xs,ys):

global layer_hint

y_pre = sess.run(layer_hint,feed_dict={x_input:v_x})#概率

cross_prediction =tf.equal(tf.argmax(y_pre,1),tf.argmax(ys,1))#预测概率最大值和真实数据的差别

accuracy = tf.reduce_mean(tf.cast(cross_prediction,tf.float32))#计算这组数据有多少对的多少错的

reslut = sess.run(accuracy,feed_dict = {x_input:xs,y_input:ys})#输出 百分比

return reslut

运行输出

0.0685

...

0.1707

...

0.7484

...

0.7977

0.7975

...

0.8008

0.8012

0.8024

...

0.802

1306

1306

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?