目录

1 理论

逻辑回归假设数据服从伯努利分布(二分类),通过极大化似然函数的方法,运用梯度下降来求解参数,来达到将数据二分类的目的。

逻辑斯蒂回归(Logistic Regression)是一种用于解决分类问题的线性模型。尽管名字中包含“回归”一词,但逻辑斯蒂回归实际上用于处理分类问题,特别是二分类问题。

逻辑斯蒂回归通过将线性回归模型的输出通过一个逻辑斯蒂函数(Logistic Function)进行转换,将连续的预测值映射到 0 到 1 之间的概率值。

2 求解

2.1 二分类形式

二项逻辑斯蒂回归模型是如下条件概率分布:

应用极大似然估计法估计模型参数:

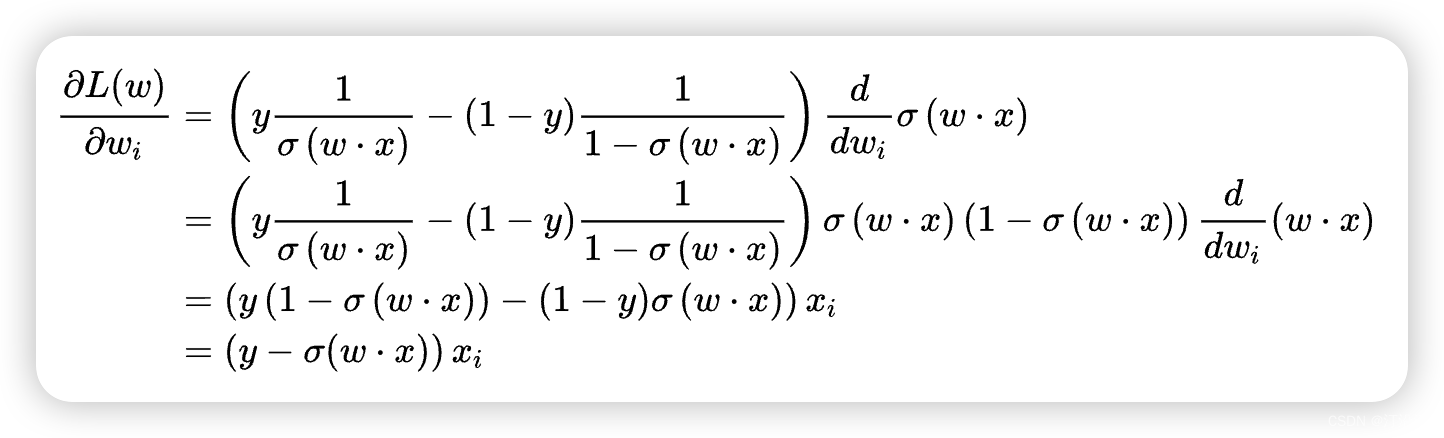

2.2 梯度下降

如何训练呢?梯度下降法。

那么,l(w). 把代入进去:

3 面试

逻辑回归的优缺点总结。

优点:

- 形式简单,模型的可解释性非常好。从特征的权重可以看到不同的特征对最后结果的影响,某个特征的权重值比较高,那么这个特征最后对结果的影响会比较大。

- 模型效果不错。在工程上是可以接受的(作为baseline),如果特征工程做的好,效果不会太差,并且特征工程可以大家并行开发,大大加快开发的速度。

- 训练速度较快。分类的时候,计算量仅仅只和特征的数目相关。并且逻辑回归的分布式优化sgd发展比较成熟,训练的速度可以通过堆机器进一步提高,这样我们可以在短时间内迭代好几个版本的模型。

- 资源占用小,尤其是内存。因为只需要存储各个维度的特征值,。

- 方便输出结果调整。逻辑回归可以很方便的得到最后的分类结果,因为输出的是每个样本的概率分数,我们可以很容易的对这些概率分数进行cutoff,也就是划分阈值(大于某个阈值的是一类,小于某个阈值的是一类)。

缺点:

- 准确率并不是很高。因为形式非常的简单(非常类似线性模型),很难去拟合数据的真实分布。

- 很难处理数据不平衡的问题。举个例子:如果我们对于一个正负样本非常不平衡的问题比如正负样本比 10000:1.我们把所有样本都预测为正也能使损失函数的值比较小。但是作为一个分类器,它对正负样本的区分能力不会很好。

- 处理非线性数据较麻烦。逻辑回归在不引入其他方法的情况下,只能处理线性可分的数据,或者进一步说,处理二分类的问题 。

- 逻辑回归本身无法筛选特征。有时候,我们会用gbdt来筛选特征,然后再上逻辑回归。

本文介绍了逻辑回归的基本理论,包括其假设、通过极大似然估计求解参数的方法以及二分类形式。文章详细讲述了使用梯度下降进行训练的过程,并总结了逻辑回归在面试中的优缺点,如模型解释性、效率、资源需求及处理非线性和数据不平衡的局限性。

本文介绍了逻辑回归的基本理论,包括其假设、通过极大似然估计求解参数的方法以及二分类形式。文章详细讲述了使用梯度下降进行训练的过程,并总结了逻辑回归在面试中的优缺点,如模型解释性、效率、资源需求及处理非线性和数据不平衡的局限性。

588

588

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?