1、一阶导数和梯度(gradient vector)

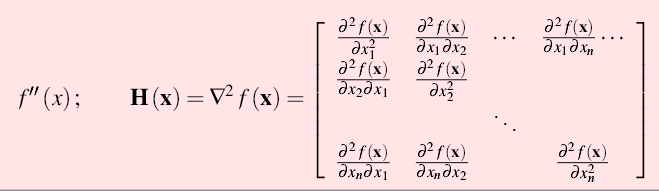

2、二阶导数和Hessian矩阵

Hessian矩阵是一个对称矩阵

3、泰勒级数与极值

对比着标量来看可能会容易理解一些。

(1)泰勒级数展开(标量):

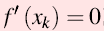

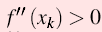

称满足

如果,有可能是一个鞍点(saddle point)

(2)泰勒级数展开(矢量)(和上面的标量对比)

称满足

,xk为严格局部极小点(反之,严格局部极大点)

如果

我们应知道,梯度下降法选择的是负梯度。梯度是函数最快上升的方向,则负梯度是函数最快下降的方向。

在训练的时候,需要选择对的方向(也就是delta);初此之外,还有一个步长(alpha),在选定的方向上,一次走多远。

2242

2242

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?