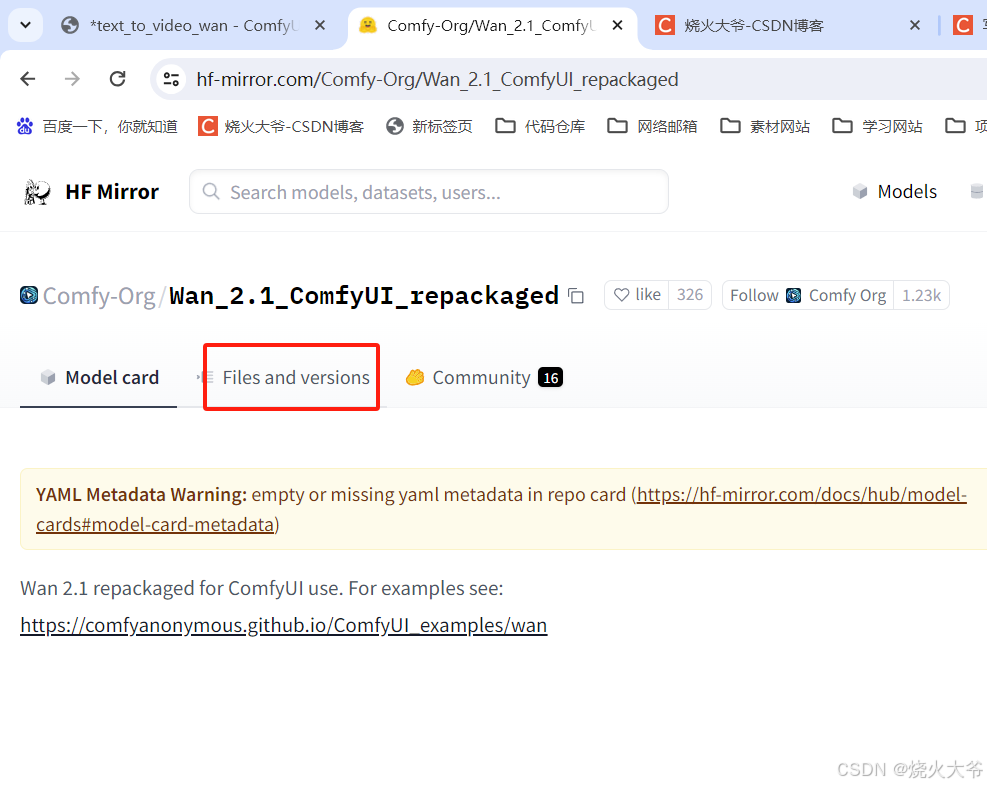

直接下载 Hugging Face

开启梯子,一看好几个g...

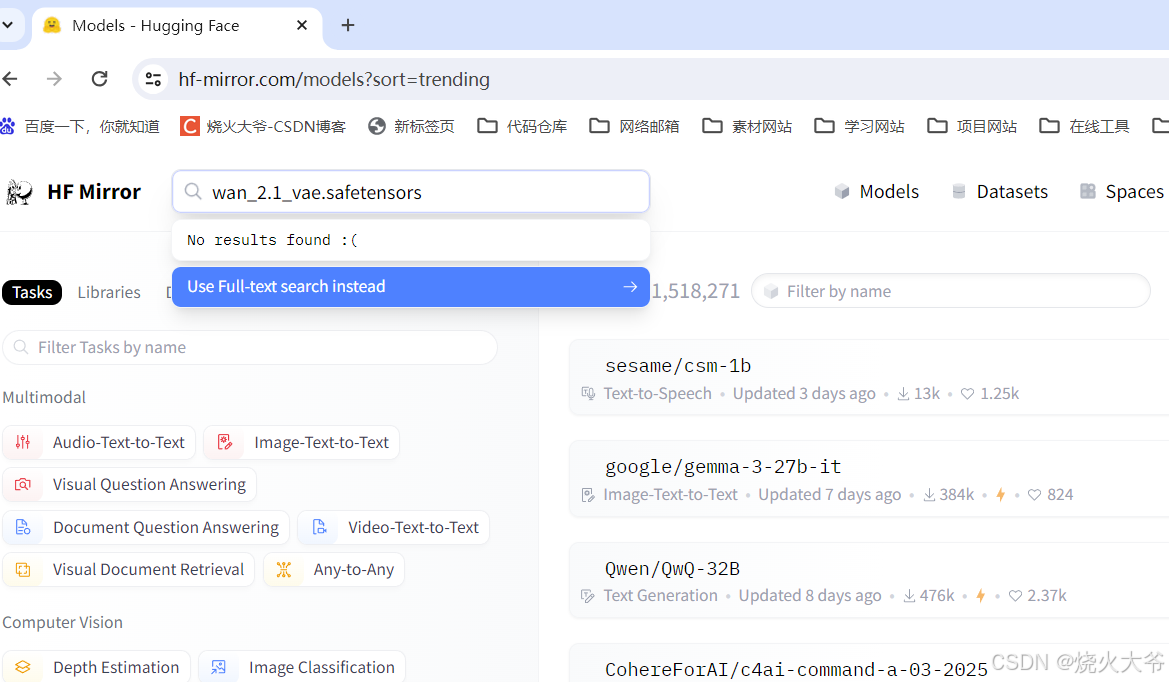

我们寻找国内镜像。

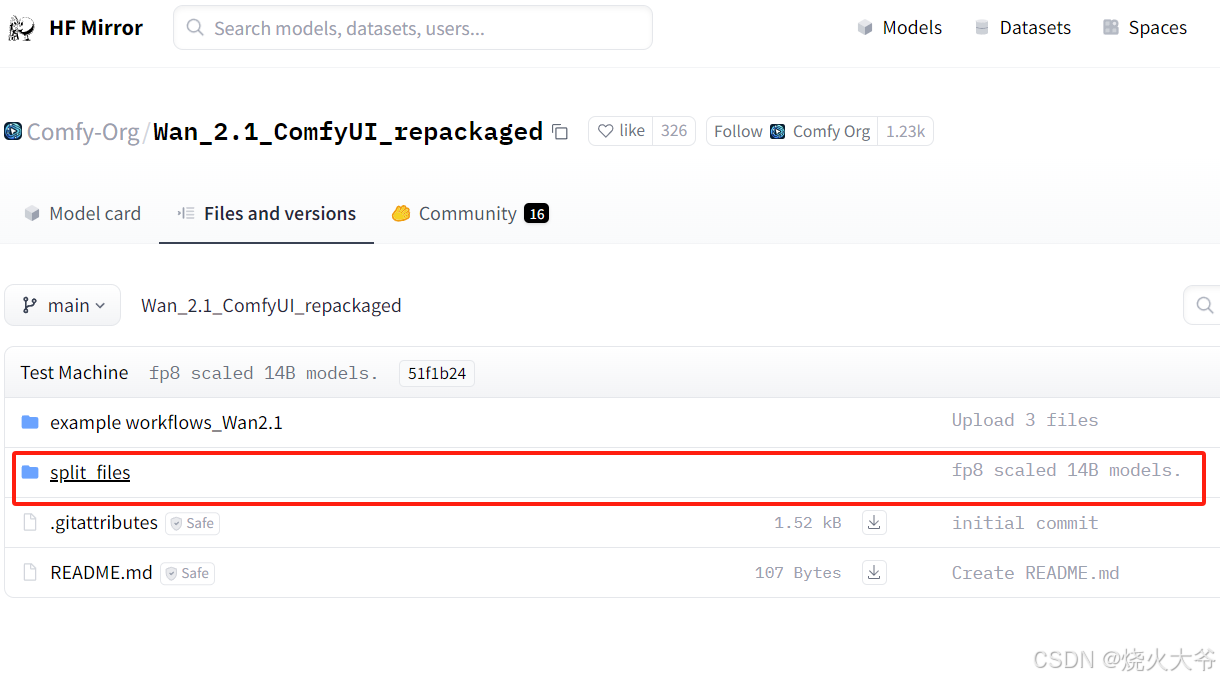

继续上面搜索。

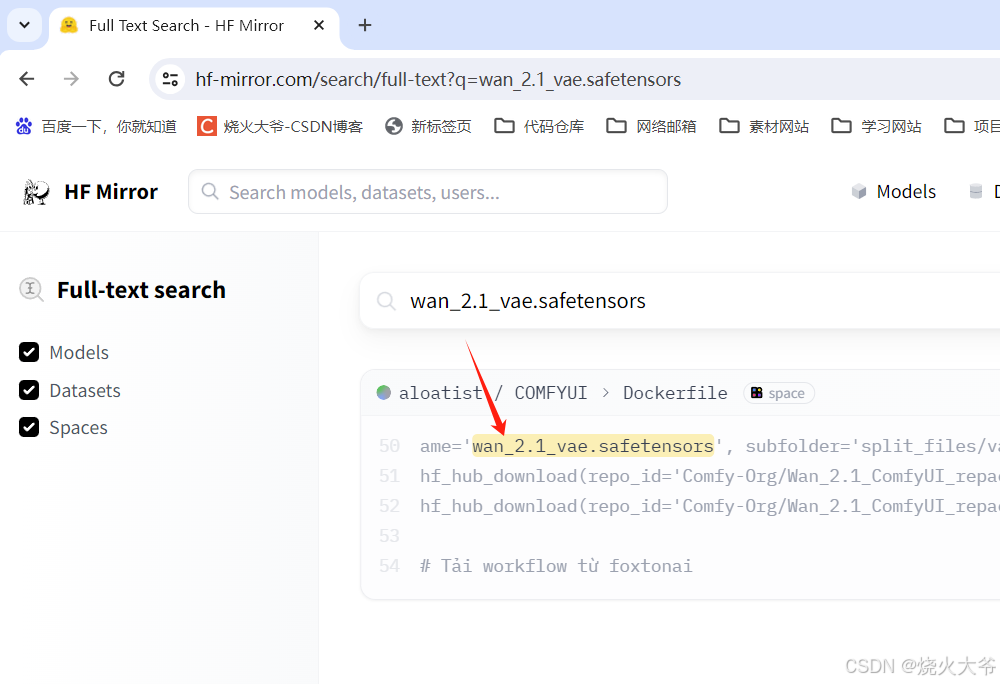

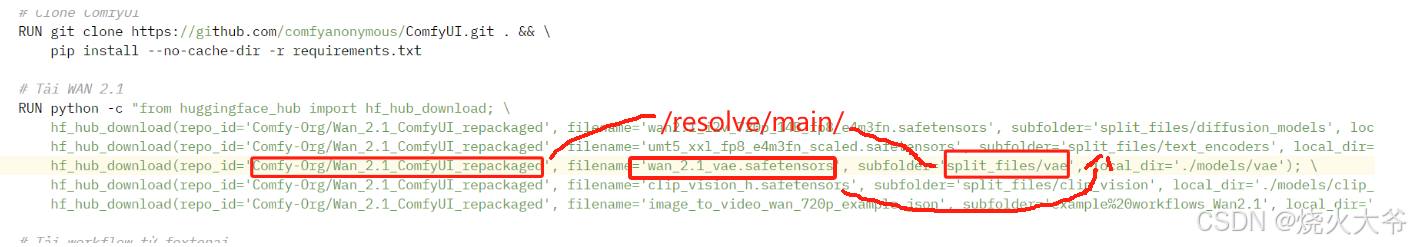

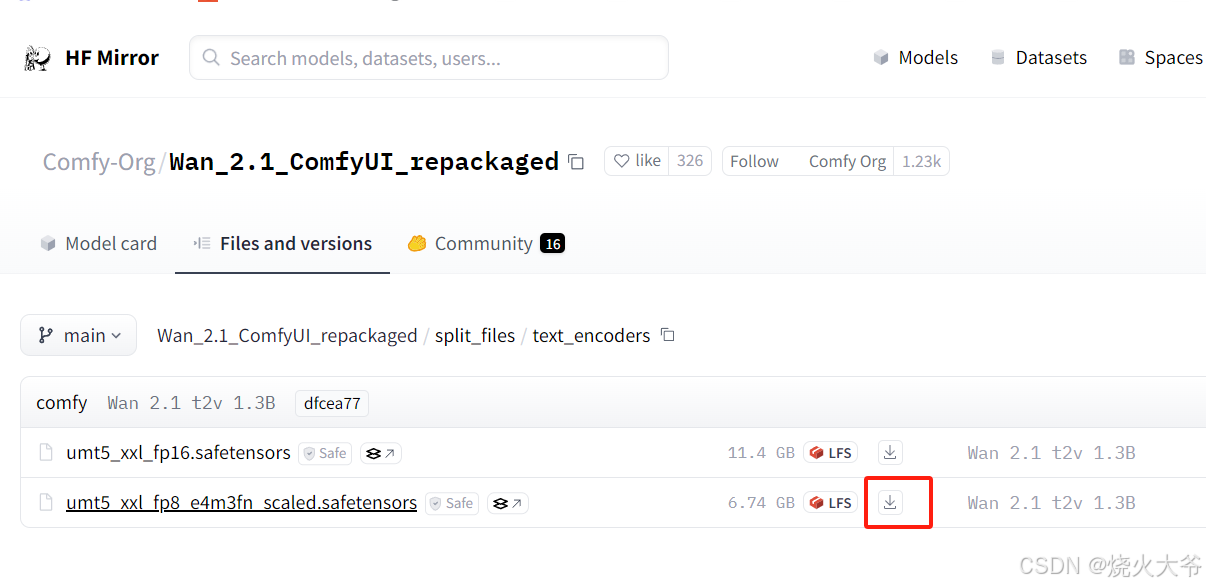

继续点击跟踪路径。

拼出路径。

https://hf-mirror.com/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/main/split_files/vae/wan_2.1_vae.safetensors如果网络足够好,定位资源直接下也可是可以的。

https://hf-mirror.com/Comfy-Org/Wan_2.1_ComfyUI_repackaged

我这里利用cur 来拉取文件。

先安装虚拟环境。

conda create --prefix D:\myenv python=3.10

再激活。

conda activate D:/myenv

检查并创建本地目录

mkdir D:\ComfyUI\models\text_encoders

将镜像资源拉取刚刚创建的文件下。

curl -o D:\ComfyUI\models\text_encoders\umt5_xxl_fp8_e4m3fn_scaled.safetensors https://hf-mirror.com/Comfy-Org/Wan_2.1_ComfyUI_repackaged/resolve/main/split_files/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensors

测试要比直接网络下载要快。

3644

3644

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?