目录

1 Dropout 定义

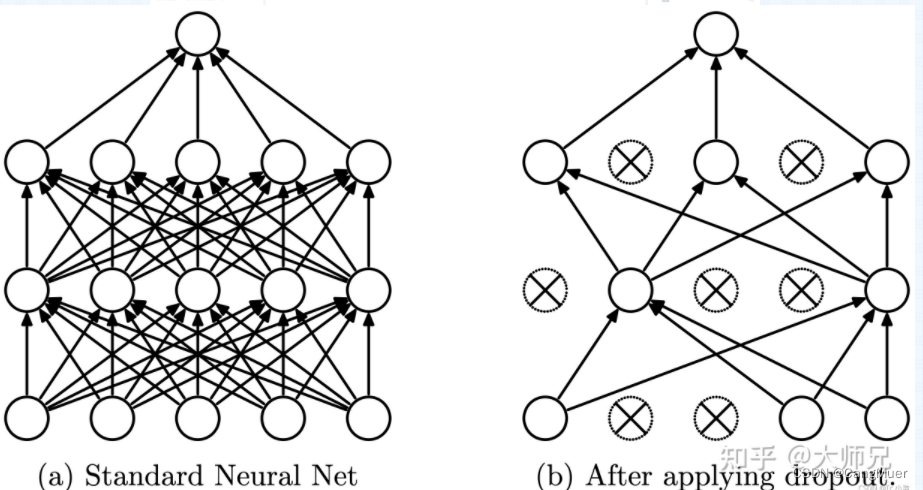

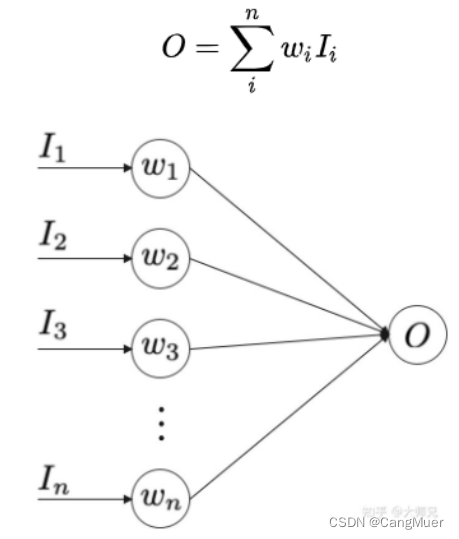

Dropout,随机失活,是一种网络正则化办法,用于缓解模型过拟合的策略,减少神经元关联的边,能提升泛化能力。

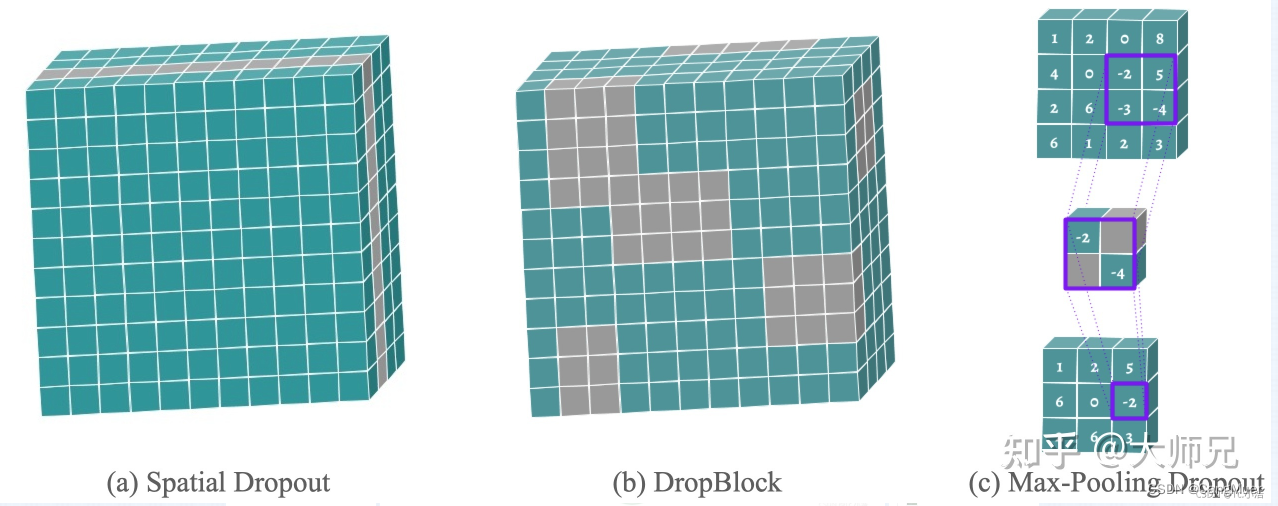

CNN的Feature Map是一个由W,H,C组成的三维矩阵,而传统的dropout是二维思想,丢掉特征图上的像素点

但是由于在特征图上,相邻的特征点具有相似性,所以丢掉特征点的方法不大适用。

① 所以提出了以通道为单位来随机丢弃,叫做 Spatial Dropout。

② 也可以丢掉多维特征图的一部分区域,叫做 DropBlock。

③ 也可以在进行最大池化时,对某些特征点进行mask,叫做 Max-Pooling Dropout。

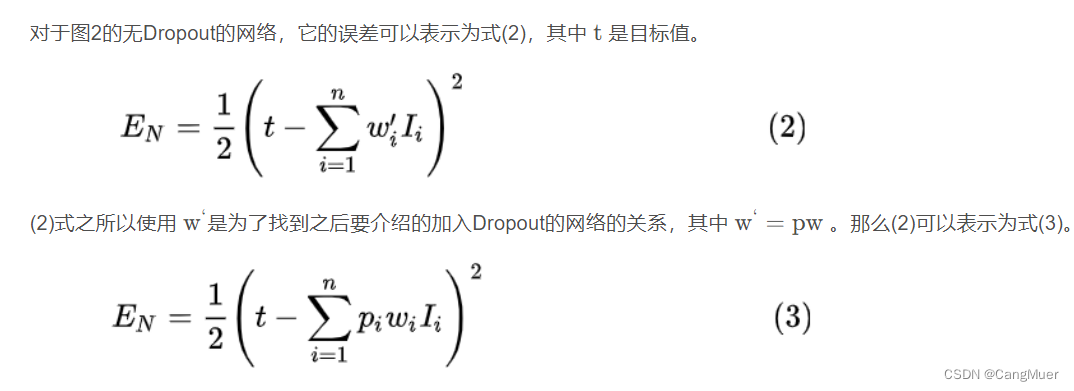

2 Dropout 数学原理

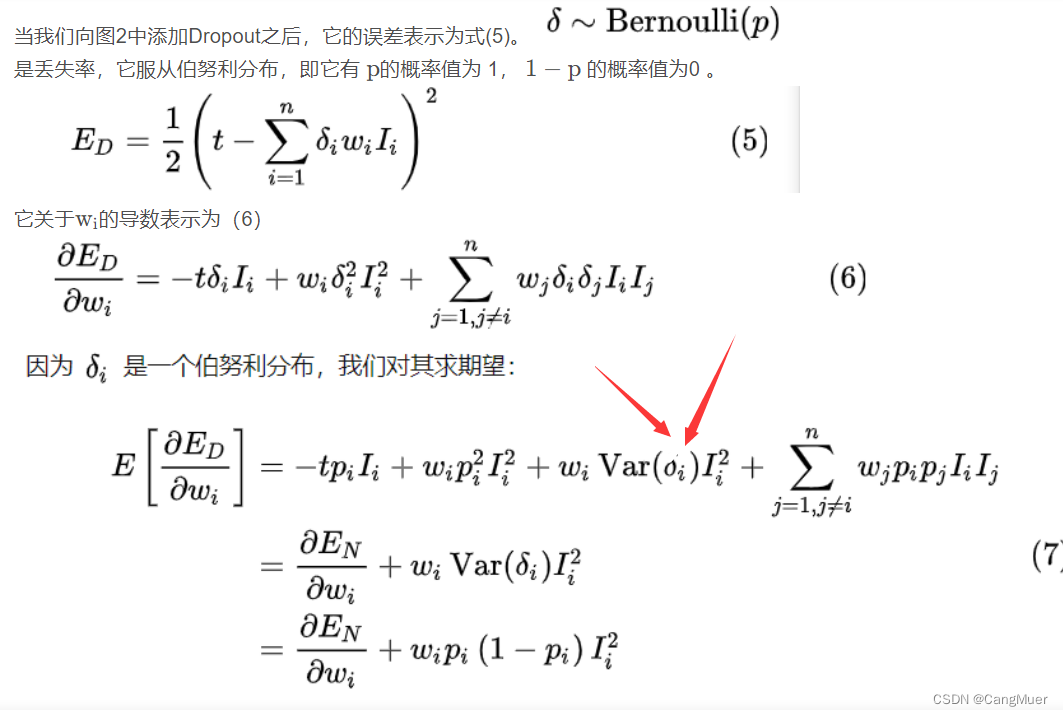

其中,我在公式推导时,在上图红色箭头Var()方差卡壳,其概率论原理为:

3 Dropout率的设定

通过最后的计算,不难看出,Dropout的梯度的期望,等价于带有正则的网络。

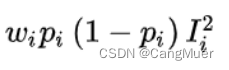

其正则项为:

由于p × (1 - p ),在 p=0.5 时最大,所以在丢失率为0.5时,所得到的正则化效果最大。

但是在浅层网络时,丢失率不宜设置过大,以免丢失过多导致输入对输出的影响较大。同时,丢失率设置不宜超过 0.5,因为在0.5是个极值点,设置过大在正则效果并没有得到提升的同时反而又丢失了很多信息。

4 参考链接

深度学习-Dropout详解_Tc.小浩的博客-CSDN博客_深度学习dropout文章目录前言1、什么是Dropout2、Dropout的数学原理3、Dropout是一个正则网络4、CNN的Dropout5、Dropout的变种5.1 高斯Dropout6、总结前言Dropout是深度学习中被广泛的应用到解决模型过拟合问题的策略,相信你对Dropout的计算方式和工作原理已了如指掌。这篇文章将更深入的探讨Dropout背后的数学原理,通过理解Dropout的数学原理,我们可以推导出几个设置丢失率的小技巧,通过这篇文章你也将对Dropout的底层原理有更深刻的了解。同时我们也将对Drohttps://blog.csdn.net/weixin_48167570/article/details/121559922 Numpy实现Dropout_AI浩的博客-CSDN博客_dropout numpyclass Dropout(Layer): """A layer that randomly sets a fraction p of the output units of the previous layer to zero. Parameters: ----------- p: float The probability that unit x is set to zero. """ def __init__(self, p=0

https://blog.csdn.net/hhhhhhhhhhwwwwwwwwww/article/details/120322341 【深度学习】正则化:L1正则化、L2正则化、Batch Normal与Dropout_阳一子的博客-CSDN博客目录正则化0 正则化介绍0.0 什么是正则化?0.1 正则化解决什么问题?0.2 正则化常用手段L1、L2正则化1.0 范数定义正则化0 正则化介绍0.0 什么是正则化?《Deep Learning》书中定义正则化为“对学习算法的修改——旨在减少泛化误差而不是训练误差” 模型可以看成是一个高维函数,对于不同的模型参数,能得到千千万万个不同的模型,我们将这所有的可能得到的模型称之为假设空间。我们只需要通过训练将生成真实数据的一组模型参数找出来即可。从已有的假设空

https://blog.csdn.net/qq_279033270/article/details/109695441 动手实现深度神经网络6 神经网络的优化之权值衰减与Dropout_如魔的博客-CSDN博客_对神经网络执行权重衰减或删除是什么操作机器学习的问题中,过拟合是一个很常见的问题。过拟合`指的是`只能拟合训练数据,但不能很好地拟合不包含在训练数据中的其他数据的状态。这一篇文章,我们介绍抑制过拟合的两种方法;权值衰减和Dropout。

https://blog.csdn.net/weixin_49374896/article/details/123305422 网络优化方法--Dropout_别团等shy哥发育的博客-CSDN博客_dropout设置网络优化方法--Dropout1、Dropout介绍2、Dropout程序1、Dropout介绍 Dropout 也是一种用于抵抗过拟合的技术,它试图改变网络本身来对网络进行优化。我 们先来了解一下它的工作机制,当我们训练一个普通的神经网络时,网络的结构可能如图所示。 Dropout 通常是在神经网络隐藏层的部分使用,使用的时候会临时关闭掉一部分的神经 元,我们可以通过一个参数来控制神经元被关闭的概率,网络结构如图所示。更详细的流程如下:在模型训练阶段我们可以先给 Dropout 参数设

https://blog.csdn.net/qq_43753724/article/details/124656662

31万+

31万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?