0. 前言

该文章是本人观看视频后的一些心得,系统笔记请前往:

http://blog.csdn.net/red_stone1/article/details/71122928

1. Restriction of Break Point

- 影响成长函数

mH(N)

的两个因素:

- 样本数量 N

- break point

k

2. Bounding Function: Basic Cases

- 上界函数bounding functionB(N,k):Bound Function指的是当break point为k的时候,成长函数 mH(N) 可能的最大值。

- 上界函数的引入不考虑是1D postive intrervals问题还是2D perceptrons问题,而只关心成长函数的上界是多少,从而简化了问题的复杂度。

- 我们只需要证明上界函数是多项式时间可求的,那么就能证明成长函数也是多项式时间可求的。

- B(N,k)矩阵:

- 当k=1时,B(N,1)恒为1。

- 当N < k时,根据break point的定义,很容易得到B(N,k)= 2N 。

- 当N = k时,此时N是第一次出现不能被shatter的值,所以最多只能有

2N−1

个dichotomies,则B(N,k)=

2N−1

。

shatter:是指在该样本数时,无法用假设函数模拟出所有情况(即 mH(N)≠2N )

3. Bounding Function: Inductive Cases

- 对于2D perceptrons,break point为k=4, mH(N) 的上界是 Nk−1 。广一下,也就是说,如果能找到一个模型的break point,且是有限大的,那么就能推断出其成长函数 mH(N) 有界。

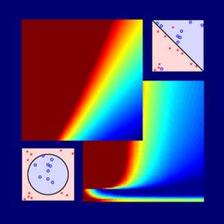

- B(N,K)中N大于k的部分:

4. A Pictorial Proof

- Vapnik-Chervonenkis(VC) bound:(证明可看视频。)

- 对于2D perceptrons,它的break point是4,那么成长函数 mH(N)=O(N3) 。因此证明成长函数有界—–>样本足够大则 Eout(x)≈Ein(X) 。

总结

证明了只要存在break point,那么成长函数就是多项式时间内可求的,即机器学习就是可求的。本章节进行了一些推导。

423

423

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?