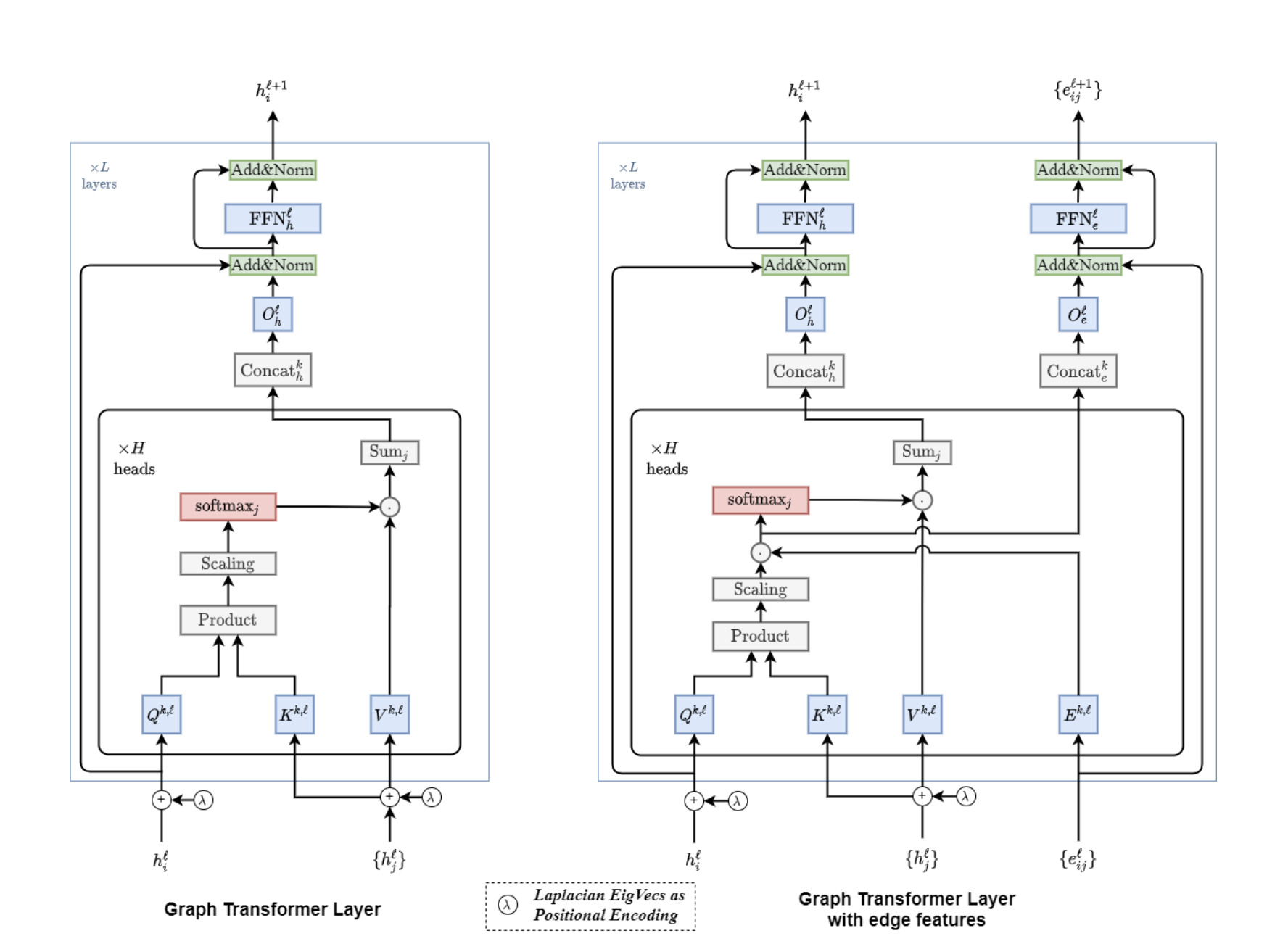

与原始Transformer相比,所提出的架构的亮点如下:

*注意力机制是图中每个节点的邻域连通性的函数。

*位置编码由拉普拉斯特征向量表示,自然地推广了NLP中经常使用的正弦位置编码。

*层规范化被批量规范化层取代。

*该架构被扩展为具有边表示,这对于在边缘或成对相互作用(如分子中的键类型,或kgs中的关系类型等)上具有丰富信息的任务至关重要。

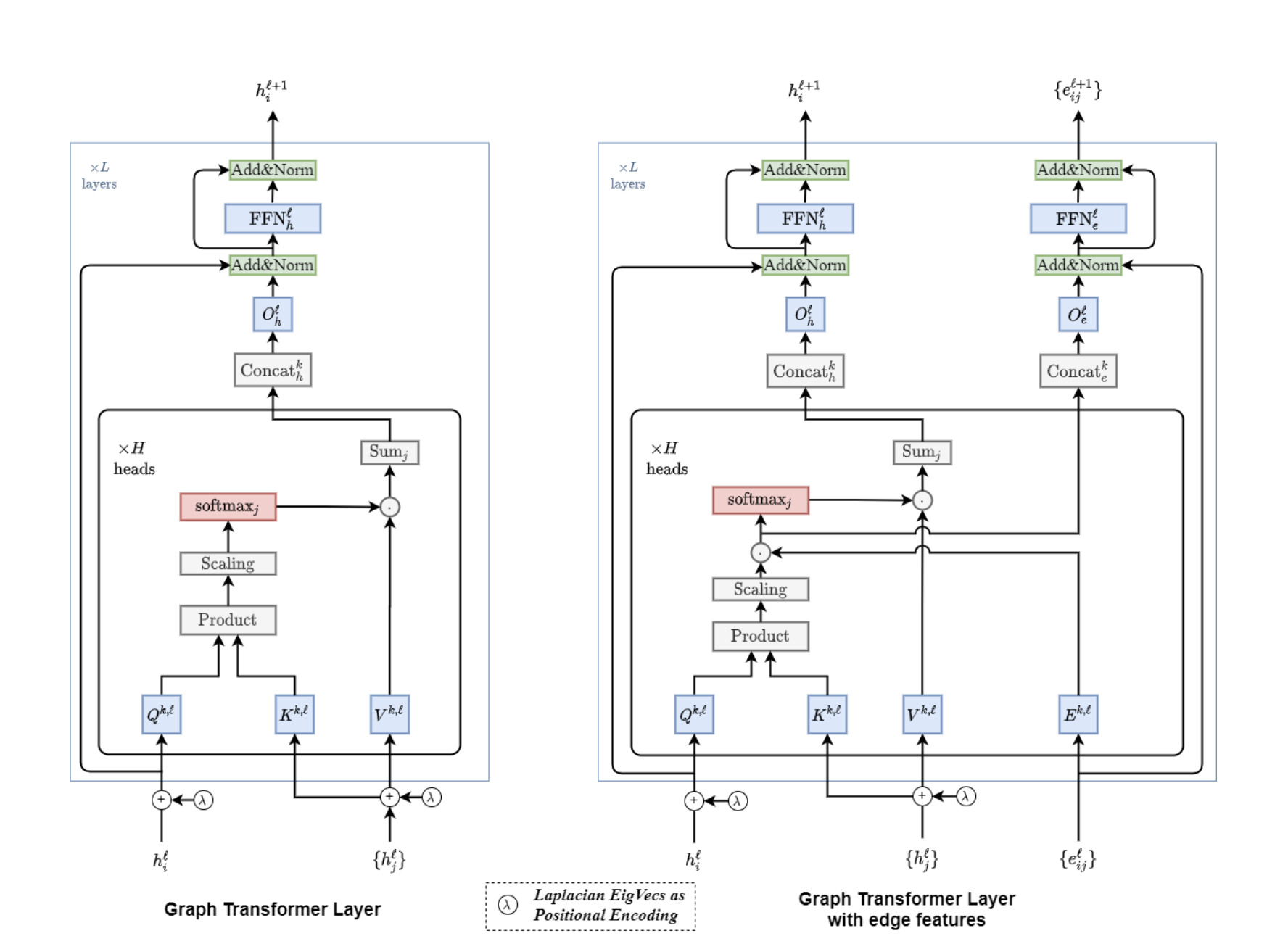

与原始Transformer相比,所提出的架构的亮点如下:

*注意力机制是图中每个节点的邻域连通性的函数。

*位置编码由拉普拉斯特征向量表示,自然地推广了NLP中经常使用的正弦位置编码。

*层规范化被批量规范化层取代。

*该架构被扩展为具有边表示,这对于在边缘或成对相互作用(如分子中的键类型,或kgs中的关系类型等)上具有丰富信息的任务至关重要。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?