卷积和池化

前面用全连接神经网络对图像进行了识别,总觉得奇奇怪怪的,因为全连接的方法就是死记硬背,根本没有考虑图像的空间结构,它对待相距很远和相距很近的点的态度是一样的,比如说猫的眼睛跟鼻子的像素他们之间应该联系的更紧密一些,而眼睛跟鼻子的像素关联度要更远一些,而用卷积神经网络的方法很好的考虑了图像的内部关系和空间结构。

如果图像的像素太多,使用全连接也会造成参数过多导致内存爆炸,但是使用卷积滤波可以大大减少参数。卷积神经网络跟数字图像处理有着很大的关系,在数字图像处理中,卷积操作是一种线性运算,人为设定的卷积核,比如著名的拉普拉斯卷积核,可以进行边缘提取,各种平滑锐化操作。

在一层网络中同时使用多个不同的卷积核,同时进行卷积运算,每一个卷积核完成卷积之后都可以得到一张卷积图,卷积核其实就是一些可以提取不同特征的方框,与数字图像处理不同的是,网络会自己生成卷积核,并且很多是人类无法理解的特征,每一个卷积核完成之后会得到一张特征图。

一般卷积完了之后进行池化操作,池化层是一种特殊的降采样卷积层,降低了输入规模和过拟合的风险,有最大池化和平均池化等。

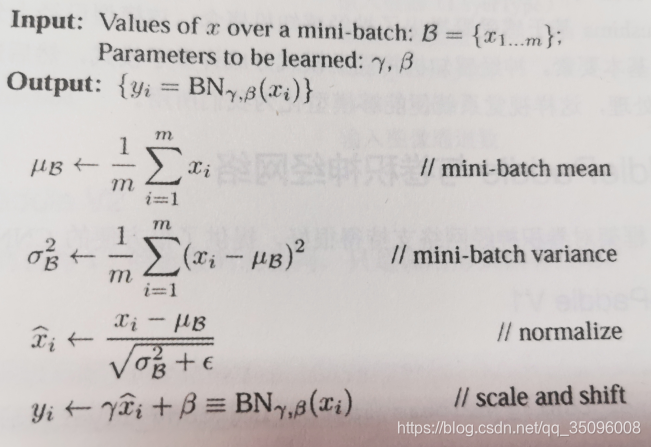

batch normalization

求输入数据的均值和方差,利用大数定律对其进行归一化,然后将其线性变化,大数定律(law of large numbers),是一种描述当试验次数很大时所呈现的概率性质的定律。但是注意到,大数定律并不是经验规律,而是在一些附加条件上经严格证明了的定理,它是一种自然规律因而通常不叫定理而是大数“定律”。而我们说的大数定理通常是经数学家证明并以数学家名字命名的大数定理,如伯努利大数定理,BN层可以提高模型的泛化能力。这个理论比较复杂,需要很多数学知识。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?