1.relu/tanh激活函数

Q:为什么要有激活函数?

A:如果没有激活函数,那么输出只是输入的线性组合,意义不大

比如:有输入x1,x2…xn,如果没有激活函数,最终的输出可以写成表达式

z

=

a

1

×

x

1

+

a

2

×

x

2

+

.

.

a

n

×

x

n

z=a1\times x1+a2\times x2+..an\times xn

z=a1×x1+a2×x2+..an×xn

这还不如直接只用一层直接输出呢,

不过,线性组合有一个很好的作用是,可以减少参数量,如下,这里可以结合QR分解来理解

激活函数的作用:如下面万能近似定理所述

这句话告诉我们,只要至少有一个带激活函数的隐藏单元,就可以用这个网络来近似代表任何Borel可测函数(不知道具体意义)。

这句话告诉我们,只要至少有一个带激活函数的隐藏单元,就可以用这个网络来近似代表任何Borel可测函数(不知道具体意义)。

Q:那只要一层是不是就可以了?

A:层数越多,其泛化能力越好,也就是泛化误差(测试误差)越小

这是作者的实验

relu、tanh(Hyperbolic Tangent)

这两个函数共同特点:

1.非线性

2.0附近倒数为近似1,利于学习(这也是为甚不用softplus最为中间层激活函数的原因)

3.relu(0)=0 , tanh(0) = 0(这是为什么不用sigmoid做中间层激活函数的原因)

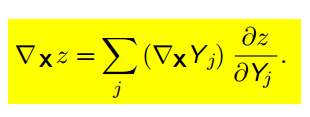

2.反向传播计算图

记住下面的图。。

总结:欠了两天的债,今天准备一口气看30页,谁知道。。。知识储备不够+稀烂翻译,看着这三十页看着真的是难受,所以就只理解了这一点内容,要学会及时调整策略,适当放弃一些内容,往后面看。

771

771

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?