目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

选题指导:

大家好,这里是海浪学长毕设专题,本次分享的课题是

🎯基于机器学习的施工人员安全帽佩戴识别系统

课题背景和意义

施工人员的安全帽佩戴情况是保障工地安全的重要指标。然而,传统的人工检查方式存在效率低下、主观性强等问题。基于机器学习的施工人员安全帽佩戴识别系统可以通过自动化和智能化的方式,准确判断施工人员是否佩戴了安全帽。该系统可以利用机器学习算法对施工场景中的图像进行分析和识别,从而提高工地安全管理的效率和准确性。这样的系统不仅可以提升工地的安全性,减少事故发生的可能性,还可以为相关管理部门提供及时的监控和预警,对于施工行业的安全管理具有重要的意义。

实现技术思路

一、算法理论基础

1.1 卷积神经网络

拾取施工现场工作图像是实现安全帽实时检测的第一步。通过分析图像或监控视频中的目标,可以准确判断施工人员的安全情况。为了提取图像中的目标种类和位置信息,卷积神经网络的兴起在图像处理领域起到了重要作用。卷积神经网络通过卷积、池化、激活和归一化等处理方式对图像进行压缩和解压,从中提取目标的特征,如轮廓、颜色和外形等。这些特征可以记录下来,并利用相应的算法进行目标检测和标注。卷积神经网络在图像处理中具有多种功能,其重要性在当前以及未来的很长一段时间都将得到广泛应用。

通过卷积神经网络的应用,能够实现对施工现场图像的目标检测和标注,包括安全帽的检测。这为监督者提供了准确判断施工人员安全情况的依据。进一步扩展和深入研究卷积神经网络的技术,能够推动图像处理领域的发展,并在实际应用中发挥重要作用。

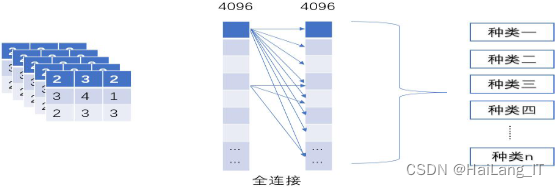

全连接层在图像处理中的主要作用是实现目标物体的分类。在全连接层中,每一层由多个神经元组成,形成一个平铺结构。典型情况下,全连接层的规模为1x4096,可以将一个3x3x5的输入转换成1x4096的形式。转换过程中,全连接层通过在网络中间添加一个卷积操作,使用一个3x3x5的卷积核对经过激活函数输出的特征图进行卷积。卷积的结果即为全连接层的神经元输出内容,这个输出结果是一个数值。全连接层通常包含4096个神经元,可以理解为使用一个3x3x5x4096的卷积层对网络的输入进行卷积,即激活函数的输出数据。

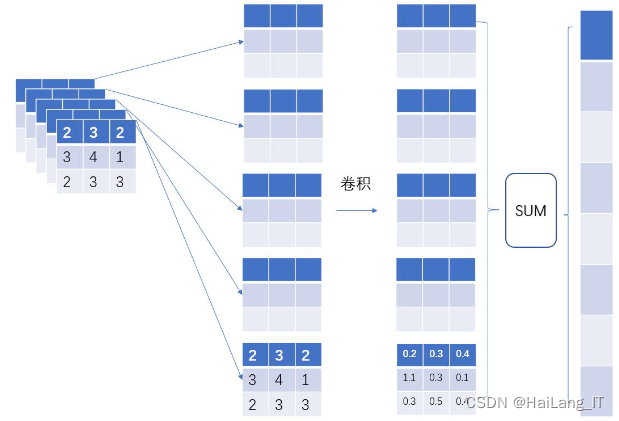

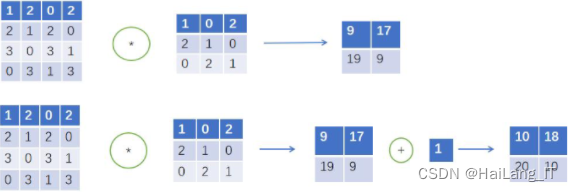

全连接层在处理图像数据时存在计算量大且忽视形状的问题,因为它将三维的图像数据转换为一维进行处理。相比之下,卷积层能够维持数据的形状,并充分利用图像的特征信息。卷积层通过卷积运算对输入特征图进行处理,输出对应的特征图,实现了对图像的特征提取和处理。卷积神经网络在处理图像数据时更加适应,并且能够有效利用图像的形状和特征信息。

1.2 目标检测算法

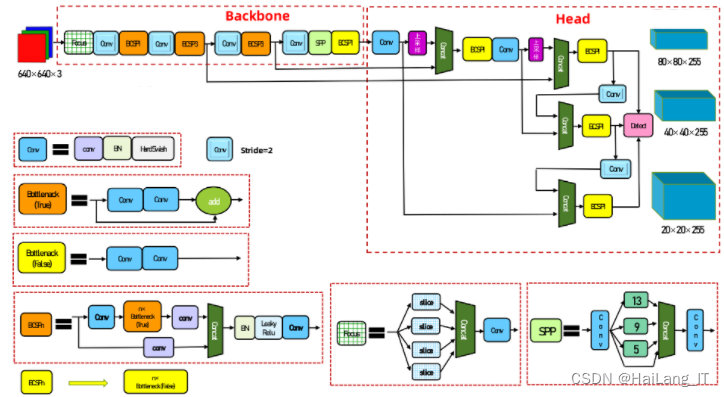

YOLOv5是一种单阶段目标检测算法,具有较高的速度优势。YOLOv5包括四种不同大小的网络结构:YOLOv5s、YOLOv5m、YOLOv5l和YOLOv5x。这些网络结构在训练精度上逐渐提升,但对应的训练时间也随之增加。为了平衡时间和研究需求,本文选择了相对简单的YOLOv5s版本进行优化改良。

YOLOv5s网络结构包括输入部分、主干网络、颈部网络和检测层。输入部分对输入的图像进行数据增强、计算锚框和尺度缩放等预处理操作。主干网络包括focus、conv、c3模块和SPP空间金字塔池化模块,通过这些模块提取图像的特征信息。其中,focus层将平面信息转换为通道信息,并在切分图片的同时减少信息损失。颈部网络由卷积、上采样、concat和C3模块组成,提取图像的不同尺度特征图。检测层对颈部网络输出的三个尺度的特征进行目标检测,生成对应的预测框,并应用非极大值抑制(NMS)处理来选择最佳的预测框。

二、 数据集

2.1 数据集

由于网络上缺乏现有的适用于施工人员安全帽佩戴识别的数据集,我决定自己进行网络爬取,收集了大量包含施工人员图像的数据样本来构建一个全新的数据集。通过编写网络爬虫程序,我能够从不同来源的图片中获取样本数据,并进行标注和分类。这个自制的数据集包含了各种施工场景中的施工人员图像样本,覆盖了不同工种、不同环境和不同佩戴情况。通过自制数据集,我能够获得更真实、多样的施工人员图像数据,这将为我的施工人员安全帽佩戴识别系统的改进提供更准确、可靠的实际数据支持。

2.2 数据扩充

通过数据增强技术来扩充数据集,例如随机旋转、平移、缩放和加噪声等操作,以增加数据的多样性和泛化能力。通过扩充数据集,我将进一步提高施工人员安全帽佩戴识别系统的准确性和鲁棒性,并使其能够适应更广泛的施工场景和条件,为实际应用提供更可靠的解决方案。

三、实验及结果分析

3.1 实验环境搭建

使用一台配备有Intel Core i7-10700K处理器和GeForce RTX 3070ti 8GB显存的电脑,在Ubuntu 16.04 LTS 64位操作系统下进行YOLOv5模型的训练。使用PyTorch框架,CUDA版本为11.1.0,cuDNN版本为11.1,编程语言为Python 3.8。

模型训练过程中,初始学习率(Lr0)为0.01,周期学习率(Lr0)为0.2。每次传入模型的训练样本数量为16,数据加载器数量为8。总共进行128个训练轮次(epochs),并且训练和测试图像的尺寸设置为640x640。

3.2 模型训练

YOLOv5使用精度(P)、均值平均精度(mAP)和召回率(R)作为评估网络模型训练和测试性能的指标。精度(P),也称为查准率,用于衡量模型的准确性。它表示在所有被模型预测为正类的样本中,实际为正类的比例。均值平均精度(mAP)是将各类别的精度AP相加后除以类别数得到的平均值。AP指的是召回率曲线与坐标轴所围成的面积,可以通过对召回率进行积分来计算得到。mAP用于衡量模型在多个类别上的综合性能。召回率(R),也称为查全率,用来衡量模型检测目标的全面性。它表示在所有实际为正类的样本中,被模型正确预测为正类的比例。

相关代码示例:

import torch

import torch.nn as nn

import torch.nn.functional as F

class AttentionModule(nn.Module):

def __init__(self, in_channels, reduction=16):

super(AttentionModule, self).__init__()

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.fc = nn.Sequential(

nn.Linear(in_channels, in_channels // reduction),

nn.ReLU(inplace=True),

nn.Linear(in_channels // reduction, in_channels)

)

def forward(self, x):

b, c, _, _ = x.size()

y = self.avg_pool(x).view(b, c)

y = self.fc(y).view(b, c, 1, 1)

attention = torch.sigmoid(y)

return attention * x

class ModifiedYOLOv5(nn.Module):

def __init__(self):

super(ModifiedYOLOv5, self).__init__()

# Original YOLOv5 backbone layers

self.conv1 = nn.Conv2d(3, 64, kernel_size=3, stride=1, padding=1)

self.attention1 = AttentionModule(64)

self.conv2 = nn.Conv2d(64, 128, kernel_size=3, stride=1, padding=1)

self.attention2 = AttentionModule(128)海浪学长项目示例:

最后

我是海浪学长,创作不易,欢迎点赞、关注、收藏。

毕设帮助,疑难解答,欢迎打扰!

本文介绍了如何利用卷积神经网络和YOLOv5目标检测算法开发一个施工人员安全帽佩戴识别系统。通过构建自己的数据集,进行数据扩充,并详细描述了实验环境和模型训练过程,旨在提高工地安全管理的效率和准确性。

本文介绍了如何利用卷积神经网络和YOLOv5目标检测算法开发一个施工人员安全帽佩戴识别系统。通过构建自己的数据集,进行数据扩充,并详细描述了实验环境和模型训练过程,旨在提高工地安全管理的效率和准确性。

1082

1082

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?