深度学习笔记(二):回归的定义及其建模过程

回归的定义及其建模过程

Regression 就是找到一个函数 f u n c t i o n function function ,通过输入特征 x x x,输出一个数值 S c a l a r Scalar Scalar。

模型步骤

- step1:模型假设,选择模型框架(线性模型)

- step2:模型评估,如何判断众多模型的好坏(损失函数)

- step3:模型优化,如何筛选最优的模型(梯度下降)

Step 1:模型假设 - 线性模型

一元线性模型(单个特征)

以一个特征

x

c

p

x_{cp}

xcp 为例,线性模型假设

y

=

b

+

w

⋅

x

c

p

y = b + w·x_{cp}

y=b+w⋅xcp ,所以

w

w

w 和

b

b

b 可以猜测很多模型:

f

1

:

y

=

10.0

+

9.0

⋅

x

c

p

f

2

:

y

=

9.8

+

9.2

⋅

x

c

p

f

3

:

y

=

−

0.8

−

1.2

⋅

x

c

p

⋅

⋅

⋅

f_1: y = 10.0 + 9.0·x_{cp} \\ f_2: y = 9.8 + 9.2·x_{cp} \\ f_3: y = - 0.8 - 1.2·x_{cp} \\ ···

f1:y=10.0+9.0⋅xcpf2:y=9.8+9.2⋅xcpf3:y=−0.8−1.2⋅xcp⋅⋅⋅

多元线性模型(多个特征)

在实际应用中,输入特征肯定不止 x c p x_{cp} xcp 这一个。所以我们假设 线性模型 Linear model: y = b + ∑ w i x i y = b + \sum w_ix_i y=b+∑wixi

- x i x_i xi:就是各种特征(fetrure) x c p , x h p , x w , x h , ⋅ ⋅ ⋅ x_{cp},x_{hp},x_w,x_h,··· xcp,xhp,xw,xh,⋅⋅⋅

- w i w_i wi:各个特征的权重 w c p , w h p , w w , w h , ⋅ ⋅ w_{cp},w_{hp},w_w,w_h,·· wcp,whp,ww,wh,⋅⋅

- b b b:偏移量

Step 2:模型评估 - 损失函数

如何判断众多模型的好坏

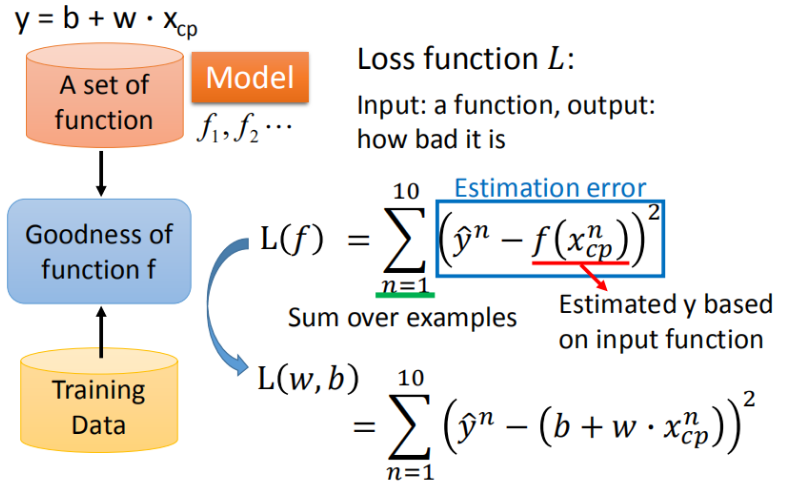

有了这些真实的数据,那我们怎么衡量模型的好坏呢?从数学的角度来讲,我们使用距离。也就是使用损失函数(Loss function) 来衡量模型的好坏,统计原始数据 ( y ^ n − f ( x c p n ) ) 2 \left ( \hat{y}^n - f(x_{cp}^n) \right )^2 (y^n−f(xcpn))2 的和,和越小模型越好。如下图所示:

公式推导的过程:

L ( f ) = ∑ n = 1 N ( y ^ n − f ( x n ) ) 2 , 将 【 f ( x ) = y 】 , 【 y = b + w ⋅ x 】 代 入 = ∑ n = 1 N ( y ^ n − ( b + w ⋅ x ) ) 2 \begin{aligned} L(f) & = \sum_{n=1}^{N}\left ( \hat{y}^n - f(x^n) \right )^2,将【f(x) = y】, 【y= b + w·x】代入 \\ & = \sum_{n=1}^{N}\left ( \hat{y}^n - (b + w·x) \right )^2\\ \end{aligned} L(f)=n=1∑N(y^n−f(xn))2,将【f(x)=y】,【y=b+w⋅x】代入=n=1∑N(y^n−(b+w⋅x))2

最终定义 损失函数 Loss function: L ( w , b ) = ∑ n = 1 N ( y ^ n − ( b + w ⋅ x ) ) 2 L(w,b)= \sum_{n=1}^{N}\left ( \hat{y}^n - (b + w·x) \right )^2 L(w,b)=∑n=1N(y^n−(b+w⋅x))2

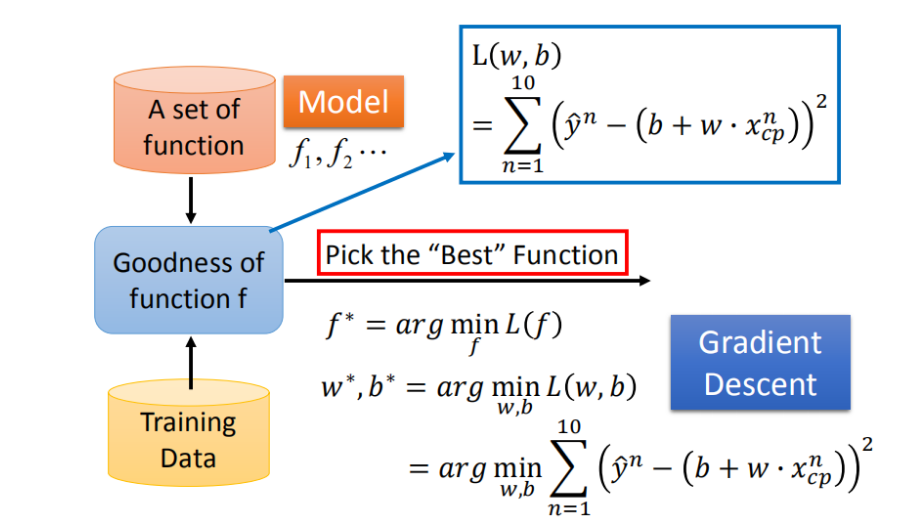

Step 3:最佳模型 - 梯度下降

【单个特征】: x i x_{i} xi

如何筛选最优的模型(参数w,b)

已知损失函数是

L

(

w

,

b

)

=

∑

n

=

1

N

(

y

^

n

−

(

b

+

w

⋅

x

i

)

)

2

L(w,b)= \sum_{n=1}^{N}\left ( \hat{y}^n - (b + w·x_{i}) \right )^2

L(w,b)=∑n=1N(y^n−(b+w⋅xi))2 ,需要找到一个令结果最小的

f

∗

f^*

f∗,在实际的场景中,我们遇到的参数肯定不止

w

w

w,

b

b

b。

定义

w

∗

=

a

r

g

min

x

L

(

w

)

w^* = arg\ \underset{x}{\operatorname{\min}} L(w)

w∗=arg xminL(w)

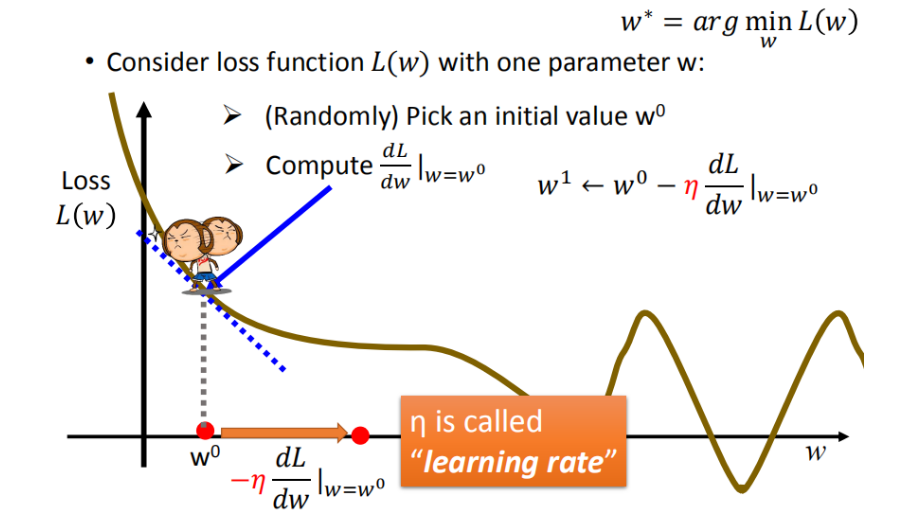

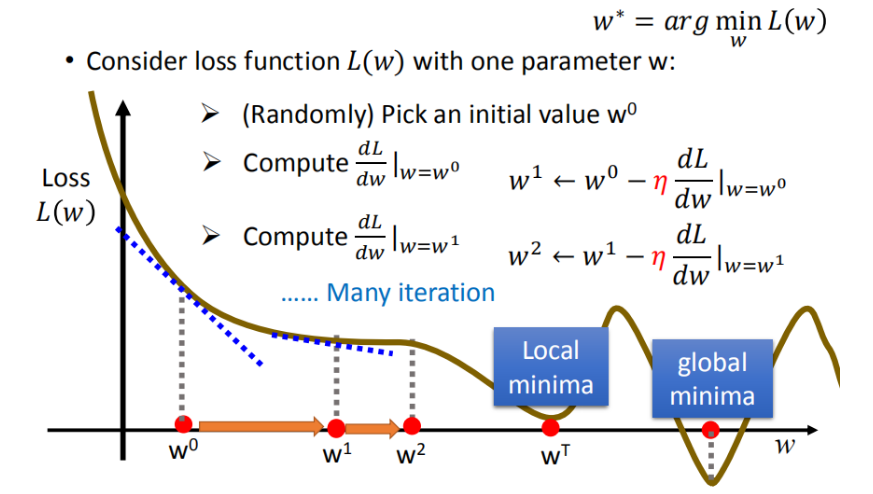

首先在这里引入一个概念 学习率 :移动的步长,如图中

η

\eta

η

- 步骤1:随机选取一个 w 0 w^0 w0

- 步骤2:计算微分,也就是当前的斜率,根据斜率来判定移动的方向

- 大于0向右移动(增加 w w w)

- 小于0向左移动(减少 w w w)

- 步骤3:根据学习率移动

- 重复步骤2和步骤3,直到找到最低点

解释完单个模型参数

w

w

w,引入2个模型参数

w

w

w 和

b

b

b , 其实过程是类似的,需要做的是偏微分,过程如下图所示,

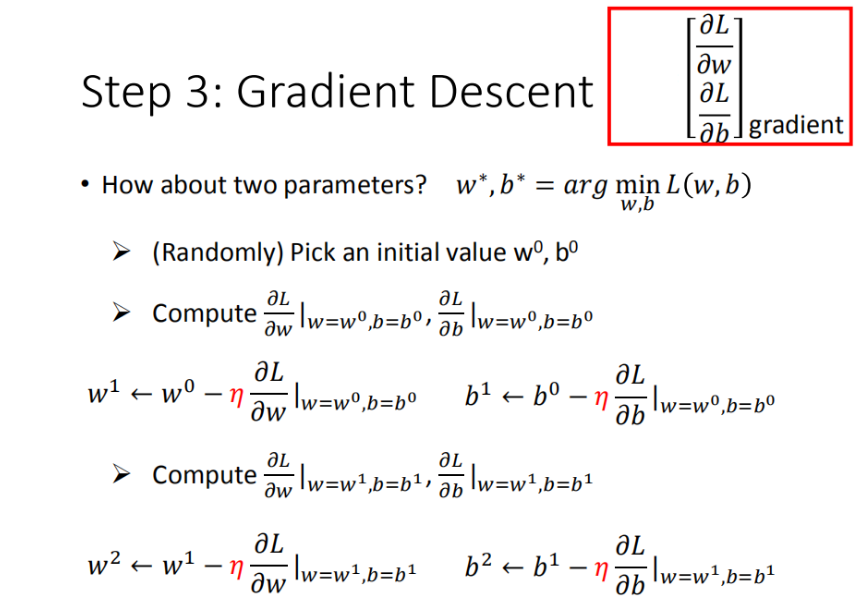

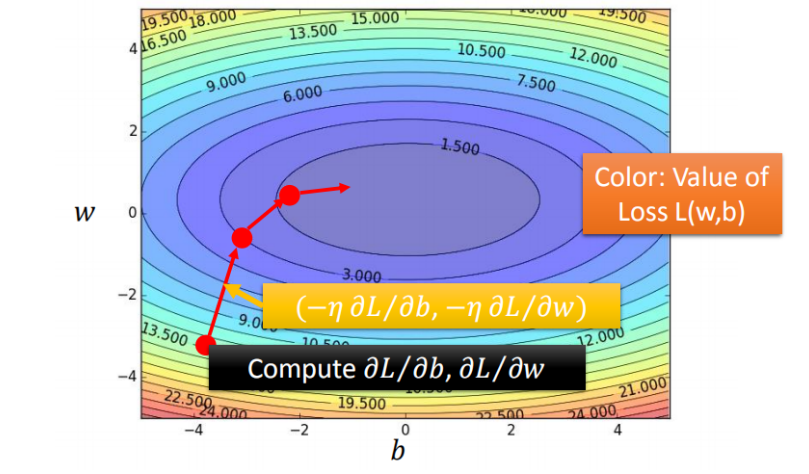

梯度下降推演最优模型的过程

如果把 w w w 和 b b b 在图形中展示:

- 每一条线围成的圈就是等高线,代表损失函数的值,颜色约深的区域代表的损失函数越小

- 红色的箭头代表等高线的法线方向

如何验证训练好的模型的好坏

更强大复杂的模型:1元N次线性模型

过拟合问题出现

步骤优化

Step1优化:2个input的线性模型是合并到一个线性模型中

Step2优化:如果希望模型更强大表现更好(更多参数,更多input)

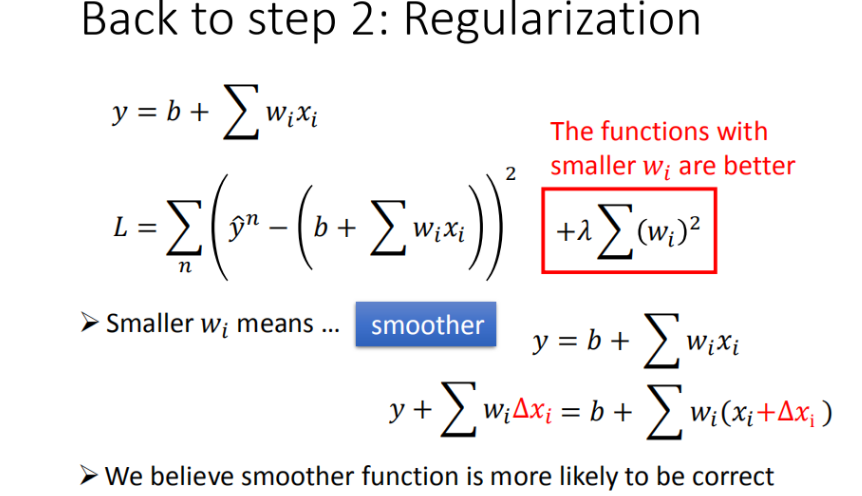

Step3优化:加入正则化

- w w w 越小,表示 f u n c t i o n function function 较平滑的, f u n c t i o n function function输出值与输入值相差不大

- 在很多应用场景中,并不是 w w w 越小模型越平滑越好,但是经验值告诉我们 w w w 越小大部分情况下都是好的。

- b b b 的值接近于0 ,对曲线平滑是没有影响。

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?