关于Tensorflow与Pytorch之间可用性、易用性、速度、部署能力的选择之争历来有之,但由于迄今为止深度学习框架已经发展了相当长一段时间,框架各自的缺点在一次次的更新迭代中被优化与改进,如Tensorflow目前也更新了所谓具有动态图的版本,对两者区分的意义越来越小。虽然如此,对这两个经典框架的区分还是比较有学习意义的。

正文

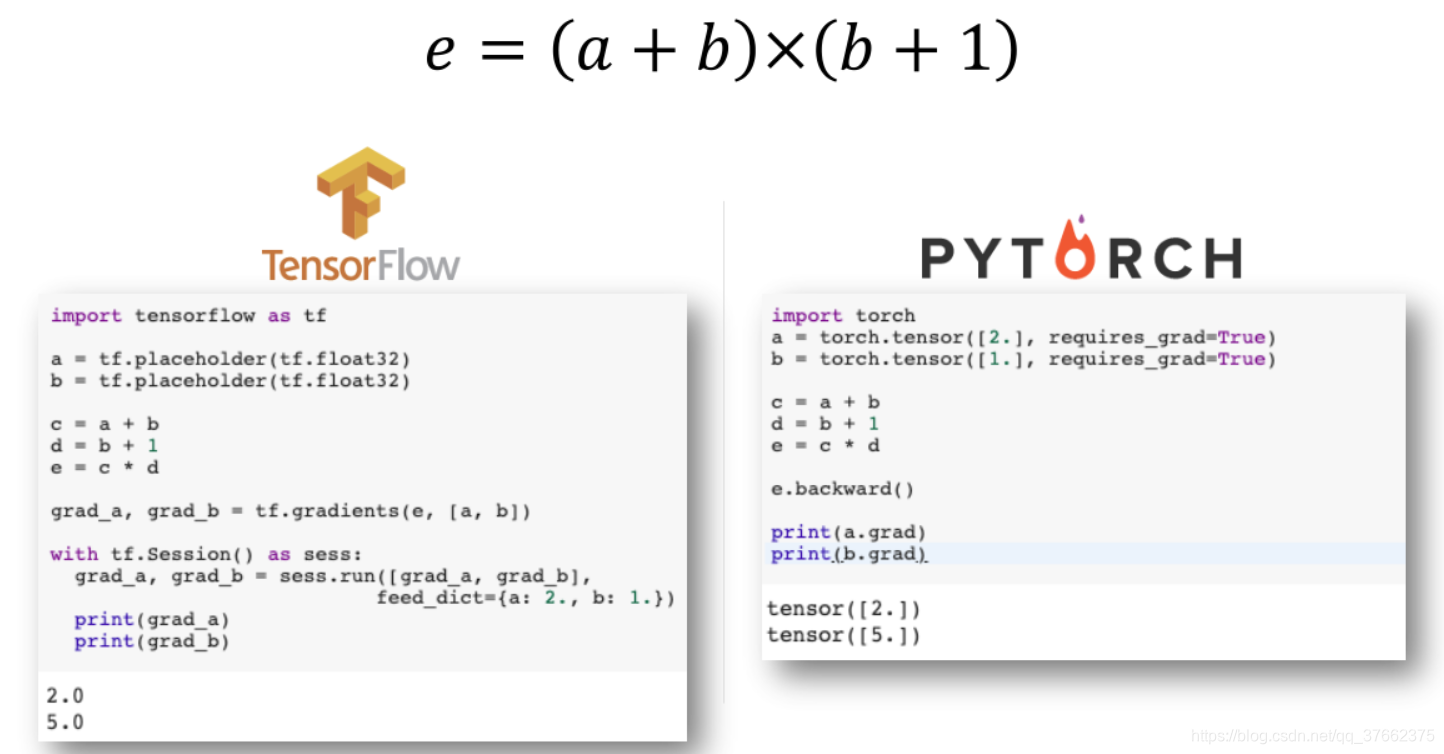

对于Tensorflow和Pytorch的区别,首先能想到的肯定是tensorflow是静态图计算,而pytorch是动态图。那么动静态图是什么意思?在框架中又是如何体现与使用的呢?

计算图

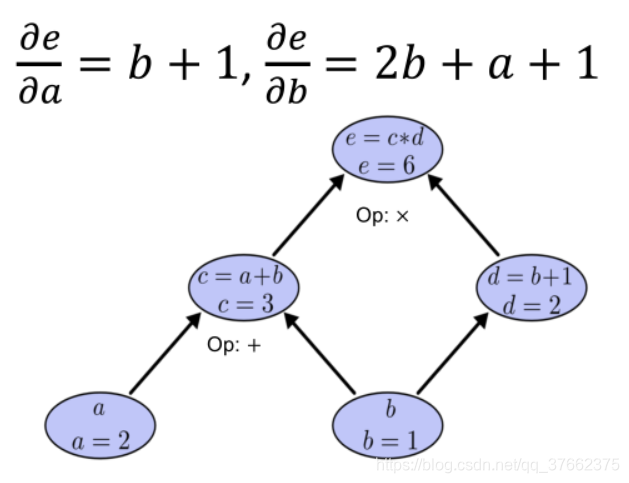

不论是动态图还是静态图,它们都属于计算图。计算图是用来描述运算的有向无环图,它有两个主要元素:结点(Node) 和边(Edge) 。结点表示数据,如向量、矩阵、张量,而边表示运算,如加减乘除卷积等。

采用计算图来描述运算的好处不仅是让运算流的表达更加简洁清晰,还有一个更重要的原因是方便求导计算梯度。

上图表示的是e=(a+b)* (b+1)代表的计算图,若要计算e对b的导数,那么结合链式求导法则,就在计算图中反向从y找到所有到w的路径,每条路径上各段的导数相乘就是该路径的偏导,最后再将所有路径获得的偏导求和即可。

叶子节点是用户创建的变量,如上图的a与b,在Pytorch的实现中,为了节省内存,在梯度反向传播后,非叶子节点的梯度都会被释放掉。

动态图

动态图意味着计算图的构建和计算同时发生(define by run)。这种机制由于能够实时得到中间结果的值,使得调试更加容易,同时我们将大脑中的想法转化为代码方案也变得更加容易,对于编程实现来说更友好。Pytorch使用的就是动态图机制,因此它更易上手,风格更加pythonic,大受科研人员的喜爱。

静态图

静态图则意味着计算图的构建和实际计算是分开(define and run)的。在静态图中,会事先了解和定义好整个运算流,这样之后再次运行的时候就不再需要重新构建计算图了(可理解为编译),因此速度会比动态图更快,从性能上来说更加高效,但这也意味着你所期望的程序与编译器实际执行之间存在着更多的代沟,代码中的错误将难以发现,无法像动态图样随时拿到中间计算结果。Tensorflow默认使用的是静态图机制,这也是其名称的由来,先定义好整个计算流(flow) ,然后再对数据 (tensor)进行计算。

动态图vs静态图

通过一个例子来对比一下动静态图机制在编程实现上的区别:

import torch

first_counter = torch.Tensor([0])

second_counter = torch.Tensor([10])

while (first_counter < second_counter) :

first_counter += 2

second_counter += 1

可以看到,Pytorch的编程与python无异,再来看看Tensorflow的静态图机制:

import tensorflow as tf

first_counter = tf.constant(0)

second_counter = tf.constant(10)

def cond(first_counter, second_counter, *args):

return first_counter < second_counter

def body(first_counter, second_counter):

first_counter = tf.add(first_counter, 2)

second_counter = tf.add(second_counter, 1)

return first_counter, second_counter

c1, c2 = tf.while_loop(cond, body, [first_counter, second_counter])

with tf.Session() as sess:

counter_1_res, counter_2_res = sess.run([c1, c2])Tensorflow在静态图的模式下,每次运算使用的计算图都是同一个,因此不能直接使用python的while循环语句,而是要使用其内置的辅助函数th.while_loop,而且还要额外的tf.Session().run()之类的。

而Pytorch的动态图模式,每次运算会构建新的计算图,在编程实现上不需要额外的学习成本。

本文探讨了Tensorflow和Pytorch之间的主要差异,重点关注静态图和动态图的概念及其在实际应用中的优缺点。动态图允许即时反馈和更直观的编程,适合快速原型和调试,而静态图则提供更高的运行效率,适用于优化和部署。尽管Tensorflow推出了动态图模式,但两种框架各有适用场景,选择取决于具体需求。

本文探讨了Tensorflow和Pytorch之间的主要差异,重点关注静态图和动态图的概念及其在实际应用中的优缺点。动态图允许即时反馈和更直观的编程,适合快速原型和调试,而静态图则提供更高的运行效率,适用于优化和部署。尽管Tensorflow推出了动态图模式,但两种框架各有适用场景,选择取决于具体需求。

1191

1191

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?