一.基于Word2vec词聚类的关键词步骤

基于Word2Vec的词聚类关键词提取包括以下步骤:

1.准备文本数据:

收集或准备文本数据,可以是单一文档或文档集合,涵盖关键词提取的领域。

2.文本预处理:

清洗文本数据,去除无关字符、标点符号,将文本转换为小写等。

进行分词,将文本划分为词语。

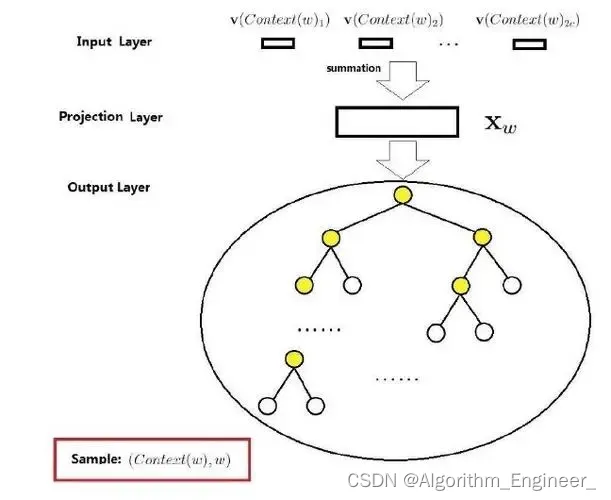

3.训练Word2Vec模型:

使用预处理后的文本数据训练Word2Vec模型。

可以使用现有的库如gensim,也可以自行实现Word2Vec模型的训练。

定义模型的参数,如词向量维度、窗口大小、最小词频等。

4.获取词向量:

通过训练好的Word2Vec模型获取每个词语的词向量。

5.词聚类:

使用聚类算法对词向量进行聚类,将相似的词语分为同一簇。

常用的聚类算法包括K-Means、DBSCAN等。

定义聚类的数量(簇数)。

6.获取每个聚类的代表词:

对每个聚类,选择代表性的词语作为关键词。

这可以通过计算每个聚类的中心或其他代表性指标来实现。

7.输出关键词:

将每个聚类的代表词作为关键词输出,得到最终的关键词列表。

整个流程的核心在于使用Word2Vec模型得到词向量,然后通过聚类算法将相似的词语归为一簇,最终提取每个簇的代表性词语作为关键词。这种方法能够捕捉词语之间的语义关系,提高关键词的表达力。

二.基于Word2vec词聚类的关键词的代码实现

词向量的预处理

# coding=utf-8

import warnings

warnings.filterwarnings(action='ignore', category=UserWarning, module='gensim') # 忽略警告

import codecs

import pandas as pd

import numpy as np

import jieba # 分词

import jieba.posseg

import gensim # 加载词向量模型

# 返回特征词向量bai

def word_vecs(wordList, model):

name = []

vecs = []

for word in wordList:

word = word.replace('\n', '')

try:

if word in model: # 模型中存在该词的向量表示

name.append(word.encode('utf8').decode("utf-8"))

vecs.append(model[word])

except KeyError:

continue

a = pd.DataFrame(name, columns=['word'])

b = pd.DataFrame(np.array(vecs, dtype='float'))

return pd.concat([a, b], axis=1)

# 数据预处理操作:分词,去停用词,词性筛选

def data_prepare(text, stopkey):

l = []

# 定义选取的词性

pos = ['n', 'nz', 'v', 'vd', 'vn', 'l', 'a', 'd']

seg = jieba.posseg.cut(text) # 分词

for i in seg:

# 去重 + 去停用词 + 词性筛选

if i.word not in l and i.word\

not in stopkey and i.flag in pos:

# print i.word

l.append(i.word)

return l

# 根据数据获取候选关键词词向量

def build_words_vecs(data, stopkey, model):

idList, titleList, abstractList = data['id'], data['title'], data['abstract']

for index in range(len(idList)):

id = idList[index]

title = titleList[index]

abstract = abstractList[index]

l_ti = data_prepare(title, stopkey) # 处理标题

l_ab = data_prepare(abstract, stopkey) # 处理摘要

# 获取候选关键词的词向量

words = np.append(l_ti, l_ab) # 拼接数组元素

words = list(set(words)) # 数组元素去重,得到候选关键词列表

wordvecs = word_vecs(words, model) # 获取候选关键词的词向量表示

# 词向量写入csv文件,每个词400维

data_vecs = pd.DataFrame(wordvecs)

data_vecs.to_csv('result/vecs/wordvecs_' + str(id) + '.csv', index=False)

print ("document ", id, " well done.")

def main():

# 读取数据集

dataFile = 'data/text.csv'

data = pd.read_csv(dataFile)

# 停用词表

stopkey = [w.strip() for w in codecs.open('data/stopWord.txt', 'r', encoding='utf-8').readlines()]

# 词向量模型

inp = 'wiki.zh.text.vector'

model = gensim.models.KeyedVectors.load_word2vec_format(inp, binary=False)

build_words_vecs(data, stopkey, model)

if __name__ == '__main__':

main()

基于word2vec的关键词提取

# coding=utf-8

import os

from sklearn.cluster import KMeans

import pandas as pd

import numpy as np

import math

# 对词向量采用K-means聚类抽取TopK关键词

def words_kmeans(data, topK):

words = data["word"] # 词汇

vecs = data.iloc[:, 1:] # 向量表示

kmeans = KMeans(n_clusters=1, random_state=10).fit(vecs)

labels = kmeans.labels_ # 类别结果标签

labels = pd.DataFrame(labels, columns=['label'])

new_df = pd.concat([labels, vecs], axis=1)

vec_center = kmeans.cluster_centers_ # 聚类中心

# 计算距离(相似性) 采用欧几里得距离(欧式距离)

distances = []

vec_words = np.array(vecs) # 候选关键词向量,dataFrame转array

vec_center = vec_center[0] # 第一个类别聚类中心,本例只有一个类别

length = len(vec_center) # 向量维度

for index in range(len(vec_words)): # 候选关键词个数

cur_wordvec = vec_words[index] # 当前词语的词向量

dis = 0 # 向量距离

for index2 in range(length):

dis += (vec_center[index2] - cur_wordvec[index2]) * \

(vec_center[index2] - cur_wordvec[index2])

dis = math.sqrt(dis)

distances.append(dis)

distances = pd.DataFrame(distances, columns=['dis'])

# 拼接词语与其对应中心点的距离

result = pd.concat([words, labels, distances], axis=1)

# 按照距离大小进行升序排序

result = result.sort_values(by="dis", ascending=True)

# 抽取排名前topK个词语作为文本关键词

wordlist = np.array(result['word'])

# 抽取前topK个词汇

word_split = [wordlist[x] for x in range(0, topK)]

word_split = " ".join(word_split)

return word_split

if __name__ == '__main__':

# 读取数据集

dataFile = 'data/text.csv'

articleData = pd.read_csv(dataFile)

ids, titles, keys = [], [], []

rootdir = "result/vecs" # 词向量文件根目录

fileList = os.listdir(rootdir) # 列出文件夹下所有的目录与文件

# 遍历文件

for i in range(len(fileList)):

filename = fileList[i]

path = os.path.join(rootdir, filename)

if os.path.isfile(path):

# 读取词向量文件数据

data = pd.read_csv(path, encoding='utf-8')

# 聚类算法得到当前文件的关键词

artile_keys = words_kmeans(data, 5)

# 根据文件名获得文章id以及标题

(shortname, extension) = os.path.splitext(filename)

t = shortname.split("_")

article_id = int(t[len(t) - 1]) # 获得文章id

# 获得文章标题

artile_tit = articleData[articleData.id == article_id]['title']

print(artile_tit)

print(list(artile_tit))

artile_tit = list(artile_tit)[0] # series转成字符串

ids.append(article_id)

titles.append(artile_tit)

keys.append(artile_keys.encode("utf-8").decode("utf-8"))

# 所有结果写入文件

result = pd.DataFrame({"id": ids, "title": titles, "key": keys}, columns=['id', 'title', 'key'])

result = result.sort_values(by="id", ascending=True) # 排序

result.to_csv("result/word2vec.csv", index=False, encoding='utf_8_sig')

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?