Neural Machine Translation

many to many

数据集 预处理

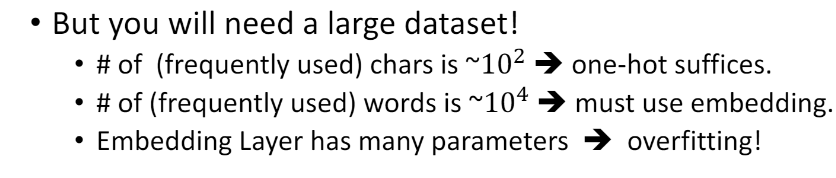

两者都可以,实际机器翻译是Word-level,因为数据集足够大

为什么采用两个tokenizers?

两者语言的字符是不一样的,不同的语言也有不同的分词

training seqtoseq model

decoder的初始状态是encoder的最后一个状态,decoder靠state(h,c)来知道前面的输入的英语句子

第一个输入必须是起始符,根据输出的概率p与y计算crossentropy 进行反向传播,第二次decoder的输入

重复上述过程

搭建过程

inference

重复

summary

只输出最后一个状态

how to improve

encoder 可以是双向的LSTM,但是decoder(文本生成器)是单向的

304

304

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?