文字理解 参考

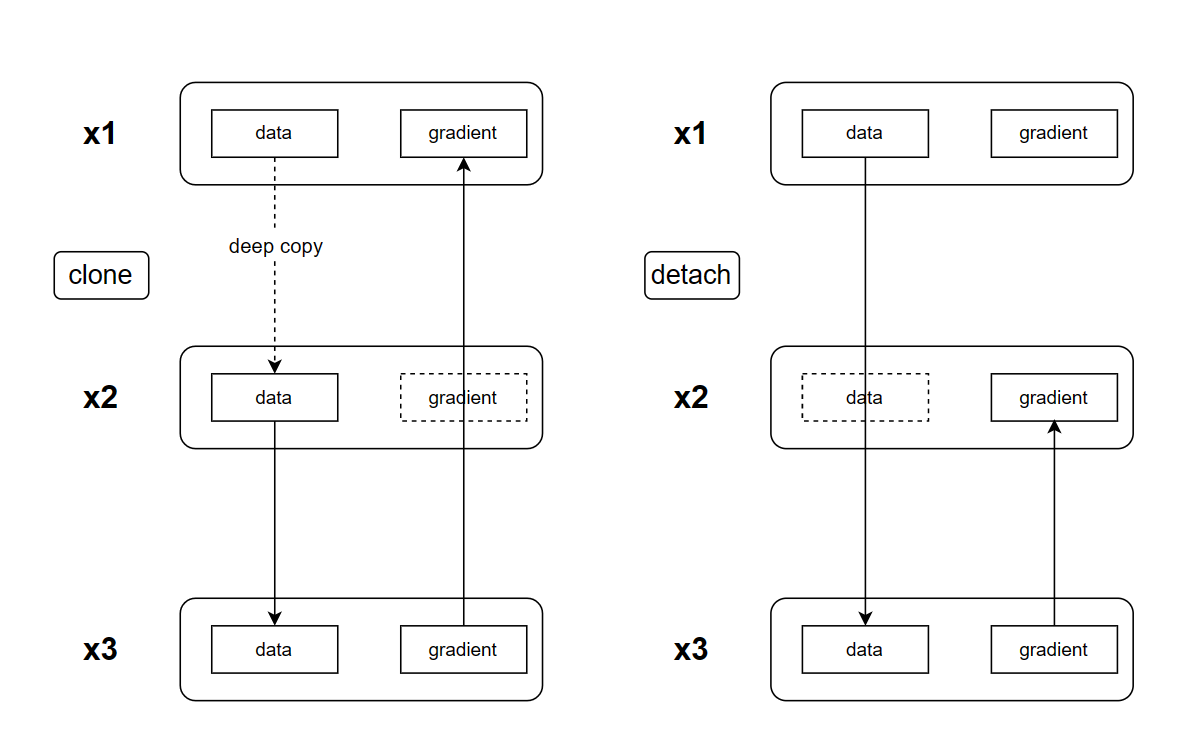

左图clone

clone是对数据data的`深度拷贝`,但是梯度是共享的, 即x1的data和x2的data是不一样的,但是gradient是同一个,共享一个内存地址。

右图detach

detach的机制正好与clone相反。x1的data和x2的data是同一个,但是gradient被截断了,是不通的,即x2的gradient回传不给x1

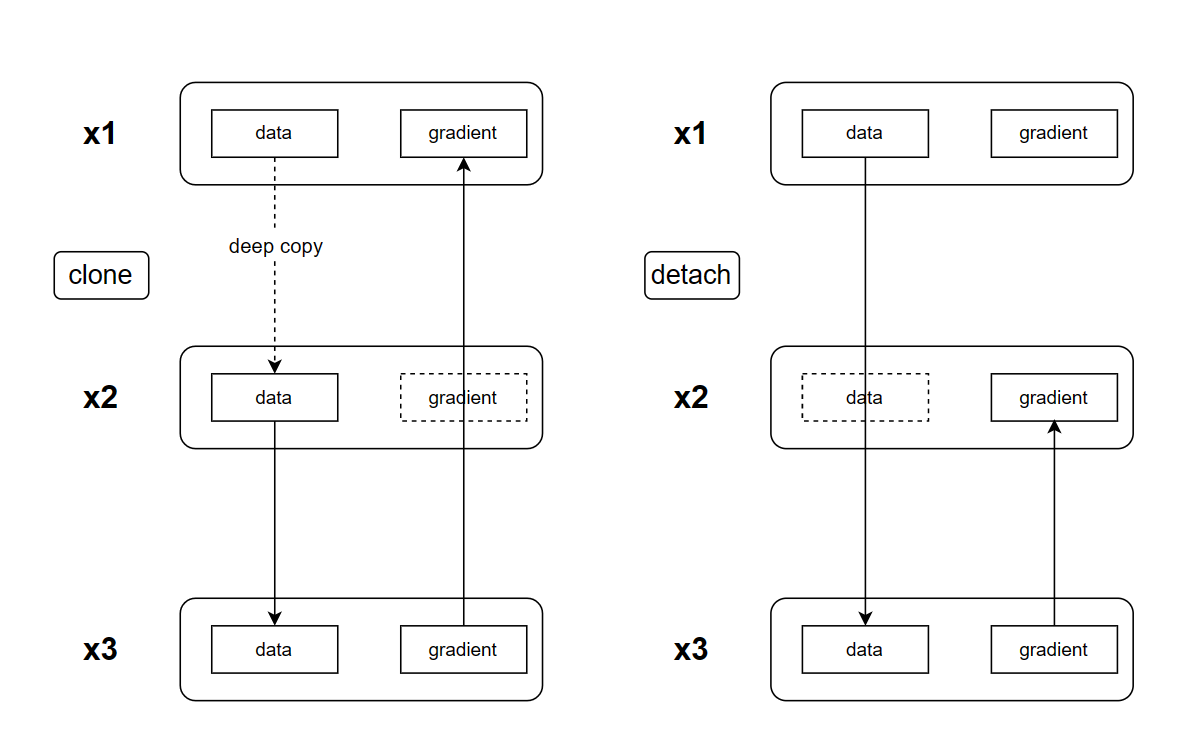

文字理解 参考

clone是对数据data的`深度拷贝`,但是梯度是共享的, 即x1的data和x2的data是不一样的,但是gradient是同一个,共享一个内存地址。

detach的机制正好与clone相反。x1的data和x2的data是同一个,但是gradient被截断了,是不通的,即x2的gradient回传不给x1

9146

9146

3万+

3万+

906

906

1135

1135

650

650

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?