单向RNN

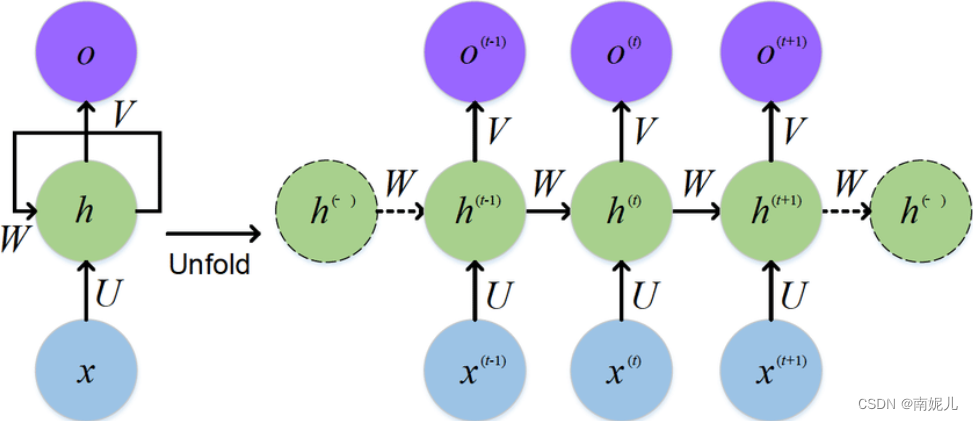

这几天一直在看RNN方面的知识,其中最感到疑惑的是下面的两张图。下面两张图说出了单向循环神经网络的所有原理,但是这里面其实是有一点问题的。比如下面第一张图,整个RNN的构成其实是有三个矩阵的。首先输入向量通过输入矩阵U,与上一个的隐藏层状态乘以权重矩阵W后相乘得到了这一层的隐藏状态ht,ht通过权重矩阵V得到最后的输出。

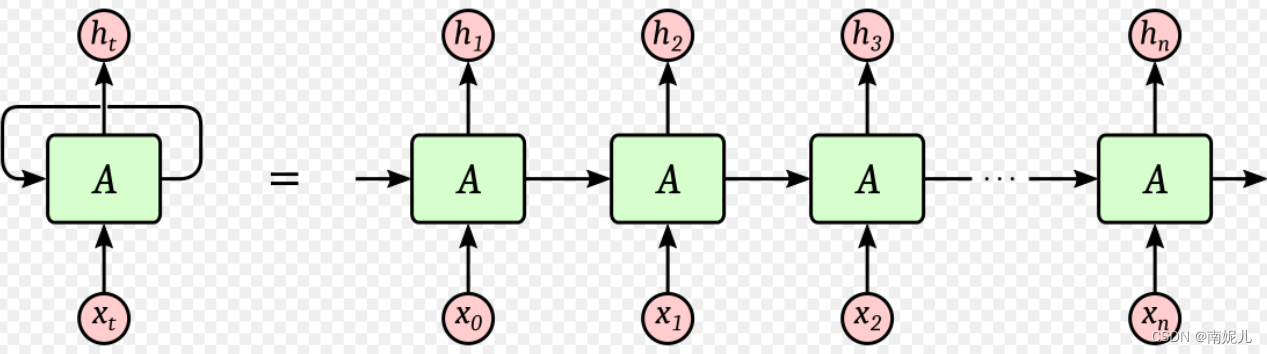

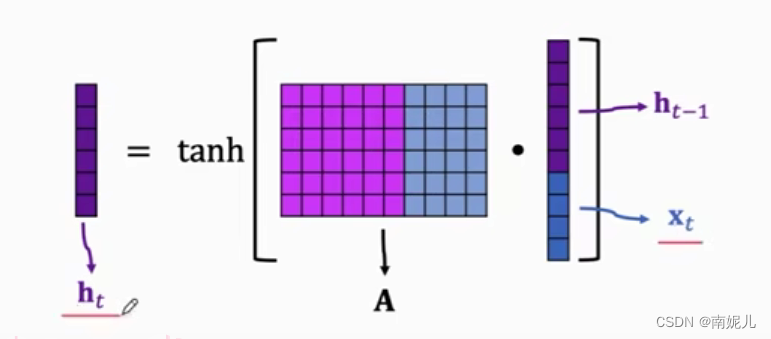

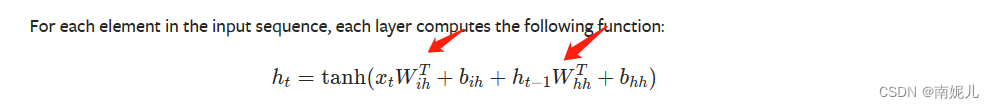

下面这一张图更加简单,整个RNN共用一个矩阵。下图的第二张图讲的非常清楚。将上一层的隐藏层状态和当前的输入拼接送入权重矩阵A中得到本层的隐藏层的状态。

pytorch中 RNN的实现

RNN — PyTorch 1.13 documentation

上面

订阅专栏 解锁全文

订阅专栏 解锁全文

4215

4215

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?