前言:

feature scaling 即为特征归一化、标准化,是数据预处理中的重要技术。在实际运用中,使用梯度下降算法的模型都需要归一化,包括线性回归、逻辑回归、支持向量机、神经网络等模型。但对决策树模型并不适用,因为信息增益、信息增益比、基尼指数跟特征是否经过归一化是无关的。

1、归一化的原因

- 对数据做特征归一化是为了消除特征尺度不同所带来的影响,使特征具有可比性。

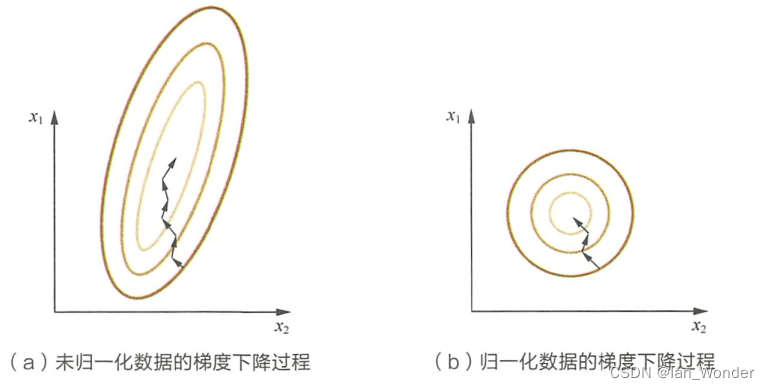

- 数值归一化后能加快收敛速度,更容易找到梯度下降的最优解。在基于梯度更新对模型求解的过程中,未归一化的数值特征在求解时,梯度下降较为抖动,模型难以收敛,而归一化后的数值特征较为稳定,进而减少梯度下降的次数,模型更容易收敛。

2、常用的feature scaling

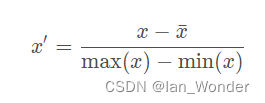

- Mean Normalization(均值归一化)

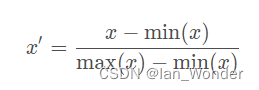

- min-max normalization

3、类别型特征转换为数值型特征

- 序列编码

- one-hot编码

对于类别取值较多(转换成onehot编

特征归一化是数据预处理的关键步骤,尤其在使用梯度下降的模型中。它消除特征尺度差异,提升模型收敛速度。常见的归一化方法包括均值归一化和min-max归一化。类别型特征通常通过序列编码、one-hot编码或二进制编码转化为数值型。特征组合用于揭示数据的复杂关系,而高维组合特征可以通过PCA、LDA等降维技术处理。

特征归一化是数据预处理的关键步骤,尤其在使用梯度下降的模型中。它消除特征尺度差异,提升模型收敛速度。常见的归一化方法包括均值归一化和min-max归一化。类别型特征通常通过序列编码、one-hot编码或二进制编码转化为数值型。特征组合用于揭示数据的复杂关系,而高维组合特征可以通过PCA、LDA等降维技术处理。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?