神经网络

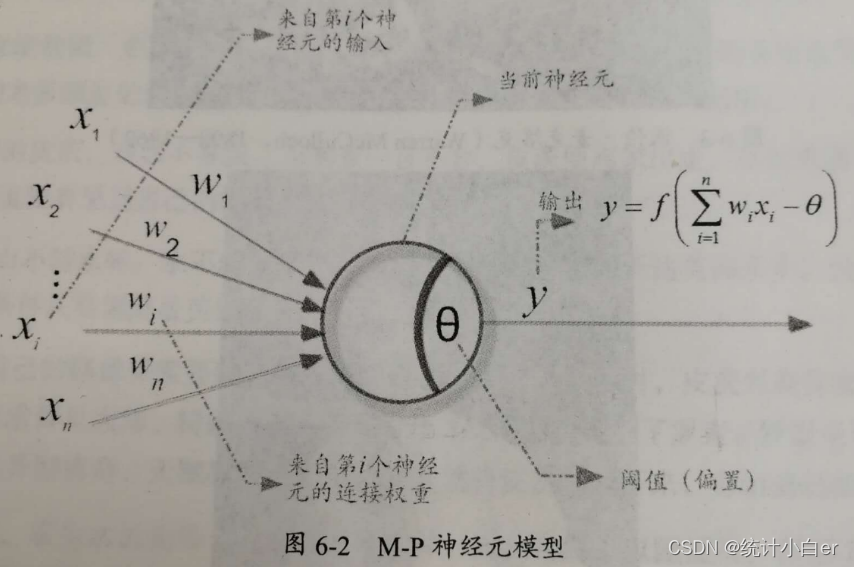

1. 神经元模型

神经网络是由具有适应性的简单单元组成的广泛并行互连的网络, 它的组织能够模拟生物神经系统对真实世界物体所作出的交互反应.

神经网络中最基本的成分是神经元模型, 即上述定义中的"简单单元".

把许多个这样的神经元按一定的层次结构连接起来, 就得到了神经网络.

只需将一个神经网络视为包含了许多参数的数学模型, 这个模型是若干个函数, 例如

y

i

=

f

(

∑

i

ω

i

x

i

−

θ

j

)

y_{i} = f(\sum_{i}\omega_{i}x_{i}-\theta_{j})

yi=f(i∑ωixi−θj)

相互(嵌套)代入而得.

激活函数:

-

阶跃函数

-

Sigmoid函数

理想的激活函数是阶跃函数, 但是阶跃函数具有不连续、不光滑等不太好的性质, 因此实际常用Sigmoid函数作为激活函数, Sigmoid函数也称为"挤压函数".

专业词汇:

神经网络 - neural networks

神经元 - neuron / unit

阈值 - threshold / 偏置 - bias

连接 - connection

激活函数 /响应函数 - activation function

挤压函数 - squashing function

2. 感知机与多层网络

感知机由两层神经元组成:

感知机学习规则就是, 对训练样例

(

x

,

y

)

(x,y)

(x,y) , 若当前感知机的输出为

y

^

\hat{y}

y^ , 则感知机权重将这样调整:

ω

i

←

ω

i

+

△

ω

i

△

ω

i

=

η

(

y

−

y

^

)

x

i

η

∈

(

0

,

1

)

\omega_{i} \leftarrow \omega_{i} + \triangle \omega_{i} \\ \triangle \omega_{i} = \eta(y - \hat{y})x_{i} \\ \eta \in (0,1)

ωi←ωi+△ωi△ωi=η(y−y^)xiη∈(0,1)

其中

η

\eta

η 称为学习率. 上式的意思就是如何感知机对训练样例预测正确, 也就是

y

=

y

^

y=\hat{y}

y=y^ , 则感知机不发生变化, 否则将根据错误的程度进行权重调整.

多层前馈神经网络:

每层神经元与下一层神经元互连, 神经元之间不存在同层连接, 也不存在跨层连接. 这样的神经网络结构通常称为"多层前馈神经网络".

神经网络的学习过程就是根据训练数据来调整神经元之间的"连接权重"以及每个功能神经元的阈值; 换言之, 神经网络"学"到的东西, 蕴涵在连接权重与阈值中.

专业词汇:

感知机 - perceptron

阈值逻辑单元 - threshold logic unit

哑结点 - dummy node

学习率 - learning rate

功能神经元 - functional neuron

线性可分 - linearly separable

收敛 - converge

振荡 - fluctuation

隐层/隐含层/隐藏层 - hidden layer

多层前馈神经网络 - multi-layer feedforward neural networks

连接权/连接权重 - connection weight

待续~

720

720

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?