talk

在写这篇文章笔记时候,以为是 MVGRL+GRACE。。看完代码和GraphCL,发现这篇文章是 GRACE+GraphCL的 拼接版本,代码就是两者的结合。

不同之处

1.

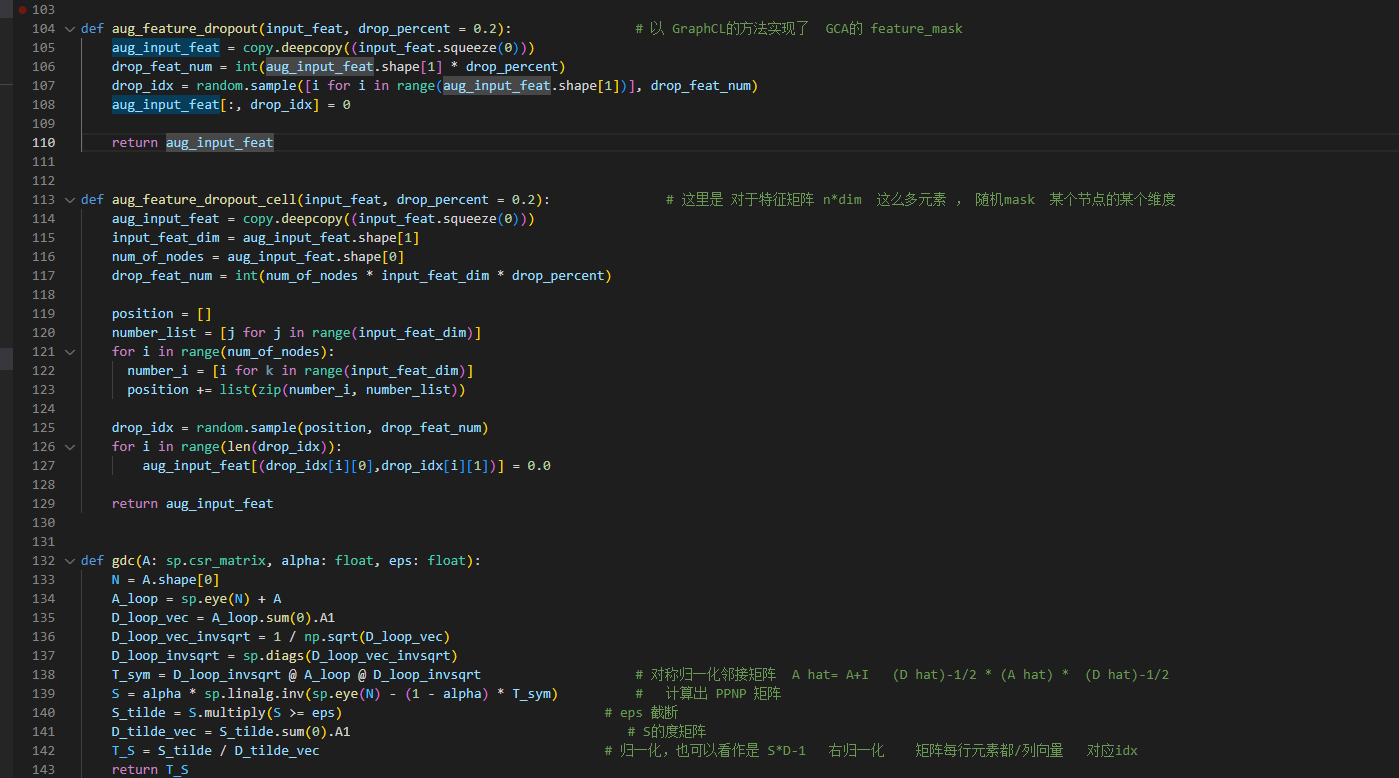

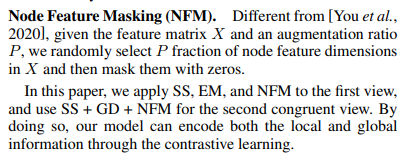

视图增强里面,大都是 GraphCL 处理cora的代码,这里作者增加了三个函数,第一个是 随机 将X(所有节点)的某 几个 维度 完全mask,和GRACE 特征掩码一样,第二个是 对于 每个节点的每个维度,都存在mask 概率。 第三个 gdc 是 通过PPNP直接 计算S,再归一化

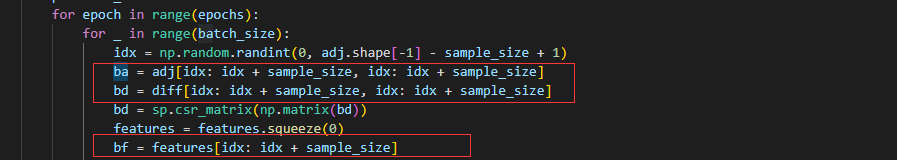

2. 训练的时候 又采用了 MVGRL的 naive sampling

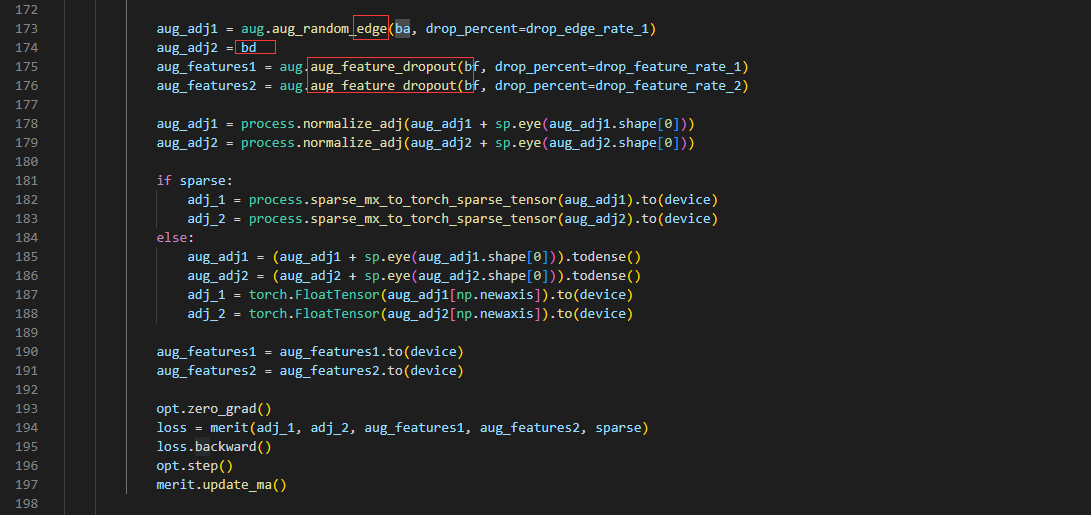

视图1: 采样+edge+GRACE drop。

视图2: 采样+diff + GRACE drop。

代码这里确实和paper一样

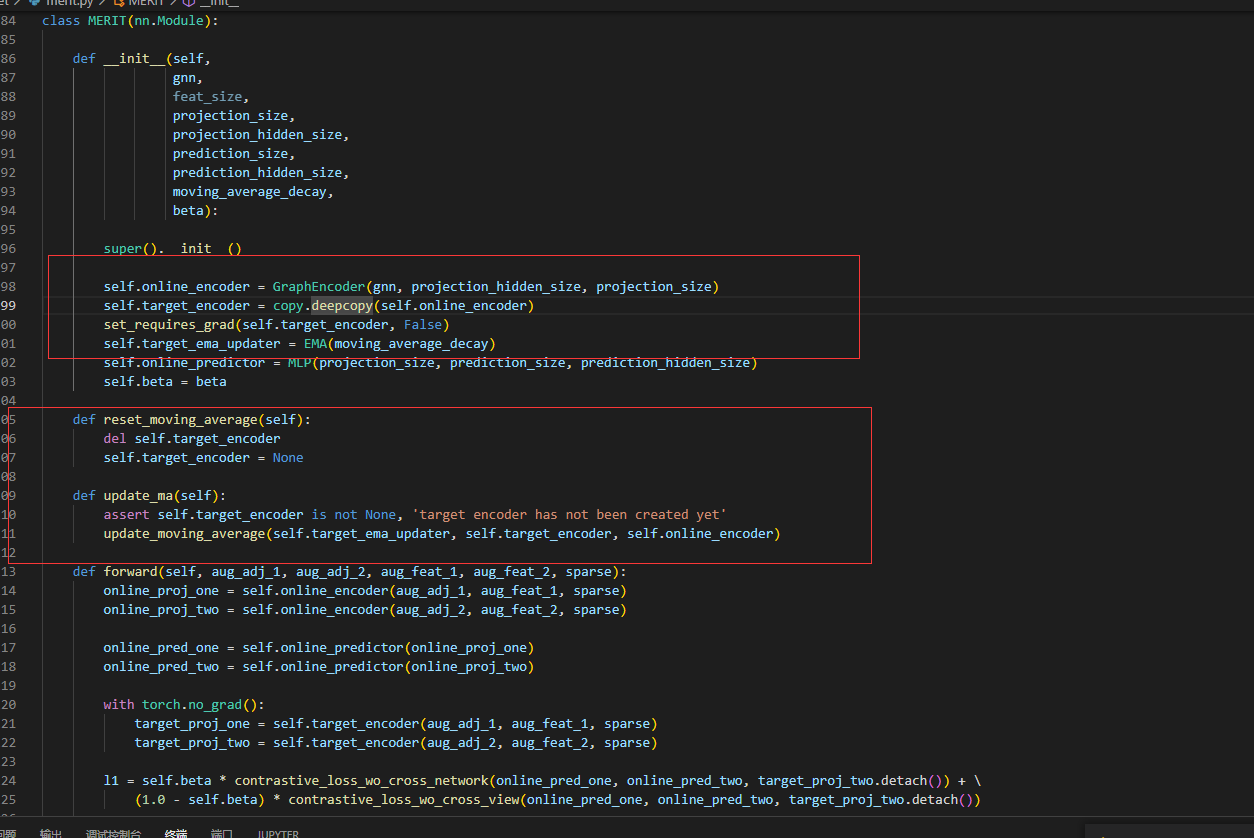

3. 模型里面动量EMA更新

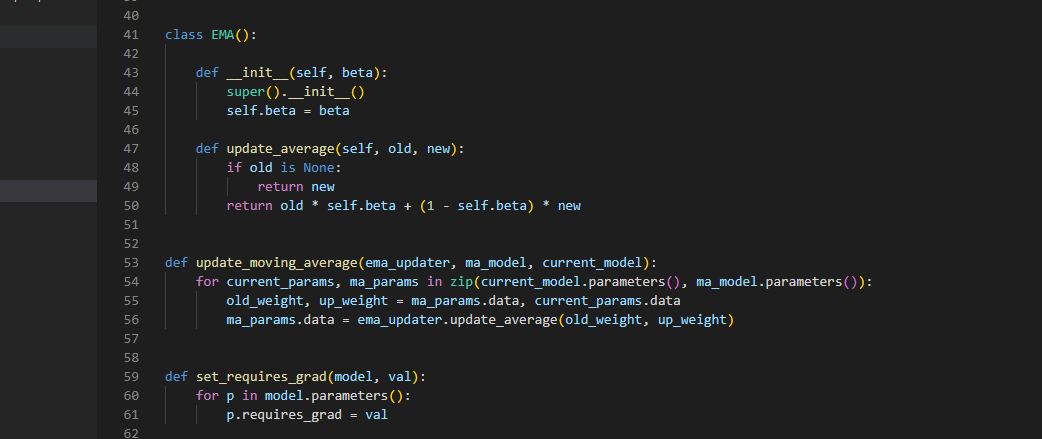

定义ema 以及 moving_average

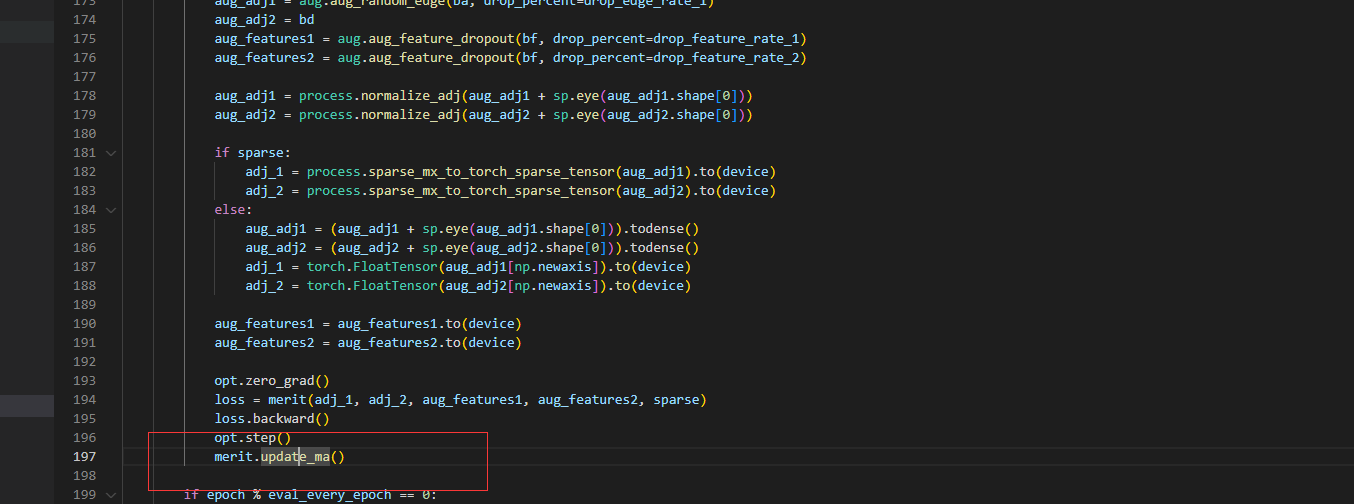

模型 参数更新

online , target encoder 初始化

效果: 收敛很慢,速度很慢,且作者保存最好的结果,才达到其文章中的acc。

9140

9140

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?