talk

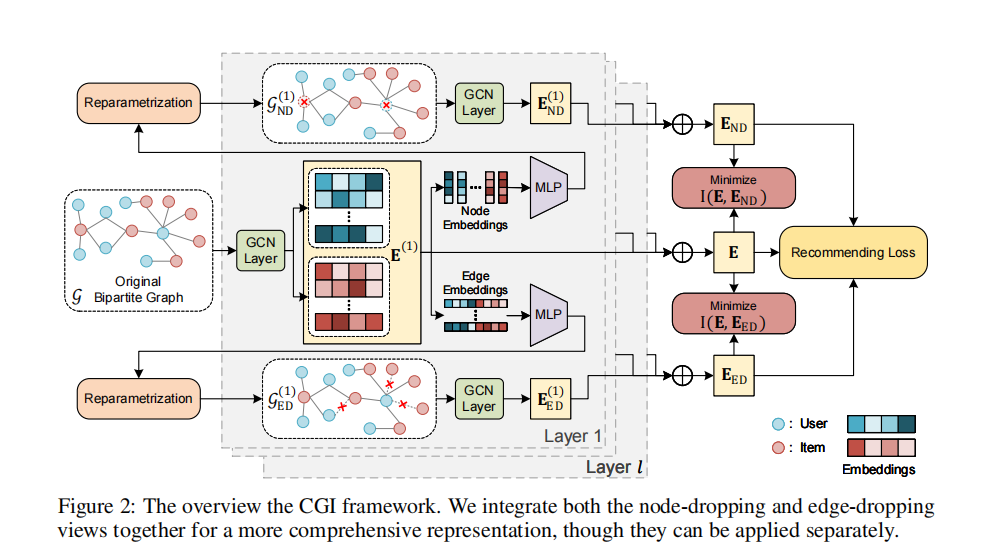

文章是阿里的,创新性也是一般,但在于其实验充分,且遇到了一个不是同行的审稿人给了8.。文章核心思想:对比学习来做推荐。不同点1:其所谓的图结构学习:不是简单的采用drop node或者edge,而是采用替换node和 mlp学边。 不同点2:损失函数,其从信息瓶颈阐述,这里很多地方写的不是很好,证明或者做法都怪怪的,自己看完,觉得不知道为什么 infonce也可以 去消除冗余。 有审稿人也是这样的看法。

1. model

1.1丢弃节点

从伯努利分布中 根据 ωi采样出 mask,来进行drop,不同于之前的,不是drop节点,而是采用邻居embedding代替节点embedding。

这里这个ωi 在底下有介绍,通过节点特征算。

1.2 丢弃边

同样是通过ωi 来进行伯努利采样,得到mask ρ。

其中,对于节点ωi,直接通过节点表征mlp。边的,通过两个节点拼接后端的表征接mlp。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

659

659

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?