一、本地部署模型

ollama官网:Ollama

下载ollama

ollama基本命令:

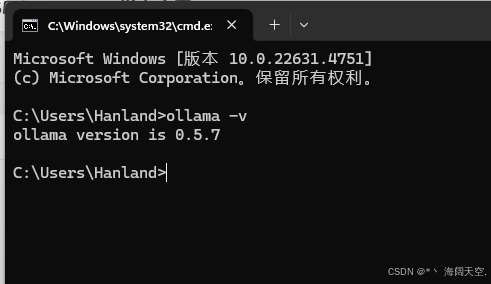

#查看版本号

ollama -v

#列出本地所有可用的模型

ollama list

#删除一个已安装的模型

ollama rm [模型名称]安装后查看版本号

安装成功!

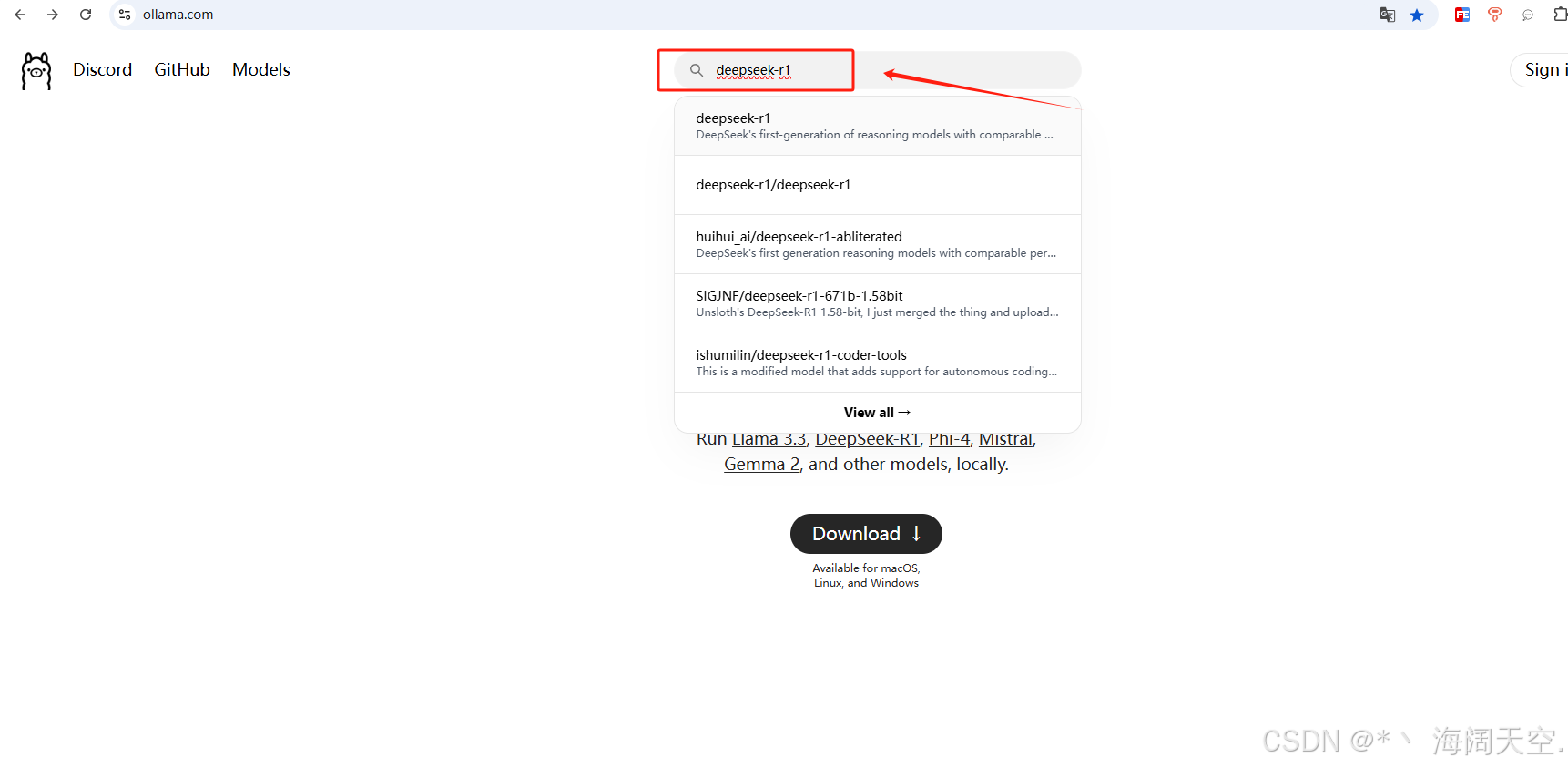

搜索 deepseek-r1

具体参数可参照配置表自行选择

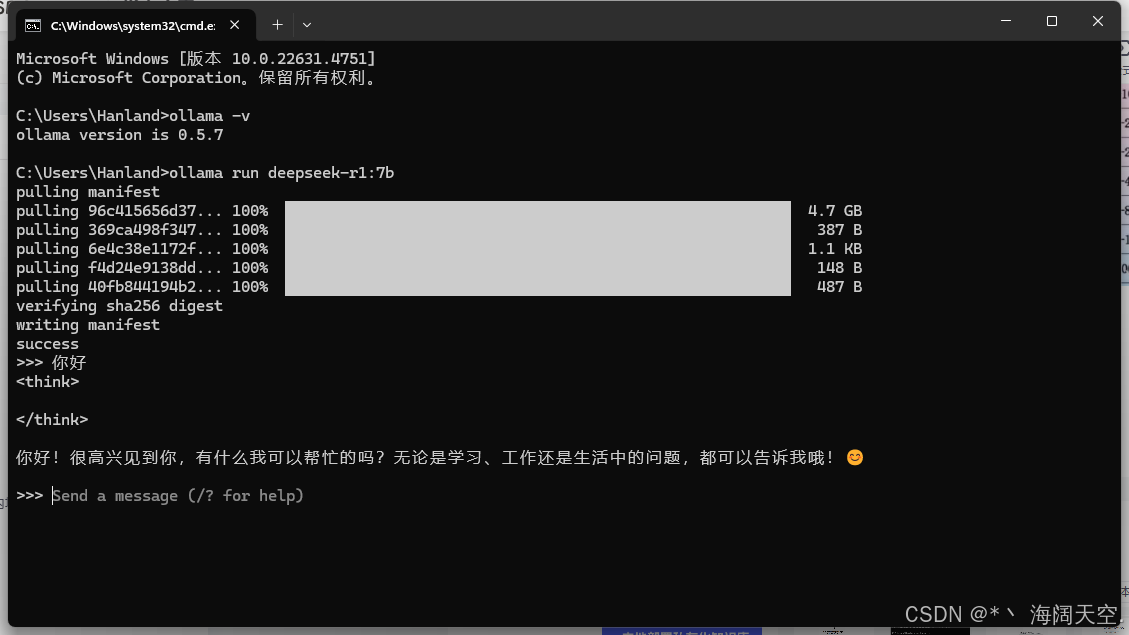

出现success安装成功!

dify官网:Dify.AI · 生成式 AI 应用创新引擎

部署dify首先下载dokcer docker官网:https://www.docker.com/

文档链接:Deploy with Docker Compose | Dify

将 Dify 源代码克隆到本地机器:

git clone https://github.com/langgenius/dify.git启动 Dify

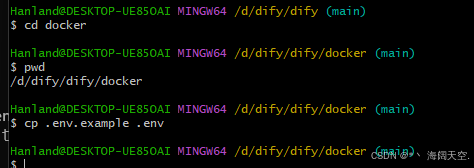

1. 导航到 Dify 源代码中的 Docker 目录

cd dify/docker2. 复制环境配置文件

cp .env.example .env

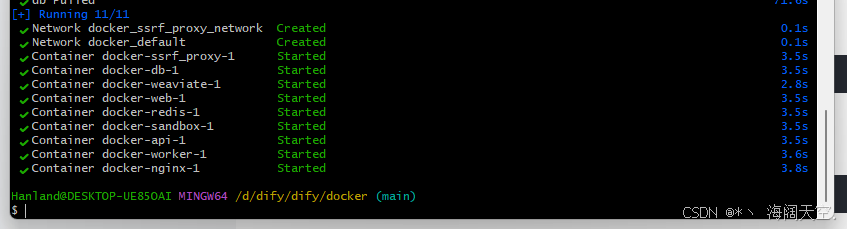

3.启动 Docker 容器

如果您有 Docker Compose V2,请使用以下命令:

docker compose up -d如果您有 Docker Compose V1,请使用以下命令:

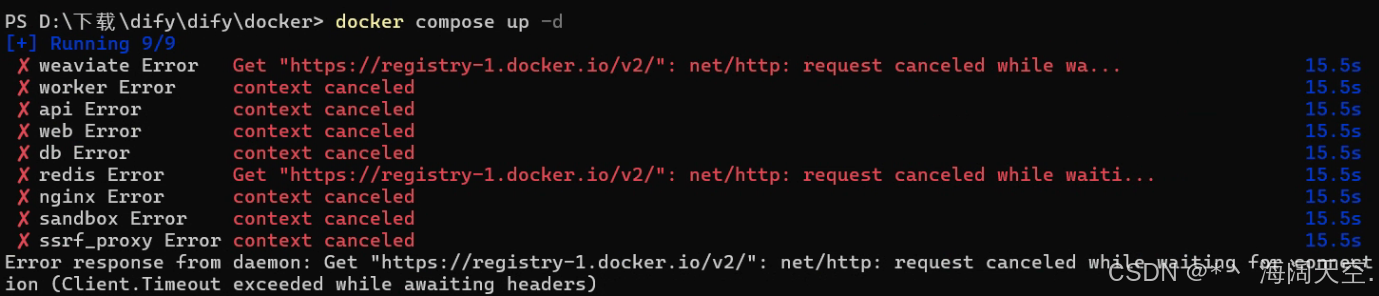

docker-compose up -d如果遇到报错:

Error response from daemon: Get "https://registry-1.docker.io/v2/": net/http: request canceled while waiting for connection (Client.Timeout exceeded while awaiting headers)

问题是镜像源没有配置国内的镜像源

Linux系统设置如下:

vi /etc/docker/daemon.json配如下地址:

{

"registry-mirrors": [

"https://2a6bf1988cb6428c877f723ec7530dbc.mirror.swr.myhuaweicloud.com",

"https://docker.m.daocloud.io",

"https://hub-mirror.c.163.com",

"https://mirror.baidubce.com",

"https://your_preferred_mirror",

"https://dockerhub.icu",

"https://docker.registry.cyou",

"https://docker-cf.registry.cyou",

"https://dockercf.jsdelivr.fyi",

"https://docker.jsdelivr.fyi",

"https://dockertest.jsdelivr.fyi",

"https://mirror.aliyuncs.com",

"https://dockerproxy.com",

"https://mirror.baidubce.com",

"https://docker.m.daocloud.io",

"https://docker.nju.edu.cn",

"https://docker.mirrors.sjtug.sjtu.edu.cn",

"https://docker.mirrors.ustc.edu.cn",

"https://mirror.iscas.ac.cn",

"https://docker.rainbond.cc"

]

}重新加载配置文件及docker服务:

systemctl daemon-reload重启docker服务:

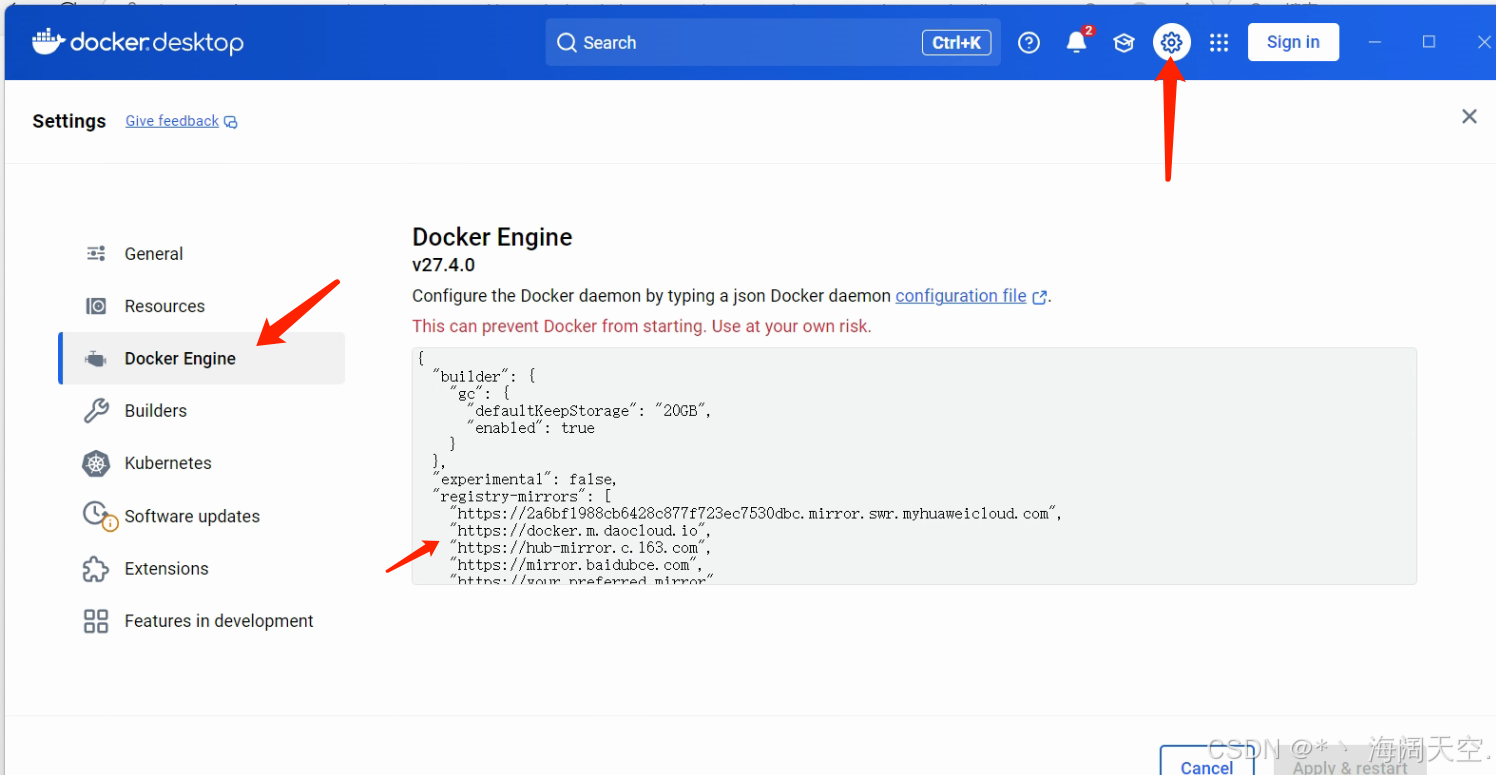

systemctl restart dockerwindows系统设置如下:

配置文件:

{

"registry-mirrors": [

"https://2a6bf1988cb6428c877f723ec7530dbc.mirror.swr.myhuaweicloud.com",

"https://docker.m.daocloud.io",

"https://hub-mirror.c.163.com",

"https://mirror.baidubce.com",

"https://your_preferred_mirror",

"https://dockerhub.icu",

"https://docker.registry.cyou",

"https://docker-cf.registry.cyou",

"https://dockercf.jsdelivr.fyi",

"https://docker.jsdelivr.fyi",

"https://dockertest.jsdelivr.fyi",

"https://mirror.aliyuncs.com",

"https://dockerproxy.com",

"https://mirror.baidubce.com",

"https://docker.m.daocloud.io",

"https://docker.nju.edu.cn",

"https://docker.mirrors.sjtug.sjtu.edu.cn",

"https://docker.mirrors.ustc.edu.cn",

"https://mirror.iscas.ac.cn",

"https://docker.rainbond.cc"

]

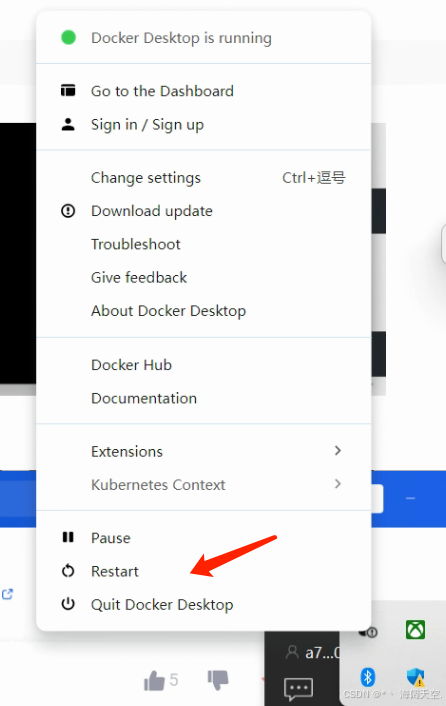

}然后重启docker服务

再次执行:

docker compose up -d

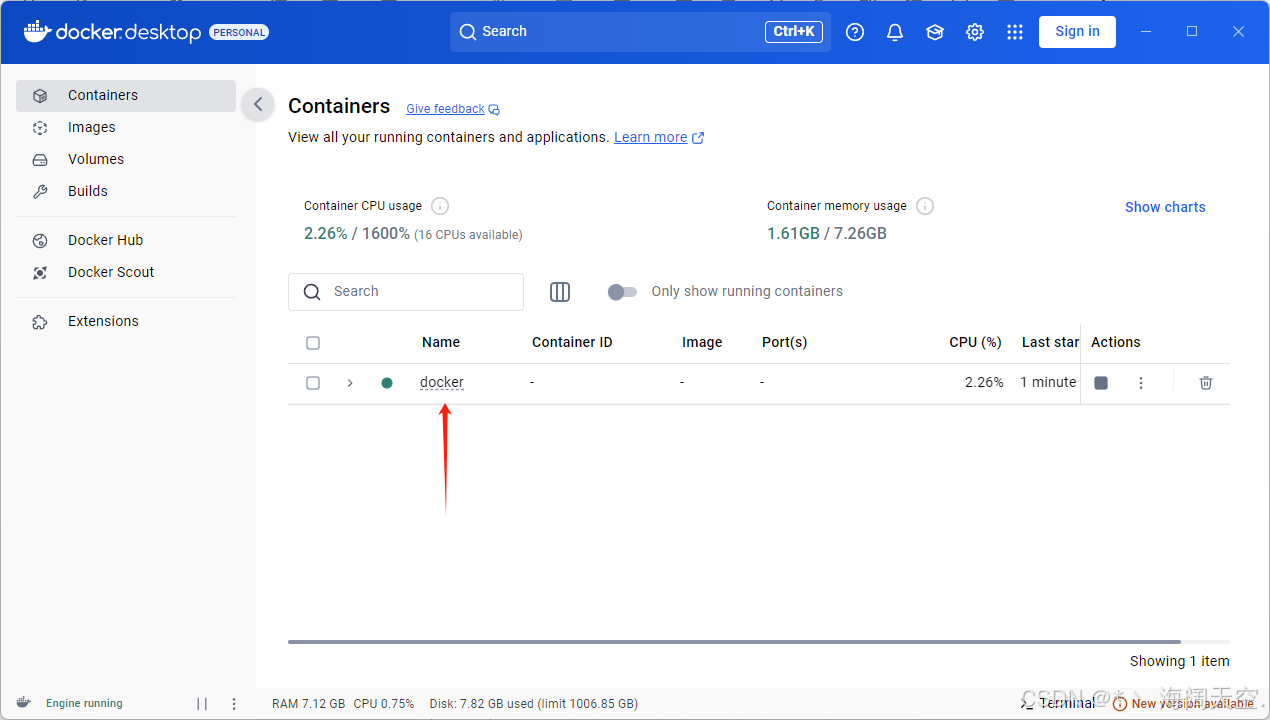

dify 安装完成!会有docker名字的这个容器

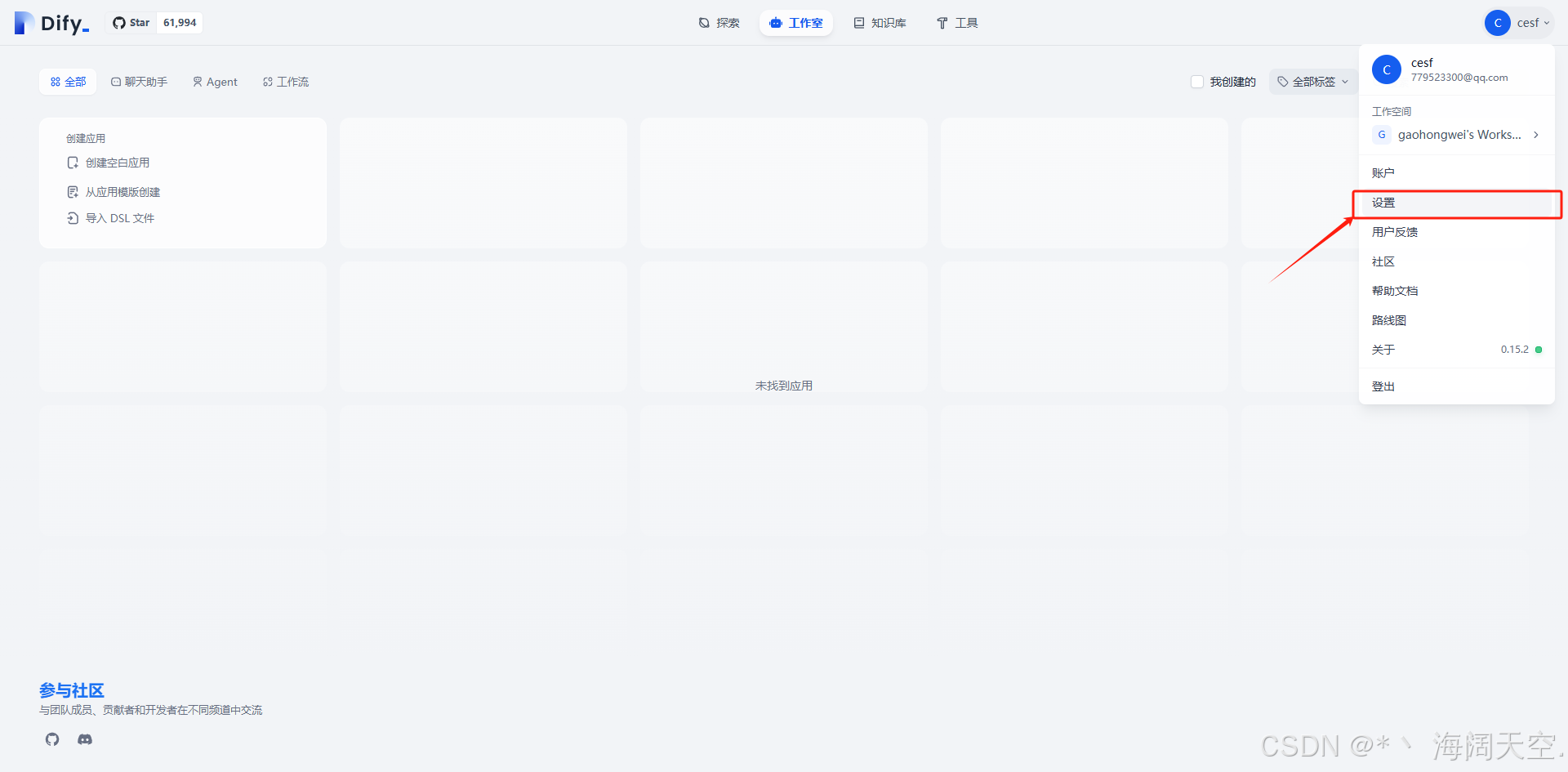

访问 http://localhost/install 设置账号密码 设置好后

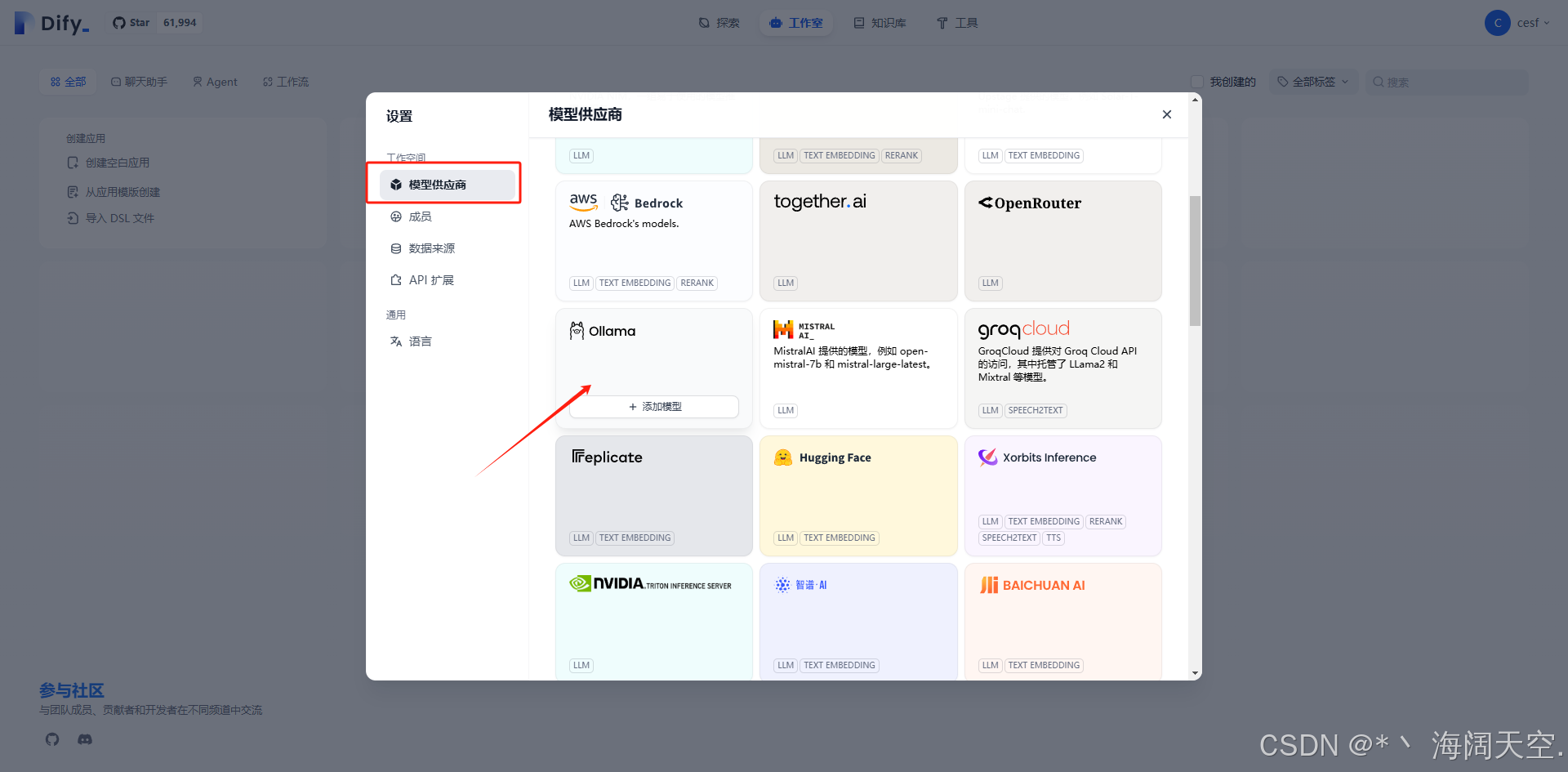

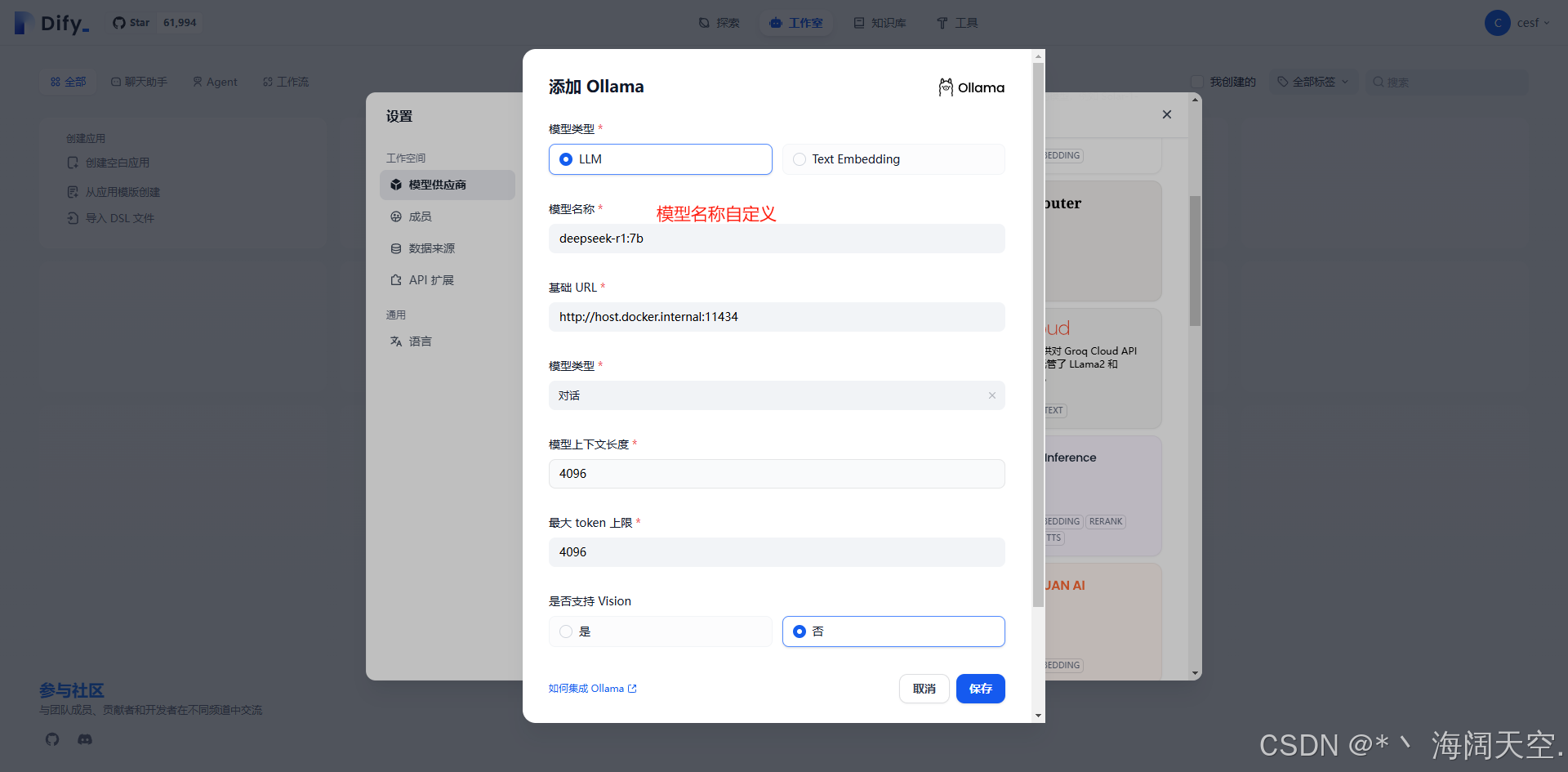

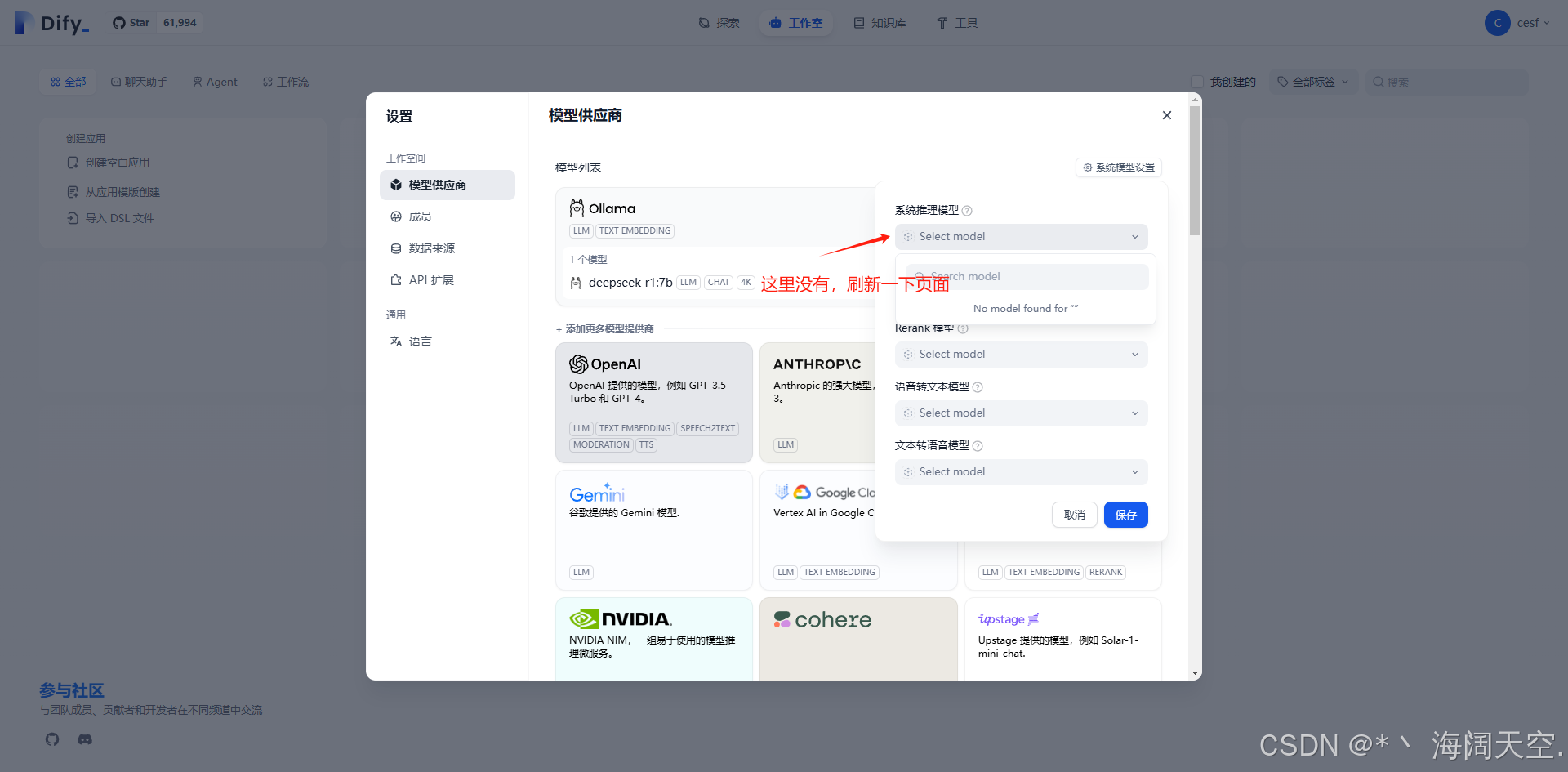

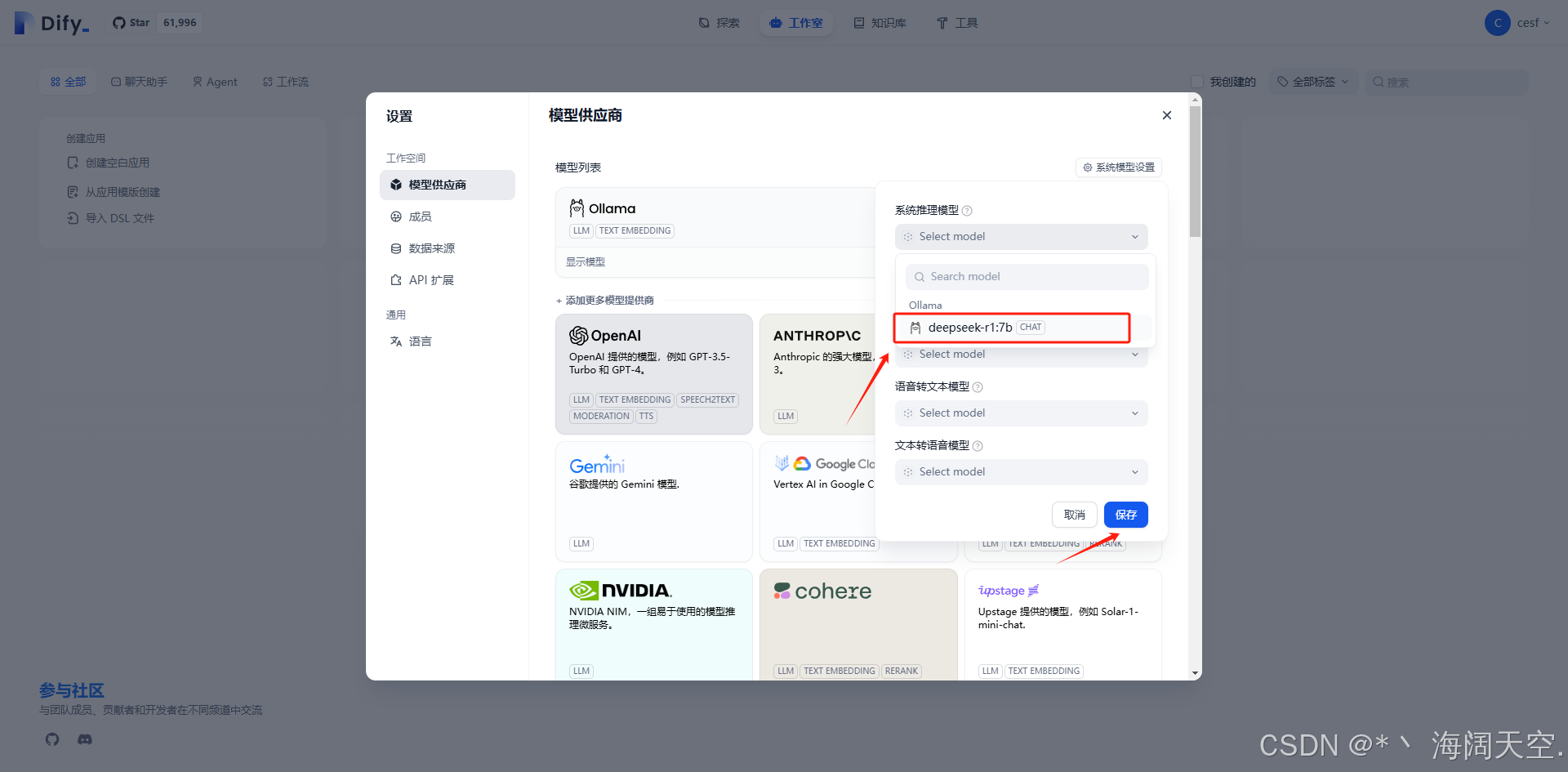

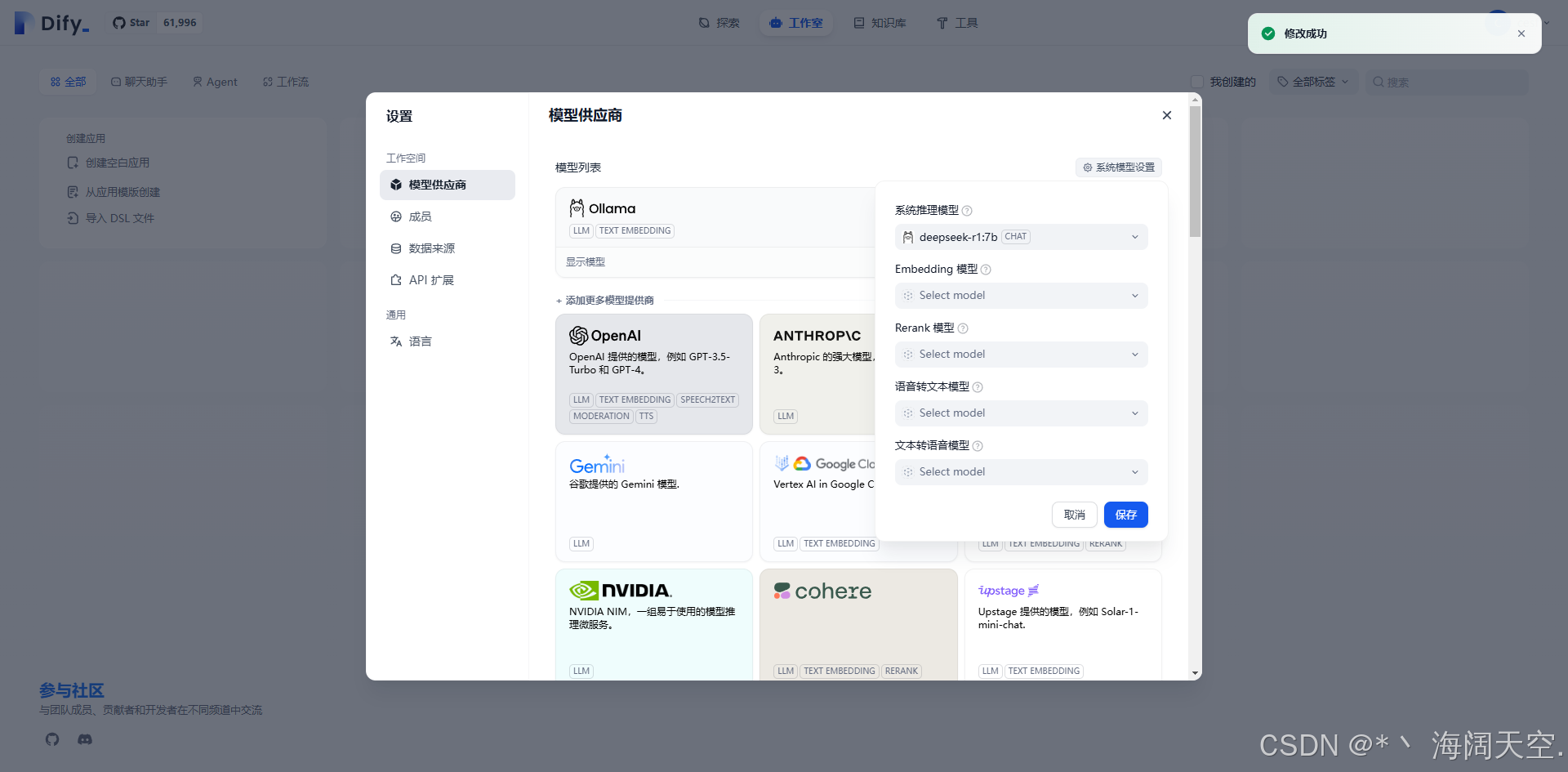

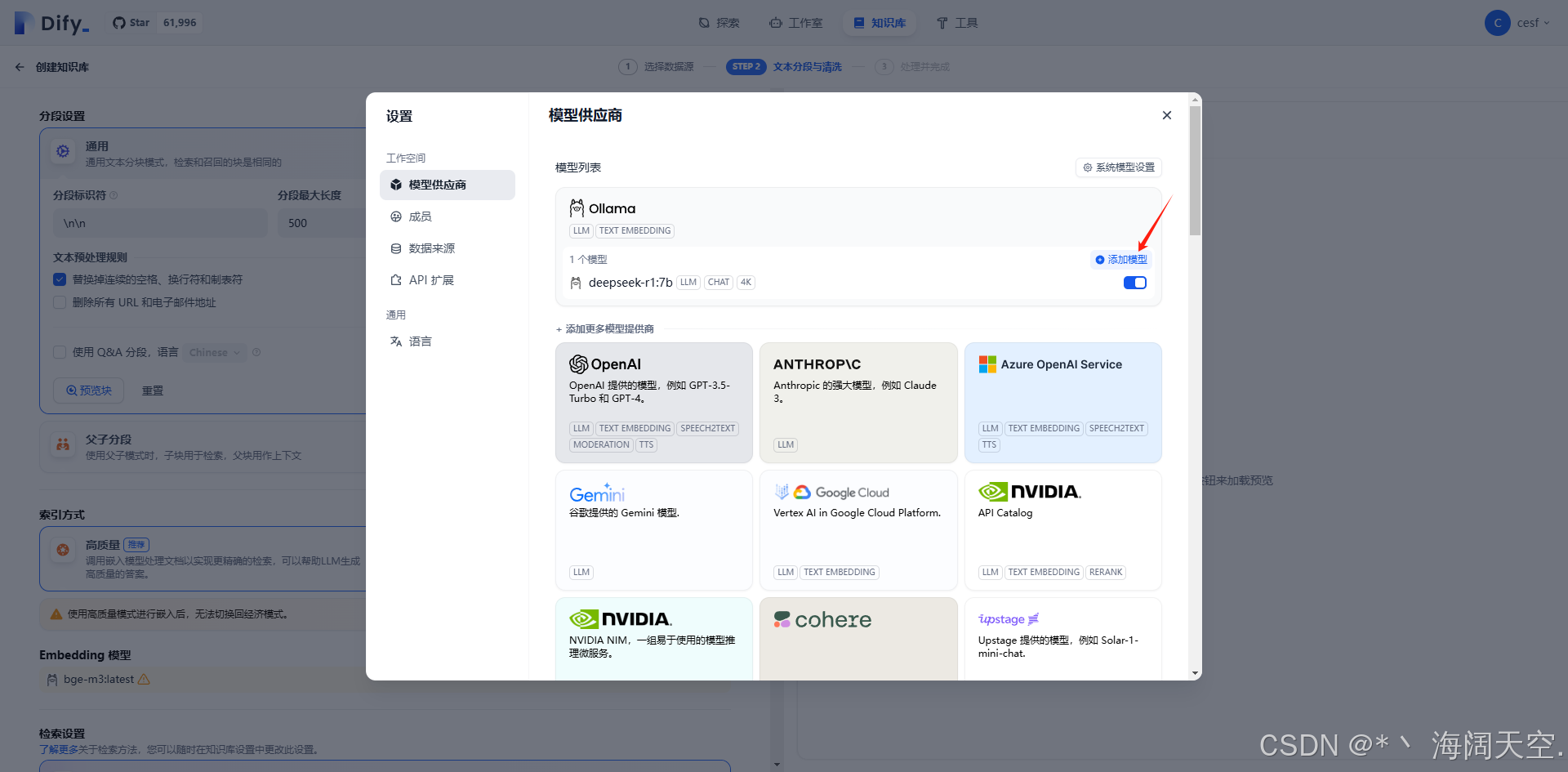

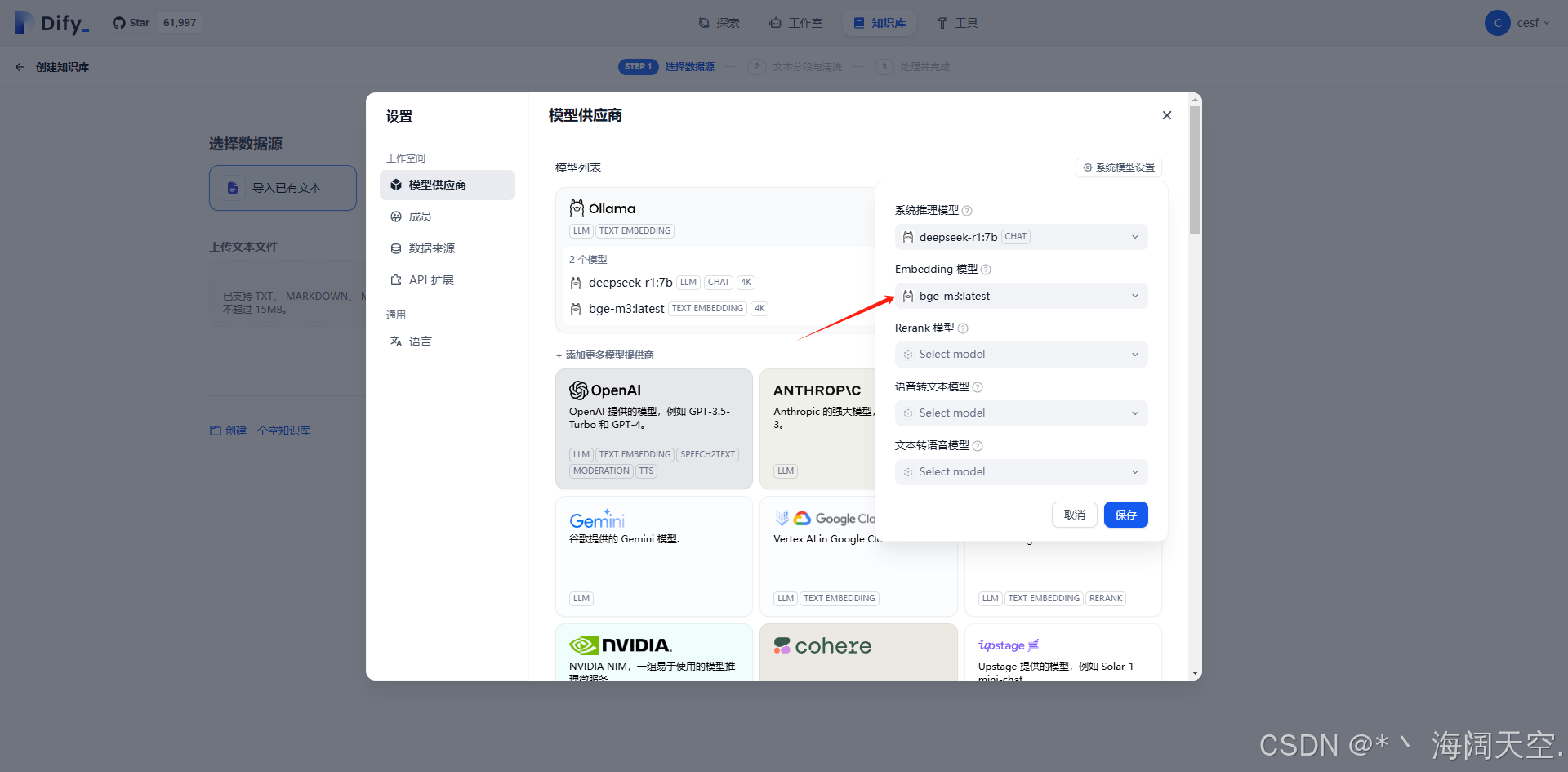

找到模型供应商,添加模型

模型名称自定义可以填写对应的名称 deepseek-r1:7b

url地址填写:

http://host.docker.internal:11434

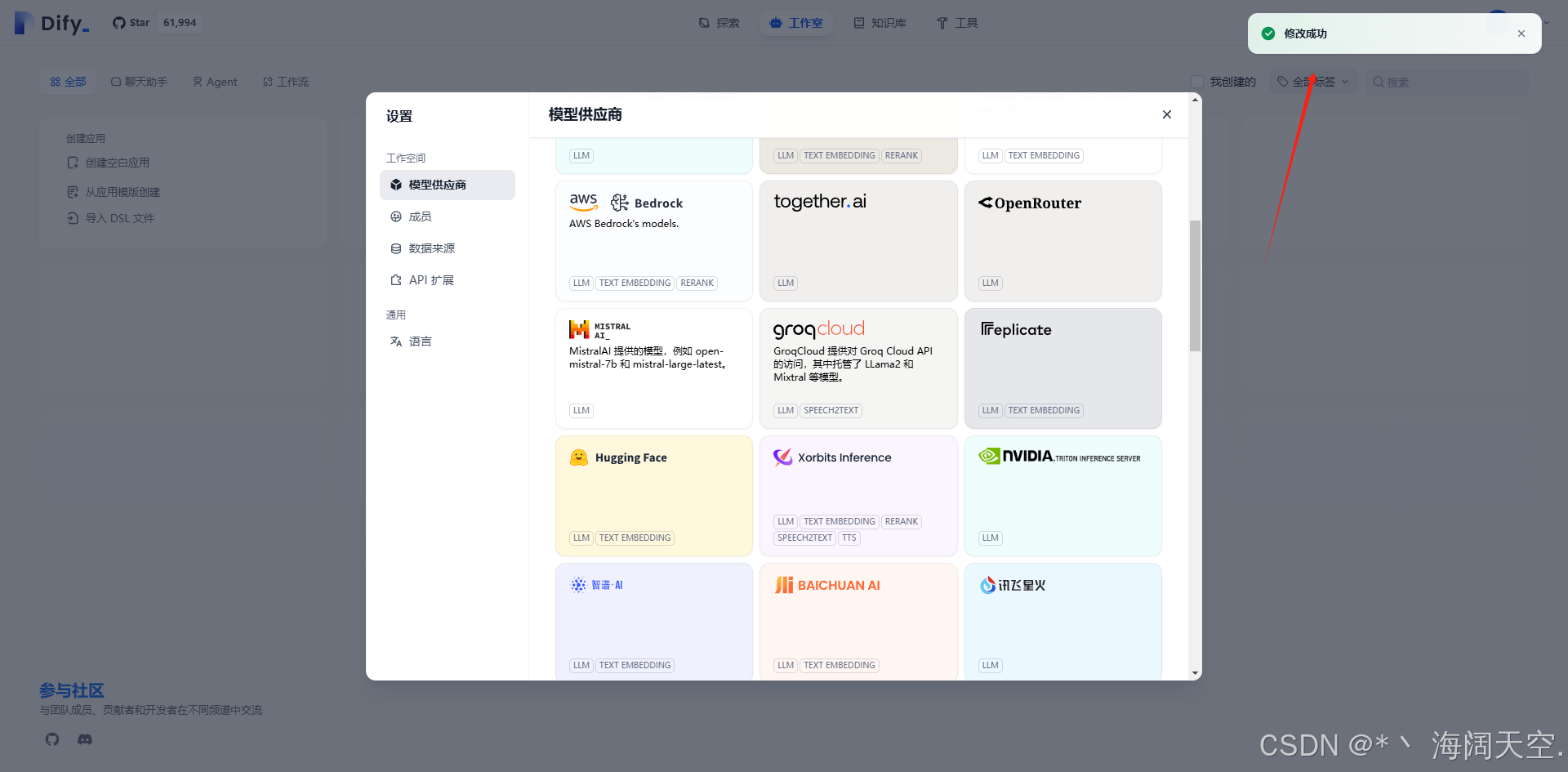

保存

选择保存

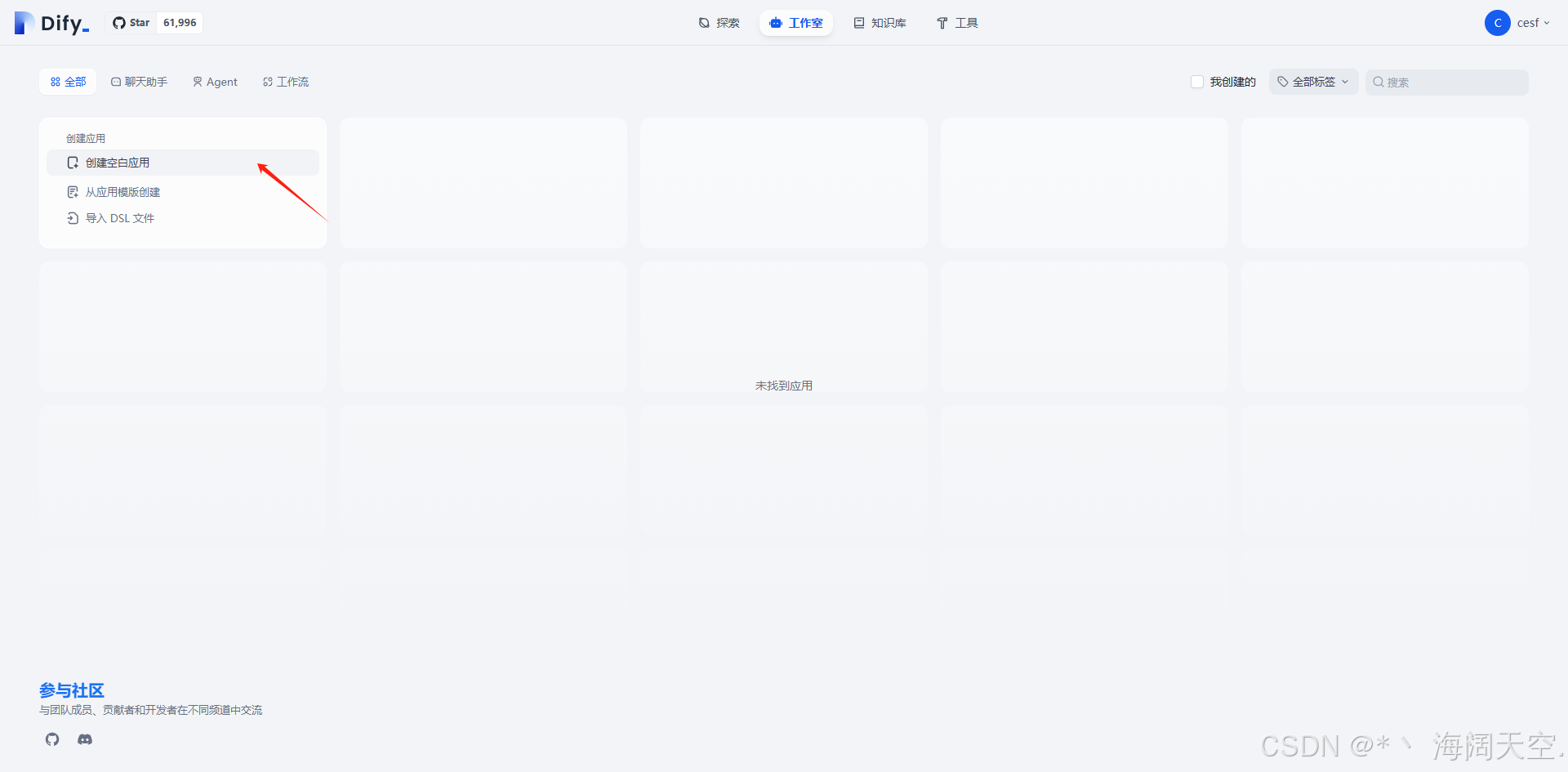

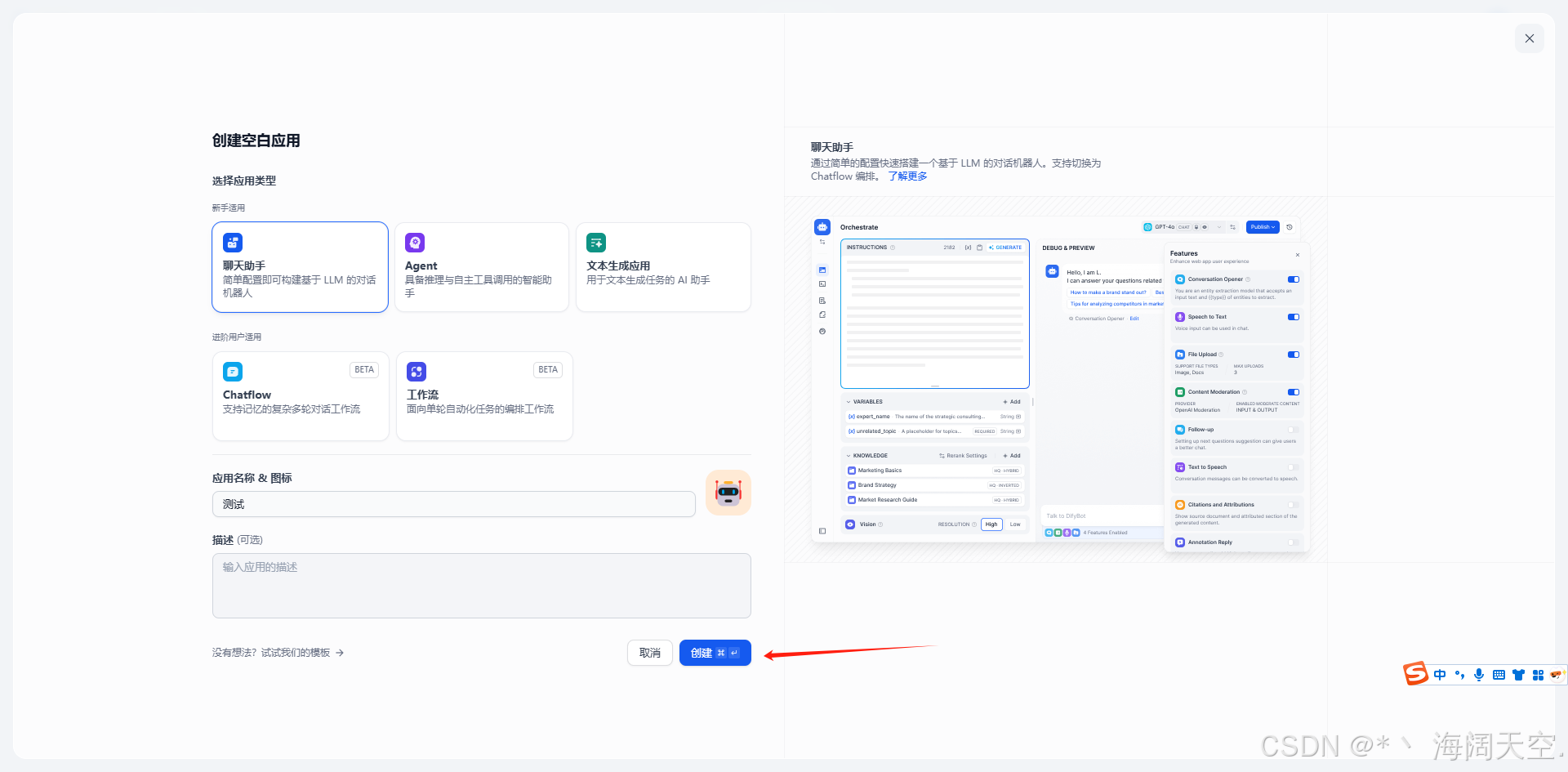

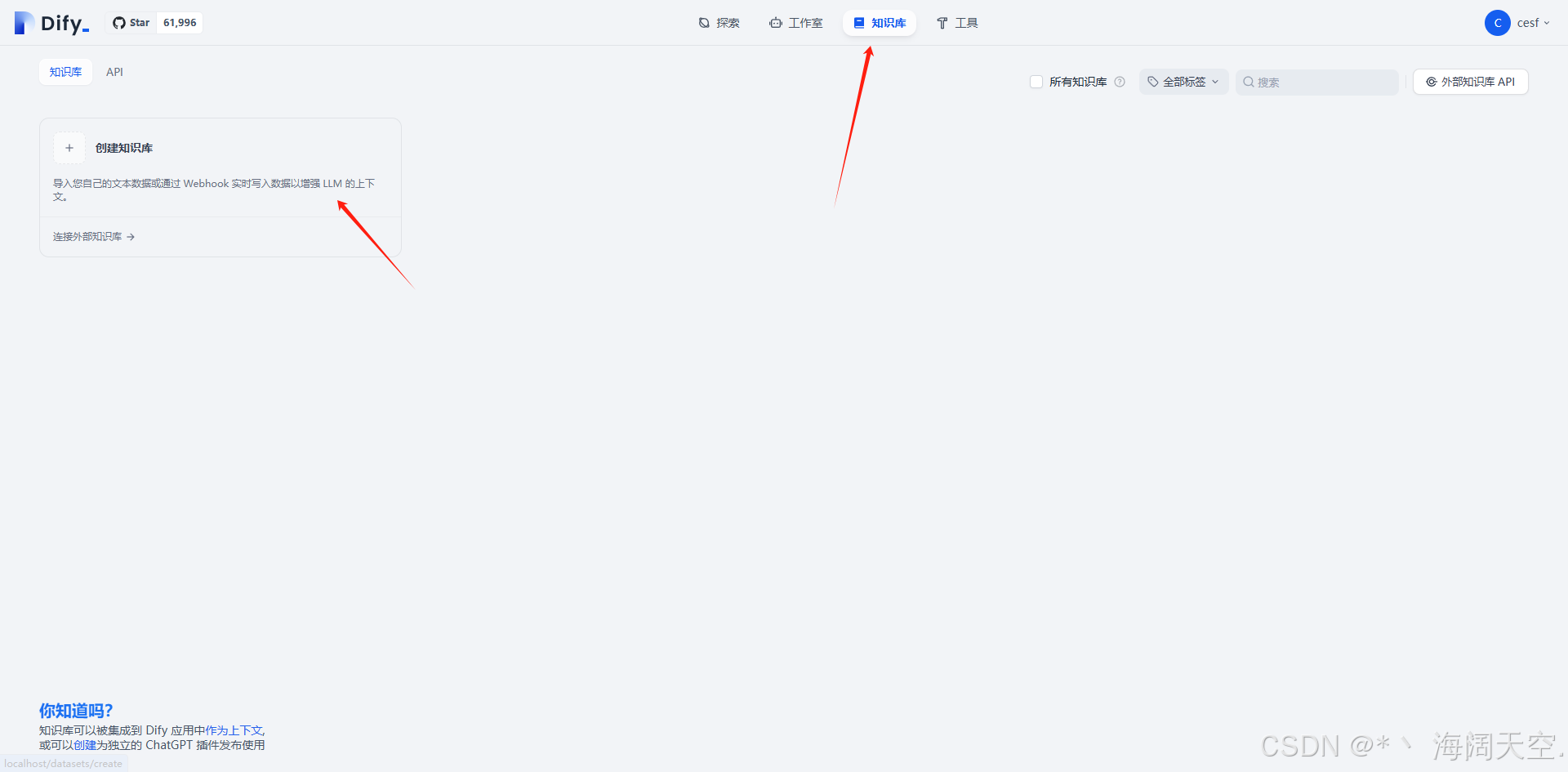

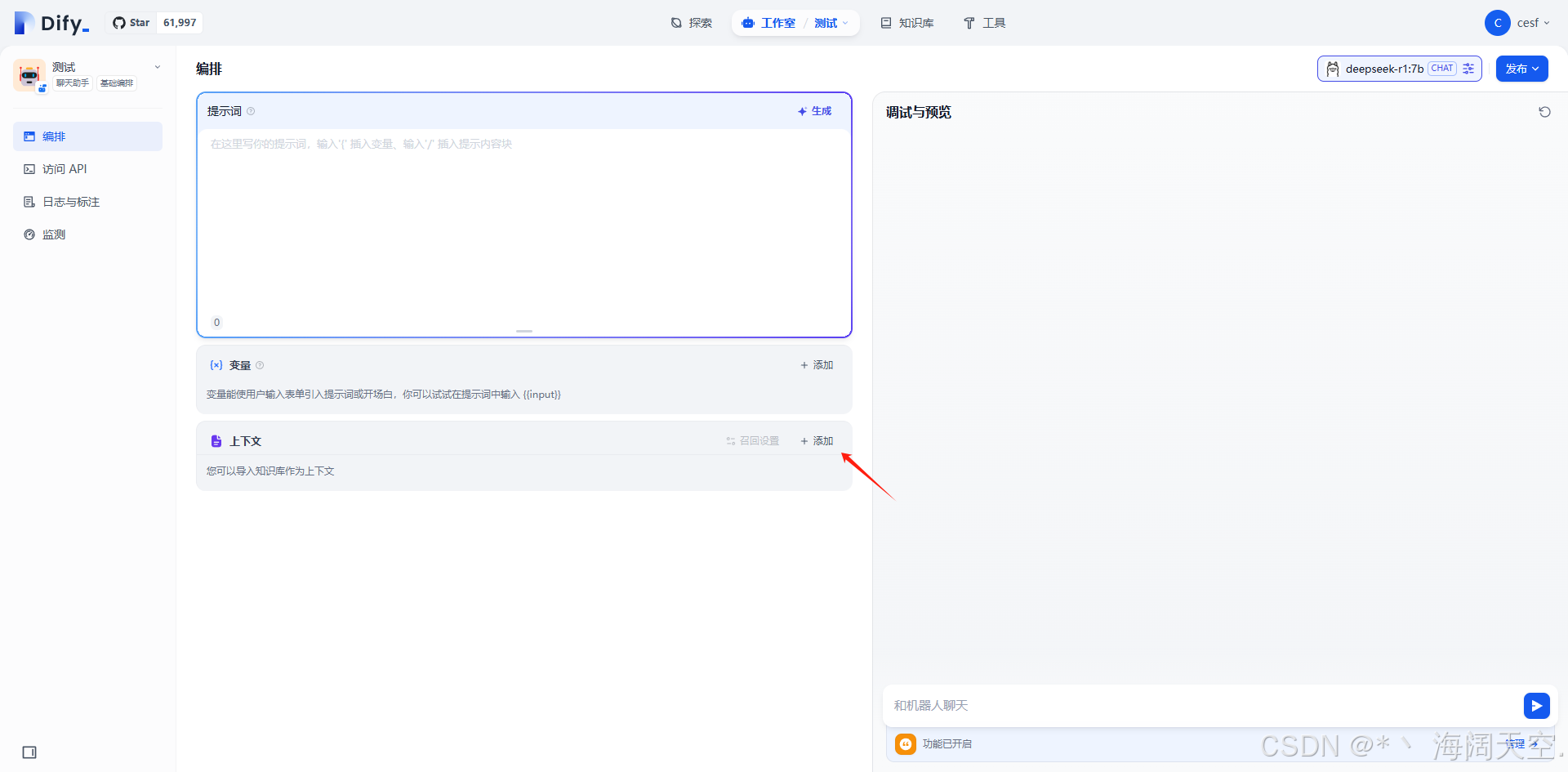

创建应用

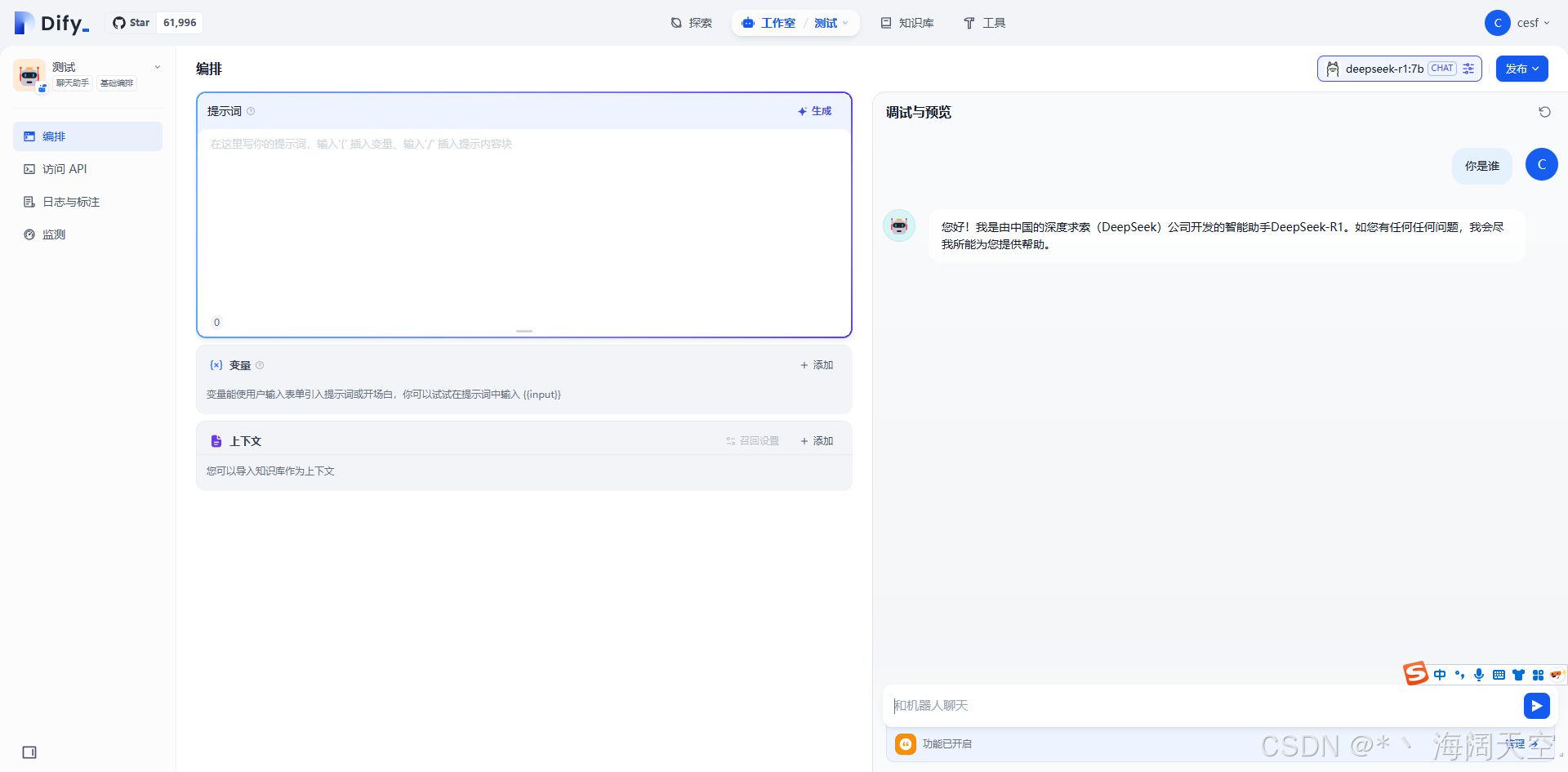

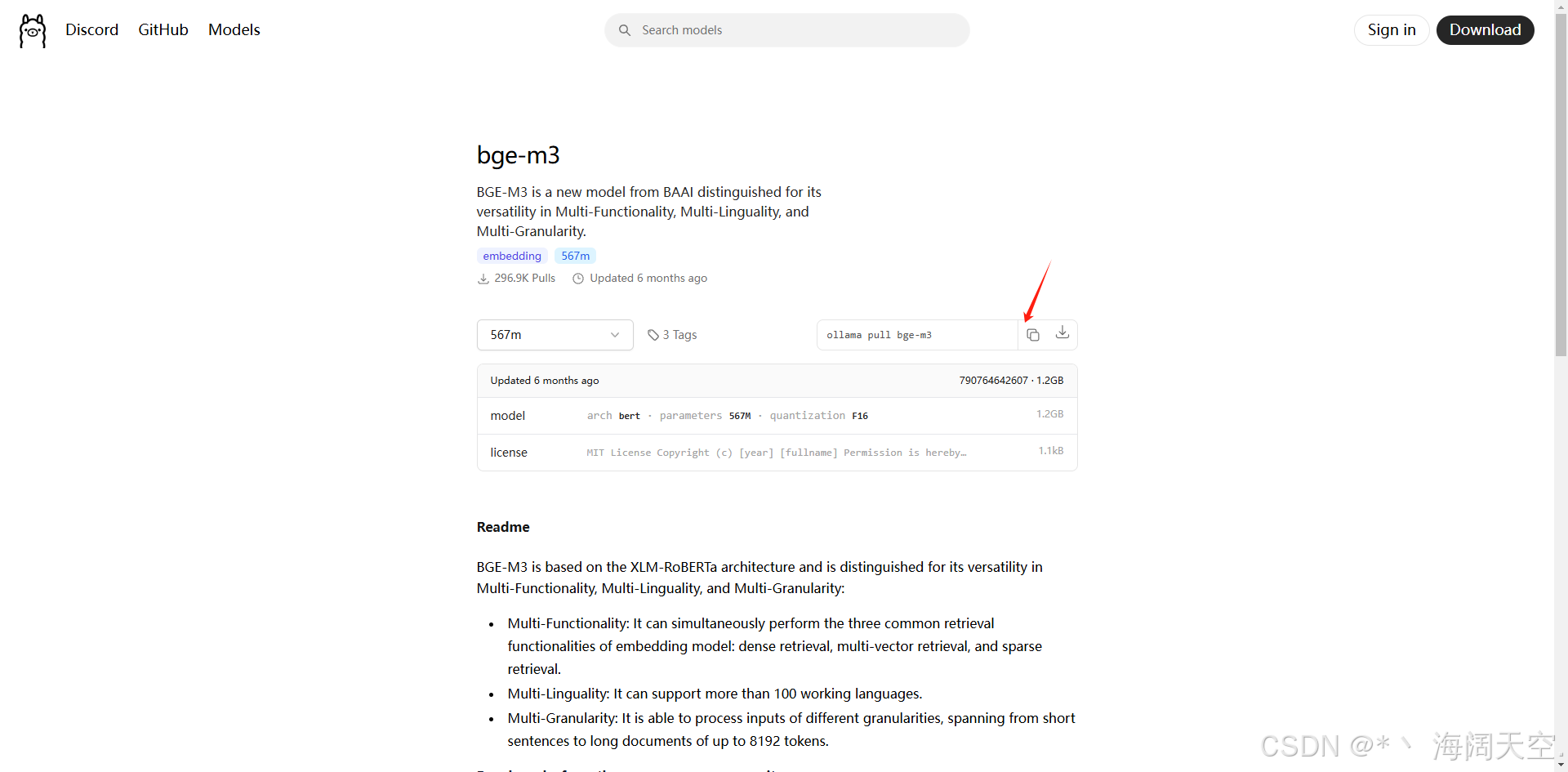

这里就可以访问了,创建本地的知识库,需要用到Embedding 模型,测试bge-m3性能最高

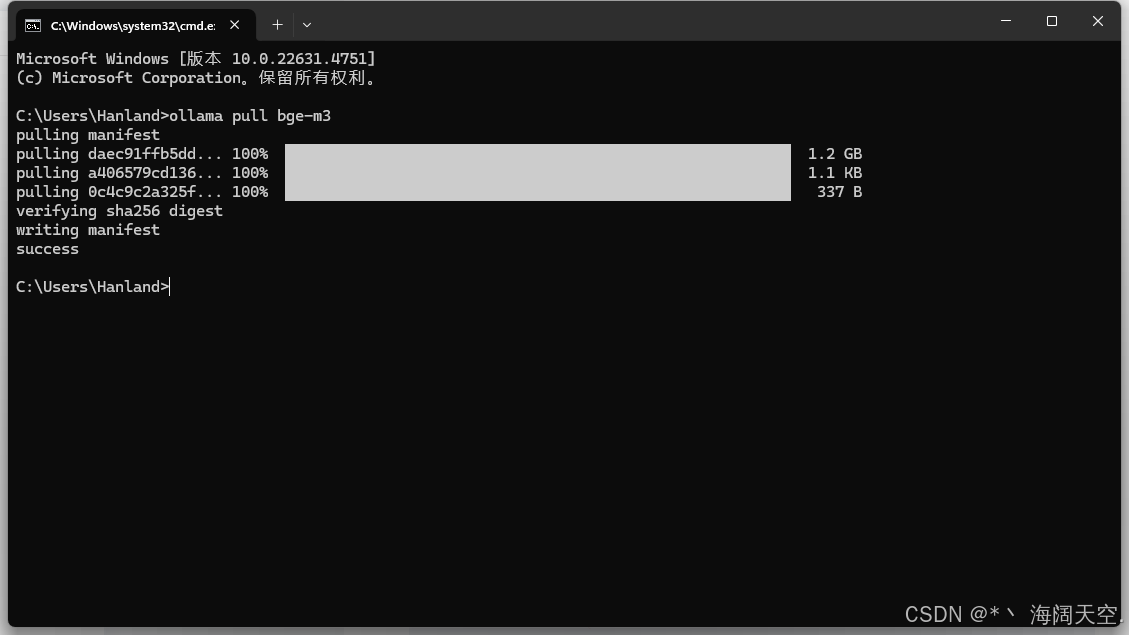

安装bge-m3

ollama pull bge-m3

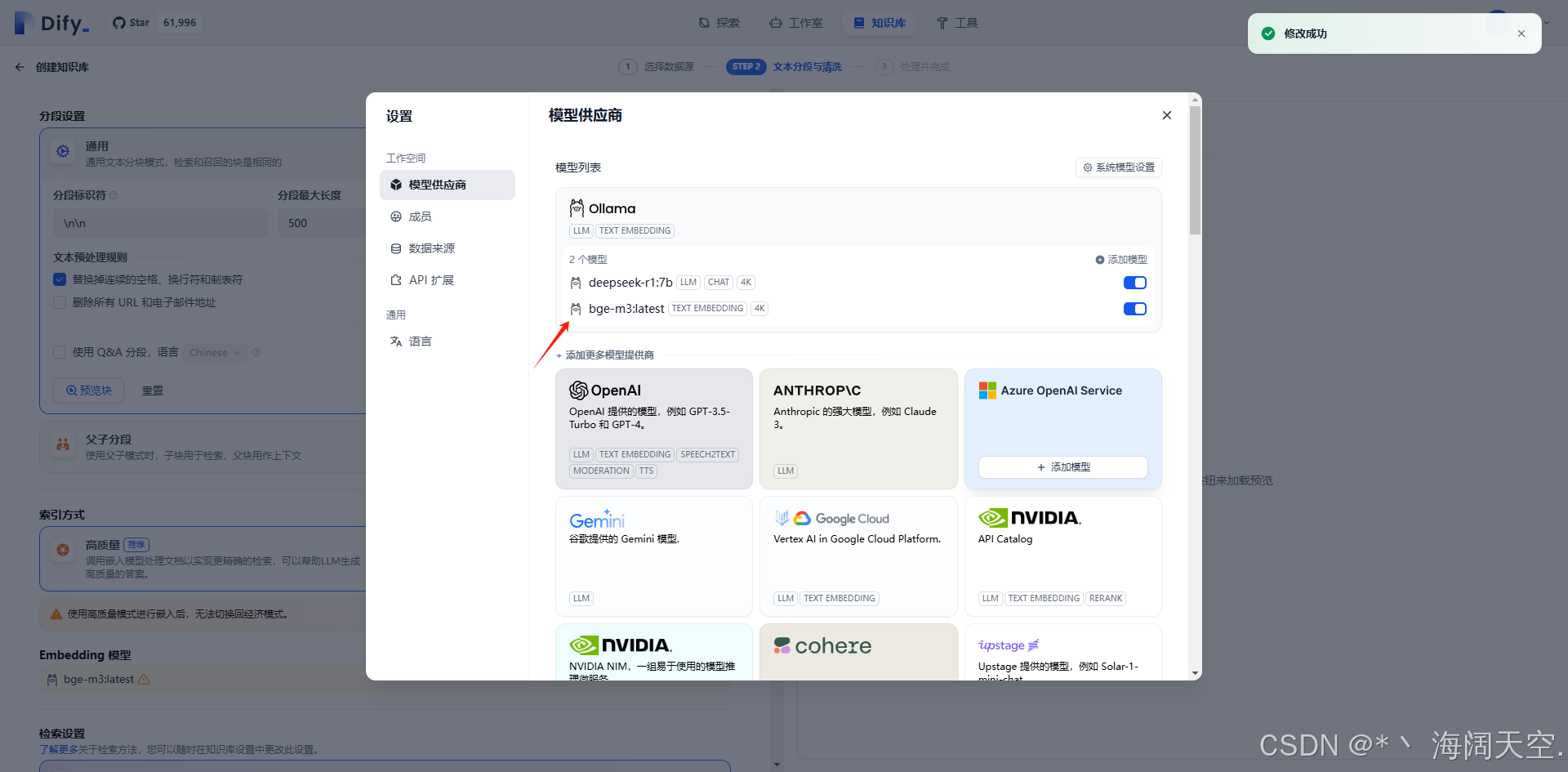

添加模型

名字可以已定义,url还是设置

http://host.docker.internal:11434

设置成功,现在可以创建知识库

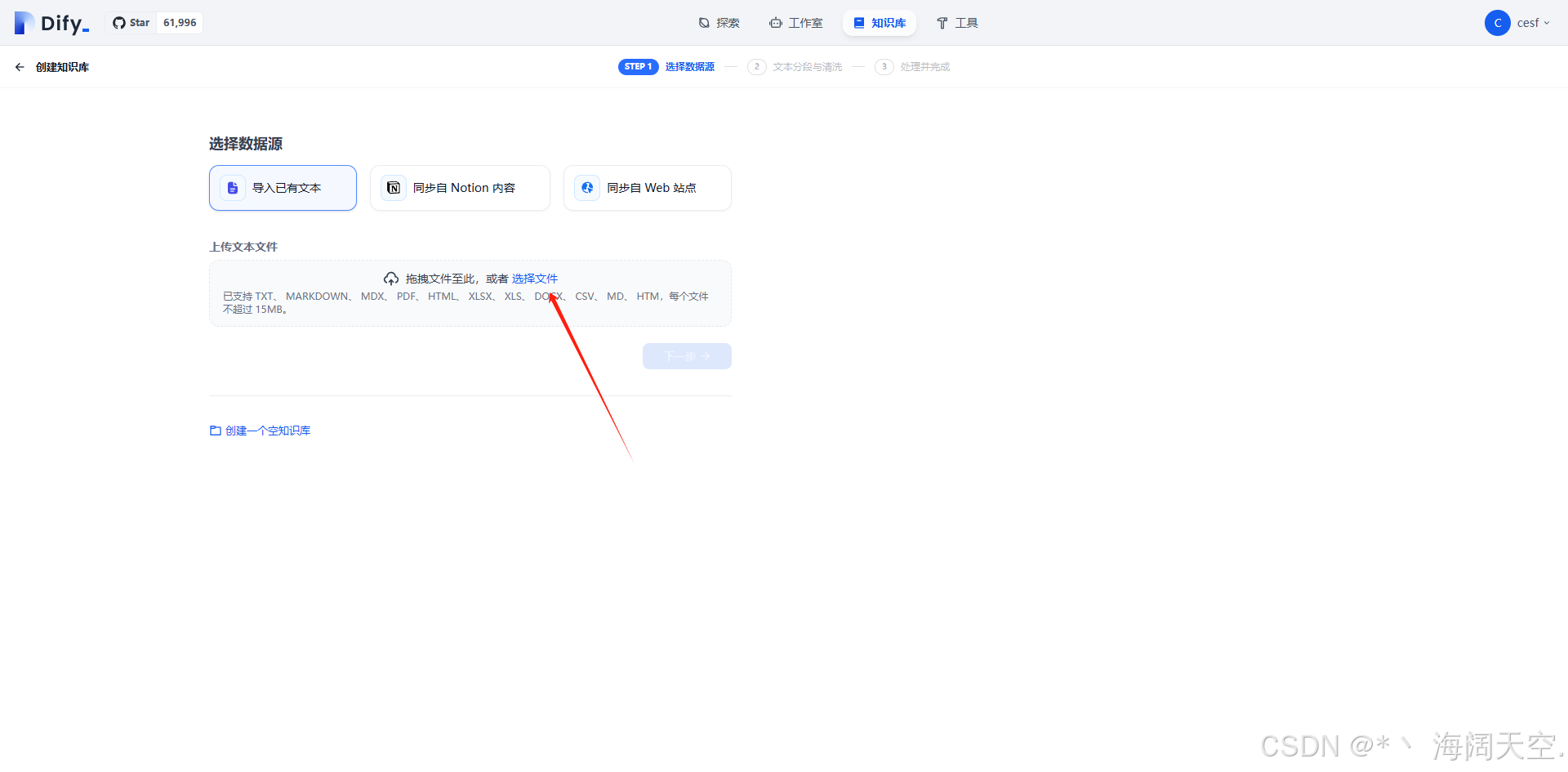

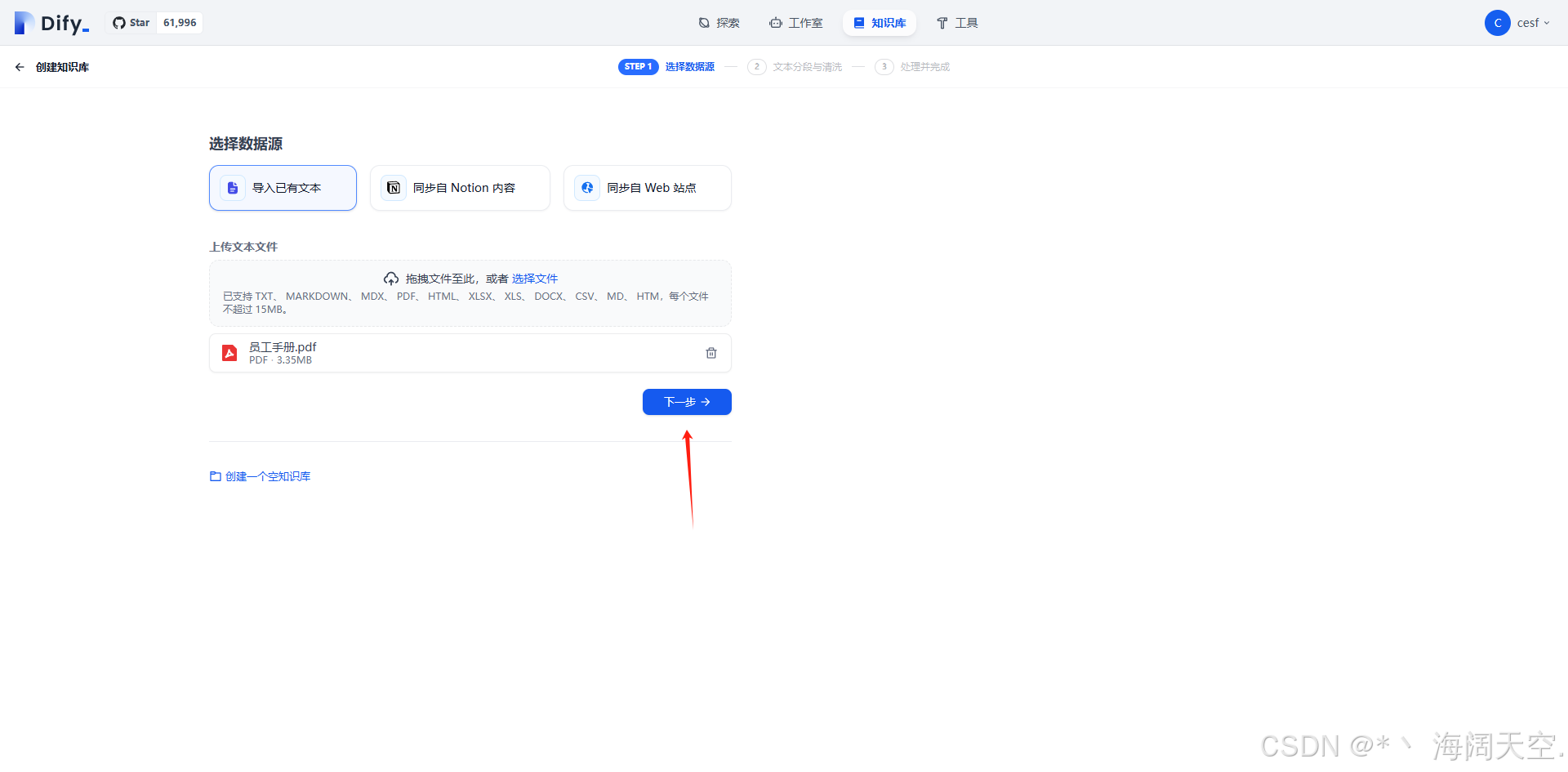

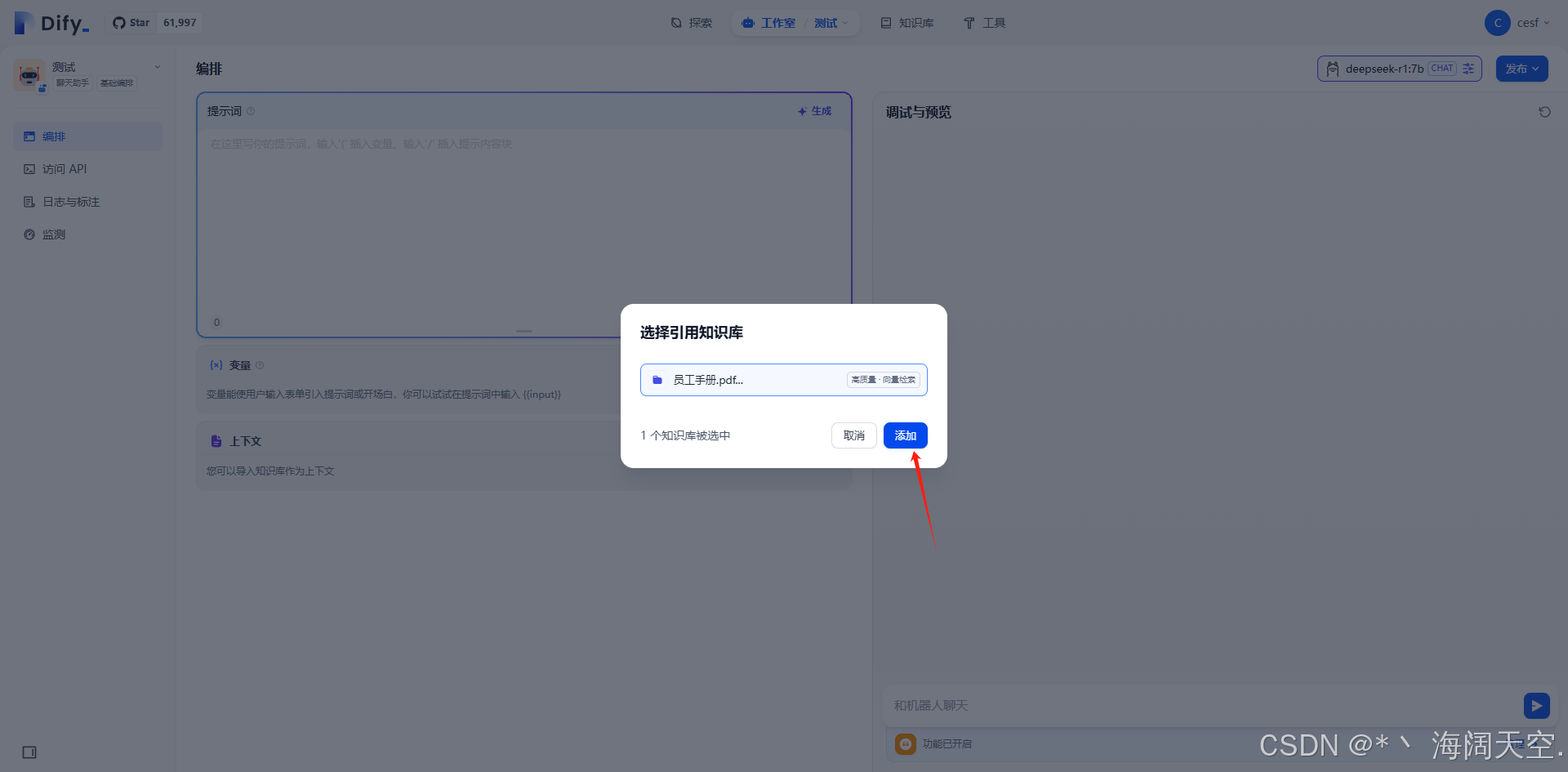

选择上传的知识文件

上传下一步

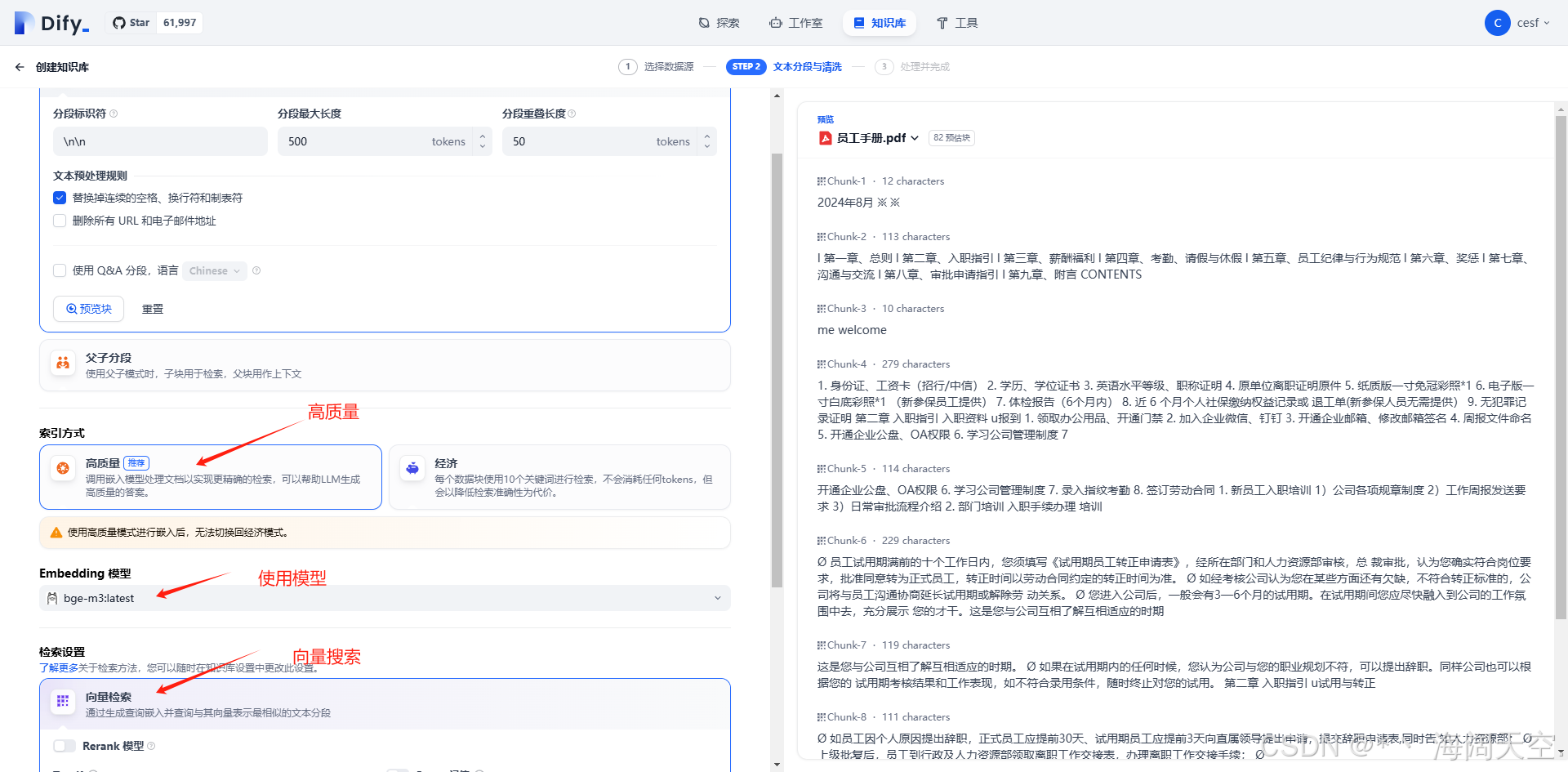

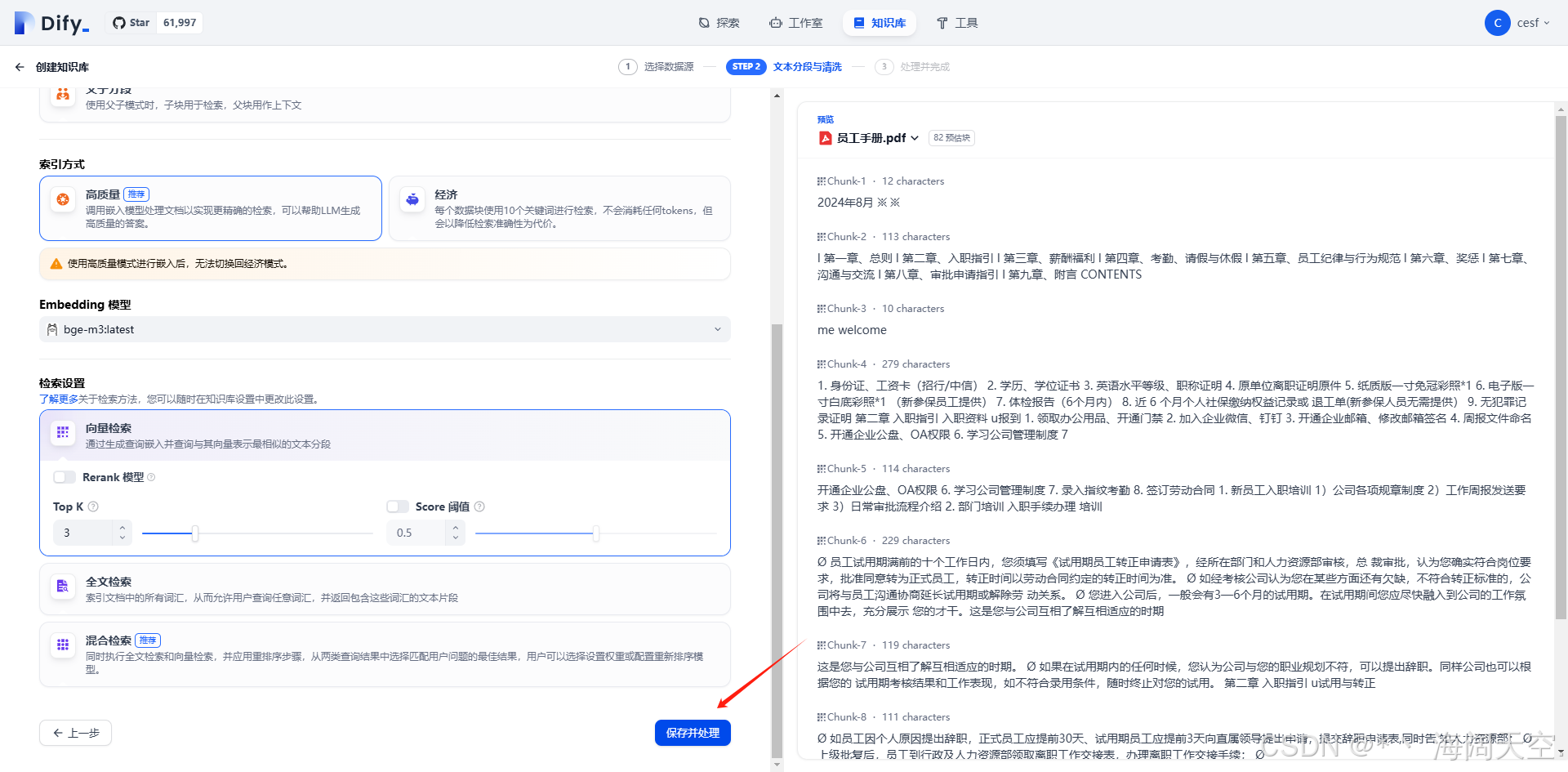

选择高质量,只用引擎,向量搜索

点击保存处理

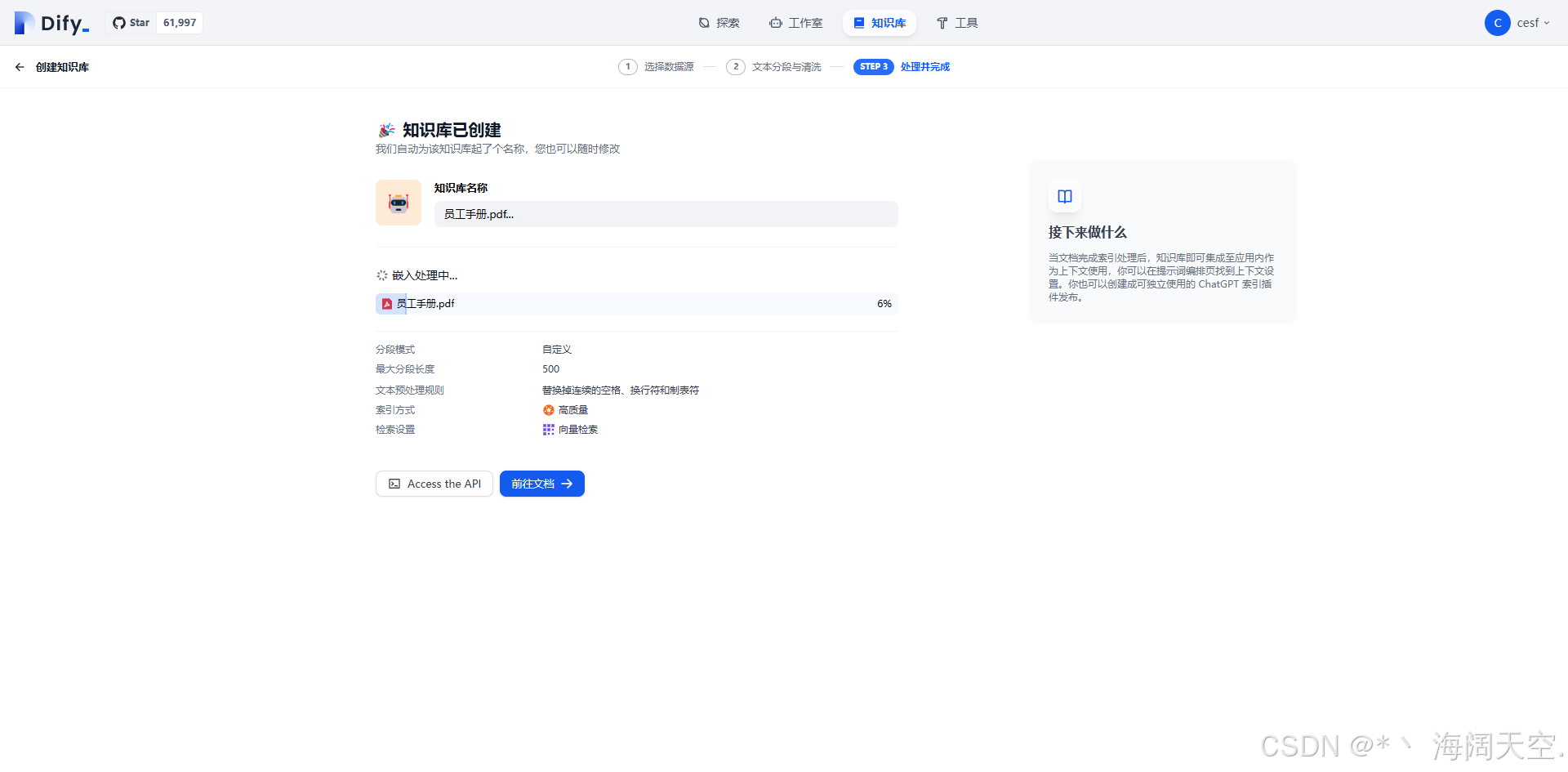

嵌入中

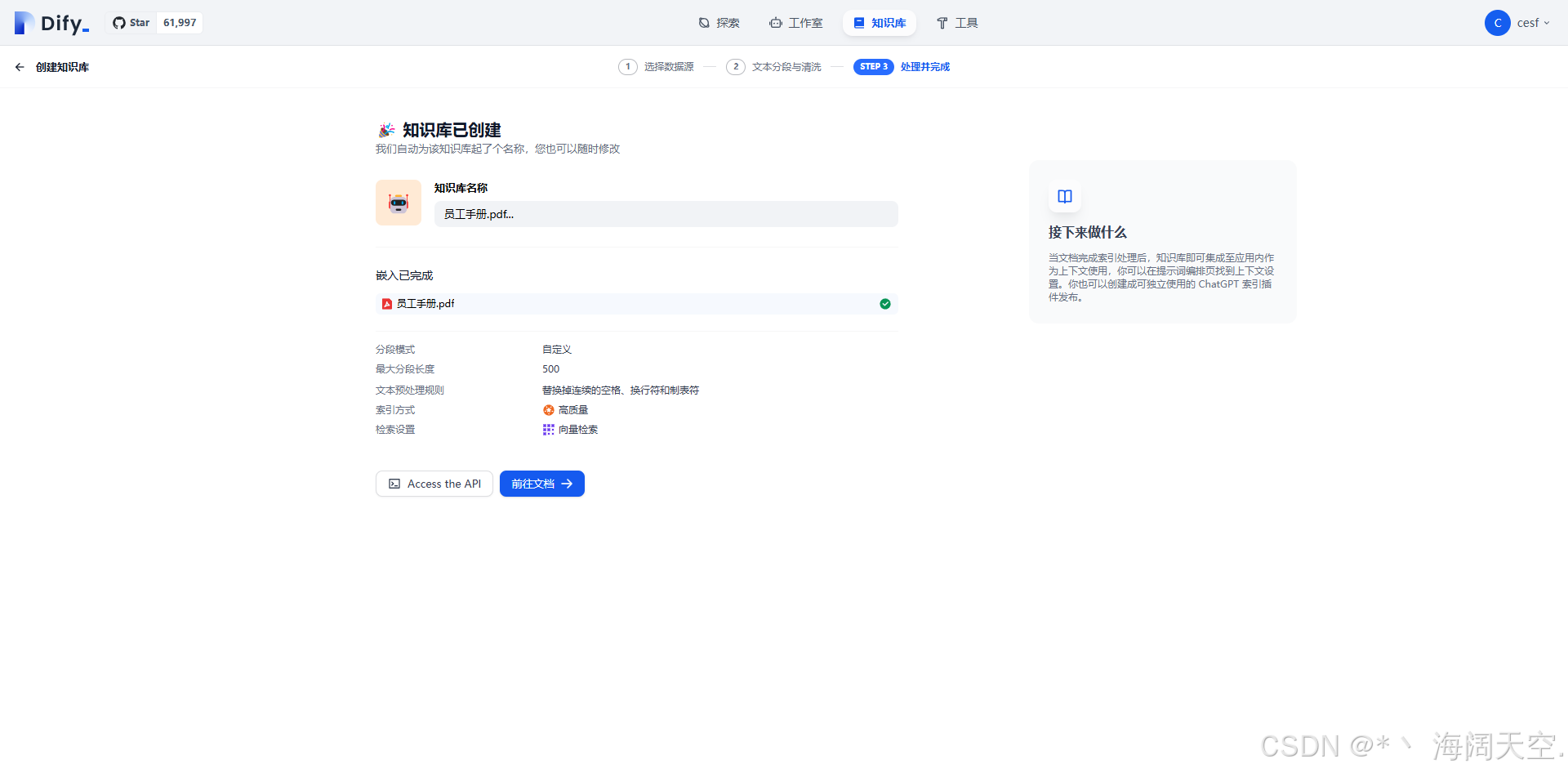

嵌入已完成

添加知识库

选择添加

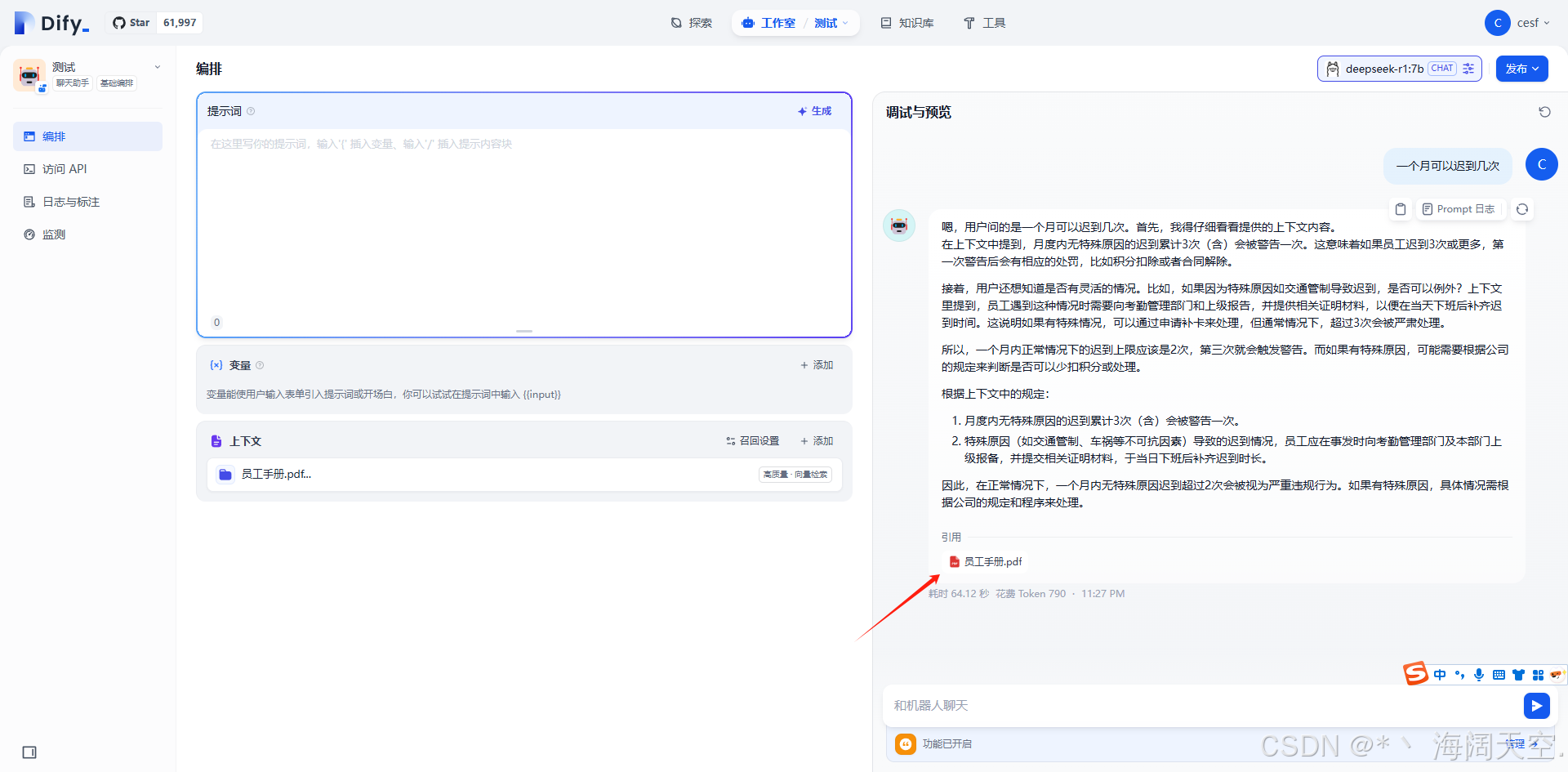

读取的知识库,我的电脑配置没那么高,用7b的响应了1分钟,配置高的可以选择高版本的

6118

6118

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?