- 🍨 本文为🔗365天深度学习训练营 中的学习记录博客

- 🍖 原作者:K同学啊

目录

🍺要求:

- 保存训练过程中的最佳模型权重

- 调用官方的VGG-16网络框架

🍻拔高(可选):

- 测试集准确率达到60%(难度有点大,但是这个过程可以学到不少)

- 手动搭建VGG-16网络框架

一、创建环境

● 语言环境:Python3.8

● 编译平台:colab

● 深度学习环境:Pytorch

○ torch1.12.1+cu113

○ torchvision0.13.1+cu113

● 数据:🔗百度网盘

二、前期准备

2.1 设置GPU

import torch

import torch.nn as nn

import torchvision.transforms as transforms

import torchvision

from torchvision import transforms, datasets

import os,PIL,pathlib,warnings

warnings.filterwarnings("ignore") #忽略警告信息

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

device

输出结果:

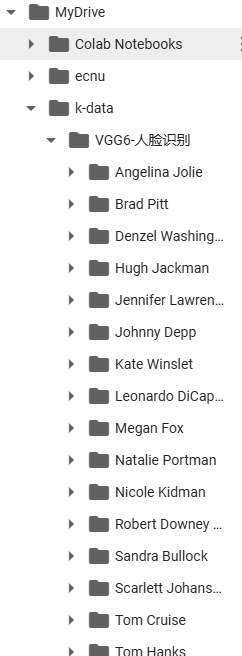

2.2 导入数据

数据存放的目录结构:

# 导入数据

import os,PIL,random,pathlib

data_dir = '/content/drive/MyDrive/k-data/VGG6-人脸识别'

data_dir = pathlib.Path(data_dir)

data_paths = list(data_dir.glob('*'))

classeNames = [str(path).split("\\")[-1] for path in data_paths]

classeNames

输出结果:

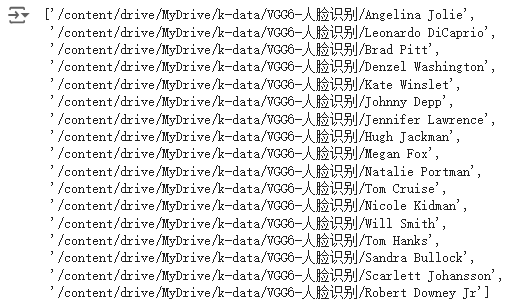

2.3 处理图像信息

代码详解

👉 transforms.Compose(…)

torchvision.transforms.Compose()类的主要作用是串联多个图片变换的操作。

👉 datasets.ImageFolder(datadir, transform)

datasets.ImageFolder类用于创建一个数据集。ImageFolder假设所有的图像都存储在一个文件夹中,并且每个子文件夹代表一个类别。这个类会自动读取文件夹结构,并将每个子文件夹的名称作为类别标签。transform参数指定了在加载数据时要应用于每个图像的转换操作,即transforms.Compose(…)定义的内容。

# 图片变换

train_transforms = transforms.Compose([

transforms.Resize([224, 224]), # 将输入图片resize成统一尺寸

# transforms.RandomHorizontalFlip(), # 随机水平翻转

transforms.ToTensor(), # 将PIL Image或numpy.ndarray转换为tensor,并归一化到[0,1]之间

transforms.Normalize( # 标准化处理-->转换为标准正太分布(高斯分布),使模型更容易收敛

mean=[0.485, 0.456, 0.406],

std=[0.229, 0.224, 0.225]) # 其中 mean=[0.485,0.456,0.406]与std=[0.229,0.224,0.225] 从数据集中随机抽样计算得到的。

])

total_data = datasets.ImageFolder("/content/drive/MyDrive/k-data/VGG6-人脸识别",transform=train_transforms)

total_data

输出:

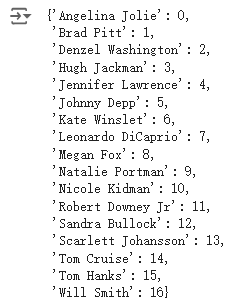

代码详解–对train文件夹下面的数据类别打标签

👉 train_dataset.class_to_idx

当使用torchvision.datasets.ImageFolder类来创建一个图像数据集时,该类会自动推断每个子文件夹的名称作为类别标签,并会给每个类别分配一个唯一的整数索引。这个索引是从0开始的,根据子文件夹的顺序递增。

train_dataset.class_to_idx是一个字典,它将类别名称映射到这些整数索引。键是类别名称(通常是子文件夹的名称),值是对应的整数索引。这个映射对于将类别标签转换为模型训练时需要的数字索引非常重要。

# 分类映射

total_data.class_to_idx

输出结果:

# 划分数据集

train_size = int(0.8 * len(total_data))

test_size = len(total_data) - train_size

train_dataset, test_dataset = torch.utils.data.random_split(total_data, [train_size, test_size])

train_dataset, test_dataset

输出结果:

2.4 加载数据集

代码详解

👉torch.utils.data.DataLoader

DataLoader将Dataset对象或自定义数据类的对象封装成一个迭代器,这个迭代器可以迭代输出Dataset的内容,同时可以实现多进程、shuffle、不同采样策略,数据校对等等处理过程。

主要参数:

- dataset:这个就是pytorch已有的数据读取接口(比如torchvision.datasets.ImageFolder)或者自定义的数据接口的输出,该输出要么是torch.utils.data.Dataset类的对象,要么是继承自torch.utils.data.Dataset类的自定义类的对象。

- batch_size:根据具体情况设置即可。

- shuffle:随机打乱顺序,一般在训练数据中会采用。

- collate_fn:是用来处理不同情况下的输入dataset的封装,一般采用默认即可,除非你自定义的数据读取输出非常少见。

- batch_sampler:从注释可以看出,其和batch_size、shuffle等参数是互斥的,一般采用默认。

- sampler:从代码可以看出,其和shuffle是互斥的,一般默认即可。

- num_workers:从注释可以看出这个参数必须大于等于0,0的话表示数据导入在主进程中进行,其他大于0的数表示通过多个进程来导入数据,可以加快数据导入速度

batch_size = 32

train_dl = torch.utils.data.DataLoader(train_dataset,

batch_size=batch_size,

shuffle=True,

num_workers=1)

test_dl = torch.utils.data.DataLoader(test_dataset,

batch_size=batch_size,

shuffle=True,

num_workers=1)

三、调用官方的VGG-16模型

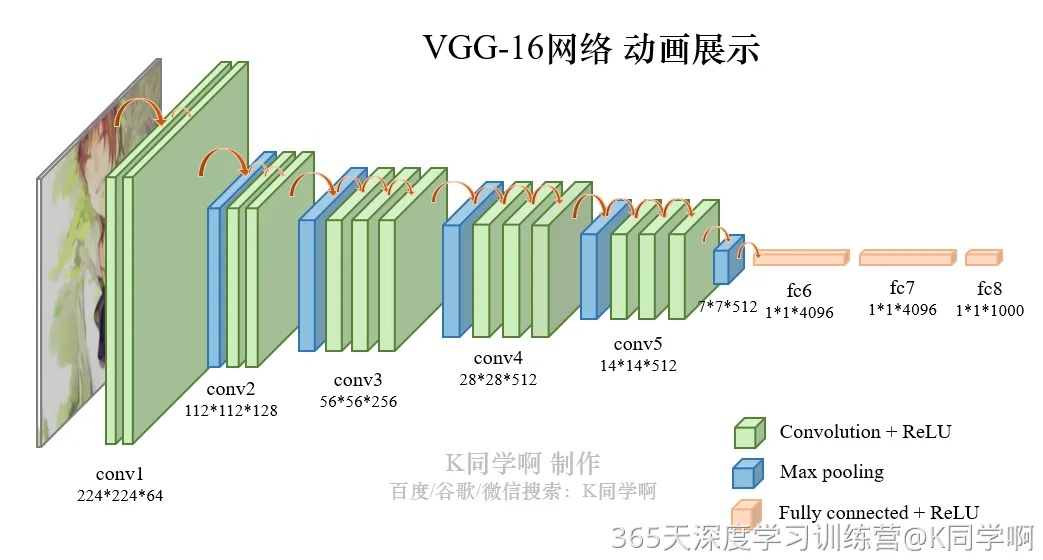

VGG-16(Visual Geometry Group-16)是由牛津大学视觉几何组(Visual Geometry Group)提出的一种深度卷积神经网络架构,用于图像分类和对象识别任务。VGG-16在2014年被提出,是VGG系列中的一种。VGG-16之所以备受关注,是因为它在ImageNet图像识别竞赛中取得了很好的成绩,展示了其在大规模图像识别任务中的有效性。

以下是VGG-16的主要特点:

- 深度:VGG-16由16个卷积层和3个全连接层组成,因此具有相对较深的网络结构。这种深度有助于网络学习到更加抽象和复杂的特征。

- 卷积层的设计:VGG-16的卷积层全部采用3x3的卷积核和步长为1的卷积操作,同时在卷积层之后都接有ReLU激活函数。这种设计的好处在于,通过堆叠多个较小的卷积核,可以提高网络的非线性建模能力,同时减少了参数数量,从而降低了过拟合的风险。

- 池化层:在卷积层之后,VGG-16使用最大池化层来减少特征图的空间尺寸,帮助提取更加显著的特征并减少计算量。

- 全连接层:VGG-16在卷积层之后接有3个全连接层,最后一个全连接层输出与类别数相对应的向量,用于进行分类。

VGG-16结构说明:

● 13个卷积层(Convolutional Layer),分别用blockX_convX表示;

● 3个全连接层(Fully connected Layer),用classifier表示;

● 5个池化层(Pool layer)。

VGG-16包含了16个隐藏层(13个卷积层和3个全连接层),故称为VGG-16。

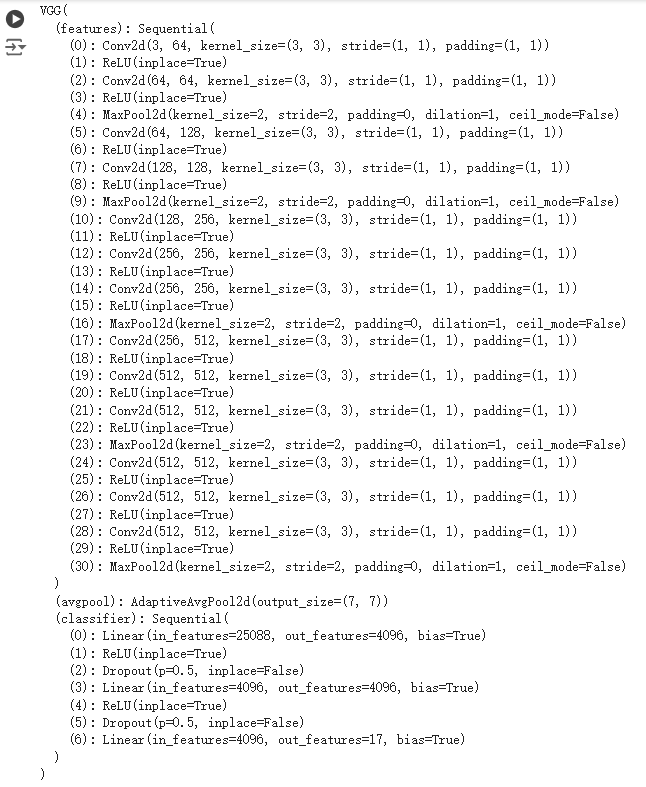

# 调用官方VGG模型

# torchvision是PyTorch的一个图形库,它包含了流行的模型架构、数据集和图像转换器。

from torchvision.models import vgg16

device = "cuda" if torch.cuda.is_available() else "cpu"

print("Using {} device".format(device))

# 加载预训练的VGG-16模型,并将模型移动到GPU上。pretrained=True表示加载在ImageNet数据集上预训练的权重。

model = vgg16(pretrained = True).to(device) # 加载预训练的vgg16模型

# 通过遍历模型的所有参数,并将它们的requires_grad属性设置为False,来冻结模型的参数。这意味着在训练过程中,这些参数的梯度将不会被计算,因此它们的值将不会被更新。

for param in model.parameters():

param.requires_grad = False # 冻结模型的参数,这样子在训练的时候只训练最后一层的参数

# 修改classifier模块的第6层,即最后一层(即:(6): Linear(in_features=4096, out_features=2, bias=True))

# 注意查看我们下方打印出来的模型

# classifier是VGG-16模型的最后一部分,是一个全连接网络。这里将最后一层的输出特征数从4096改为类别名称的数量(len(classeNames)),以适应新的分类任务。

model.classifier._modules['6'] = nn.Linear(4096,len(classeNames)) # 修改vgg16模型中最后一层全连接层,输出目标类别个数

model.to(device)

model

输出结果:

四、训练模型

4.1 编写训练函数

# 训练循环

def train(dataloader, model, loss_fn, optimizer):

size = len(dataloader.dataset) # 训练集的大小

num_batches = len(dataloader) # 批次数目, (size/batch_size,向上取整)

train_loss, train_acc = 0, 0 # 初始化训练损失和正确率

for X, y in dataloader: # 获取图片及其标签

X, y = X.to(device), y.to(device)

# 计算预测误差

pred = model(X) # 网络输出

loss = loss_fn(pred, y) # 计算网络输出和真实值之间的差距,targets为真实值,计算二者差值即为损失

# 反向传播

optimizer.zero_grad() # grad属性归零

loss.backward() # 反向传播

optimizer.step() # 每一步自动更新

# 记录acc与loss

train_acc += (pred.argmax(1) == y).type(torch.float).sum().item()

train_loss += loss.item()

train_acc /= size

train_loss /= num_batches

return train_acc, train_loss

4.2 编写测试函数

# 测试函数

def test (dataloader, model, loss_fn):

size = len(dataloader.dataset) # 测试集的大小

num_batches = len(dataloader) # 批次数目, (size/batch_size,向上取整)

test_loss, test_acc = 0, 0

# 当不进行训练时,停止梯度更新,节省计算内存消耗

with torch.no_grad():

for imgs, target in dataloader:

imgs, target = imgs.to(device), target.to(device)

# 计算loss

target_pred = model(imgs)

loss = loss_fn(target_pred, target)

test_loss += loss.item()

test_acc += (target_pred.argmax(1) == target).type(torch.float).sum().item()

test_acc /= size

test_loss /= num_batches

return test_acc, test_loss

4.3 设置动态学习率

# 设置动态学习率

learn_rate = 1e-4 # 初始学习率

# 调用官方动态学习率接口时使用

lambda1 = lambda epoch: 0.92 ** (epoch // 4)

optimizer = torch.optim.SGD(model.parameters(), lr=learn_rate)

scheduler = torch.optim.lr_scheduler.LambdaLR(optimizer, lr_lambda=lambda1) #选定调整方法

4.4 正式开始训练

# 开始训练

import copy

loss_fn = nn.CrossEntropyLoss() # 创建损失函数

epochs = 40

train_loss = []

train_acc = []

test_loss = []

test_acc = []

best_acc = 0 # 设置一个最佳准确率,作为最佳模型的判别指标

for epoch in range(epochs):

model.train()

epoch_train_acc, epoch_train_loss = train(train_dl, model, loss_fn, optimizer)

scheduler.step() # 更新学习率(调用官方动态学习率接口时使用)

model.eval()

epoch_test_acc, epoch_test_loss = test(test_dl, model, loss_fn)

# 保存最佳模型到 best_model

if epoch_test_acc > best_acc:

best_acc = epoch_test_acc

best_model = copy.deepcopy(model)

train_acc.append(epoch_train_acc)

train_loss.append(epoch_train_loss)

test_acc.append(epoch_test_acc)

test_loss.append(epoch_test_loss)

# 获取当前的学习率

lr = optimizer.state_dict()['param_groups'][0]['lr']

template = ('Epoch:{:2d}, Train_acc:{:.1f}%, Train_loss:{:.3f}, Test_acc:{:.1f}%, Test_loss:{:.3f}, Lr:{:.2E}')

print(template.format(epoch+1, epoch_train_acc*100, epoch_train_loss,

epoch_test_acc*100, epoch_test_loss, lr))

# 保存最佳模型到文件中

PATH = './best_model.pth' # 保存的参数文件名

torch.save(model.state_dict(), PATH)

print('Done')

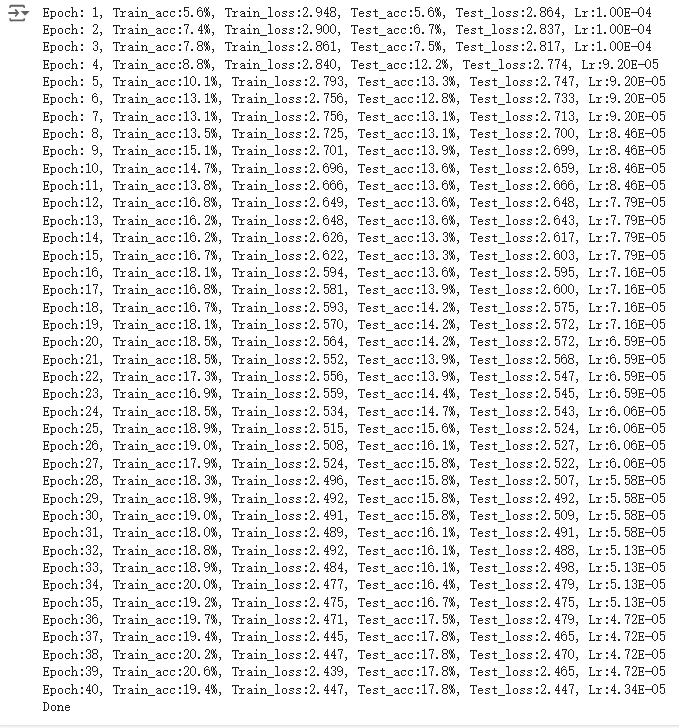

输出结果:

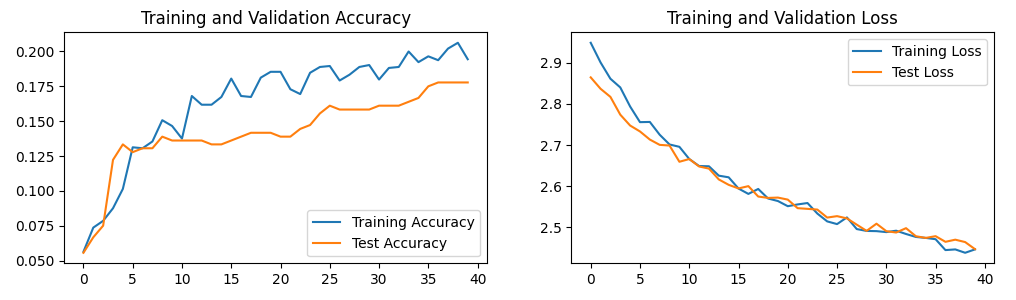

4.5 结果可视化

4.5.1 Loss与Accuracy图

# 结果可视化

import matplotlib.pyplot as plt

#隐藏警告

import warnings

warnings.filterwarnings("ignore") #忽略警告信息

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.dpi'] = 100 #分辨率

epochs_range = range(epochs)

plt.figure(figsize=(12, 3))

plt.subplot(1, 2, 1)

plt.plot(epochs_range, train_acc, label='Training Accuracy')

plt.plot(epochs_range, test_acc, label='Test Accuracy')

plt.legend(loc='lower right')

plt.title('Training and Validation Accuracy')

plt.subplot(1, 2, 2)

plt.plot(epochs_range, train_loss, label='Training Loss')

plt.plot(epochs_range, test_loss, label='Test Loss')

plt.legend(loc='upper right')

plt.title('Training and Validation Loss')

plt.show()

输出结果:

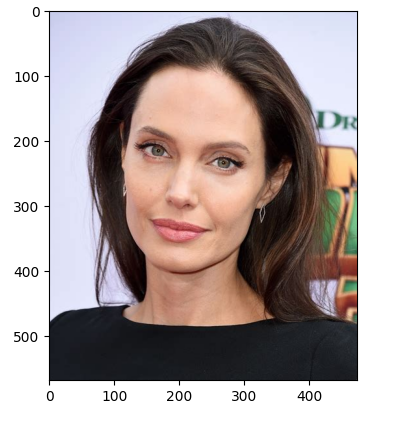

4.5.2 指定图片进行预测

# 指定模型进行训练

from PIL import Image

classes = list(total_data.class_to_idx)

def predict_one_image(image_path, model, transform, classes):

test_img = Image.open(image_path).convert('RGB')

plt.imshow(test_img) # 展示预测的图片

test_img = transform(test_img)

img = test_img.to(device).unsqueeze(0)

model.eval()

output = model(img)

_,pred = torch.max(output,1)

pred_class = classes[pred]

print(f'预测结果是:{pred_class}')

# 预测训练集中的某张照片

predict_one_image(image_path='/content/drive/MyDrive/k-data/VGG6-人脸识别/Angelina Jolie/001_fe3347c0.jpg',

model=model,

transform=train_transforms,

classes=classes)

输出结果:

五、总结

1.本周学习了VGG-16的框架的组成:

- 输入层:接受一个固定大小(通常为224x224像素)的3通道彩色图像作为输入。

- 卷积层(Convolutional Layers):VGG-16包含13个卷积层,分为多个块,每个块中的卷积层使用相同数量的过滤器。这些块分别是:

第1块:2个卷积层,每个层有64个过滤器,大小为3x3,步长为1,使用相同填充。

第2块:2个卷积层,每个层有128个过滤器。

第3块:3个卷积层,每个层有256个过滤器。

第4块:3个卷积层,每个层有512个过滤器。

第5块:3个卷积层,每个层有512个过滤器。

每个卷积层后面都跟着一个ReLU激活函数。 - 池化层(Pooling Layers):在卷积块之间,VGG-16使用了5个最大池化层,每个池化层的大小为2x2,步长为2。这些池化层用于减少空间维度。

- 全连接层(Fully Connected Layers):VGG-16包含3个全连接层,前两个各有4096个神经元,第三个是分类层,其神经元数量等于目标数据集的类别数(对于ImageNet来说,是1000个类别)。每个全连接层后面都跟着一个ReLU激活函数和一个Dropout层,以减少过拟合。

- 输出层:输出层是一个softmax层,它将全连接层的输出转换为概率分布,表示输入图像属于每个类别的概率。

1484

1484

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?