简介

“LiveTalking” 是一个开源的实时互动数字人直播系统,旨在提供高质量的数字人直播解决方案。它由开发者 lipku 主导,托管在 GitHub 上(地址:https://github.com/lipku/LiveTalking)。截至 2025 年 4 月,该项目已获得超过 5.1k 的星标和 750 多个 fork,显示出较高的社区关注度和活跃度。

项目概述

-

目标:LiveTalking 致力于构建一个实时互动的数字人系统,能够实现音视频同步对话,支持直播、在线教育、虚拟客服等多种场景。

-

核心特点:

** 实时性:通过流式传输技术(RTMP 或 WebRTC)实现低延迟的音视频互动。

** 多模型支持:集成了多种数字人模型,包括 ER-NeRF、MuseTalk、Wav2Lip 和 Ultralight-Digital-Human。

** 支持语音克隆

** 支持在数字人说话时打断它

** 支持全身视频拼接

** 支持rtmp和webrtc

** 支持视频编排:不说话时播放自定义视频

** 支持多并发

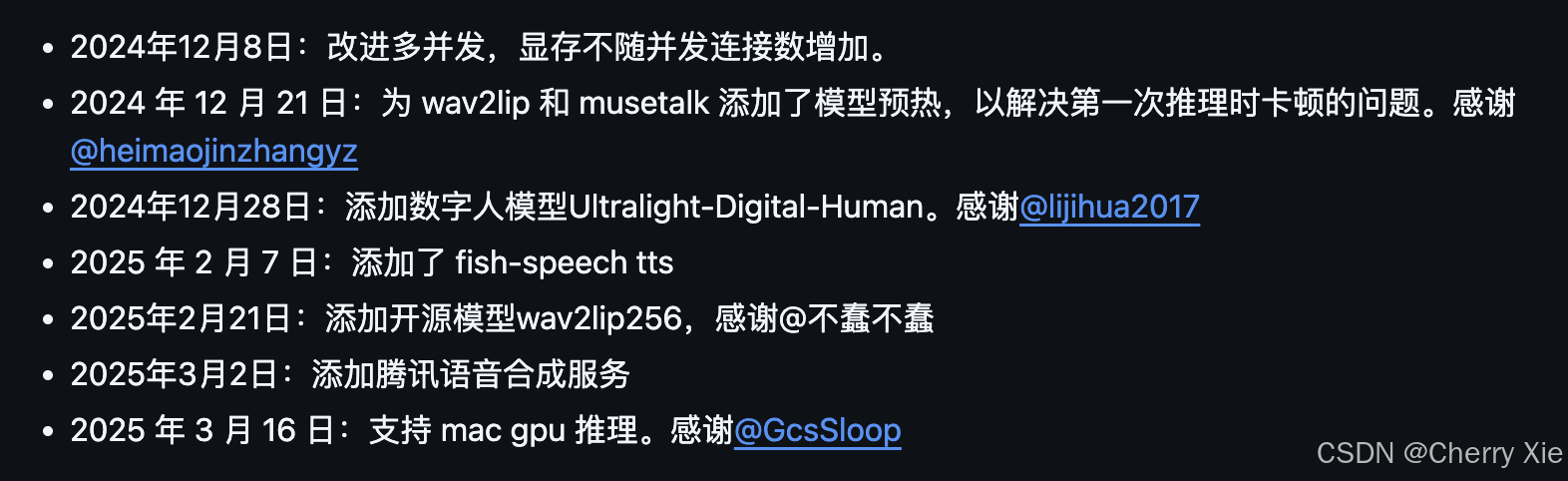

迭代记录

技术栈

LiveTalking 整合了多项前沿技术,技术复杂度较高

数字人模型

-

ER-NeRF:基于神经辐射场的渲染技术,用于生成高质量的数字人动画。

-

MuseTalk:支持实时唇形同步和面部动画。

-

Wav2Lip:经典的唇形同步模型,适用于音频驱动的视频生成。

-

Ultralight-Digital-Human:轻量化数字人解决方案,优化性能。

音视频处理

-

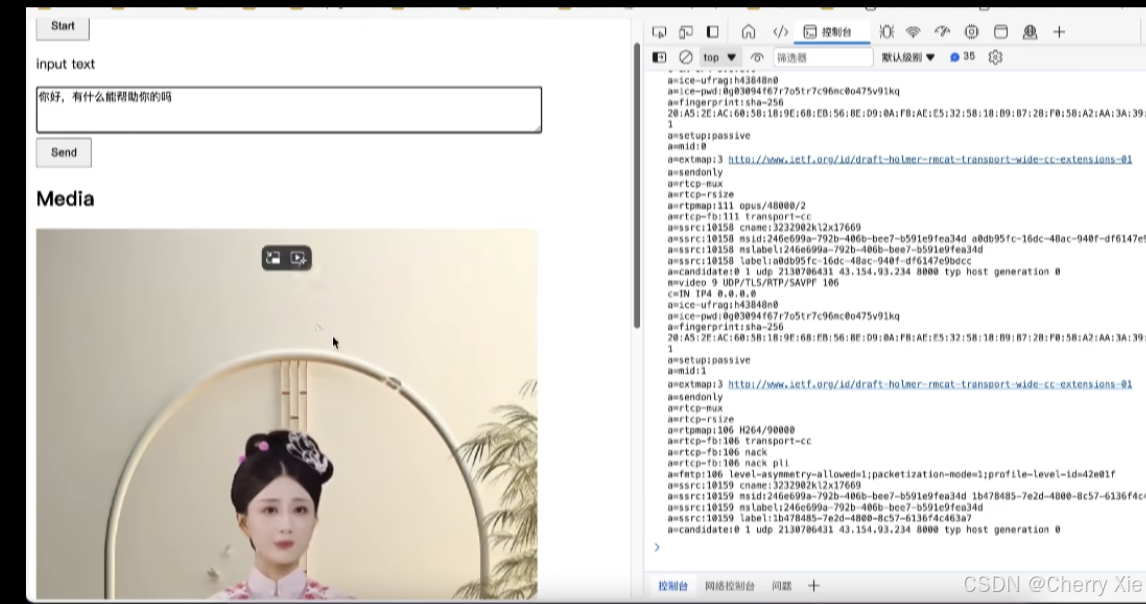

支持 WebRTC 和 RTMP 协议,用于实时流传输。

-

依赖 FFmpeg 处理音视频流。

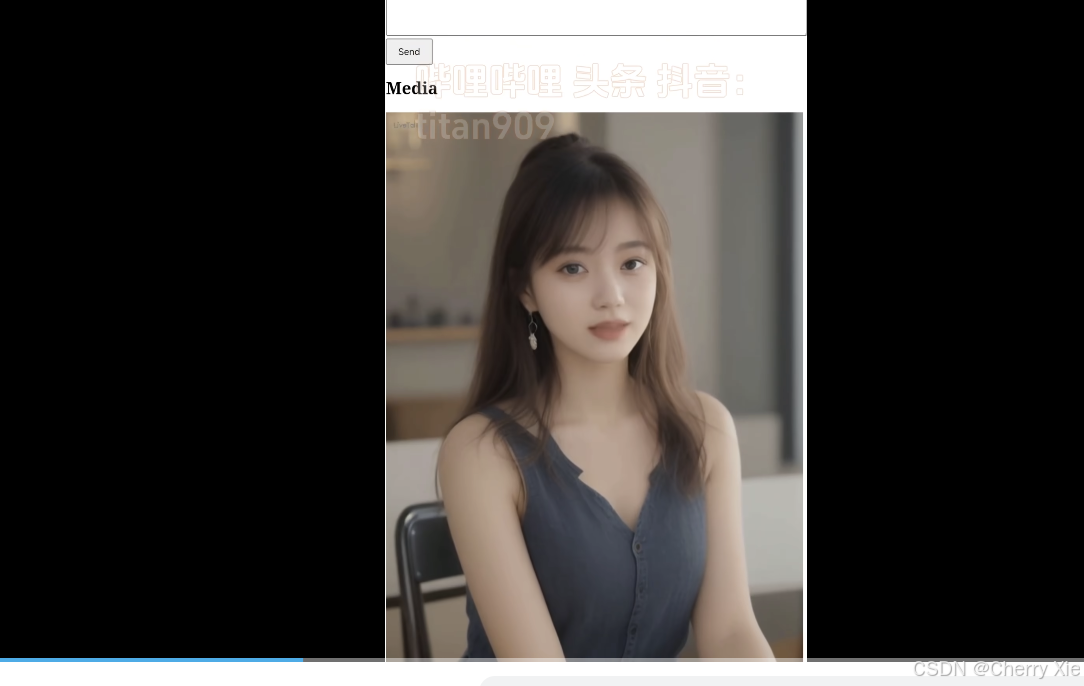

看看效果

相关文献

github项目地址:https://github.com/lipku/LiveTalking

实际效果参考:https://www.bilibili.com/video/BV1gEc2e3Ep1/?spm_id_from=333.788.player.player_end_recommend_autoplay&vd_source=ef215224fd573c6ab6505c231b6be959

7723

7723

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?