论文:arxiv.org/abs/1901.01484

参考资料:

【LanczosNet】LANCZOSNET: MULTI-SCALE DEEP GRAPH CONVOLUTIONAL NETWORKS 论文笔记

摘要

我们提出了Lanczos network(LanczosNet),它使用 Lanczos algorithm 构造了图卷积的图拉普拉斯量graph Laplacian的低秩近似 low rank approximations。利用Lanczos算法的三对角分解 tridiagonal decomposition,通过矩阵乘方的快速近似计算有效地利用多尺度信息,还设计了可学习的谱滤波器learnable spectral filters。由于是完全可微的,LanczosNet促进了图核学习graph kernel learning和学习节点嵌入 node embeddings。我们展示了我们的LanczosNet和基于图的流形学习方法graph based manifold learning methods之间的联系,特别是扩散图diffusion maps。我们对引文网络citation networks和QM8量子化学数据集 QM8 quantum chemistry dataset上的几个深度图网络进行了基准测试benchmark。实验结果表明,我们的模型在大多数任务中都达到了最先进的性能。代码发布在:https://github.com/lrjconan/LanczosNetwork。

1 INTRODUCTION

图结构数据在现实世界的应用、社会网络、基因表达调控网络、蛋白质-蛋白质相互作用和许多其他物理系统中无处不存在。如何使用机器学习,特别是深度学习来建模这些数据,已经成为一个中心研究问题[1]。对于监督和半监督任务,如图或节点分类和回归,基于学习的模型可以大致分为两类,用图卷积[2]或递归神经网络[3]表示。

基于递归神经网络(RNN)的方法,特别是图神经网络(GNN)[3],通过在节点之间交换信息,反复展开图上的消息传递过程。理论上,一个GNN可以具有与其卷积对应物一样大的模型容量。然而,由于RNN动力学的不稳定性和优化的困难,GNN及其变体通常更慢,更难训练。

本文主要研究了基于图卷积的方法。这些方法建立在图信号处理(GSP)方法[4]的基础上,利用谱图论、图小波理论等方法将卷积算子扩展到图上。图卷积可以堆叠,并与非线性激活函数结合,以建立深度模型,就像在规则的卷积神经网络(CNN)中一样。它们通常具有较大的模型容量,并取得了良好的结果。此外,图卷积也可以很容易地用现代科学计算库来实现。

图卷积方法的问题

目前的图卷积方法有两个主要问题。

首先,除了直接叠加多层外,如何有效地利用多尺度信息尚不清楚。拥有一个有效的多尺度方案是使模型能够对尺度变化保持不变,并捕获许多内在规律[5,6]的关键。图的粗化方法 Graph coarsening methods已经被提出来形成一个多尺度图[7]的层次结构,但这种粗化过程在推理和学习过程中都是固定的,这可能会导致一些偏差。或者,图信号可以乘以指数图拉普拉斯量exponentiated graph Laplacian,其中指数表示图[8]上扩散过程的尺度。不幸的是,计算和内存成本随指数呈线性增加,这阻碍了在实践中利用长尺度扩散long scale diffusion。其他计算矩阵乘方的快速方法,如平方指数exponentiating by squaring是内存密集的memory intensive,即使是中等大的图形。

其次,当前基于图卷积的模型中的光谱滤波器大多是固定的。在图像处理的背景下,使用高斯核Gaussian kernel和光谱滤波器spectral filter f(λ)=2λ−λ2对应于向前运行热方程(模糊),然后向后运行(锐化)[9]。[10]中引入的多尺度核 Multi-scale kernels扩展了前后扩散过程forward-backward diffusion process的思想,可以表示为与高斯核相关的矩阵的多项式。因此,学习光谱滤波器是有益的,因为它学习图上的随机过程,为特定的任务产生有用的表示。然而,如何学习具有大模型容量的光谱滤波器在很大程度上尚未得到充分的探索。

本文工作

在本文中,我们提出了 Lanczos network (LanczosNet)来克服上述问题。首先,基于Lanczos算法所隐含的三对角分解,我们的模型利用了图拉普拉斯函量的低秩近似。这种近似有助于矩阵乘方的有效计算,从而很容易地收集多尺度信息。其次,我们设计了基于近似的可学习光谱滤波器learnable spectral filters based on the approximation,有效地提高了模型容量。在想要学习图核 和/或 节点嵌入的情况下,我们提出了另一种变体,即自适应adaptive Lanczos network(AdaLanczosNet),它通过Lanczos algorithm反向传播。我们表明,我们提出的模型与基于图的流形学习方法密切相关,如扩散映射diffusion maps,这可能会从深度图网络和流形学习之间的交叉中激发更多的工作。我们在引文网络和一个量子化学图回归问题上对9个最近的深度图网络进行了基准测试,包括基于卷积和基于RNN的方法,并在大多数任务中实现了最先进的结果。

2.背景

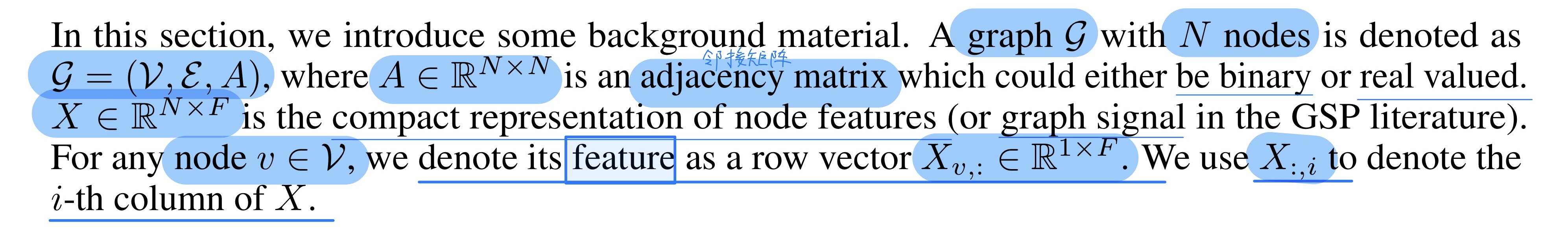

在本节中,我们将介绍一些背景材料。

图定义

图傅里叶变换

局部多项式滤波器

用Lanczos算法的原因↑

3 LANCZOS NETWORKS

在本节中,我们首先介绍近似亲和矩阵S approximates the affinity matrix S的 Lanczos algorithm。我们提出了我们的第一个模型,称为 Lanczos network (LanczosNet),在该模型中,我们每个图执行一次Lanczos 算法,并在整个推理和学习过程中修复基础 fix the basis。然后引入自适应Lanczos网络(AdaLanczosNet),通过Lanczos算法反向传播来学习图核 和/或 节点嵌入。

3.1 LANCZOS ALGORITHM

这清楚地解释了伪代码的第4行到第6行,也就是说,它试图以迭代的方式求解系统。请注意,算法中最昂贵的操作是第4行中的矩阵向量乘法。在得到三对角矩阵T之后,我们可以通过对角化矩阵T来计算近似S的特征值和特征向量的Ritz值和Ritz向量。我们只在LanczosNet中添加这一步,因为我们发现通过AdaLanczosNet中的特征分解反向传播在数值上是不稳定的。

3.2 LANCZOSNET

在本节中,我们首先展示基于Lanczos算法输出的局部多项式滤波器的构造,并讨论其局限性。然后,我们解释了如何使用特定的低秩近似构造光谱滤波器,以及如何进一步使滤波器可学习。最后,我们阐述了如何构造多尺度图卷积并构建一个深度网络。

Localized Polynomial Filter

Spectral Filter

理想情况下,我们希望在深度图卷积网络的推理过程中只计算一次Lanczos向量。幸运的是,如果我们采用Lanczos算法的另一种观点,这是可以实现的。

Learning the Spectral Filter

Multi-Scale Graph Convolution

请注意,短尺度对应的卷积类似于[8](Diffusion-convolutional neural networks),当矩阵向量乘法的次数与S的最大尺度相关等时。相反,长尺度的卷积将 Lanczos步骤K 和 尺度参数I 解耦(decouple),从而允许将尺度作为 超参数 进行调整时有很大的自由度。人们可以适当选择K来平衡 计算成本 和 低秩逼近的精度。在我们的实验中,短尺度通常小于10,具有合理的计算成本。此外,短尺度部分有时可以弥补低秩近似粗糙的情况。我们在实验中设置了不大于100的长尺度。如果S的最大特征值为1,我们甚至可以把幂提高到无穷大,这对应于图上扩散过程的平衡状态。

为了构建深度网络,我们可以堆叠多个这样的图卷积层,其中每一层都有自己的光谱滤波器权重。可以在层之间添加非线性激活函数,例如ReLU和/或Dropout。这种深度网络的推理算法如 算法2 所示。模型的整体计算图 如图1 所示。对于顶层表示(top layer representation),可以使用softmax执行分类,也可以使用完全连接的层执行回归。Lanczos算法在每个图中预先运行一次以构建网络,并且在推理和学习过程中不会被调用。

3.3 ADALANCZOSNET

在本节中,我们将解释另一种通过Lanczos算法反向传播的变体。这有助于学习图形内核和/或节点嵌入。

Graph Kernel

Node Embedding

在某些应用中,我们不观察 节点特征X,只观察 图本身G,因此我们可能需要了解每个节点的 嵌入向量。例如,这种情况适用于量子化学任务中的节点,即分子中的原子,很少观察到特征。我们仍然可以使用上面的图核来构造亲和矩阵,除了f被丢弃,其结果是相同的形式。学习嵌入X自然等于学习节点之间的相似性。

Tridiagonal Decomposition三对角分解

虽然LanczosNet中的所有运算都是可微的,但我们从经验上观察到,通过三对角矩阵的特征分解的反向传播在数值上是不稳定的。如果多个特征值在数值上接近,或者一个特征值在公式(7)中取较大的幂,情况会更糟。

解决 因此,我们直接利用通过运行 Lanczos算法k步 得到的 近似三对角分解S ≈ QTQT。然后我们可以将 光谱过滤 spectral filtering 改写如下,

通过上述图拉普拉斯和三对角分解的参数化,我们可以通过Lanczos算法将损失反向传播到图核 参数θ 或 节点嵌入x 中。除了每次推理过程都需要调用Lanczos算法外,总体模型与LanczosNet类似。

4 LANCZOS NETWORK AND DIFFUSION MAPS

在本节中,我们将重点介绍LanczosNet和图的一个重要示例(基于流形学习算法的扩散图)之间的关系。

Diffusion Maps

Connection to Graph Convolution

除了使用扩散图嵌入不同时间尺度的节点特征X外,还可以使用它计算X的频率表示,如下所示,

抑制特征值较小的项。回想一下,在LanczosNet的卷积层Eq(6)中,我们使用了多个不同尺度t的这样的频率表示,并替换了Eq.(12)中的特征值Λ。用它们的近似值,即Ritz值。因此,在LanczosNet中,spectral filters实际上应用于通过将节点特征X投影到不同尺度的多个扩散图上获得频率表示。

5 RELATED WORK

我们可以大致将机器学习,特别是深度学习的应用归类为有监督/半监督和无监督的场景。对于前者,大部分工作集中在节点/图分类和回归[1,19–21]。对于后者,无监督节点/图嵌入学习[22,23]是常见的。最近,图的生成模型,比如分子生成,引起了一些关注[24,25]。

Graph Convolution Based Models

图的第一类学习模型源于图信号处理(GSP)[4,12],它试图将卷积算子从传统的信号处理推广到图。spectral graph theory[26]和图小波理论graph wavelet theory[27],提出了图信号频率表示的几种定义[4]。其中,基于谱图的理论比较流行,其中图傅里叶变换及其逆是根据图拉普拉斯的特征基定义的。沿着这条线,许多基于图卷积的深度网络模型应运而生。[2,28]是第一批探索深度网络上下文中基于拉普拉斯的图卷积的人之一。同时,[29]基于邻接矩阵直接进行图卷积来预测分子指纹。[30]提出一种策略,形成相同大小的本地邻居,然后像普通CNN一样应用卷积。Chebyshev多项式被[7]利用来构造图卷积的局部多项式滤波器,后来在图卷积网络中得到简化(GCN) [11]。[31,32]提出了基于重要抽样和控制变量技术的GCN进一步加速。在[33,34]中引入了几种注意机制来学习gcn的边缘权重。值得注意的是,[8]提出了利用扩散算子进行图卷积的扩散卷积神经网络。在文献[35]中探索了以加速为目的的图卷积的Lanczos方法。具体来说,他们只考虑我们LanczosNet变体中的局部多项式滤波器情况,不像我们一样探索低秩分解、可学习谱滤波器和图核/节点嵌入学习。

Graph based Manifold Learning

非线性降维方法,如局部线性嵌入(LLE) [47]、ISOMAP [48]、Hessian LLE[49]、拉普拉斯特征映射Laplacian eigenmaps[50]和扩散映射diffusion maps[17],假设高维数据位于或接近低维流形,并利用加权图中的局部相似性来学习数据的全局特征。它们是在低维空间中嵌入复杂数据和在图中回归函数的宝贵工具。谱聚类Spectral clustering[51,52]、半监督学习semi-supervised learning[53]和样本外扩展out-of-sample extension[54]共享关联图的相似几何考虑。各向异性图核Anisotropic graph kernels在许多应用中都是有用的。例如,[15]用一个考虑高斯核函数中每个节点的局部方差的自校正扩散核来改进谱聚类结果。同样,[55]使用局部马氏距离定义的各向异性高斯核,从独立随机过程的非线性测量中提取独立分量。各向异性核流形学习Manifold learning with anisotropic kernel对于数据驱动的动力系统分析也很有用,例如,检测随机动力系统的本质慢变量[56],过滤动力过程[57],以及长期气候预测[58,59]。各向异性扩散anisotropic diffusion能够利用测量的局部统计来传递潜在因素的几何信息,而不是手头的具体实现或测量[60,61]。

6 EXPERIMENTS

在本节中,我们将我们的两个模型变体与最近的9个图网络进行了比较,其中包括指纹图卷积网络graph convolution networks for fingerprint(GCN-FP) [29]、门控图神经网络gated graph neural networks(GGNN) [37]、扩散卷积神经网络diffusion convolutional neural networks(DCNN) [8]、切比雪夫网络Chebyshev networks (ChebyNet) [7]、图卷积网络graph convolutional networks(GCN) [11]、消息传递神经网络message passing neural networks(MPNN) [62]、图样本和聚合graph sample and aggregate(GraphSAGE) [39]、图划分神经网络graph partition neural networks(GPNN) [40]、图注意力网络graph attention networks(GAT) [33]。我们在两组任务上测试它们:(1)3个引文网络上的半监督文献分类[63],(2)QM8量子化学数据集上的分子性质监督回归[64]。为了公平比较,我们在所有的实验中只调优模型相关的超参数,并共享其他参数,比如使用相同的批量。我们根据交叉验证仔细调整超参数,并报告每个竞争对手的最佳表现。有关超参数的详细信息,请参阅附录。我们使用PyTorch [65]实现所有方法,并在https://github.com/lrjconan/LanczosNetwork.发布代码

略

7 CONCLUSION

本文提出了利用Lanczos算法构造图Laplacian的低秩近似的LanczosNet。它不仅为图卷积提供了一种收集多尺度信息的有效方法,而且可以实现学习谱滤波器。此外,我们还提出了一个模型变体AdaLanczosNet,它有助于图核和节点嵌入学习。我们表明我们的模型与基于图的流形学习有着密切的关系,特别是扩散图。实验结果表明,在具有挑战性的图问题上,我们的模型优于其他一系列图网络。我们目前正在探索三对角矩阵的定制特征分解方法,这将有可能进一步改进我们的AdaLanczosNet。总的来说,这个方向的工作有希望让深度学习扩展到非常大的图形问题。

总结

530

530

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?