谈谈你对微服务的理解

微服务架构下的一整套解决方案

- 服务注册与发现

- 服务调用

- 服务熔断

- 负载均衡

- 服务降级

- 服务消息队列

- 配置中心

- 服务网关

- 服务监控

- 全链路追踪

- 自动化构建部署

- 服务定时任务调度操作

Spring Cloud

分布式微服务架构的一站式解决方案,是多种微服务架构落地技术的集合体,俗称微服务全家桶

下面一张图是京东的促销架构

阿里的架构图:

京东物流的架构图:

基础服务:

Spring Cloud技术栈

这是原来2020年以前的微服务方案

但是随着Eureka等组件的闭源,后续的一些解决方案也有了新的替换产品

Spring Cloud版本选型

SpringBoot2.X版 和 SpringCloud H版

SpringBoot官方已经强烈推荐 2.X版

SpringCloud采用英国伦敦地铁站的名称来命名,并由地铁站名称字母A-Z一次类推的形式发布迭代版本

SpringCloud是由许多子项目组成的综合项目,各子项目有不同的发布节奏,为了管理SpringCloud与各子项目的版本依赖关系,发布了一个清单,其中包括了某个SpringCloud版对应的子项目版本,为了避免SpringCloud版本号与子项目版本号混淆,SpringCloud版采用了名称而非版本号命名。例如Angel,Brixton。当SpringCloud的发布内容积累到临界点或者一个重大BUG被解决后,会发布一个Service releases版本,俗称SRX版本,比如 Greenwich.SR2就是SpringCloud发布的Greenwich版本的第二个SRX版本

SpringBoot和SpringCloud版本约束

SpringBoot和SpringCloud的版本选择也不是任意的,而是应该参考官网的约束配置

地址:https://spring.io/projects/spring-cloud

版本对应:https://start.spring.io/actuator/info

关于Cloud各种组件的停更/升级/替换

停更引发的升级惨案

- 被动修复Bugs

- 不再接受合并请求

- 不再发布新版本

明细条目

- 服务调用

- Eureka

- Zookeeper

- Consul

- Nacos (推荐)

- 服务调用

- Feign

- OpenFeign (推荐)

- Ribbon

- LoadBalancer

- 服务降级

- Hystrix

- resilience4j

- sentienl (推荐)

- 服务网关

- Zuul

- Zuul2

- Gateway(推荐)

- 服务配置

- Config

- Nacos(推荐)

- 服务总线

- Bus

- Nacos(推荐)

Clound升级

环境搭建

1,创建父工程,pom依赖

-

建一个空工程---------------------------约定 > 配置 > 编码

-

File——》new Project——》mavan

-

Mavan选安装的3.5及以上的

-

设置字符集

-

注解生效激活

*

-

java编译版本选8

-

文件过滤

2.父工程的pom.xml

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.atguigu.springboot</groupId>

<artifactId>clound2020</artifactId>

<version>1.0-SNAPSHOT</version>

<packaging>pom</packaging>

<!-- 统一管理jar包版本 -->

<properties>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

<maven.compiler.source>1.8</maven.compiler.source>

<maven.compiler.target>1.8</maven.compiler.target>

<junit.version>4.12</junit.version>

<log4j.version>1.2.17</log4j.version>

<lombok.version>1.16.18</lombok.version>

<mysql.version>5.1.47</mysql.version>

<druid.version>1.1.16</druid.version>

<mybatis.spring.boot.version>1.3.0</mybatis.spring.boot.version>

</properties>

<!-- 子模块继承之后,提供作用:锁定版本+子modlue不用写groupId和version -->

<dependencyManagement>

<dependencies>

<!--spring boot 2.2.2-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-dependencies</artifactId>

<version>2.2.2.RELEASE</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<!--spring cloud Hoxton.SR1-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-dependencies</artifactId>

<version>Hoxton.SR1</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<!--spring cloud alibaba 2.1.0.RELEASE-->

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-alibaba-dependencies</artifactId>

<version>2.1.0.RELEASE</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<version>${mysql.version}</version>

</dependency>

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>druid</artifactId>

<version>${druid.version}</version>

</dependency>

<dependency>

<groupId>org.mybatis.spring.boot</groupId>

<artifactId>mybatis-spring-boot-starter</artifactId>

<version>${mybatis.spring.boot.version}</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>${junit.version}</version>

</dependency>

<dependency>

<groupId>log4j</groupId>

<artifactId>log4j</artifactId>

<version>${log4j.version}</version>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<version>${lombok.version}</version>

<optional>true</optional>

</dependency>

</dependencies>

</dependencyManagement>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

<configuration>

<fork>true</fork>

<addResources>true</addResources>

</configuration>

</plugin>

</plugins>

</build>

</project>

- demo示意图:

3.创建子模块,pay模块

- 微服务模块构建步骤

- 建立module

- 改POM

- 改YML

- 主启动

- 业务类

- 建库----》payment

- 新建业务类

* Payment

package com.atguigu.springcloud.entities;

@Data

@AllArgsConstructor

@NoArgsConstructor

public class Payment implements Serializable {

private Long id;

private String serial;

}

CommonResult

package com.atguigu.springcloud.entities;

@Data

@AllArgsConstructor

@NoArgsConstructor

public class CommonResult<T> {

private Integer code;

private String message;

private T data;

public CommonResult(Integer code, String message) {

this(code, message, null);

}

}

PaymentService

package com.atguigu.springcloud.service;

public interface PaymentService

{

public int create(Payment payment);

public Payment getPaymentById(@Param("id") Long id);

}

PaymentServiceImpl

package com.atguigu.springcloud.service.impl;

@Service

public class PaymentServiceImpl implements PaymentService

{

@Resource

private PaymentDao paymentDao;

public int create(Payment payment)

{

return paymentDao.create(payment);

}

public Payment getPaymentById(Long id)

{

return paymentDao.getPaymentById(id);

}

}

PaymentController

package com.atguigu.springcloud.controller;

@RestController

@Slf4j

public class PaymentController

{

@Resource

private PaymentService paymentService;

@PostMapping(value = "/payment/create")

public CommonResult create( Payment payment)

{

int result = paymentService.create(payment);

log.info("*****插入结果:"+result);

if(result > 0)

{

return new CommonResult(200,"插入数据库成功",result);

}else{

return new CommonResult(444,"插入数据库失败",null);

}

}

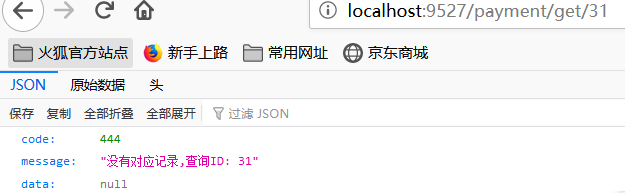

@GetMapping(value = "/payment/get/{id}")

public CommonResult<Payment> getPaymentById(@PathVariable("id") Long id)

{

Payment payment = paymentService.getPaymentById(id);

if(payment != null)

{

return new CommonResult(200,"查询成功 ",payment);

}else{

return new CommonResult(444,"没有对应记录,查询ID: "+id,null);

}

}

}

4.配置application.yml

server:

port: 8001

spring:

application:

name: cloud-payment-service

datasource:

type: com.alibaba.druid.pool.DruidDataSource # 当前数据源操作类型

driver-class-name: org.gjt.mm.mysql.Driver # mysql驱动包

url: jdbc:mysql://localhost:3306/spring?useUnicode=true&characterEncoding=utf-8&useSSL=false

username: root

password: 123

mybatis:

mapperLocations: classpath:mapper/*.xml

type-aliases-package: com.atguigu.springcloud.entities # 所有Entity别名类所在包

- 创建mapper-------》mapper/*.xml

<?xml version="1.0" encoding="UTF-8" ?>

<!DOCTYPE mapper PUBLIC "-//mybatis.org//DTD Mapper 3.0//EN" "http://mybatis.org/dtd/mybatis-3-mapper.dtd" >

<mapper namespace="com.atguigu.springcloud.dao.PaymentDao">

<!-- useGeneratedKeys 插入成功返回值大于0,返回keyProperty-->

<insert id="create" parameterType="Payment" useGeneratedKeys="true" keyProperty="id">

insert into payment(serial) values(#{serial});

</insert>

<resultMap id="BaseResultMap" type="com.atguigu.springcloud.entities.Payment">

<id column="id" property="id" jdbcType="BIGINT"/>

<id column="serial" property="serial" jdbcType="VARCHAR"/>

</resultMap>

<!-- 实际开发建议用resultMap,映射解决不规范-->

<select id="getPaymentById" parameterType="Long" resultMap="BaseResultMap">

select * from payment where id=#{id};

</select>

</mapper>

- 测试(postMan)

4.配置热部署

- 引入依赖

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

- 在父工程的pom添加插件

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

<configuration>

<fork>true</fork>

<addResources>true</addResources>

</configuration>

</plugin>

</plugins>

</build>

- 开启自动编译的权限

4 跟新值----------------ctrl+shift+alt+/------->repository

- . 重启idea测试--------这里我就不这么弄了,我用的方法:

- 添加热部署依赖

- 编写代码ctrl+f9实现热部署

5.创建cloud-consumer-order80子模块

- 引入依赖

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!--监控-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<!--热部署-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

- 创建主启动类

- 编写业务类

-

创建与cloud-provider-payment8001相同的entities

-

RestTemplate官网

- RestTemplate是Spring提供的用于访问Rest服务的客户端,RestTemplate提供了多种便捷访问远程Http服务的方法,能够大大提高客户端的编写效率

-

ApplicationContextConfig

package com.atguigu.springclound.config; @Configuration public class ApplicationContextConfig { @Bean public RestTemplate getRestTemplate() { return new RestTemplate(); } } -

OrderController

package com.atguigu.springclound.controller; @RestController @Slf4j public class OrderController { public static final String PAYMENT_URL = "http://localhost:8001"; @Resource private RestTemplate restTemplate; @GetMapping("/consumer/payment/create") public CommonResult<Payment> create(Payment payment) { return restTemplate.postForObject(PAYMENT_URL +"/payment/create",payment, CommonResult.class); } @GetMapping("/consumer/payment/get/{id}") public CommonResult<Payment> getPayment(@PathVariable("id") Long id) { return restTemplate.getForObject(PAYMENT_URL+"/payment/get/"+id,CommonResult.class ); } }

-

- Run Dashboars如果不自动出来的请观看P13

6.工程重构

- 将cloud-provider-payment8001和cloud-consumer-order80的entities抽出到cloud-api-commons

- 对cloud-api-commons模块clean—install

- cloud-provider-payment8001和cloud-consumer-order80引入依赖

<dependency><!-- 引入自己定义的api通用包,可以使用Payment支付Entity -->

<groupId>com.atguigu.springboot</groupId>

<artifactId>cloud-api-commons</artifactId>

<version>${project.version}</version>

</dependency>

- 启动测试即可

服务注册与发现,Eureka:

前面我们没有服务注册中心,也可以服务间调用,为什么还要服务注册?

当服务很多时,单靠代码手动管理是很麻烦的,需要一个公共组件,统一管理多服务,包括服务是否正常运行,等

Eureka用于服务注册,目前官网已经停止更新

1.引入pom依赖

<dependencies>

<!--eureka-server-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-server</artifactId>

</dependency>

<!-- 引入自己定义的api通用包,可以使用Payment支付Entity -->

<dependency>

<groupId>com.atguigu.springboot</groupId>

<artifactId>cloud-api-commons</artifactId>

<version>${project.version}</version>

</dependency>

<!--boot web actuator-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<!--一般通用配置-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

</dependency>

</dependencies>

2.配置yaml

server:

port: 7001

eureka:

instance:

hostname: eureka7001.com #eureka服务端的实例名称

client:

register-with-eureka: false #false表示不向注册中心注册自己。

fetch-registry: false #false表示自己端就是注册中心,我的职责就是维护服务实例,并不需要去检索服务

service-url:

defaultZone: http://${eureka.instance.hostname}:${server.port}/eureka/

3.主启动类

package com.atguigu.springcloud;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

import org.springframework.cloud.netflix.eureka.server.EnableEurekaServer;

@SpringBootApplication

@EnableEurekaServer //服务注册中心

public class EurekaMain7001 {

public static void main(String[] args) {

SpringApplication.run(EurekaMain7001.class, args);

}

}

4.测试------http://localhost:7001/

5.其他服务注册到eureka:

- 主启动类添加@EnableEurekaClient注解

@SpringBootApplication

@EnableEurekaClient

public class PaymentMain8001{

public static void main(String[] args) {

SpringApplication.run(PaymentMain8001.class, args);

}

}

- 在cloud-provider-payment8001POM添加依赖

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

- 修改yaml配置文件,以下是添加的内容

eureka:

client:

#表示是否将自己注册进EurekaServer默认为true。

register-with-eureka: true

#是否从EurekaServer抓取已有的注册信息,默认为true。单节点无所谓,集群必须设置为true才能配合ribbon使用负载均衡

fetchRegistry: true

service-url:

defaultZone: http://localhost:7001/eureka

- 将cloud-consumer-order80注册进去,步骤和上面一样,下面只记录下yaml添加的内容

eureka:

client:

#表示是否将自己注册进EurekaServer默认为true。

register-with-eureka: true

#是否从EurekaServer抓取已有的注册信息,默认为true。单节点无所谓,集群必须设置为true才能配合ribbon使用负载均衡

fetchRegistry: true

service-url:

defaultZone: http://localhost:7001/eureka

- 测试结果如下

集群版eureka:

原理

1,就是pay模块启动时,注册自己,并且自身信息也放入eureka

2.order模块,首先也注册自己,放入信息,当要调用pay时,先从eureka拿到pay的调用地址

3.通过HttpClient调用

并且还会缓存一份到本地,每30秒更新一次

EurekaServer集群环境构建

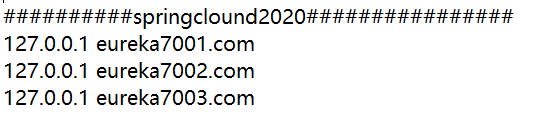

- 修改映射配置添加进hosts文件,找到 C:\Windows\System32\drivers\etc路径下的hosts文件添加如下内容

- 建一个cloud-eureka-server7002模块,与cloud-eureka-server7001一样

- 配置文件yaml

cloud-eureka-server7001

server:

port: 7001

eureka:

instance:

hostname: eureka7001.com #eureka服务端的实例名称

client:

register-with-eureka: false #false表示不向注册中心注册自己。

fetch-registry: false #false表示自己端就是注册中心,我的职责就是维护服务实例,并不需要去检索服务

service-url:

#集群指向其它eureka

defaultZone: http://eureka7002.com:7002/eureka/

#单机就是7001自己

# defaultZone: http://eureka7001.com:7001/eureka/

cloud-eureka-server7002

server:

port: 7002

eureka:

instance:

hostname: eureka7002.com #eureka服务端的实例名称

client:

register-with-eureka: false #false表示不向注册中心注册自己。

fetch-registry: false #false表示自己端就是注册中心,我的职责就是维护服务实例,并不需要去检索服务

service-url:

#集群指向其它eureka

defaultZone: http://eureka7001.com:7001/eureka/

#单机就是7001自己

# defaultZone: http://eureka7001.com:7001/eureka/

- 浏览器测试即可:http://eureka7002.com:7001/和http://eureka7002.com:7002/

- 将cloud-provider-payment8001和cloud-consumer-order80注册进去----修改yaml即可

eureka:

instance:

hostname: eureka7001.com #eureka服务端的实例名称

client:

register-with-eureka: false #false表示不向注册中心注册自己。

fetch-registry: false #false表示自己端就是注册中心,我的职责就是维护服务实例,并不需要去检索服务

service-url:

# 单击版

# defaultZone: http://localhost:7001/eureka

# 集群版

defaultZone: http://eureka7001.com:7001//eureka,http://eureka7002.com:7002//eureka

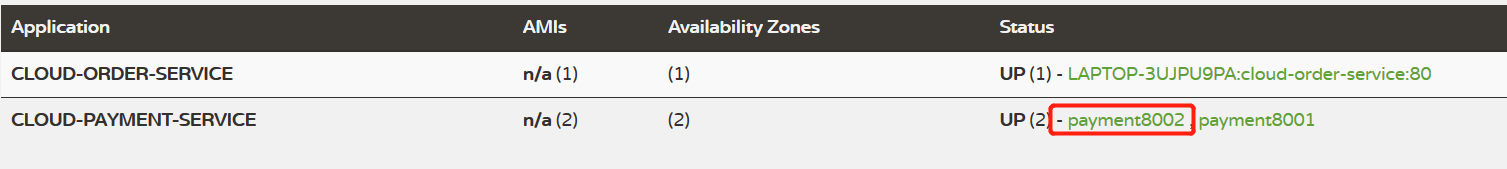

- 创建支付服务提供者8001集群,直接复制8001创建模块cloud-provider-payment8002即可

- 修改controller

@RestController

@Slf4j

public class PaymentController

{

@Resource

private PaymentService paymentService;

@Value("${server.port}")

private String serverPort;

@PostMapping(value = "/payment/create")

public CommonResult create(@RequestBody Payment payment)

{

int result = paymentService.create(payment);

log.info("*****插入结果:"+result);

if(result > 0)

{

return new CommonResult(200,"插入数据库成功,serverPort: "+serverPort,result);

}else{

return new CommonResult(444,"插入数据库失败",null);

}

}

@GetMapping(value = "/payment/get/{id}")

public CommonResult<Payment> getPaymentById(@PathVariable("id") Long id)

{

Payment payment = paymentService.getPaymentById(id);

if(payment != null)

{

return new CommonResult(200,"查询成功,serverPort: "+serverPort,payment);

}else{

return new CommonResult(444,"没有对应记录,查询ID: "+id,null);

}

}

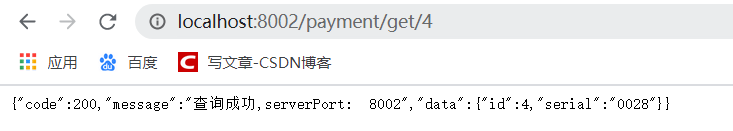

- 启动测试:

- http://eureka7002.com:7001/

- http://eureka7002.com:7002/

- http://localhost:8001/payment/get/4

- http://localhost:8002/payment/get/4

- http://localhost/consumer/payment/get/4

- 80的访问需要加上@LoadBalanced注解,否则会报错,因为服务不知道调用哪个

- http://localhost/consumer/payment/get/4

- 修改服务主机名和ip在eureka的web上显示与及鼠标一上去显示ip

- 比如修改payment模块 :

eureka:

client:

#表示是否将自己注册进EurekaServer默认为true。

register-with-eureka: true

#是否从EurekaServer抓取已有的注册信息,默认为true。单节点无所谓,集群必须设置为true才能配合ribbon使用负载均衡

fetchRegistry: true

service-url:

# 单击版

# defaultZone: http://localhost:7001/eureka

# 集群版

defaultZone: http://eureka7001.com:7001//eureka,http://eureka7002.com:7002//eureka

instance: #新加的

instance-id: payment8002 #新加的

prefer-ip-address: true #新加的

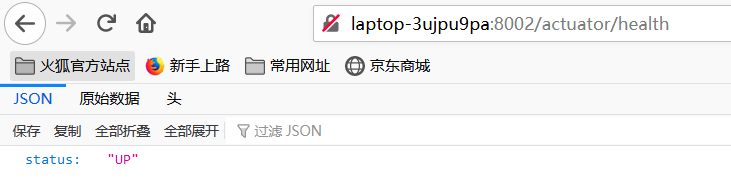

- 点击即可跳转到安全监控信息

- eureka服务发现:(向外暴露微服务信息)

- 向外暴露接口

@Resource

private DiscoveryClient discoveryClient;

@GetMapping(value = "/payment/discovery")

public Object discovery() {

List<String> services = discoveryClient.getServices();//拿到所有的注册信息

for (String element : services) {

log.info("*****element: " + element);

}

List<ServiceInstance> instances = discoveryClient.getInstances("CLOUD-P服务名所有的注册信息

for (ServiceInstance instance : instances) {

log.info(instance.getServiceId() + "\t" + instance.getHost() + "\t" + instance.getPort() + "\t" + instance.getUri());

}

return this.discoveryClient;

}

@SpringBootApplication

@EnableEurekaClient

@EnableDiscoveryClient

public class PaymentMain8001 //主启动类

{

public static void main(String[] args) {

SpringApplication.run(PaymentMain8001.class, args);

}

}

-

http://localhost:8001/payment/discovery

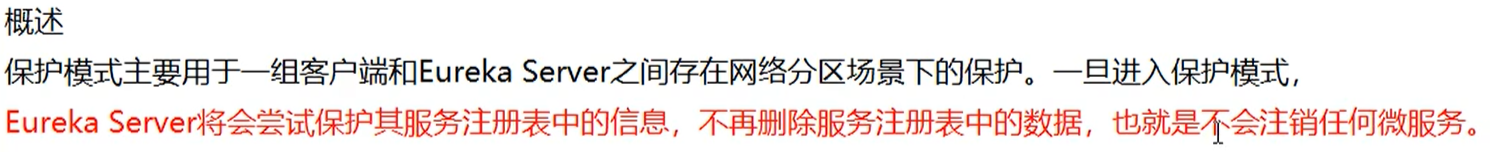

- Eureka自我保护(好死不如赖活着)

一句话:某时刻某一个微服务不可用了,Eureka不会立刻清理,依旧会对该微服务的信息进行保存

- Eureka自我保护(好死不如赖活着)

- 关闭7001的自我保护机制(改回单击模式玩)

#cloud-eureka-server7001

eureka:

instance:

hostname: eureka7001.com #eureka服务端的实例名称

client:

register-with-eureka: false #false表示不向注册中心注册自己。

fetch-registry: false #false表示自己端就是注册中心,我的职责就是维护服务实例,并不需要去检索服务

service-url:

# 单击版

defaultZone: http://eureka7001.com:7001//eureka

# 集群版 集群指向其它eureka

# defaultZone: http://eureka7002.com:7002//eureka

server:

#关闭自我保护机制,保证不可用服务被及时踢除

enable-self-preservation: false

eviction-interval-timer-in-ms: 2000

#cloud-provider-payment8001

instance:

instance-id: payment8001

prefer-ip-address: true

#客户端向服务端发送的时间间隔单位为秒(默认30秒)

lease-renewal-interval-in-seconds: 1

# 服务端在收到最后一次心跳所等的上限时间,超时剔除服务(默认90秒)

lease-expiration-duration-in-seconds: 2

此时启动erueka和payment8001.此时如果直接关闭了payment8001,那么erueka会直接删除其注册信息

Zookeeper服务注册与发现:

- Zookeeper替换Eureka

- Zookeeper是什么

Zookeeper是一个分布式协调工具,可以实现注册中心功能

关闭Linux服务器防火墙后,启动Zookeeper服务器,Zookeeper服务器取代Eureka服务器,zk作为服务注册中心。

搭建Zookeeper注册中心

cloud-provider-payment8004注册进Zookeeper

- 在linux用docker启动Zookeeper

- 健cloud-provider-payment8004模块

引入依赖

<dependencies>

<!-- SpringBoot整合Web组件 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency><!-- 引入自己定义的api通用包,可以使用Payment支付Entity -->

<groupId>com.atguigu.springboot</groupId>

<artifactId>cloud-api-commons</artifactId>

<version>${project.version}</version>

</dependency>

<!-- SpringBoot整合zookeeper客户端 -->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-zookeeper-discovery</artifactId>

<!--先排除自带的zookeeper3.5.3-->

<exclusions>

<exclusion>

<groupId>org.apache.zookeeper</groupId>

<artifactId>zookeeper</artifactId>

</exclusion>

</exclusions>

</dependency>

<!--添加zookeeper3.4.9版本-->

<dependency>

<groupId>org.apache.zookeeper</groupId>

<artifactId>zookeeper</artifactId>

<version>3.4.9</version>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

主启动类 ,创建order消费模块注册到zk

@SpringBootApplication

@EnableDiscoveryClient //该注解用于向使用consul或者zookeeper作为注册中心时注册服务

public class

{

public static void main(String[] args) {

SpringApplication.run(PaymentMain8004.class, args);

}

}

配置文件

#8004表示注册到zookeeper服务器的支付服务提供者端口号

server:

port: 8004

#服务别名----注册zookeeper到注册中心名称

spring:

application:

name: cloud-provider-payment

cloud:

zookeeper:

connect-string: 192.168.1.106:2181

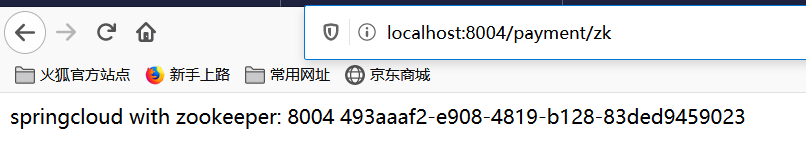

控制层

package com.atguigu.springcloud.controller;

@RestController

@Slf4j

public class PaymentController

{

@Value("${server.port}")

private String serverPort;

@RequestMapping(value = "/payment/zk")

public String paymentzk()

{

return "springcloud with zookeeper: "+serverPort+"\t"+ UUID.randomUUID().toString();

}

}

- http://localhost:8004/payment/zk

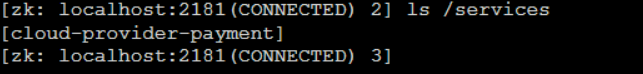

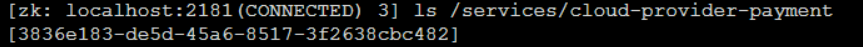

- 进入docker查看

- docker ps查看zk的容器id

- docker exec -it 容器id /bin/bash进入内部

- 进入bin执行 ./zkCli.sh, 后查看服务ls /services

- 查看流水号ls /services/cloud-provider-payment

- 查看基本信息 get /services/cloud-provider-payment/3836e183-de5d-45a6-8517-3f2638cbc482

思考

服务已经成功注册到Zookeeper客户端,那么注册上去的节点被称为临时节点,还是持久节点?

首先Eureka有自我保护机制,也就是某个服务下线后,不会立刻清除该服务,而是将服务保留一段时间

Zookeeper也一样在服务下线后,会等待一段时间后,也会把该节点删除,这就说明Zookeeper上的节点是临时节点。

cloud-consumerzk-order80注册进Zookeeper

- 创建module

- 引入依赖

<dependencies>

<!-- SpringBoot整合Web组件 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<!-- SpringBoot整合zookeeper客户端 -->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-zookeeper-discovery</artifactId>

<!--先排除自带的zookeeper-->

<exclusions>

<exclusion>

<groupId>org.apache.zookeeper</groupId>

<artifactId>zookeeper</artifactId>

</exclusion>

</exclusions>

</dependency>

<!--添加zookeeper3.4.9版本-->

<dependency>

<groupId>org.apache.zookeeper</groupId>

<artifactId>zookeeper</artifactId>

<version>3.4.9</version>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

- 创建主启动类

@SpringBootApplication

@EnableDiscoveryClient

public class OrderZKMain80

{

public static void main(String[] args) {

SpringApplication.run(OrderZKMain80.class, args);

}

}

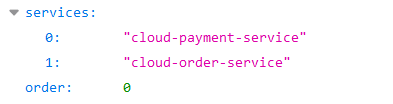

3.配置yaml

server:

port: 80

spring:

application:

name: cloud-consumer-order

cloud:

#注册到zookeeper地址

zookeeper:

connect-string: 192.168.1.106:2181

Consul

简介官网

Consul是一套开源的分布式服务发现和配置管理系统,由HashiCorp公司用Go语言开发

提供了微服务系统中的服务治理、配置中心、控制总线等功能,这些功能中的每一个都可以根据需要单独使用,也可以一起使用构建全方位的服务网路,总之Consul提供了一种完整的服务网络解决方案。

它具有很多优点,包括:基于raft协议,比较简洁;支持健康检查,同时支持HTTP和DNS协议,支持跨数据中心的WAN集群,提供图形化界面,跨平台,支持Linux,MAC,Windows

安装Consul

- 到https://www.consul.io/downloads.html下载

- 解压后cmd就到加压后的目录,consul --version可查看版本

- consul agent -dev启动访问即可----http://localhost:8500/ui/dc1/services

创建cloud-providerconsul-payment8006模块

- 引入依赖

<dependencies>

<!-- 引入自己定义的api通用包,可以使用Payment支付Entity -->

<dependency>

<groupId>com.atguigu.springboot</groupId>

<artifactId>cloud-api-commons</artifactId>

<version>${project.version}</version>

</dependency>

<!--SpringCloud consul-server -->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-consul-discovery</artifactId>

</dependency>

<!-- SpringBoot整合Web组件 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<!--日常通用jar包配置-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

<dependency>

<groupId>cn.hutool</groupId>

<artifactId>hutool-all</artifactId>

<version>RELEASE</version>

<scope>test</scope>

</dependency>

<dependency>

<groupId>cn.hutool</groupId>

<artifactId>hutool-all</artifactId>

<version>RELEASE</version>

<scope>test</scope>

</dependency>

</dependencies>

- 主启动类

@SpringBootApplication

@EnableDiscoveryClient

public class PaymentMain8006

{

public static void main(String[] args) {

SpringApplication.run(PaymentMain8006.class, args);

}

}

- 配置文件

###consul服务端口号

server:

port: 8006

spring:

application:

name: consul-provider-payment

####consul注册中心地址

cloud:

consul:

host: localhost

port: 8500

discovery:

#hostname: 127.0.0.1

service-name: ${spring.application.name}

- controller

package com.atguigu.springcloud.controller;

@RestController

@Slf4j

public class PaymentController

{

@Value("${server.port}")

private String serverPort;

@RequestMapping(value = "/payment/consul")

public String paymentConsul()

{

return "springcloud with consul: "+serverPort+"\t "+ UUID.randomUUID().toString();

}

}

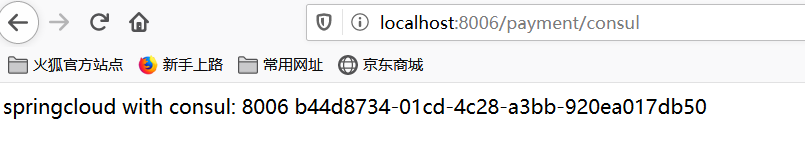

- 测试访问-----http://localhost:8500/ui/dc1/services(下图看出已经注册进去)

http://localhost:8006/payment/consul

创建cloud-consumerconsul-order80模块

- 引入依赖

<dependencies>

<!--SpringCloud consul-server -->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-consul-discovery</artifactId>

</dependency>

<!-- SpringBoot整合Web组件 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<!--日常通用jar包配置-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

- 配置yaml

###consul服务端口号 cloud-consumerconsul-order80

server:

port: 80

spring:

application:

name: cloud-consumer-order

####consul注册中心地址

cloud:

consul:

host: localhost

port: 8500

discovery:

#hostname: 127.0.0.1

service-name: ${spring.application.name}

- 主启动类

@SpringBootApplication

@EnableDiscoveryClient //该注解用于向使用consul或者zookeeper作为注册中心时注册服务

public class OrderConsulMain80

{

public static void main(String[] args) {

SpringApplication.run(OrderConsulMain80.class, args);

}

}

- config

package com.atguigu.springcloud.config;

@Configuration

public class ApplicationContextConfig

{

@Bean

@LoadBalanced

public RestTemplate getRestTemplate()

{

return new RestTemplate();

}

}

- controller

package com.atguigu.springcloud.controller;

@RestController

@Slf4j

public class OrderConsulController

{

public static final String INVOKE_URL = "http://consul-provider-payment";

@Resource

private RestTemplate restTemplate;

@GetMapping(value = "/consumer/payment/consul")

public String paymentInfo()

{

String result = restTemplate.getForObject(INVOKE_URL+"/payment/consul",String.class);

return result;

}

}

- 测试,像cloud-consumerconsul-order80一样测试即可

http://localhost/consumer/payment/consul

http://localhost:8500/ui/dc1/services

总结

| 组件名 | 语言 | 健康检查 | 对外暴露接口 | CAP | Spring Clou集成 |

|---|---|---|---|---|---|

| Eureka | Java | 可配支持 | HTTP | AP | 已集成 |

| Consul | Go | 支持 | HTTP/DNS | CP | 已集成 |

| Zookeeper | Java | 支持 | 客户端 | CP | 已集成 |

CAP理论

Availability:高可用

Consistency:强一致性

Partition Tolerance:分区容错性

CAP理论关注粒度是数据,而不是整体系统设计的策略

因此现在的微服务架构要么是 CP 要么是 AP,也就是P一定需要保证,最多只能较好的同时满足两个

CAP理论的核心:一个分布式系统不可能同时很好的满足:一致性,可用性和分区容错性这个三个需求

因此,根据CAP原理将NoSQL数据库分成了满足CA原则,满足CP原则,满足AP的三大类

- CA:单点集群,满足一致性,可用性的系统,通常在可扩展性上不太满足

- CP:满足一致性,分区容错性,通常性能不是特别高

- AP:满足可用性,分区容错性,通常对一致性要求低一些

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-LPLHdAfO-1592895378078)(images/image-20200408101128947.png)]](https://img-blog.csdnimg.cn/2020062314575678.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

部分情况下,我们对数据一致性的要求没有这么高,比如蘑菇博客的点赞和浏览记录,都是每隔一段时间才写入数据库的。

AP架构

Eureka是AP架构

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-yHLtUrYn-1592895378080)(images/image-20200408101854416.png)]](https://img-blog.csdnimg.cn/20200623150112586.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

因为同步原因出现问题,而造成数据没有一致性

当出现网络分区后,为了保证高可用,系统B可以返回旧值,保证系统的可用性

结论:违背了一致性C的要求,只满足可用性和分区容错性,即AP

CP架构

Zookeeper和Consul是CP架构

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-a9lCmyti-1592895378081)(images/image-20200408102120317.png)]](https://img-blog.csdnimg.cn/20200623150340137.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

当出现网络分区后,为了保证一致性,就必须拒绝请求,否者无法保证一致性

结论:违背了可用性A的要求,只满足一致性和分区容错性,即CP

Ribbon实现负载均衡

Ribbon目前已经进入了维护模式,但是目前主流还是使用Ribbon

Spring Cloud想通过LoadBalancer用于替换Ribbon

概念

Spring Cloud Ribbon是基于Netflix Ribbon实现的一套客户端,负载均衡的工具

简单的说,Ribbon是NetFlix发布的开源项目,主要功能是提供客户端的软件负载均衡算法和服务调用。Ribbon客户端组件提供了一系列完善的配置项如连接超时,重试等。简单的说,就是在配置文件中列出Load Balancer(简称LB)后面所有的机器,Ribbon会自动的帮助你基于某种规则(如简单轮询,随机连接等)去连接这些机器。我们很容易使用Ribbon实现自定义的负载均衡算法。

LB负载均衡是什么

Load Balance,简单来说就是将用户的请求平摊的分配到多个服务上,从而达到系统的HA(高可用)。常见的负载均衡有软件Nginx,LVS,硬件F5等。

- 集中式LB:即在服务的消费方和提供方之间使用独立的LB设施(可以是硬件,如F5,也可以是软件,如Nginx),由该设施负责把访问请求通过某种策略转发至服务的提供方

- 进程内LB:将LB逻辑集成到消费方,消费方从服务注册中心获知有哪些地址可用,然后自己再从这些地址中选择出一个合适的服务器。Ribbon就属于进程内LB,它只是一个类库,集成于消费方进程,消费方通过它来获取到服务提供方的地址。

Ribbon本地负载均衡客户端 VS Nginx服务端负载均衡

Nginx是服务器负载均衡,客户端所有的请求都会交给nginx,然后由nginx实现转发请求,即负载均衡是由服务端实现的。

Ribbon本地负载均衡,在调用微服务接口的时候,会在注册中心上获取注册信息服务列表之后,缓存到JVM本地,从而在本地实现RPC远程调用的技术。

一句话就是:RIbbon = 负载均衡 + RestTemplate调用

Ribbon工作原理

Ribbon其实就是一个软负载均衡的客户端组件,它可以和其它所需请求的客户端结合使用,和Eureka结合只是其中的一个实例。

Ribbon在工作时分成两步

- 首先先选择EurekaServer,它优先选择在同一个区域内负载较少的Server

- 再根据用户的指定的策略,从Server取到服务注册列表中选择一个地址

- 其中Ribbon提供了多种策略:比如轮询,随机和根据响应时间加权

引入Ribbon

新版的Eureka已经默认引入Ribbon了,不需要额外引入

<!--Eureka客户端-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-0cCxsdAw-1592897124451)(images/image-20200408105549983.png)]](https://img-blog.csdnimg.cn/20200623153313224.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

RestTemplate–官网

主要方法为:

- reseTemplate.getForObject

- reseTemplate.posttForObject

@GetMapping("/consumer/payment/create")

public CommonResult<Payment> create(Payment payment) {

return restTemplate.postForObject(PAYMENT_URL + "/payment/create", payment, CommonResult.class);

}

@GetMapping("/consumer/payment/get/{id}")

public CommonResult<Payment> getPayment(@PathVariable("id") Long id) {

return restTemplate.getForObject(PAYMENT_URL + "/payment/get/" + id, CommonResult.class);

}

@GetMapping("/consumer/payment/getForEntity/{id}") //与上一接口一样效果

public CommonResult<Payment> getPayment2(@PathVariable("id") Long id) {

ResponseEntity<CommonResult> entity = restTemplate.getForEntity(PAYMENT_URL + "/payment/get/" + id, CommonResult.class);

if (entity.getStatusCode().is2xxSuccessful()) {

// entity.getHeaders();entity.getStatusCodeValue();

return entity.getBody();

} else {

return new CommonResult<>(444, "操作失败");

}

Ribbon核心组件IRule

Ribbon默认是使用轮询作为负载均衡算法

IRule根据特定算法从服务列表中选取一个要访问的服务,IRule是一个接口

public interface IRule {

Server choose(Object var1);

void setLoadBalancer(ILoadBalancer var1);

ILoadBalancer getLoadBalancer();

}

然后对该接口,进行特定的实现

负载均衡算法

IRule的实现主要有以下七种

- RoundRobinRule:轮询

- RandomRule:随机

- RetryRUle:先按照RoundRobinRule的策略获取服务,如果获取服务失败则在指定时间内会进行重试,获取可用服务

- WeightedResponseTimeRule:对RoundRobinRule的扩展,响应速度越快的实例选择的权重越大,越容易被选择

- BestAvailableRule:会先过滤掉由于多次访问故障而处于短路跳闸状态的服务,然后选择一个并发量最小的服务

- AvailabilityFilteringRule:先过滤掉故障实例,在选择并发较小的实例

- ZoneAvoidanceRule:默认规则,符合判断server所在区域的性能和server的可用性选择服务器

默认负载均衡算法替换

官网警告:自定义的配置类不能放在@ComponentScanner所扫描的当前包下以及子包下,否者我们自定义的这个配置类就会被所有的Ribbon客户端所共享,达不到特殊化定制的目的了。eg:

- 然后我们创建自定义Rule接口

package com.atguigu.myrule;

@Configuration

public class MySelfRule

{

@Bean

public IRule myRule()

{

return new RandomRule();//定义为随机

}

}

- 主启动类

@SpringBootApplication

@EnableEurekaClient

@RibbonClient(name="CLOUD-PAYMENT-SERVICE",configuration = MySelfRule.class)

public class OrderMain80 {

public static void main(String[] args) {

SpringApplication.run(OrderMain80.class, args);

}

}

手写Ribbon负载均衡算法

原理

负载均衡算法:rest接口第几次请求数 % 服务器集群总数量 = 实际调用服务器位置下标,每次服务重启后rest接口计数从1开始。

假设现在有2台机器,同时 List = 2 instance(也就是服务注册列表中,有两台)

1 % 2 = 1 -> index = list.get(1)

2 % 2 = 0 -> index = list.get(0)

3 % 2 = 1 -> index = list.get(1)

....

这就是轮询的原理,即

](https://img-blog.csdnimg.cn/20200623213917957.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

我们查看RandomRule的源码发现,其实内部就是利用的取余的技术,同时为了保证同步机制,还是使用了AtomicInteger原子整型类

public class RandomRule extends AbstractLoadBalancerRule {

public RandomRule() {

}

@SuppressWarnings({"RCN_REDUNDANT_NULLCHECK_OF_NULL_VALUE"})

public Server choose(ILoadBalancer lb, Object key) {

if (lb == null) {

return null;

} else {

Server server = null;

while(server == null) {

if (Thread.interrupted()) {

return null;

}

List<Server> upList = lb.getReachableServers();

List<Server> allList = lb.getAllServers();

int serverCount = allList.size();

if (serverCount == 0) {

return null;

}

int index = this.chooseRandomInt(serverCount);

server = (Server)upList.get(index);

if (server == null) {

Thread.yield();

} else {

if (server.isAlive()) {

return server;

}

server = null;

Thread.yield();

}

}

return server;

}

}

protected int chooseRandomInt(int serverCount) {

return ThreadLocalRandom.current().nextInt(serverCount);

}

public Server choose(Object key) {

return this.choose(this.getLoadBalancer(), key);

}

public void initWithNiwsConfig(IClientConfig clientConfig) {

}

}

RoundRobinRule

public Server choose(ILoadBalancer lb, Object key) {

if (lb == null) {

log.warn("no load balancer");

return null;

}

Server server = null;

int count = 0;

while (server == null && count++ < 10) {

List<Server> reachableServers = lb.getReachableServers();

List<Server> allServers = lb.getAllServers();

int upCount = reachableServers.size();

int serverCount = allServers.size();

if ((upCount == 0) || (serverCount == 0)) {

log.warn("No up servers available from load balancer: " + lb);

return null;

}

int nextServerIndex = incrementAndGetModulo(serverCount);

server = allServers.get(nextServerIndex);

if (server == null) {

/* Transient. */

Thread.yield();

continue;

}

if (server.isAlive() && (server.isReadyToServe())) {

return (server);

}

// Next.

server = null;

}

if (count >= 10) {

log.warn("No available alive servers after 10 tries from load balancer: "

+ lb);

}

return server;

}

手写负载均衡算法

原理 + JUC(CAS+自旋锁)

- 在cloud-provider-payment8001和cloud-provider-payment8002的controller加上:

@GetMapping(value = "/payment/lb")

public String getPaymentLB()

{

return serverPort;

}

- 首先需要在RestTemplate的配置上将 @LoadBalanced注解删除

- 编写接口

package com.atguigu.springclound.lb;

public interface LoadBalancer {

// 获取注册的一个实例

ServiceInstance instances(List<ServiceInstance> serviceInstances);

}

- 编写实现类

package com.atguigu.springclound.lb;

@Component

public class MyLB implements LoadBalancer

{

private AtomicInteger atomicInteger = new AtomicInteger(0);

public final int getAndIncrement()

{

int current;

int next;

do {

current = this.atomicInteger.get();

next = current >= 2147483647 ? 0 : current + 1;

}while(!this.atomicInteger.compareAndSet(current,next));

System.out.println("*****第几次访问,次数next: "+next);

return next;

}

//负载均衡算法:rest接口第几次请求数 % 服务器集群总数量 = 实际调用服务器位置下标 ,每次服务重启动后rest接口计数从1开始。

@Override

public ServiceInstance instances(List<ServiceInstance> serviceInstances)

{

int index = getAndIncrement() % serviceInstances.size();

return serviceInstances.get(index);

}

}

- 在com.atguigu.springclound.controller.OrderController注入LoadBalancer

@Resource

private LoadBalancer loadBalancer;

5.继续编写com.atguigu.springclound.controller.OrderControlle

@Resource

private DiscoveryClient discoveryClient;

@GetMapping(value = "/consumer/payment/lb")

public String getPaymentLB()

{

List<ServiceInstance> instances = discoveryClient.getInstances("CLOUD-PAYMENT-SERVICE");

if(instances == null || instances.size() <= 0)

{

return null;

}

ServiceInstance serviceInstance = loadBalancer.instances(instances);

URI uri = serviceInstance.getUri();

return restTemplate.getForObject(uri+"/payment/lb",String.class);

}

- 测试即可:(结果即是轮询)

OpenFeign实现服务调用

关于Feign的停更,目前已经使用OpenFeign进行替换

概述

Feign是一个声明式WebService客户端。使用Feign能让编写WebService客户端更加简单。OpenFeign->Github

它的使用方法是定义一个服务接口然后在上面添加注解。Feign也支持可插拔式的编码和解码器。Spring Cloud对feign进行了封装,使其支持了Spring MVC标准注解和HttpMessageConverters。Feign可以与Eureka和Ribbon组合使用以支持负载均衡。

Feign的作用

Feign旨在使编写Java Http客户端变得更容易。

前面在使用Ribbon + RestTemplate时,利用RestTemplate对http请求的封装处理,形成了一套模板化的调用方法。但是在实际开发中,由于对服务依赖的调用可能不止一处,往往一个接口会被多处调用,所以通常都会针对每个微服务自行封装一些客户端来包装这些依赖,所以Feign在这个基础上做了进一步封装,由他来帮助我们定义和实现依赖服务的接口定义。在Feign的实现下,我们只需要创建一个接口,并使用注解的方式来配置它(以前是Dao接口上面标注Mapper注解,现在是微服务接口上标注一个Feign注解),即可完成服务提供方的接口绑定,简化了使用Spring Cloud Ribbon时,自动封装服务调用客户端的开发量。

Feign集成Ribbon

利用Ribbon维护了Payment的服务列表信息,并且通过轮询实现了客户端的负载均衡。而与Ribbon不同的是,通过Feign只需要定义服务绑定接口且声明式的方法,优雅而简单的实现了服务调用。

Feign和OpenFeign的区别

| Feign | OpenFeign |

|---|---|

| Feign是Spring Cloud组件中的一种轻量级RestFul的HTTP服务客户端,Feign内置了Ribbon,用来做客户端的负载均衡,去调用服务注册中心的服务,Feign的使用方式是:使用Feign的注解定义接口,调用这个接口,就可以调用服务注册中心的服务 | OpenFeign是Spring Cloud 在Feign的基础上支持了SpringMVC的注解,如@RequestMapping等等,OpenFeign的@FeignClient可以解析SpringMVC的@RequestMapping注解下的接口,并通过动态代理的方法生产实现类,实现类中做均衡并调用其它服务 |

| spring-cloud-starter-feign | spring-cloud-starter-openfeign |

OpenFeign使用步骤

1.引入依赖

<!--openfeign-->

<dependencies>

<!--openfeign-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-openfeign</artifactId>

</dependency>

<!--eureka client-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

<!-- 引入自己定义的api通用包,可以使用Payment支付Entity -->

<dependency>

<groupId>com.atguigu.springcloud</groupId>

<artifactId>cloud-api-commons</artifactId>

<version>${project.version}</version>

</dependency>

<!--web-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<!--一般基础通用配置-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

2.配置yml

server:

port: 80

eureka:

client:

register-with-eureka: false

service-url:

defaultZone: http://eureka7001.com:7001/eureka/,http://eureka7002.com:7002/eureka/

3.主启动类

@SpringBootApplication

@EnableFeignClients

public class OrderFeignMain80

{

public static void main(String[] args) {

SpringApplication.run(OrderFeignMain80.class, args);

}

}

4.service

package com.atguigu.springcloud.service;

@Component

@FeignClient(value = "CLOUD-PAYMENT-SERVICE")

public interface PaymentFeignService {

@GetMapping(value = "/payment/get/{id}")

public CommonResult<Payment> getPaymentById(@PathVariable("id") Long id)

5.controller

package com.atguigu.springcloud.controller;

@RestController

@Slf4j

public class OrderFeignController {

@Resource

private PaymentFeignService paymentFeignService;

@GetMapping(value = "/consumer/payment/get/{id}")

public CommonResult<Payment> getPaymentById(@PathVariable("id") Long id)

{

return paymentFeignService.getPaymentById(id);

}

}

6.测试

- 先启动2个Eureka集群7001、7002

- 在启动俩个微服务8001、8002

- 启动OpenFegn

- http://localhost/consumer/payment/get/4

图解

OpenFeign的超时控制

服务提供者需要超过3秒才能返回数据,但是服务调用者默认只等待1秒,这就会出现超时问题。

制造超时效果

1. cloud-provider-payment8001

//package com.atguigu.springcloud.controller;

@GetMapping(value = "/payment/feign/timeout")

public String paymentFeignTimeout()

{

// 业务逻辑处理正确,但是需要耗费3秒钟

try { TimeUnit.SECONDS.sleep(3); } catch (InterruptedException e) { e.printStackTrace(); }

return serverPort;

}

2. cloud-consumer-feign-order80

//package com.atguigu.springcloud.service;

@GetMapping(value = "/payment/feign/timeout")

public String paymentFeignTimeout();

//package com.atguigu.springcloud.controller;

@GetMapping(value = "/consumer/payment/feign/timeout")

public String paymentFeignTimeout()

{

// OpenFeign客户端一般默认等待1秒钟

return paymentFeignService.paymentFeignTimeout();

}

3.测试

http://localhost/consumer/payment/feign/timeout

这是因为默认Feign客户端只等待一秒钟,但是服务端处理需要超过3秒钟,导致Feign客户端不想等待了,直接返回报错,这个时候,消费方的OpenFeign就需要增大超时时间

cloud-consumer-feign-order80中的yml设置等待时间

server:

port: 80

eureka:

client:

register-with-eureka: false

service-url:

defaultZone: http://eureka7001.com:7001/eureka/,http://eureka7002.com:7002/eureka/

#设置feign客户端超时时间(OpenFeign默认支持ribbon)

ribbon:

#指的是建立连接所用的时间,适用于网络状况正常的情况下,两端连接所用的时间

ReadTimeout: 5000

#指的是建立连接后从服务器读取到可用资源所用的时间

ConnectTimeout: 5000

OpenFeign日志打印功能

概念

Feign提供了日志打印功能,我们可以通过配置来调整日志级别,从而了解Feign中Http请求的细节,说白了就是对Feign接口的调用情况进行监控和输出。

日志级别

- NONE:默认的,不显示任何日志

- BASIC:仅记录请求方法、URL、相应状态码以及执行时间

- HEADERS:除了BASIC中定义的信息之外,还有请求和响应头的信息

- FULL:除了HEADERS中定义的信息之外,还有请求和相应的正文及元数据

controller

package com.atguigu.springcloud.config;

//cloud-consumer-feign-order80

import feign.Logger;

@Configuration

public class FeignConfig

{

@Bean

Logger.Level feignLoggerLevel()

{

return Logger.Level.FULL;

}

}

修改YML文件

logging:

level:

# feign日志以什么级别监控哪个接口

com.atguigu.springcloud.service.PaymentFeignService: debug

测试-----下面控制台输出

2020-06-28 22:44:08.295 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] ---> GET http://CLOUD-PAYMENT-SERVICE/payment/get/4 HTTP/1.1

2020-06-28 22:44:08.295 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] ---> END HTTP (0-byte body)

2020-06-28 22:44:08.301 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] <--- HTTP/1.1 200 (6ms)

2020-06-28 22:44:08.301 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] connection: keep-alive

2020-06-28 22:44:08.301 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] content-type: application/json

2020-06-28 22:44:08.301 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] date: Sun, 28 Jun 2020 14:44:08 GMT

2020-06-28 22:44:08.301 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] keep-alive: timeout=60

2020-06-28 22:44:08.301 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] transfer-encoding: chunked

2020-06-28 22:44:08.301 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById]

2020-06-28 22:44:08.302 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] {"code":200,"message":"查询成功,serverPort: 8001","data":{"id":4,"serial":"0028"}}

2020-06-28 22:44:08.302 DEBUG 40576 --- [p-nio-80-exec-5] c.a.s.service.PaymentFeignService : [PaymentFeignService#getPaymentById] <--- END HTTP (87-byte body)

2020-06-28 22:45:18.013 INFO 40576 --- [trap-executor-0] c.n.d.s.r.aws.ConfigClusterResolver : Resolving eureka endpoints via configuration

Hystrix断路器

Hystrix官宣停更,官方推荐使用:resilence4j替换,同时国内Spring Cloud Alibaba 提出了Sentinel实现熔断和限流

概述

分布式面临的问题

复杂分布式体系结构中的应用程序有数十个依赖关系,每个依赖关系在某些时候将不可避免地失败(网络卡顿,网络超时)

服务雪崩

多个微服务之间调用的时候,假设微服务A调用微服务B和微服务C,微服务B和微服务C又调用其它的微服务,这就是所谓的“扇出”。如果扇出的链路上某个微服务的调用响应时间过长或者不可用,对微服务A的调用就会占用越来越多的系统资源,进而引起系统崩溃,所谓的 雪崩效应

对于高流量的应用来说,单一的后端依赖可能会导致所有服务器上的所有资源都在几秒钟内饱和。比失败更糟糕的是,这些应用程序还可能导致服务之间的延迟增加,备份队列,线程和其它系统资源紧张,导致整个系统发生更多的级联故障,这些都表示需要对故障和延迟进行隔离和管理,以便单个依赖关系的失败,不能取消整个应用程序或系统。

通常当你发现一个模块下的某个实例失败后,这时候这个模块依然还会接收流量,然后这个有问题的模块还调用了其他的模块,这样就会发生级联故障,或者叫雪崩

HyStrix的诞生

Hystrix是一个用于处理分布式系统的延迟和容错的开源库,在分布式系统里,许多依赖不可避免的会调用失败,比如超时,异常等,Hystrix能够保证在一个依赖出问题的情况下,不会导致整体服务失败,避免级联故障,以提高分布式系统的弹性。

断路器 本身是一种开关装置,当某个服务单元发生故障之后,通过断路器的故障监控(类似于熔断保险丝),向调用方返回一个符合预期的,可处理的备选响应(FallBack),而不是长时间的等待或者抛出调用方无法处理的异常,这样就保证了服务调用方的线程不会被长时间、不必要地占用,从而避免了故障在分布式系统中蔓延,乃至雪崩。

Hystrix作用

- 服务降级

- 服务熔断

- 接近实时的监控(Hystrix Dashboard)

- 。。。。

Hystrix重要概念

服务降级

fallback,假设对方服务不可用了,那么至少需要返回一个兜底的解决方法,即向服务调用方返回一个符合预期的,可处理的备选响应。

例如:服务繁忙,请稍后再试,不让客户端等待并立刻返回一个友好的提示,fallback

哪些情况会触发降级

- 程序运行异常

- 超时

- 服务熔断触发服务降级

- 线程池/信号量打满也会导致服务降级

服务熔断

break,类比保险丝达到了最大服务访问后,直接拒绝访问,拉闸断电,然后调用服务降级的方法并返回友好提示

一般过程:服务降级 -> 服务熔断 -> 恢复调用链路

服务限流

flowlimit,秒杀高并发等操作,严禁一窝蜂的过来拥挤,大家排队,一秒钟N个,有序进行

Hystrix案例

构建:cloud-provider-hystrix-payment8001

- 提示:将cloud-eureka-server7001改为单机版

1.引入依赖

<dependencies>

<!--hystrix-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-hystrix</artifactId>

</dependency>

<!--eureka client-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

<!--web-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<dependency><!-- 引入自己定义的api通用包,可以使用Payment支付Entity -->

<groupId>com.atguigu.springcloud</groupId>

<artifactId>cloud-api-commons</artifactId>

<version>${project.version}</version>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

2.yml配置

server:

port: 8001

spring:

application:

name: cloud-provider-hystrix-payment

eureka:

client:

register-with-eureka: true

fetch-registry: true

service-url:

#defaultZone: http://eureka7001.com:7001/eureka,http://eureka7002.com:7002/eureka

defaultZone: http://eureka7001.com:7001/eureka

3.启动类添加Hystrix注解

package com.atguigu.springcloud;

@SpringBootApplication

@EnableDiscoveryClient

public class PaymentHystrixMain8001 {

public static void main(String[] args) {

SpringApplication.run(PaymentHystrixMain8001.class, args);

}

}

4.Service层

package com.atguigu.springcloud.service;

import cn.hutool.core.util.IdUtil;

rvice

public class PaymentService

{

/**

* 正常访问,肯定OK

*/

public String paymentInfo_OK(Integer id)

{

return "线程池: "+Thread.currentThread().getName()+" paymentInfo_OK,id: "+id+"\t"+"O(∩_∩)O哈哈~";

}

public String paymentInfo_TimeOut(Integer id)

{

int timeNumber =3;

try { TimeUnit.SECONDS.sleep(3000); } catch (InterruptedException e) { e.printStackTrace(); }

return "线程池: "+Thread.currentThread().getName()+" id: "+id+"\t"+"O(∩_∩)O哈哈~"+" 耗时(秒): ";

}

}

5.Controller层

package com.atguigu.springcloud.controller;

@RestController

@Slf4j

public class PaymentController

{

@Resource

private PaymentService paymentService;

@Value("${server.port}")

private String serverPort;

@GetMapping("/payment/hystrix/ok/{id}")

public String paymentInfo_OK(@PathVariable("id") Integer id)

{

String result = paymentService.paymentInfo_OK(id);

log.info("*****result: "+result);

return result;

}

@GetMapping("/payment/hystrix/timeout/{id}")

public String paymentInfo_TimeOut(@PathVariable("id") Integer id)

{

String result = paymentService.paymentInfo_TimeOut(id);

log.info("*****result: "+result);

return result;

}

}

6.测试

- http://localhost:8001/payment/hystrix/ok/4

- http://localhost:8001/payment/hystrix/timeout/4

7.高并发测试------Jmete

- 官网下载zip包,解压即可用,找到bin下的jmeter.bat启动即可

- 使用说明

以上相当于2万个请求

我们会发现当线程多的时候,会直接卡死,甚至把其它正常的接口都已经拖累

这是因为我们使用20000个线程去访问那个延时的接口,这样会把该微服务的资源全部集中处理 延时接口,而导致正常的接口资源不够,出现卡顿的现象。

同时tomcat的默认工作线程数被打满,没有多余的线程来分解压力和处理。

服务消费者加入

构建:cloud-consumer-feign-hystrix-order80

1.引入依赖

<dependencies>

<!--openfeign-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-openfeign</artifactId>

</dependency>

<!--hystrix-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-hystrix</artifactId>

</dependency>

<!--eureka client-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

<!-- 引入自己定义的api通用包,可以使用Payment支付Entity -->

<dependency>

<groupId>com.atguigu.springcloud</groupId>

<artifactId>cloud-api-commons</artifactId>

<version>${project.version}</version>

</dependency>

<!--web-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<!--一般基础通用配置-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

2.yml配置

server:

port: 80

eureka:

client:

register-with-eureka: false

service-url:

defaultZone: http://eureka7001.com:7001/eureka/

3.主启动类—首先启动 hystrix,@EnableHystrix

package com.atguigu.springcloud;

@SpringBootApplication

@EnableFeignClients

public class OrderHystrixMain80

{

public static void main(String[] args)

{

SpringApplication.run(OrderHystrixMain80.class,args);

}

}

4.Service层

package com.atguigu.springcloud.service;

@Component

@FeignClient(value = "CLOUD-PROVIDER-HYSTRIX-PAYMENT" )

public interface PaymentHystrixService

{

@GetMapping("/payment/hystrix/ok/{id}")

public String paymentInfo_OK(@PathVariable("id") Integer id);

@GetMapping("/payment/hystrix/timeout/{id}")

public String paymentInfo_TimeOut(@PathVariable("id") Integer id);

}

5.Controller层

package com.atguigu.springcloud.controller;

@RestController

@Slf4j

public class OrderHystirxController

{

@Resource

private PaymentHystrixService paymentHystrixService;

@GetMapping("/consumer/payment/hystrix/ok/{id}")

public String paymentInfo_OK(@PathVariable("id") Integer id)

{

String result = paymentHystrixService.paymentInfo_OK(id);

return result;

}

@GetMapping("/consumer/payment/hystrix/timeout/{id}")

public String paymentInfo_TimeOut(@PathVariable("id") Integer id)

{

String result = paymentHystrixService.paymentInfo_TimeOut(id);

return result;

}

}

6.测试

- http://localhost/consumer/payment/hystrix/ok/4

- 压测再测

- 8001同一层次的其他接口服务被困死,因为tomcat线程里面的工作线程已经被挤占完毕,80此时调用8001,客户端访问响应缓慢,转圈圈

解决方案

原因

超时导致服务器变慢,超时不再等待

出错,宕机或者程序运行出错,出错要有兜底

解决

- 对方服务8001超时了,调用者80不能一直卡死等待,必须有服务降级

- 对方服务8001宕机了,调用者80不能一直卡死,必须有服务降级

- 对方服务8001正常,调用者自己出故障或者有自我要求(自己的等待时间小于服务提供者),自己处理降级

服务降级

使用新的注解 @HystrixCommand

同时需要在cloud-provider-hystrix-payment8001主启动类上新增:@EnableCircuiteBreaker

设置8001自身调用超时时间的峰值,峰值内可以正常运行,超过了需要有兜底的方法处理,作为服务降级fallback

package com.atguigu.springcloud.service;

/**

* 超时访问

*

* @param id

* @return

*/

@HystrixCommand(fallbackMethod = "paymentInfo_TimeOutHandler", commandProperties = {

@HystrixProperty(name = "execution.isolation.thread.timeoutInMilliseconds", value = "3000")

})

public String paymentInfo_TimeOut(Integer id) {

int timeNumber = 5;

try { TimeUnit.SECONDS.sleep(timeNumber); } catch (InterruptedException e) { e.printStackTrace();}

return "线程池:" + Thread.currentThread().getName() + " paymentInfo_TimeOut,id:" + id + "\t" +

"O(∩_∩)O哈哈~ 耗时(秒)";

}

/**

* 兜底的解决方案

* @param id

* @return

*/

public String paymentInfo_TimeOutHandler(Integer id){

return "线程池:" + Thread.currentThread().getName() + " 8001系统繁忙请稍后再试!!,id:" + id + "\t"+"我哭了!!";

}

上述的方法就是当在规定的3秒内没有完成,那么就会触发服务降级,返回一个兜底的解决方案

同时不仅是超时,假设服务内的方法出现了异常,也同样会触发兜底的解决方法,例如下面的代码,我们制造出一个除数为0的异常。

@HystrixCommand(fallbackMethod = "paymentInfo_TimeOutHandler", commandProperties = {

@HystrixProperty(name = "execution.isolation.thread.timeoutInMilliseconds", value = "3000")

})

public String paymentInfo_TimeOut(Integer id) {

int timeNumber = 10 / 0;

return "线程池:" + Thread.currentThread().getName() + " paymentInfo_TimeOut,id:" + id + "\t" +

"O(∩_∩)O哈哈~ 耗时(秒)";

}

上述说的是服务提供方的降级,服务消费者也需要设置服务降级的处理保护,也就是对客户端进行保护

也就是说服务降级,既可以放在客户端,也可以放在服务端,一般而言是放在客户端进行服务降级的

首先主启动类设置:@EnableHystrix(cloud-consumer-feign-hystrix-order80)

配置过的devtool热部署对java代码的改动明显,但是对@HystrixCommand内属性的修改建议重启微服务

然后修改yml开启hystrix

#cloud-consumer-feign-hystrix-order80

feign:

hystrix:

enabled: true

服务消费端降级

@GetMapping("/consumer/payment/hystrix/timeout/{id}")

@HystrixCommand(fallbackMethod = "paymentTimeOutFallbackMethod", commandProperties = {

@HystrixProperty(name = "execution.isolation.thread.timeoutInMilliseconds", value = "1500")

})

public String paymentInfo_TimeOut(@PathVariable("id") Integer id) {

return paymentHystrixService.paymentInfo_TimeOut(id);

}

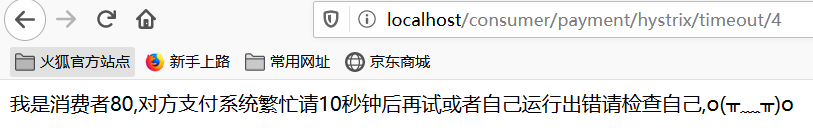

public String paymentTimeOutFallbackMethod(@PathVariable("id") Integer id)

{

return "我是消费者80,对方支付系统繁忙请10秒钟后再试或者自己运行出错请检查自己,o(╥﹏╥)o";

}

- 测试http://localhost/consumer/payment/hystrix/timeout/4

虽然服务方的业务处理逻辑需要三秒,但是服务方的峰值为5秒。但是消费方只愿等1.5秒,所以消费方调用自己的兜底方法

目前问题

目前异常处理的方法,和业务代码耦合,这就造成耦合度比较高

解决方法就是使用统一的服务降级方法

方法1:

除了个别重要核心业务有专属,其它普通的可以通过@DefaultProperties(defaultFallback = ""),这样通用的和独享的各自分开,避免了代码膨胀,合理减少了代码量

可以在Controller处设置 @DefaultProperties(defaultFallback = "payment_Global_FallbackMethod")

@RestController

@Slf4j

@DefaultProperties(defaultFallback = "payment_Global_FallbackMethod")

public class OrderHystrixController {

@GetMapping("/consumer/payment/hystrix/timeout/{id}")

@HystrixCommand // 这个方法也会走全局 fallback

public String paymentInfo_TimeOut(@PathVariable("id") Integer id) {

int age = 10/0; //方法前挂了,跟后面挂了两种

return paymentHystrixService.paymentInfo_TimeOut(id);

}

//下面是全局fallback方法

public String payment_Global_FallbackMethod(){

return "Global异常处理信息,请稍后再试,/(ㄒoㄒ)/~~";

}

}

- 测试:http://localhost/consumer/payment/hystrix/timeout/4

方法2:

我们现在还发现,兜底的方法 和 我们的业务代码耦合在一块比较混乱

我们可以在feign调用的时候,增加hystrix的服务降级处理的实现类,这样就可以进行解耦

格式:@FeignClient(fallback = PaymentFallbackService.class)

我们要面对的异常主要有

- 运行

- 超时

- 宕机

需要新建一个FallbackService实现类,然后通过实现类统一为feign接口里面的方法进行异常处理

feign接口

package com.atguigu.springcloud.service;

@Component

@FeignClient(value = "cloud-provider-hystrix-payment", fallback = PaymentFallbackService.class)

public interface PaymentHystrixService {

/**

* 正常访问

*

* @param id

* @return

*/

@GetMapping("/payment/hystrix/ok/{id}")

public String paymentInfo_OK(@PathVariable("id") Integer id);

/**

* 超时访问

*

* @param id

* @return

*/

@GetMapping("/payment/hystrix/timeout/{id}")

public String paymentInfo_TimeOut(@PathVariable("id") Integer id);

}

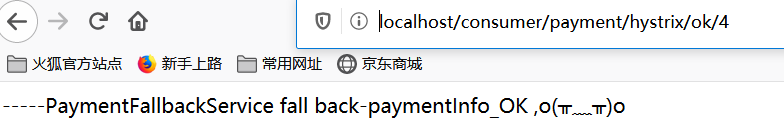

实现类

package com.atguigu.springcloud.service;

@Component

public class PaymentFallbackService implements PaymentHystrixService {

@Override

public String paymentInfo_OK(Integer id) {

return "--- PaymentFallbackService fall paymentInfo_OK vack ,/(ㄒoㄒ)/~~";

}

@Override

public String paymentInfo_TimeOut(Integer id) {

return "--- PaymentFallbackService fall paymentInfo_TimeOut, /(ㄒoㄒ)/~~";

}

}

这个时候,如果我们将服务提供方进行关闭,但是我们在客户端做了服务降级处理,让客户端在服务端不可用时,也会获得提示信息,而不会挂起耗死服务器

- 关闭服务端8001

服务熔断

服务熔断也是服务降级的一个 特例

熔断概念

熔断机制是应对雪崩效应的一种微服务链路保护机制,当扇出链路的某个微服务不可用或者响应时间太长时,会进行服务的降级,进而熔断该节点微服务的调用,快速返回错误的响应状态

当检测到该节点微服务调用响应正常后,恢复调用链路

在Spring Cloud框架里,熔断机制通过Hystrix实现,Hystrix会监控微服务间调用的状况,当失败的调用到一定的阈值,缺省是5秒内20次调用失败,就会启动熔断机制,熔断机制的注解还是 @HystrixCommand

来源,微服务提出者马丁福勒:详细内容

这个简单的断路器避免了在电路打开时进行保护调用,但是当情况恢复正常时需要外部干预来重置它。对于建筑物中的断路器,这是一种合理的方法,但是对于软件断路器,我们可以让断路器本身检测底层调用是否再次工作。我们可以通过在适当的间隔之后再次尝试protected调用来实现这种自重置行为,并在断路器成功时重置它

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-1Xkl0el0-1593569737556)(images/image-20200409095855788.png)]](https://img-blog.csdnimg.cn/20200701102332655.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

熔断器的三种状态:打开,关闭,半开

这里提出了 半开的概念,首先打开一半的,然后慢慢的进行恢复,最后在把断路器关闭

降级 -> 熔断 -> 恢复

这里我们在服务提供方 8001,增加服务熔断

这里有四个字段

// 是否开启断路器

@HystrixProperty(name = "circuitBreaker.enabled", value = "true"),

// 请求次数

@HystrixProperty(name = "circuitBreaker.requestVolumeThreshold", value = "10"),

// 时间窗口期/时间范文--多久恢复一>次尝试

@HystrixProperty(name = "circuitBreaker.sleepWindowInMilliseconds", value = "10000"),

// 失败率达到多少后跳闸

@HystrixProperty(name = "circuitBreaker.errorThresholdPercentage", value = "60")

首先是是否开启熔断器,然后是在一个时间窗口内,有60%的失败,那么就启动断路器,也就是10次里面,6次失败,完整代码如下:

Service

//cloud-provider-hystrix-payment8001

package com.atguigu.springcloud.service;

/**

* 在10秒窗口期中10次请求有6次是请求失败的,断路器将起作用

* @param id

* @return

*/

@HystrixCommand(

fallbackMethod = "paymentCircuitBreaker_fallback", commandProperties = {

@HystrixProperty(name = "circuitBreaker.enabled", value = "true"),// 是否开启断路器

@HystrixProperty(name = "circuitBreaker.requestVolumeThreshold", value = "10"),// 请求次数

@HystrixProperty(name = "circuitBreaker.sleepWindowInMilliseconds", value = "10000"),// 时间窗口期/时间范文

@HystrixProperty(name = "circuitBreaker.errorThresholdPercentage", value = "60")// 失败率达到多少后跳闸

}

)

public String paymentCircuitBreaker(@PathVariable("id") Integer id) {

if (id < 0) {

throw new RuntimeException("*****id不能是负数");

}

String serialNumber = IdUtil.simpleUUID();

return Thread.currentThread().getName() + "\t" + "调用成功,流水号:" + serialNumber;

}

Controller

package com.atguigu.springcloud.controller;

//====服务熔断

@GetMapping("/payment/circuit/{id}")

public String paymentCircuitBreaker(@PathVariable("id") Integer id)

{

String result = paymentService.paymentCircuitBreaker(id);

log.info("****result: "+result);

return result;

}

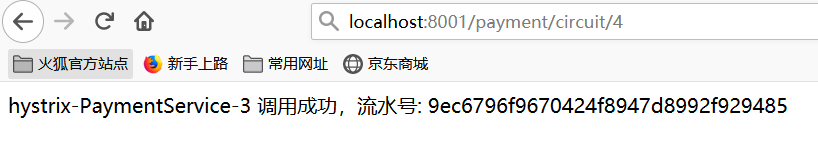

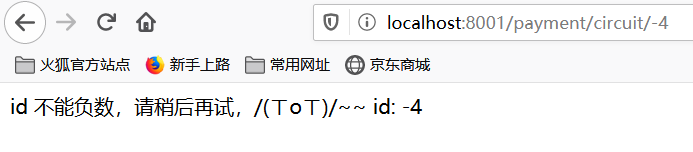

- localhost:8001/payment/circuit/4

- http://localhost:8001/payment/circuit/-4

当然狂发错误请求的时候,错误率到达60%以上,闸门打开,即使是正确的请求,也会调用回调,不会走主逻辑

当断路器被打开的时候,即使是正确的请求,该方法也会被断路

总结

熔断类型

- 熔断打开:请求不再进行调用当前服务,内部设置时钟一般为MTTR(平均故障处理时间),当打开时长达所设时钟则进入半熔断状态

- 熔断关闭:熔断关闭不会对服务进行熔断

- 熔断半开:部分请求根据规则调用当前服务,如果请求成功且符合规则,则认为当前服务恢复正常,关闭熔断

断路器启动条件

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-uYwlQdbL-1593579104974)(images/image-20200409114527145.png)]](https://img-blog.csdnimg.cn/20200701125306150.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

涉及到断路器的三个重要参数:快照时间窗,请求总阈值,错误百分比阈值

- 快照时间窗:断路器确定是否打开需要统计一些请求和错误数据,而统计的时间范围就是快照时间窗,默认为最近的10秒。

- 请求总数阈值:在快照时间窗口内,必须满足请求总数阈值才有资格熔断。默认为20,意味着在10秒内,如果hystrix的调用总次数不足20次,即使所有请求都超时或者其他原因失败,断路器都不会打开。

- 错误百分比阈值:当请求总数在快照时间窗内超过了阈值,比如发生了30次调用,并且有15次发生了超时异常,也就是超过了50的错误百分比,在默认设定的50%阈值情况下,这时候就会将断路器打开

开启和关闭的条件

- 当满足一定阈值的时候(默认10秒内超过20个请求)

- 当失败率达到一定的时候(默认10秒内超过50%的请求失败)

- 到达以上阈值,断路器将会开启

- 当开启的时候,所有请求都不会进行转发

- 一段时间之后(默认是5秒),这个时候断路器是半开状态,会让其中一个请求进行转发。如果成功,断路器会关闭,若失败,继续开启,重复4和5

断路器开启后

- 再有请求调用的时候,将不会调用主逻辑,而是直接调用降级fallback,通过断路器,实现了自动的发现错误并将降级逻辑切换为主逻辑,减少相应延迟的效果。

- 原来的主逻辑如何恢复?

- 对于这个问题,Hystrix实现了自动恢复功能,当断路器打开,对主逻辑进行熔断之后,hystrix会启动一个休眠时间窗,在这个时间窗内,降级逻辑是临时的成为主逻辑,当休眠时间窗到期,断路器将进入半开状态,释放一次请求到原来的主逻辑上,如果此次请求正常返回,断路器将继续闭合,主逻辑恢复,如果这次请求依然有问题,断路器继续保持打开状态,休眠时间窗重新计时。

服务限流

后面讲解Sentinel的时候进行说明

Hystrix工作流程

蓝色:调用路径

红色:返回路径

完整的请求路线:

- 选择一个Hystrix注册方式

- 二选一即可

- 判断缓存中是否包含需要返回的内容(如果有直接返回)

- 断路器是否为打开状态(如果是,直接跳转到8,返回)

- 断路器为健康状态,判断是否有可用资源(没有,直接跳转8)

- 构造方法和Run方法

- 将正常,超时,异常的消息发送给断路器

- 调用getFallback方法,也就是服务降级

- 无异直接返回正确结果

服务监控HystrixDashboard

概述

除了隔离依赖服务的调用以外,Hystrix还提供了准实时的调用监控(Hystrix Dashboard),Hystrix会持续地记录所有通过Hystrix发起的请求的执行信息,并以统计报表和图形化的形式展示给用户,包括每秒执行多少请求,成功多少请求,失败多少,Netflix通过Hystrix-metrics-event-stream项目实现了对以上指标的监控,SpringCloud也提供了HystrixDashboard整合,对监控内容转化成可视化页面

搭建

1.引入依赖

<dependencies>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-hystrix-dashboard</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-devtools</artifactId>

<scope>runtime</scope>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

2.配置yml

server:

port: 9001

3.主启动类

package com.atguigu.springcloud;

@SpringBootApplication

@EnableHystrixDashboard

public class HystrixDashboardMain9001

{

public static void main(String[] args) {

SpringApplication.run(HystrixDashboardMain9001.class, args);

}

}

4.访问:http://localhost:9001/hystrix

5.同时,最后我们需要注意,每个服务类想要被监控的,都需要在pom文件中,添加一下注解

<!--监控-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

同时在服务提供者的启动类上,需要添加以下的内容

//cloud-provider-hystrix-payment8001

@SpringBootApplication

@EnableDiscoveryClient

@EnableCircuitBreaker

public class PaymentHystrixMain8001 {

public static void main(String[] args) {

SpringApplication.run(PaymentHystrixMain8001.class, args);

}

/**

* 此配置是为了服务监控而配置,与服务容错本身无观,springCloud 升级之后的坑

* ServletRegistrationBean因为springboot的默认路径不是/hystrix.stream

* 只要在自己的项目中配置上下面的servlet即可

* @return

*/

@Bean

public ServletRegistrationBean getServlet(){

HystrixMetricsStreamServlet streamServlet = new HystrixMetricsStreamServlet();

ServletRegistrationBean<HystrixMetricsStreamServlet> registrationBean = new ServletRegistrationBean<>(streamServlet);

registrationBean.setLoadOnStartup(1);

registrationBean.addUrlMappings("/hystrix.stream");

registrationBean.setName("HystrixMetricsStreamServlet");

return registrationBean;

}

}

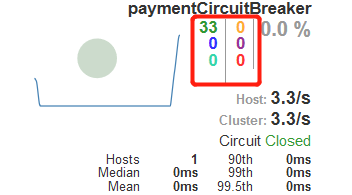

6.使用监控

我们需要使用当前hystrix需要监控的端口号,也就是使用 9001 去监控 8001,即使用hystrix dashboard去监控服务提供者的端口号

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-M36oqx4D-1593595299122)(images/image-20200409122102137.png)]](https://img-blog.csdnimg.cn/20200701172253315.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

然后我们运行

http://localhost:8001/payment/circuit/31

就能够发现Hystrix Dashboard能够检测到我们的请求

假设我们访问错误的方法后

http://localhost:8001/payment/circuit/-31

我们能够发现,此时断路器处于开启状态,并且错误率百分100

如何看懂图

首先是七种颜色

每个颜色都对应的一种结果

然后是里面的圆

实心圆:共有两种含义。它通过颜色的变化代表了实例的健康程度,它的健康程度从

绿色 < 黄色 < 橙色 <红色,递减

该实心圆除了颜色变化之外,它的大小也会根据实例的请求流量发生变化,流量越大该实心圆就越大,所以通过该实心圆的展示,就可以快速在大量的实例中快速发现故障实例和高压力实例

曲线:用于记录2分钟内流量的相对变化,可以通过它来观察到流量的上升和下降趋势

服务网关

前言

zuul目前已经出现了分歧,zuul 升级到 Zuul2的时候出现了内部分歧,并且导致Zuul的核心人员的离职,导致Zuul2一直跳票,等了两年,目前造成的局面是Zuul已经没人维护,Zuul2一直在开发中

目前主流的服务网关采用的是Spring Cloud 社区推出了 Gateway

概念

Zuul官网

Zuul是所有来自设备和web站点到Netflix流媒体应用程序后端的请求的前门。作为一个边缘服务应用程序,Zuul的构建是为了支持动态路由、监视、弹性和安全性。它还可以根据需要将请求路由到多个Amazon自动伸缩组。

Gateway

Cloud全家桶有个很重要的组件就是网关,在1.X版本中都是采用Zuul网关,但在2.X版本中,zuul的升级一直跳票,SpringCloud最后自己研发了一个网关替代Zuul,那就是SpringCloudGateway,一句话Gateway是原来Zuul 1.X 版本的替代品

Gateway是在Spring生态系统之上构建的API网关服务,基于Spring 5,Spring Boot 2 和 Project Reactor等技术。Gateway旨在提供一种简单而且有效的方式来对API进行路由,以及提供一些强大的过滤器功能,例如:熔断,限流,重试等。

Spring Cloud Gateway 是Spring Cloud的一个全新项目,作为Spring Cloud生态系统中的网关,目标是替代Zuul,在Spring Cloud 2.0以上版本中,没有对新版本的Zuul 2.0以上最新高性能版本进行集成,仍然还是使用的Zuul 1.X非Reactor模式的老版本,而为了提高网关的性能,Spring Cloud Gateway是基于WebFlux框架实现的,而WebFlux框架底层则使用了高性能的Reactor模式通信框架Netty。

Spring Cloud Gateway的目标提供统一的路由方式,且基于Filter链的方式提供了网关基本的功能,例如:安全,监控、指标 和 限流。

能做啥

- 反向代理

- 鉴权

- 流量控制

- 熔断

- 日志监控

使用场景

网关可以想象成是所有服务的入口

为什么选用Gateway

目前已经有了Zuul了,为什么还要开发出Gateway呢?

一方面是因为Zuul 1.0已经进入了维护阶段,而且Gateway是Spring Cloud团队研发的,属于亲儿子 ,值得信赖,并且很多功能Zuul都没有用起来,同时Gateway也非常简单便捷

Gateway是基于异步非阻塞模型上进行开发的,性能方面不需要担心。虽然Netflix早就发布了Zuul 2.X,但是Spring Cloud没有整合计划,因为NetFlix相关组件都进入维护期,随意综合考虑Gateway是很理想的网关选择。

Gateway特性

基于Spring Framework 5,Project Reactor 和Spring boot 2.0 进行构建

- 动态路由,能匹配任何请求属性

- 可以对路由指定Predicate(断言) 和 Filter(过滤器)

- 集成Hystrix的断路器功能

- 集成Spring Cloud服务发现功能

- 易于编写Predicate 和 Filter

- 请求限流功能

- 支持路径重写

Spring Cloud Gateway 和 Zuul的区别

在Spring Cloud Gateway Finchley正式版发布之前,Spring Cloud推荐网关是NetFlix提供的Zuul

- Zuul 1.X 是一个基于阻塞IO的API Gateway

- Zuul 1.x

基于Servlet 2.5使用阻塞架构,它不支持任何场连接,Zuul的设计模式和Nginx比较像,每次IO操作都是从工作线程中选择一个执行,请求线程被阻塞到工作线程完成,但是差别是Nginx用C++实现,Zuul用Java实现,而JVM本身会有第一次加载较慢的情况,使得Zuul的性能较差。 - Zuul 2.X理念更先进,想基于Netty非阻塞和支持长连接,但Spring Cloud目前还没有整合。Zuul 2.X的性能相比于1.X有较大提升,在性能方面,根据官方提供的基准测试,Spring Cloud Gateway的RPS(每秒请求数)是Zuul的1.6倍。

- Spring Cloud Gateway建立在Spring 5,Spring Boot 2.X之上,使用

非阻塞API - Spring Cloud Gateway

还支持WebSocket,并且与Spring紧密集成拥有更好的开发体验。

Spring Cloud 中所集成的Zuul版本,采用的是Tomcat容器,使用的还是传统的Servlet IO处理模型

Servlet的生命周期中,Servlet由Servlet Container进行生命周期管理。

Container启动时构建servlet对象,并调用servlet init()进行初始化

Container运行时接收请求,并为每个请求分配一个线程,(一般从线程池中获取空闲线程),然后调用Service

container关闭时,调用servlet destory() 销毁servlet

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-aBd13NOB-1593665538690)(images/image-20200409145343133.png)]](https://img-blog.csdnimg.cn/20200704225055339.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

上述模式的缺点:

servlet是一个简单的网络IO模型,当请求进入Servlet container时,servlet container就会为其绑定一个线程,在并发不高的场景下,这种网络模型是适用的,但是一旦高并发(Jmeter测试),线程数就会上涨,而线程资源代价是昂贵的(上下文切换,内存消耗大),严重影响了请求的处理时间。在一些简单业务场景下,不希望为每个Request分配一个线程,只需要1个或几个线程就能应对极大并发的请求,这种业务场景下Servlet模型没有优势。

所以Zuul 1.X是基于Servlet之上的一种阻塞式锤模型,即Spring实现了处理所有request请求的Servlet(DispatcherServlet)并由该Servlet阻塞式处理,因此Zuul 1.X无法摆脱Servlet模型的弊端

WebFlux框架

传统的Web框架,比如Struts2,Spring MVC等都是基于Servlet API 与Servlet容器基础之上运行的,但是在Servlet 3.1之后有了异步非阻塞的支持,而WebFlux是一个典型的非阻塞异步的框架,它的核心是基于Reactor的相关API实现的,相对于传统的Web框架来说,它可以运行在如 Netty,Undertow 及支持Servlet3.1的容器上。非阻塞式 + 函数式编程(Spring5必须让你使用Java8)

Spring WebFlux是Spring 5.0引入的新的响应式框架,区别与Spring MVC,他不依赖Servlet API,它是完全异步非阻塞的,并且基于Reactor来实现响应式流规范。

三大核心概念

Route 路由

路由就是构建网关的基本模块,它由ID,目标URI,一系列的断言和过滤器组成,如果断言为True则匹配该路由

Predicate 断言

参考的Java8的 java.util.function.Predicate

开发人员可以匹配HTTP请求中的所有内容,例如请求头和请求参数,如果请求与断言想匹配则进行路由

Filter 过滤

指的是Spring框架中GatewayFilter的实例,使用过滤器,可以在请求被路由前或者之后对请求进行修改。

Gateway工作流程

Web请求通过一些匹配条件,定位到真正的服务节点,并在这个转发过程的前后,进行了一些精细化的控制。

Predicate就是我们的匹配条件,而Filter就可以理解为一个无所不能的拦截器,有了这两个元素,在加上目标URL,就可以实现一个具体的路由了。

![[外链图片转存中...(img-ZiQ6sBtn-1593874424747)]](https://img-blog.csdnimg.cn/20200704225433703.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

客户端向Spring Cloud Gateway发出请求,然后在Gateway Handler Mapping中找到与请求相匹配的路由,将其发送到Gateway Web Handler。

Handler在通过指定的过滤器链来将请求发送到我们实际的服务执行业务逻辑,然后返回。

过滤器之间用虚线分开是因为过滤器可能会在发送代理请求前(pre)或之后(post)执行业务逻辑。

![[外链图片转存中...(img-pto9zW2F-1593874424763)]](https://img-blog.csdnimg.cn/20200704225502920.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQzODE3MTY0,size_16,color_FFFFFF,t_70)

Filter在 Pre 类型的过滤器可以做参数校验,权限校验,流量监控,日志输出,协议转换等。

在 Post类型的过滤器中可以做响应内容,响应头的修改,日志的输出,流量监控等有着非常重要的作用。