huggingface内有许多预训练模型,可以在线调用模型或者将模型部署至本地,但有时候通过网址调用模型会很慢,有些服务器甚至无法通过网址调用…

那么,正题,如何将huggingface的模型部署至本地呢?其实很简单,这里以clinicalBERT模型为例:

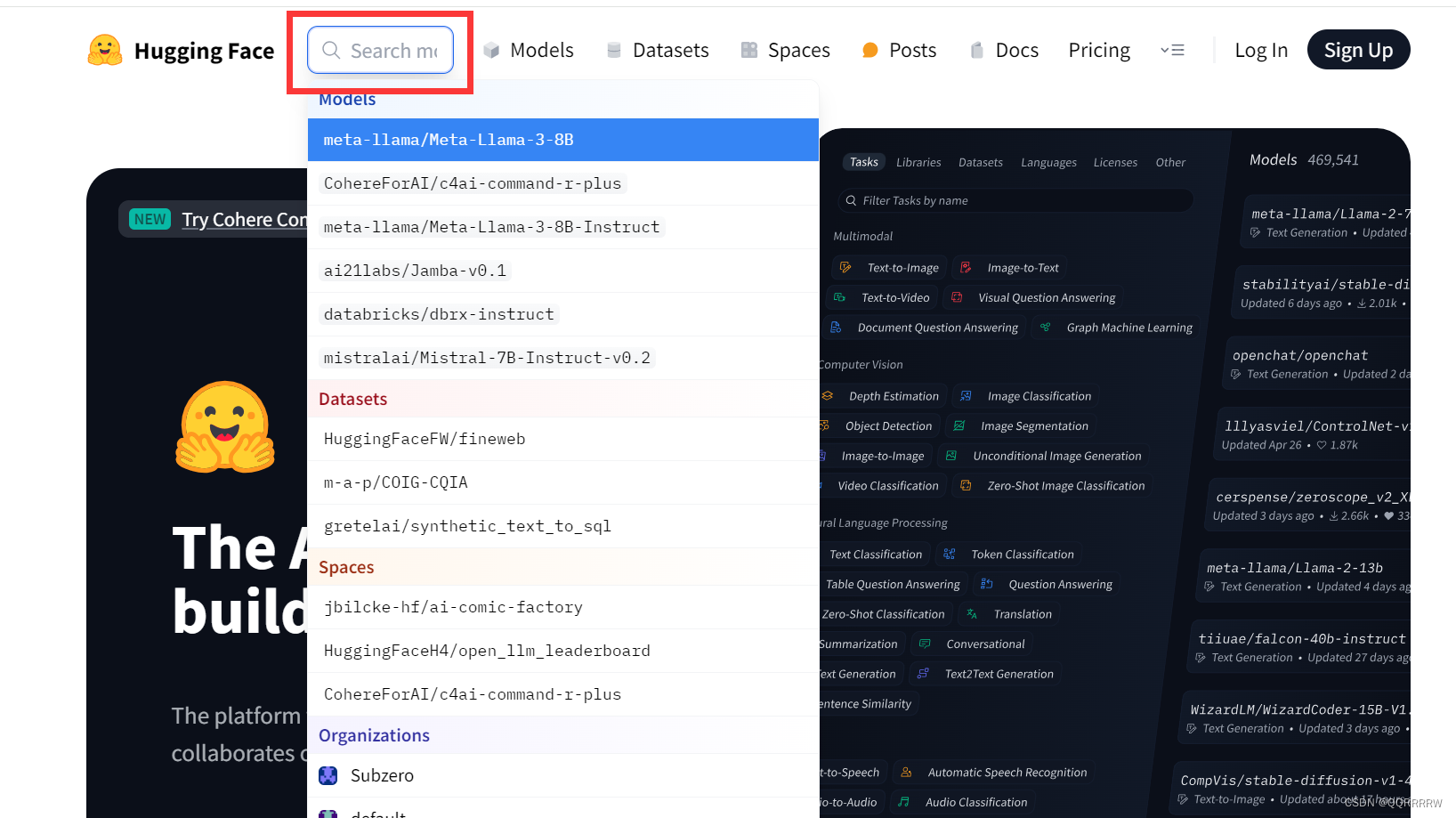

- 打开huggingface网址https://huggingface.co/

(建议挂个梯子进网址,不然很慢),在此处查找你想下载的模型

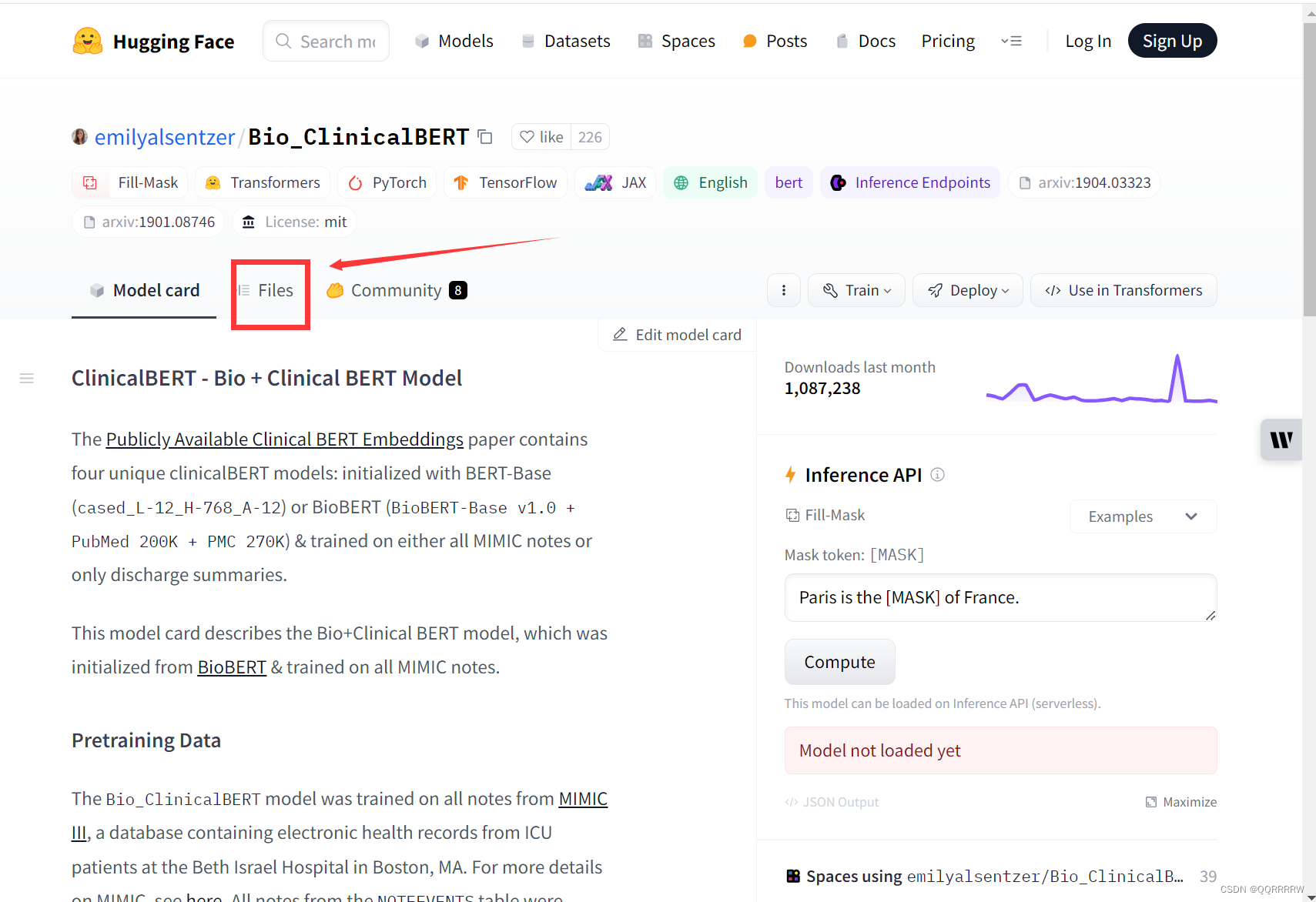

- 点这个Files进去

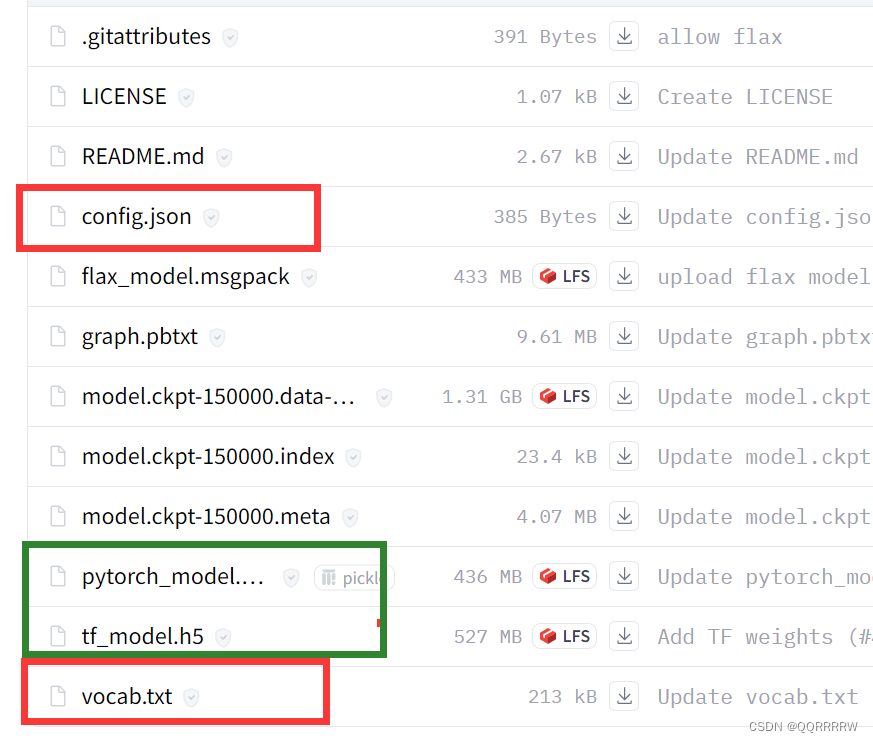

- 主要下载三个文件,红框的是必须下载的,绿色的是选择一个下载,如果你用的tensorflow框架就下载tf_model.h5,如果你用的pytorch框架就下载pytorch_model.bin文件。点后面那个下载按钮就可以下载。

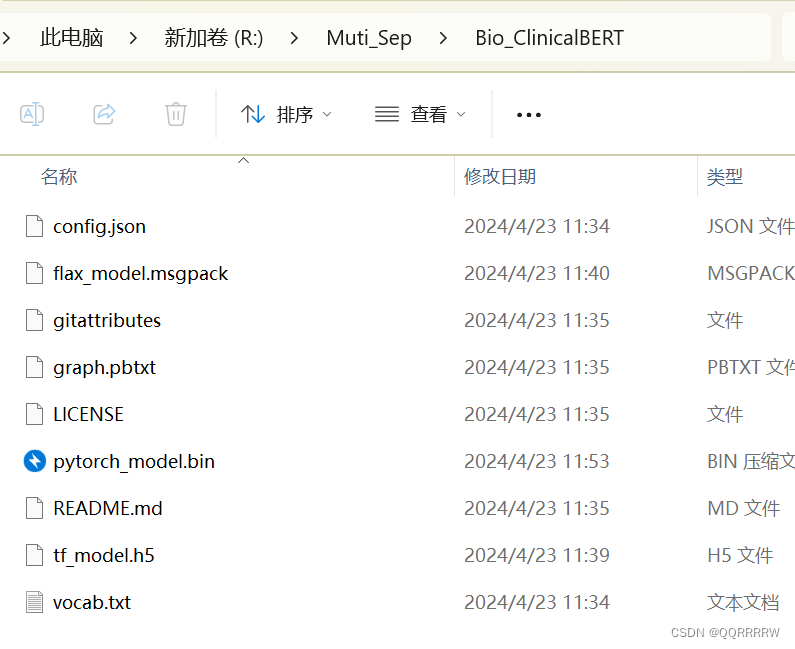

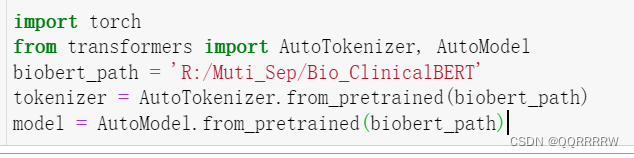

- 下载到本地后然后调用该模型,比如我下载到这个目录下,然后在代码中调用该模型:biobert_path填自己下载的模型路径

本文介绍了如何从HuggingFace网站下载临床BERT模型(如tf_model.h5或pytorch_model.bin),并指导读者如何在本地环境中使用这些模型,以提高调用速度。

本文介绍了如何从HuggingFace网站下载临床BERT模型(如tf_model.h5或pytorch_model.bin),并指导读者如何在本地环境中使用这些模型,以提高调用速度。

3302

3302

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?