这篇文章的网络结构和写作手法和RDN都非常相似,然后一看作者就是同一批 😃 。这篇文章是EDSR的一个加强版,也是RDN的姊妹版(把RDN的Dense Block换成了ResBlock)当然这篇文章中提出了新的通道注意力机制CA。

论文链接:

RCAN: Image Super-Resolution Using Very Deep Residual Channel Attention Networks

EDSR: Enhanced Deep Residual Networks for Single Image Super-Resolution

RDN: Residual Dense Network for Image Super-Resolution

RCAN源码

RCAN:Image Super-Resolution Using Very Deep Residual Channel Attention Networks

Abstract

作者发现影响图像SR性能的两个问题:

- 难以训练非常 深层的CNN网络。

- 不同通道包含的特征信息是不同的,但之前的方法都是采用一样的处理。

为了解决以上问题,作者提出了深度残差通道注意网络(RCAN)。

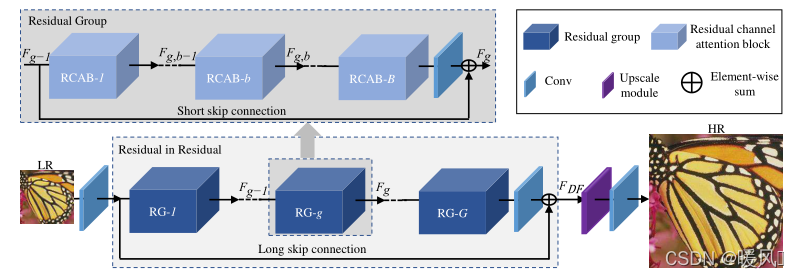

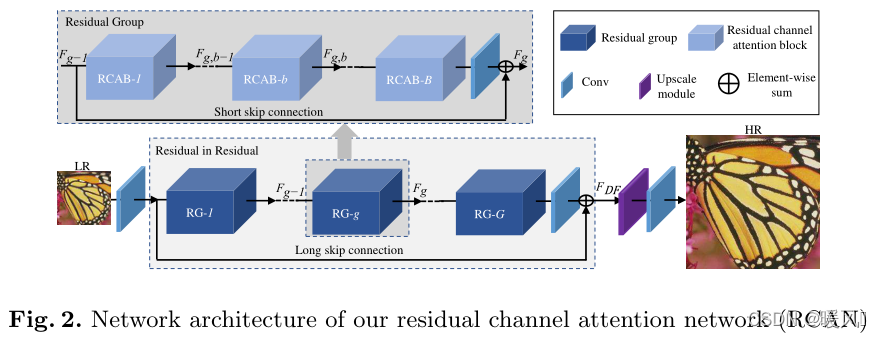

- 提出了一种

residual in residual(RIR)结构来形成非常深的网络,它由几个具有长跳跃连接LSC的残差群组RG组成。每个残差群组RG包含一些具有短跳跃连接SSC的通道残差块RCAB。每个通道注意力残差块RCAB由简单残差块BN和通道注意力机制CA组成。同时,RIR允许通过多个跳跃连接绕过丰富的低频信息,使主网络专注于学习高频信息。 - 提出了一种

通道注意力机制,通过考虑通道之间的相互依赖性,自适应地重新缩放通道特征,以改变不同通道特征对重建图像的影响权重。

大量实验表明,作者提出的RCAN相对于最先进的方法达到了更好的准确度,实现了更好的视觉效果。

1 Introduction

- 经过以往大量的实验证明网络深度对许多视觉识别任务至关重要,因此何凯明大神提出的残差网络(ResNet)被引入到许多其他基于CNN的图像SR方法中。然而,简单地叠加残差块以构建更深的网络很难获得更好的改进。

- 另一方面, 注意力可以被视为一种引导,使可用处理资源的分配偏向于输入中信息量最大的部分。而现有的基于CNN的方法都是用同样的方式处理不同的频道特征,在处理不同类型的信息时缺乏灵活性,缺乏跨特征通道的区分性学习能力,这一点影响了深层网络的表征能力。

因此作者提出了一种残差通道注意力网络(RCAN),来加深网络的深度,同时自适应地学习更多有用的通道特征。

- 为了简化深度网络(超过400层)的训练,提出了residual in residual(RIR)结构,其中残差组(RG)作为基本模块,长跳跃连接(LSC)允许粗略水平的残差学习。 在每个RG模块中,堆叠了几个带有短跳连接(SSC)的简化残差块(RCAB)。从而在LR空间中获取更多低层特征和高层特征信息。

- 长跳转连接和短跳转连接以及残差块中的short-cut 使网络得以直接绕过丰富的低频信息,简化信息流。

- 为了更进一步,提出了通道注意力(CA)机制,将注意力机制引入深层神经网络,通过模拟通道之间的相互依赖关系,自适应地重新缩放每个通道特征。这种CA机制使提出的网络能够专注于更有用的通道信息,并增强辨别学习能力。

以上,这篇文章的贡献有三个方面:

- 提出了非常深的残余通道注意力网络(RCAN)来实现高精度的图像SR。

- RCAN中包含的RIR结构来构建非常深的可训练网络。

- RCAN中包含的通道注意力机制(CA),通过考虑特征通道之间的相互依赖性,更多关注重要的特征信息。

2 Method

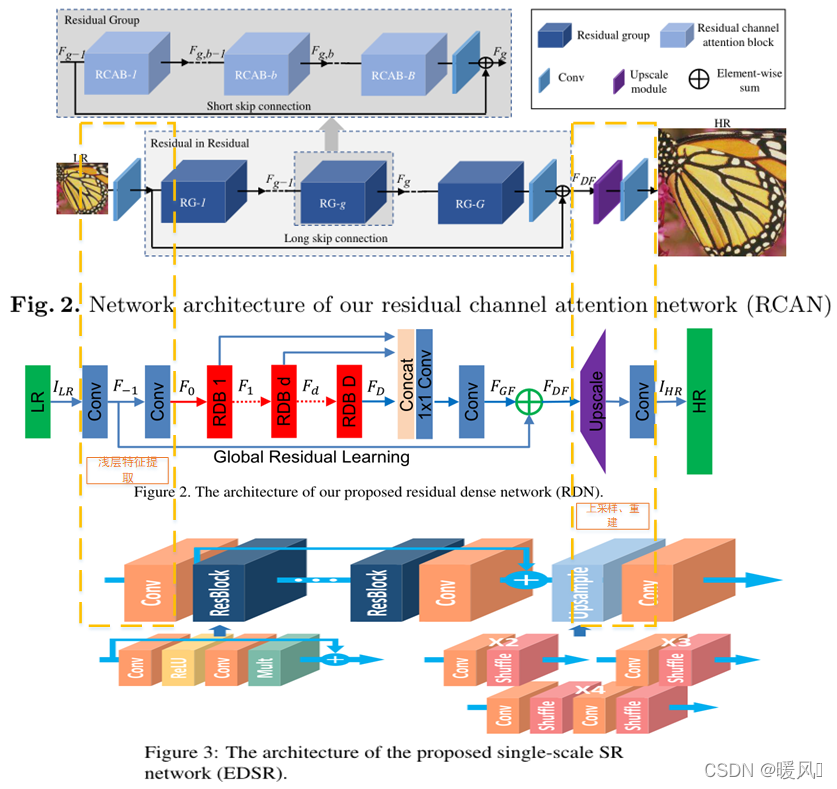

这篇文章是EDSR的加强版,使用的也是ResNet结构,从上图中可以看到RCAN和EDSR都是使用一层卷积作为低层特征提取,中间n个ResBlock接一层卷积,使用跳跃连接把浅层特征和高层特征相加,最后使用上采样和重建模块,得到输出SR。不同之处在于ResBlock和RG内部。RG内部多了”套娃“块,还使用了跳跃连接和通道注意力机制。

可以看到RDN结构和RCAN也非常像,先是两层卷积提取低层特征,然后d个RDB块提取高级特征接一层卷积,使用跳跃连接,最后上采样加重建输出SR。RDB内也是”套娃“,每个RDB内是多个稠密块。

三个网络不同之处都在于高级特征的提取,其余的部分都非常相似,所以文章只重点介绍高级特征提取部分RIR。包括RCAB和CA。对于其他部分有疑问的可以参看EDSR和RDN。

2.1 Overview

RCAN主要包括四个部分:浅层特征提取、Residual in Residual(RIR)深度特征提取、上采样和重建部分。

I L R I_{LR} ILR和 I S R I_{SR} ISR记作为RCAN的输入和输出。

浅层特征提取:(shallow feature extraction)

使用一个卷积层(Conv)从LR输入中提取浅层特征 F 0 F_0 F0。 H S F ( ⋅ ) H_{SF} (·) HSF(⋅)表示卷积操作。 F 0 F_0 F0还会用于后续RIR模块对深层特征的提取。

F 0 = H S F ( I L R ) , (1) F_0 = H_{SF} (I_{LR}),\tag{1} F0=HSF(ILR),(1)

深度特征提取(RIR):(deep feature extraction)

H R I R ( ⋅ ) H_{RIR }(·) HRIR(⋅)表示深层特征提取的一整个复合函数。该模块是非常深的RIR残差结构,包含多个RG块,每个RG块都由多个RCAB块组成,每个RCAB块都包含残差块和空间注意力机制。RCAN达到了迄今为止现有的最大网络深度,并且有非常大的感受野,所以该模块输出记作深层特征(deep feature)。

F D F = H R I R ( F 0 ) , (2) F_{DF} = H_{RIR} (F_0),\tag{2} FDF=H

RCAN是一种用于图像超分辨率的深度残差通道注意网络,通过非常深的网络结构和通道注意力机制,解决了深层CNN训练难题并自适应地学习重要通道特征。对比了RCAN与其他先进方法如EDSR和RDN,RCAN在性能和参数效率之间取得良好平衡。

RCAN是一种用于图像超分辨率的深度残差通道注意网络,通过非常深的网络结构和通道注意力机制,解决了深层CNN训练难题并自适应地学习重要通道特征。对比了RCAN与其他先进方法如EDSR和RDN,RCAN在性能和参数效率之间取得良好平衡。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2019

2019

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?