装本地知识库

给大模型添加RAG知识库和搜索的功能

1.安装phidata

pip install -U phidata

在github将该项目拉取下来,后续步骤的很多内容可以直接使用该项目中给的例子,进行简单修改就可直接使用。

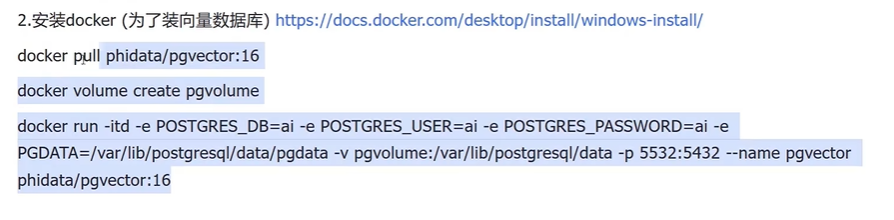

2.安装向量知识库,使用的docker

docker run -d \

-e POSTGRES_DB=ai \

-e POSTGRES_USER=ai \

-e POSTGRES_PASSWORD=ai \

-e PGDATA=/var/lib/postgresql/data/pgdata \

-v pgvolume:/var/lib/postgresql/data \

-p 5532:5432 \

--name pgvector \

phidata/pgvector:16

在此默认已经安装好了ollama

然后使用

ollama pull nomic-embed-text

启动刚刚安装的docker

进入到步骤1所说的cookbook目录下。

如果要使用自己微调的模型,则可以对rag.py里面模型对应部分的内容进行修改即可。

接下来使用命令,启动项目。

streamlit run llms/ollama/rag/app.py

streamlit run llms/ollama/rag/app.py

[微调Llama3实现在线搜索引擎和RAG检索增强生成功能!打造自己的perplexity和GPTs!用PDF实现本地知识库_哔哩哔哩_bilibili](https://www.bilibili.com/video/BV1Wb42187kk/?spm_id_from=333.337.search-card.all.click&vd_source=e3b1d6ceec31cba80353bfd01d49ed17)

2769

2769

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?