文字控制的Mamba运动:文字指导的人类运动的时间基础

Text-controlled Motion Mamba: Text-Instructed Temporal Grounding of Human Motion

摘要

人类动作理解是一项具有多种实际应用的基本任务,这一任务得益于大规模动作捕捉数据集的可用性。

最近的研究关注于文本动作任务,例如基于文本的动作生成、编辑和问答。

在本次研究中,作者引入了基于文本的人类动作定位(THMG)这一新任务,旨在精确地在未修剪的动作序列中定位与给定文本描述相对应的时间段。捕捉全局时间信息对于THMG任务至关重要。

然而,基于Transformer的模型依赖于全局时间自注意力,在处理长的未修剪序列时,面临着因二次计算成本带来的挑战。作者通过提出文本控制的TM-Mamba模型来解决这些挑战,这是一个统一模型,它融合了时间全局上下文、语言 Query 控制和平面图拓扑,且只具有线性内存成本。模型的核心是一个文本控制的选择机制,它根据文本 Query 动态地融合全局时间信息。

通过融入关系嵌入,模型进一步被加强,以实现对拓扑的感知。为了评估,作者介绍了BABEL-Grounding,这是首个提供详细的人类动作文本描述及其相应时间段对应的文本动作数据集。

广泛的评估展示了TM-Mamba在BABEL-Grounding上的有效性。

INTRODUCTION

在这项工作中,作者旨在通过一个统一的模型来攻击所有上述挑战,该模型无缝结合了时间全局上下文、语言 Query 控制以及空间图拓扑。作者主要的灵感来源是最近提出的称为Mamba的状态空间模型,这是一种处理长序列中长依赖关系的有效模型,同时保持线性计算成本。Mamba在语言建模和视觉理解等不同领域展示了其强大的能力。然而,在人类运动任务中,其潜在应用仍有待进一步探索。

Mamba的核心是一种输入依赖的选择机制,使模型能够根据当前输入选择性地在时间上传播或遗忘信息。这种创新设计极大地增强了传统的状态空间模型(SSM)方法,因为Mamba能够在筛选出不相关信息的同时把握到长序列的全局上下文。然而,在THMG任务中,模型还必须根据文本 Query 选择信息。为了应对这一挑战,引入了一种文本控制的选择机制,其关键思想是将状态转移矩阵的条件同时置于运动和文本 Query 上。与现有仅将文本和视觉特征简单拼接并输入到Mamba块中的多模态Mamba方法不同,作者的方法首次实现了让文本控制输入信息的选择性传播。这确保了模型能够根据运动和文本输入之间的交互动态调整其关注点。此外,由于人类运动序列本质上具有图形拓扑结构,原始的Mamba模型并不适用,因为它被设计用于处理单变量时间序列。为了解决这个问题,作者通过将图神经网络整合到Mamba的状态表示中来增强Mamba,使其具备拓扑感知能力。由此产生的框架,称为文本控制运动Mamba(TM-Mamba),可以在运动序列中根据文本 Query 有选择地提取相关的全局上下文信息。

对于评估,现有的数据集带有帧 Level 的时序标注,并不能直接适用于THMG任务。虽然BABEL为序列中发生的所有动作提供了时序边界,但它缺乏完整的详细文本描述,只提供了简单的分类短句。Motion-X为每一帧提供了详细的姿态描述,但其文本关注于每个时间步人体部位的运动,这使得它无法从语义动作描述映射到时序段。为了填补这一空白,基于BABEL,引入了一个新的数据集,名为BABEL-Grounding,作为评估THMG任务的基准。BABEL-Grounding是第一个文本-运动数据集,它提供了未修剪运动序列中人类动作的详细文本描述及其对应的时序段。如同现实世界场景,每个 Query 可能对应多个时序段。在新的引入的数据集上对TM-Mamba进行了广泛评估,证明了它在THMG任务中的有效性。作者的主要贡献可以总结如下:

作者引入了一个新的文本动作任务,即基于文本的人类动作定位(THMG),以及一个专为THMG设计的文本动作数据集,名为BABEL-Grounding,这是同类中的首个。

作者提出了TM-Mamba,一个专为THMG任务设计的统一模型,其内存成本仅为线性,这是首次将文本控制的选取机制融入到Mamba框架中的工作。

在BABEL-Grounding数据集上的广泛评估展示了所提出的TM-Mamba方法的有效性。

Related Work

Datasets for Text-Motion Learning

本节概述了现有带文本标注的人体动作数据集。这些文本-动作数据集主要为了文本驱动的动作生成任务而开发,因此它们通常包括每个动作序列在序列 Level 的文本描述。例如,KIT动作语言数据集首次提供了人体动作及其相应的序列级文本描述。沿着这个方向,后续的几项工作努力构建了类似的大规模数据集,如HumanML3D,InterHuman,HumanLong3D,FLAG3D,STDM。一些数据集不仅限于文本标注,还融合了额外的上下文信息。例如,HUMANISE集成了3D场景信息以促进在3D环境中的动作生成,而HOI-Diff则融入了物体几何信息以支持生成过程中的人与物体互动。此外,还有针对生成以外多样化文本-动作任务而量身定制的数据集。例如,PoseScript专注于静态姿势生成和姿势标注,而PoseFix则针对动作编辑任务。

然而,所有上述数据集仅包含序列级标注,使它们不适用于时间任务。为了解决这一限制,已经做出了各种努力来开发具有特定时间信息的运动数据集。例如,BABEL引入了一个带有逐帧标注的运动数据集,为每个动作标签提供时间跨度,从而能够执行如动作定位等任务。基于BABEL,BABEL-QA通过融入问答对扩展了数据集,旨在促进基于运动的问答。另一个例子是HuMMan-MoGen,它建立在HuMMan数据集之上,其中每个序列被划分为预定义的动作阶段,并配有描述每个身体部位运动的阶段级详细标注。最近,Motion-X为每帧的人体姿态提供部分 Level 的文本标注。然而,Motion-X的标注基于单个姿态,并且缺少从语义动作的文本描述到时间边界的映射。

Text-Motion Multi-modal Learning

近期,对文本运动多模态学习的兴趣日益增长。当前研究主要集中于文本到运动的任务(也称为文本驱动的运动生成),在这一任务中,基于自然语言生成人体运动序列。

规则已被采用来增强数据集,下面将详细阐述这一点。

Textual augmentation

BABEL中的文本标注质量在很大程度上受到仅由简单单词或短语组成的项目限制,例如’place’、‘turn’ 和 ‘step’。这些含糊不清且无意义的项目在数据中占据了相当大的比例,并未能提供涉及动作中人体运动的详细描述。为了解决这个问题,已经采用了两种方法:

利用外部标注

BABEL是基于AMASS运动捕捉数据库构建的,而HumanML3D为AMASS数据库在序列 Level 提供了详细的文本标注。对于BABEL数据集中每个标注过于简化的条目,通过序列ID找到其在HumanML3D中对应的条目。当序列 Level 的HumanML3D标注包含BABEL标注中的短语时,人工标注员将手动验证它们之间的对应关系,并使用HumanML3D中的详细文本描述来补充BABEL标注。

基于模板的增强方法:由于HumanML3D的序列级标注只部分覆盖了BABEL中的项目,许多低质量的标注仍未得到解决,特别是那些只有一个单词标签的标注。为了填补这一空白,作者手动制作了模板来增强这些标注。例如,“拿”被扩展为“用手拿某物”,“搅拌”变为“用手在圆形轨迹中搅拌某物”,而“放置”则变为“将物体放置在特定位置”。这种替换过程丰富了过于简单的标注,使它们对模型来说更加易于理解。最终的文本标注通过ChatGPT(gpt-3.5-turbo)进一步细化,以使标注内容更加充实、完整和多样化。

Temporal Augmentation

时间窗口合并

在原始的BABEL数据集中,多个标注项目的时间段可能会相互重叠。为了进一步提高文本标注的质量,作者设计了一个时间窗口合并规则,该规则将具有显著重叠的标注段落进行合并。具体来说,如果两个段落的重叠部分超过了某一比例(经验性地设置为0.8),则它们的文本标注将被合并,以描述重叠部分中的人体动作。这导致了更加详细的文本,全面描绘了人体动作。

BABEL 数据集为序列中发生的每个动作提供标注。然而,在 THMG 任务中,一个 Query 可能对应于序列中的多个时间片段。为了实现这一特性,通过合并具有相同文本标注的项目,建立了一个从文本到片段的一对多映射。

Method

在本节中,作者简要回顾了状态空间模型(State Space Models, SSM)和Mamba(Mamba, 2017)。SSM是一系列顺序模型,它通过隐藏状态 h ( t ) ∈ R N h(t)∈\mathbb{R}^N h(t)∈RN将输入序列 a ( t ) ∈ R a(t)∈\mathbb{R} a(t)∈R映射到输出序列 y ( t ) ∈ R y(t)∈\mathbb{R} y(t)∈R,这可以描述为一个线性常微分方程:

h ′ ( t ) = A h ( t ) + B a ( t ) , y ( t ) = C h ( t ) h'(t)= Ah(t) + Ba(t), y(t)=Ch(t) h′(t)=Ah(t)+Ba(t),y(t)=Ch(t).

在这里, A ∈ R N × N A ∈ \mathbb{R}^{N \times N} A∈RN×N, B ∈ R N × 1 B ∈ \mathbb{R}^{N \times 1} B∈RN×1, C ∈ R 1 × N C ∈ \mathbb{R}^{1 \times N} C∈R1×N是演变和投影参数。这个连续的ODE可以通过使用时间尺度参数△并遵循零阶保持(ZOf)规则进行离散化:

A = exp ( A Δ ) , B = ( A Δ ) − 1 ( exp ( A Δ ) − I ) A B A = \exp(A\Delta), B = (A\Delta)^{-1}(\exp(A\Delta) - I)AB A=exp(AΔ),B=(AΔ)−1(exp(AΔ)−I)AB.

上述公式的离散化形式可以使用线性递推方法进行计算:

h t = A h t − 1 + B X t , y t = C h t h_t = Ah_{t-1} + BX_t, y_t = Ch_t ht=Aht−1+BXt,yt=Cht.

然而,线性递推需要在时间上展开,并且不能被并行化。S4(Shen等人,2017)通过假设A,B,C,△保持静态来确保线性时间不变性(LTI),这使得可以通过全局卷积来实现,即 y = x ∗ K y = x * K y=x∗K,其中:

K = ( C B , C A B , … , C A ′ B ) K = (CB, CAB, \dots , CA^{'}B) K=(CB,CAB,…,CA′B),

这里,L表示输入序列的长度,而 K ∈ R L K∈\mathbb{R}^L K∈RL代表一个结构化的卷积核。另一方面,Mamba(Mamba, 2017))通过使A,B,C,△成为t的函数,引入了一种输入依赖的选择机制。这种公式可以通过所提出的并行扫描算法高效地计算。

Text-Controlled Selection Mechanism

Mamba强调了在选择性地构建序列模型中的关键作用。在处理非常长的序列时,记住压缩状态向量内的所有信息变得不切实际。因此,设计一个控制信息沿序列维度传播或交互的选择机制是至关重要的。Mamba通过采用一种对状态转换矩阵的上下文感知参数化方法来应对这一挑战。这使得模型能够根据当前的输入数据聚焦或过滤信息。

然而,在THMG任务的背景下,模型需要根据文本 Query 动态地从序列中选择相关的全局信息,以实现更好的接地性能。现有的多模态Mamba方法使用简单的拼接方法将文本和视觉特征合并作为Mamba的输入,但控制信息流的关键选择机制保持不变。

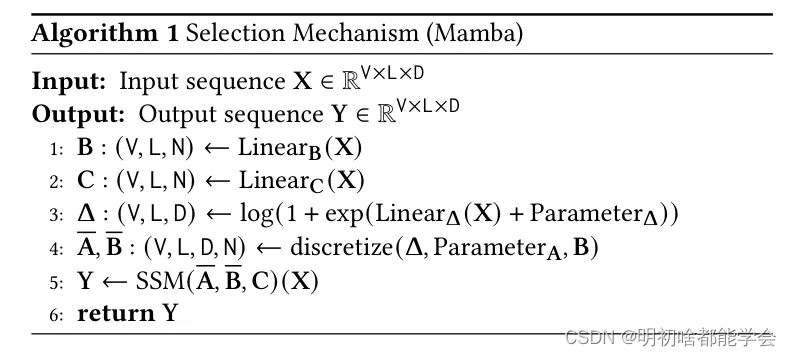

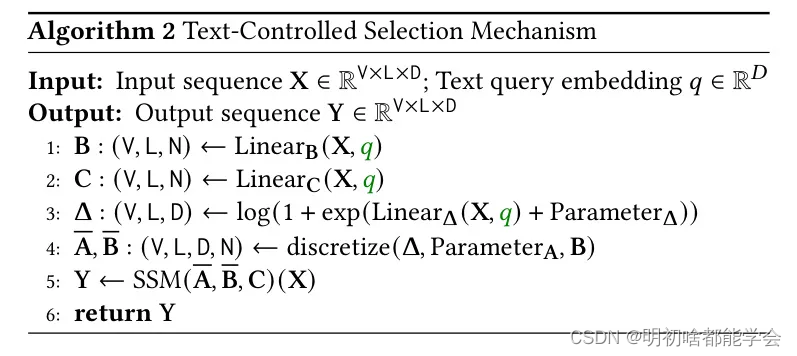

为了克服这一限制,作者提出了一种文本控制的选择机制,该机制允许选择过程依赖于运动输入和文本 Query 两者。如算法1和2所示,Mamba将 参数化为输入的函数,而在文本控制选择中,这些参数成为了输入序列以及文本 Query 的函数。

该算法本质上类似于基于文本的门控机制,动态地根据文本 Query 控制信息的流动。(Wang等人,2019年的)定理1暗示,在特定条件下,算法2与门控RNN具有相似性:

引理4.1():当

N

=

1

,

A

=

−

1

,

B

=

1

N =1,A = -1,B =1

N=1,A=−1,B=1时,文本控制选择机制具有形式

g

t

=

σ

(

L

i

n

e

a

r

4

(

X

,

q

)

)

g_t= \sigma(Linear4(X, q))

gt=σ(Linear4(X,q))

和

h

t

=

(

1

−

g

t

)

h

t

−

1

+

g

t

h

t

h_t= (1 - g_t)h_{t-1} + g_t h_t

ht=(1−gt)ht−1+gtht

其中

X

X

X表示输入序列,

q

q

q表示Query嵌入。

引理4.1表明,受文本控制的选择性状态空间模型(SSM)类似于一个门控循环神经网络(RNN),其中门 g g g依赖于运动输入和文本Query,这使得文本Query能够在传播过程中控制信息流。鉴于算法2第5行中的递归过程保持不变,因此得到的受文本控制的SSM仍然可以利用(Wang等人,2019年)中概述的并行扫描算法进行有效计算。通过修改原始Mamba的前向和梯度反向传播函数,可以实现新算法,这使得SSM和语言Backbone 网络可以进行端到端的联合训练。

Text-Controlled Motion Mamba

文本可控的选择性SSMs具有线性计算复杂度和内存消耗,使它们适合提取非常长序列的全局上下文。这使其成为运动定位任务中时间建模的自然选择。然而,人体骨架本质上具有潜在的图结构,构成一个多变量时间序列。Mamba作用于单变量序列,因此忽略了人体关节之间的交互。

在这项研究中,作者通过融入拓扑感知来增强Mamba,这是通过整合关系嵌入来传递关于相邻节点信息实现的。假设一个输入序列的形状为

X

∈

R

V

×

L

×

D

X\in\mathbb{R}^{V\times L\times D}

X∈RV×L×D,其中

V

V

V表示人体骨骼中的关节数量,

L

L

L表示序列长度,

D

D

D表示特征维度。关系嵌入

R

R

R计算为

R

=

f

(

X

)

∈

R

V

×

L

×

D

R= f(X)\in\mathbb{R}^{V\times L\times D}

R=f(X)∈RV×L×D

它封装了每个时间步的图信息。在这里,

f

f

f表示图神经网络(GNN),具体实现为(Wang等人,2019年)提出的AGCN。随后,关系嵌入

R

R

R与运动特征进行拼接,并输入到文本控制的选择性SSM中。

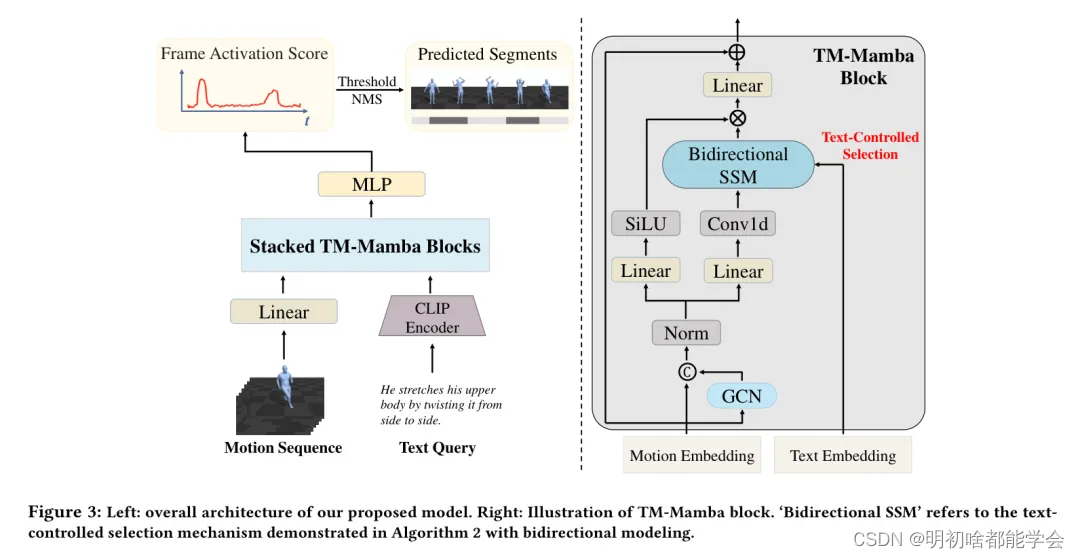

图3. 左侧:作者提出的模型的总体架构。右侧:TM-Mamba模块的说明。"双向SSM"指的是在算法2中展示的具有双向建模的文本控制选择机制。

算法2,共同捕捉每个关节的全局时间信息及其拓扑上下文。

文本控制的Motion Mamba的整体架构如图3所示。与采用单向因果建模的普通Mamba模块不同,THMG任务需要整个序列的全局上下文。为了解决这个问题,采用了如Vision Mamba(Vaswani等人,2017年)提出的双向非因果结构。输入通过TM-Mamba模块的堆叠,产生输出

Y

∈

R

V

×

L

×

D

Y\in\mathbb{R}^{V\times L\times D}

Y∈RV×L×D。在

V

V

V维度上进行平均池化后,

Y

Y

Y随后被送入一个MLP层。这为每个帧生成了帧激活得分

s

f

(

t

=

1

,

2

,

…

,

T

)

s_f(t = 1,2,\ldots ,T)

sf(t=1,2,…,T),表示其被包含在检索的时间段内的可能性。整个框架可以使用一个简单的交叉嫡损失进行监督。

L

C

E

=

∑

t

=

1

T

(

g

t

log

s

t

+

(

1

−

g

t

)

log

(

1

−

s

t

)

)

.

L_{CE}=\sum_{t=1}^{T}\left(g_t\log s_t+(1- g_t)\log(1 - s_t)\right).

LCE=t=1∑T(gtlogst+(1−gt)log(1−st)).

其中

g

t

g_t

gt表示指示帧

t

t

t是否位于通过文本Query检索到的片段内的真实标签。提出的方法在统一且简单的框架内实现了有效的全局上下文提取、基于Query的信息选择和拓扑建模。与基于Transformer的方法相比,作者的方法消除了沿时间维度对整个序列计算自注意力的必要性。这消除了一对二次内存的需求,使其能够处理非常长的序列。

1195

1195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?