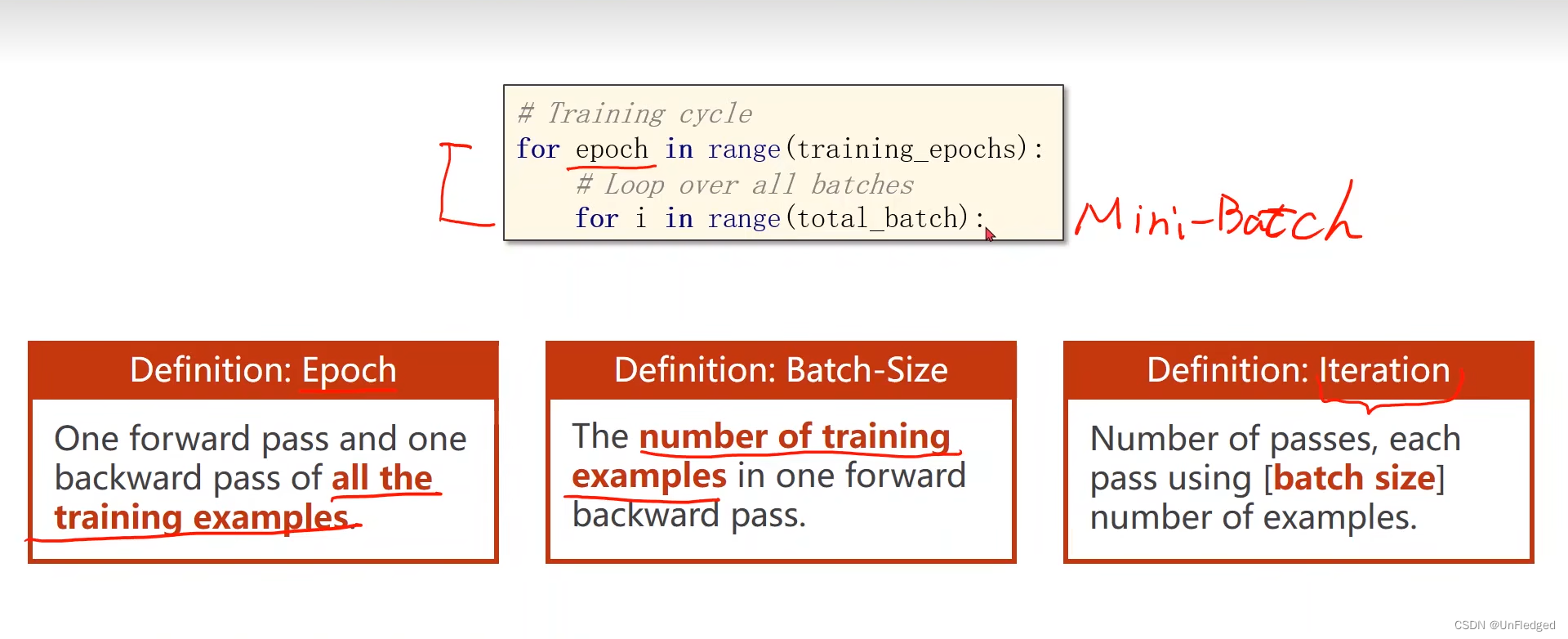

- 术语:Epoch,Batch-Size,Iteration

两层循环嵌套,外层循环表示训练周期,内层循环对mini-batch进行迭代

epoch:对所有的样本都进行了一次前向和反向传播

batch-size:每次训练(前馈、反馈、更新)所用的样本数量叫batch-size

iteration:batch分了多少个(内层迭代执行多少次)

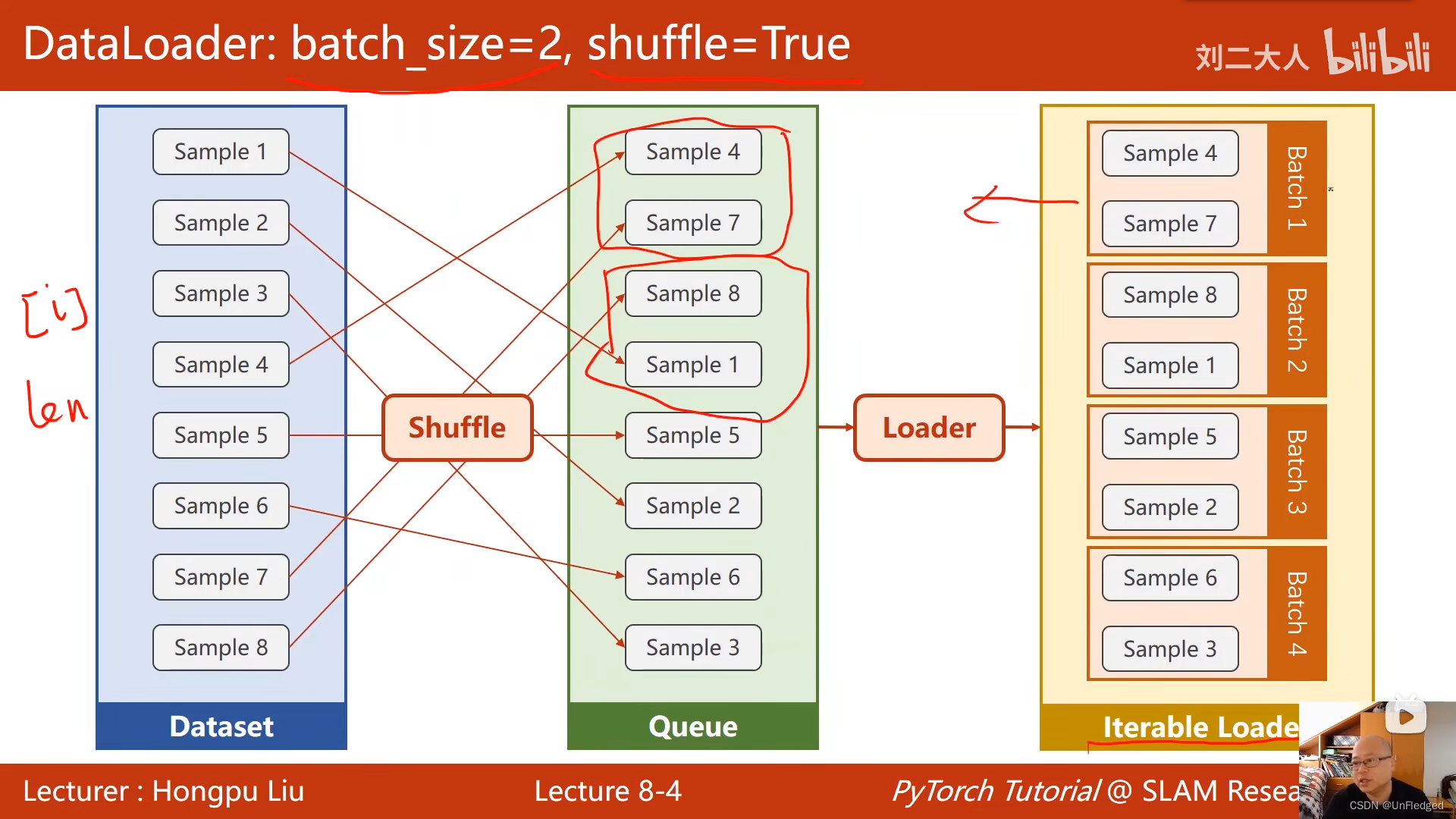

- DataLoader功能示意图

- torch.utils.data.Dataset是一个抽象类,只能被其他类继承来构造我们自己的数据集

- torch.utils.data.DataLoader帮助我们加载数据

- Dataset类必须有的几个定义:__inti__、__getitem__(使数据集支持下标索引)、__len__(返回数据条数),使该类变成可便利的数据对象

- Python enumerate() 函数

糖尿病数据集:

import torch

import numpy as np

from torch.utils.data import Dataset

from torch.utils.data import DataLoader

# prepare dataset

'''

Dataset是一个抽象函数,不能直接实例化,所以我们要创建一个自己类,继承Dataset

继承Dataset后我们必须实现三个函数:

__init__()是初始化函数,之后我们可以提供数据集路径进行数据的加载

__getitem__()帮助我们通过索引找到某个样本

__len__()帮助我们返回数据集大小

'''

class DiabetesDataset(Dataset):

def __init__(self, filepath):

xy = np.loadtxt(filepath, delimiter=',', dtype=np.float32)

self.len = xy.shape[0] # shape本身是一个二元组(x,y)对应数据集的行数和列数,这里[0]我们取行数,即样本数

self.x_data = torch.from_numpy(xy[:, :-1])

self.y_data = torch.from_numpy(xy[:, [-1]])

def __getitem__(self, index):

return self.x_data[index], self.y_data[index]

def __len__(self):

return self.len

dataset = DiabetesDataset('diabetes.csv') # 实例化dataset

train_loader = DataLoader(dataset=dataset, batch_size=32, shuffle=True, num_workers=2) # num_workers 多线程

# design model using class

class Model(torch.nn.Module):

def __init__(self):

super(Model, self).__init__()

self.linear1 = torch.nn.Linear(8, 6)

self.linear2 = torch.nn.Linear(6, 4)

self.linear3 = torch.nn.Linear(4, 1)

self.sigmoid = torch.nn.Sigmoid()

def forward(self, x):

x = self.sigmoid(self.linear1(x))

x = self.sigmoid(self.linear2(x))

x = self.sigmoid(self.linear3(x))

return x

model = Model()

# construct loss and optimizer

criterion = torch.nn.BCELoss(reduction='mean')

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)

# training cycle forward, backward, update

if __name__ == '__main__': # if这条语句在windows系统下一定要加,否则会报错

for epoch in range(100):

for i, data in enumerate(train_loader, 0): # 取出一个batch

# 1. prepare data

inputs, labels = data

# 2. forward

y_pred = model(inputs)

loss = criterion(y_pred, labels)

print(epoch, i, loss.item())

# 3.backward

optimizer.zero_grad()

loss.backward()

# 4.update

optimizer.step()

489

489

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?