💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

📋📋📋本文目录如下:🎁🎁🎁

目录

基于CNN和FNN的进化神经元模型的快速响应尖峰神经网络研究

💥1 概述

FNN网络结构:

(1)FNN可以理解为多层感知机,即:包含多个隐藏层的神经网络

(2)层与层之间是全连接的,即:相邻两层的任意两个节点都有连接

FNN前向传播:

(1)每个神经元以上一层各个节点输出作为输入,通过线性变换(结合偏置)和非线性函数激活,得到这个节点的输出,并传递给下一层的节点

(2)输入层的节点对数据不做任何处理,节点个数等于输入自变量x的维度

(3)输出层的节点个数等于输出因变量y的维度

FNN反向传播:

(1)用神经网络对数据进行建模,就是要找到最合适的参数(权重w和偏置b),对数据进行最佳逼近。通常会设计一个损失函数来度量逼近效果,最优参数应使得损失函数最小化。

(2)神经网络可以视为一个非常复杂的复合函数,求解最优参数时,需要进行链式求导,形成了梯度的反向传播。

(3)常见损失函数:分类问题:交叉熵;回归问题:均方误差

对图像(不同的数据窗口数据)和滤波矩阵(一组固定的权重:因为每个神经元的多个权重固定,所以又可以看做一个恒定的滤波器filter)做内积(逐个元素相乘再求和)的操作就是所谓的『卷积』操作,也是卷积神经网络的名字来源。

基于CNN和FNN的进化神经元模型的快速响应尖峰神经网络研究

一、进化神经元模型(EANNs)的定义与特点

-

核心定义

进化神经元模型(Evolutionary Artificial Neural Networks, EANNs)通过结合进化算法(如遗传算法)与神经网络,实现网络结构、权重或学习规则的动态优化。其核心思想是模拟生物进化中的自然选择机制,通过交叉、变异等操作生成更优的神经网络。 -

核心特点

- 全局优化能力:避免传统梯度下降法(如BP算法)的局部极小值问题,通过遗传算法的全局搜索能力寻找最优解。

- 多维度进化:包括连接权值进化、网络结构进化(如直接编码法、间接编码法)、学习规则进化等。

- 自适应性:能够在动态环境中自动调整网络参数,适用于复杂任务(如机器人控制、金融预测)。

- 计算成本挑战:尽管并行计算可缓解,但进化过程通常需要较高的计算资源。

-

典型模型

- EPNet系统:同时进化结构和权值,生成低复杂度网络。

- SENN算法:结合集成学习,在分类和回归任务中表现优异。

二、CNN与FNN的对比分析及局限性

| 模型 | 特点 | 优势 | 局限性 |

|---|---|---|---|

| CNN | - 卷积层提取空间特征 - 池化层降维 - 全连接层分类 | - 自动特征提取(无需手动设计) - 图像识别精度高(如ImageNet竞赛) - 可迁移学习(如医学影像诊断) | - 依赖网格结构数据(如图像) - 难以捕捉时序依赖关系 |

| FNN | - 单向信息流(输入层→隐藏层→输出层) - 全连接结构 | - 结构简单、训练速度快 - 适用于分类/回归任务(如文本分类) | - 无法处理空间/时序数据 - 对输入长度敏感 - 易陷入局部极值 |

三、进化神经元模型与CNN/FNN的融合策略

-

优化CNN架构

- 进化神经架构搜索(ENAS) :使用遗传算法优化CNN的层数、滤波器尺寸及连接方式,提升分类性能(如医学影像中的COVID-19诊断)。

- DenseNet进化:通过自适应模块增减,增强特征重用能力,在车辆分类任务中超越人工设计模型。

-

增强FNN能力

- 权值与结构联合进化:利用进化算法调整FNN的权重和隐藏层结构,解决复杂非线性问题(如光伏功率预测)。

- 与CNN结合:将CNN的局部特征提取结果输入FNN,提升文本分类性能(如情感分析)。

-

混合模型案例

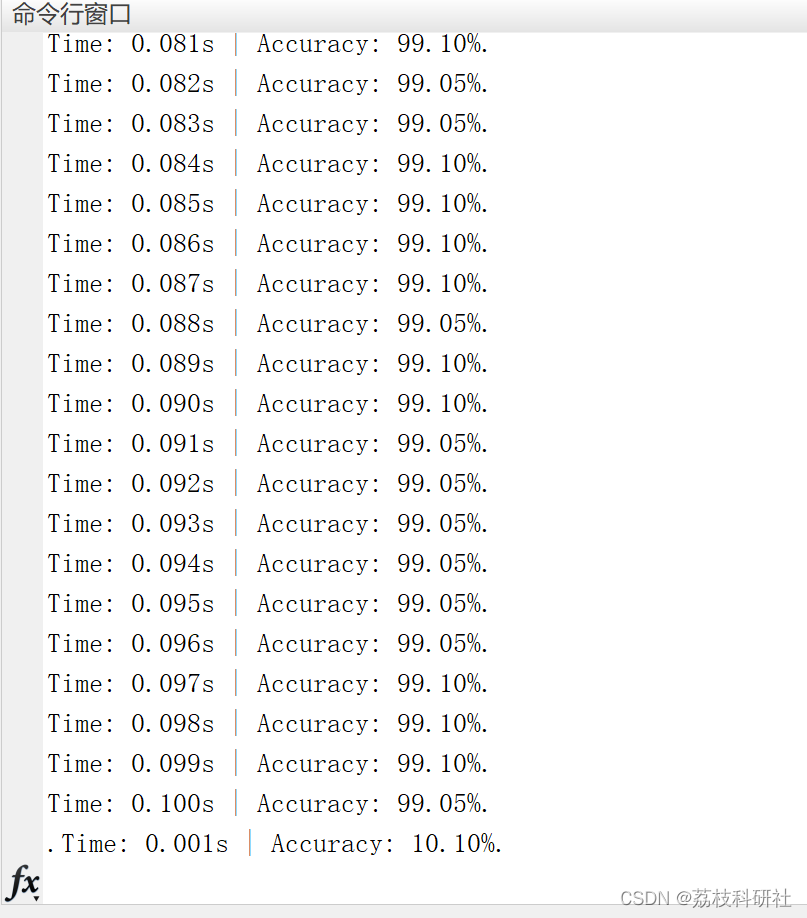

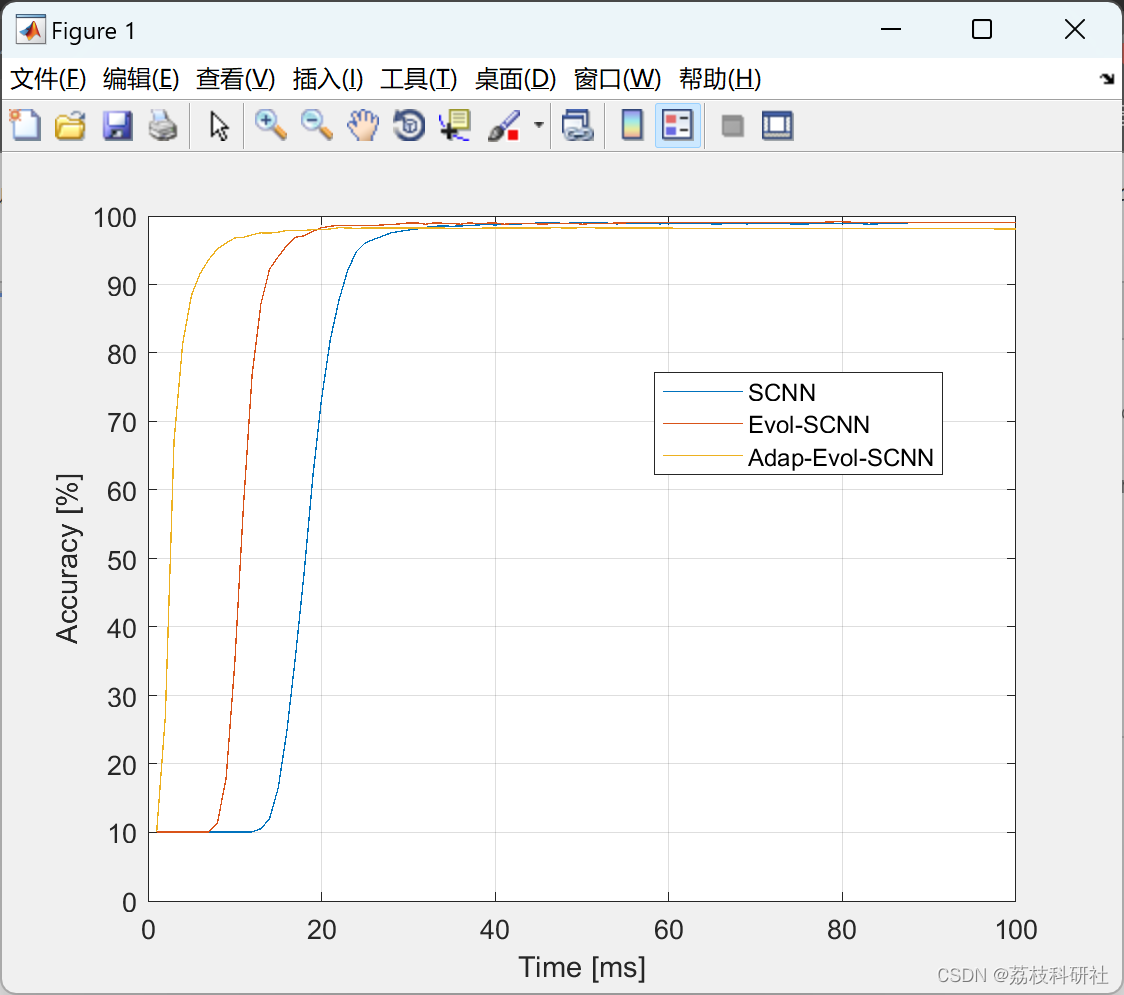

- Evol-SCNN:进化优化的CNN与尖峰神经网络结合,在MNIST数据集上实现99.14%的准确率,响应时间缩短至毫秒级。

- Adap-Evol-SCNN:自适应进化策略进一步平衡计算效率与精度,适用于实时图像处理。

四、尖峰神经网络(SNN)的快速响应机制

-

生物启发原理

- 脉冲通信:神经元通过离散尖峰传递信息,模拟生物神经元的动作电位。

- 时间编码:利用脉冲时序关系(如STDP规则)增强模式识别能力。

-

快速响应机制

- 低延迟信号处理:小鼠视觉皮层神经元可在2毫秒内响应输入扰动,通过尖峰位移或新增尖峰实现快速编码。

- 事件驱动计算:仅活跃神经元参与运算,减少能耗(如Innatera芯片的SNN实现)。

-

能效优势

- 能耗比传统ANN低10-100倍,适合边缘设备(如无人机导航、智能传感器)。

五、性能评估与案例研究

-

关键指标

- 响应时间:SNN可实现2-2.5毫秒级响应。

- 准确率:Evol-SCNN在MNIST分类中达99.14%。

- 能耗效率:SNN的每瓦特算力显著高于传统模型。

-

应用案例

- 医疗影像:CNN进化模型用于糖尿病视网膜病变分类,准确率提升12%。

- 机器人控制:SNN结合进化算法实现快速避障,延迟低于5毫秒。

- 语音识别:混合FNN-SNN模型在低功耗设备中实现实时语音转文本。

六、挑战与未来方向

-

当前挑战

- 计算效率:进化算法与SNN结合的训练成本仍较高。

- 可解释性:复杂模型的决策过程缺乏透明性。

- 大规模数据适应性:现有研究多集中于小数据集(如CIFAR-10),需验证大规模场景。

-

未来方向

- 轻量化进化算法:开发分布式进化框架(如异步遗传算法)降低计算成本。

- 跨模态融合:结合CNN(空间特征)、SNN(时序特征)与进化算法,构建多任务通用模型。

- 硬件协同设计:优化SNN在神经形态芯片(如Loihi)上的部署效率。

七、结论

基于CNN和FNN的进化神经元模型与尖峰神经网络的结合,为快速响应、高能效的智能系统提供了创新解决方案。通过进化算法优化网络结构与参数,结合SNN的生物启发性时序处理能力,此类模型在医疗、机器人、边缘计算等领域展现出广阔前景。未来研究需进一步平衡性能与计算成本,推动理论创新与工程化落地。

📚2 运行结果

部分代码:

%% Train an example ConvNet to achieve very high classification, fast.

dbstop if error;

addpath(genpath('./dlt_cnn_map_dropout_nobiasnn'));

addpath(genpath('./models'));

addpath(genpath('./util'));

rng('default')

%% Load data and network model

% dataset = 'fashion_mnist';

dataset = 'mnist';

if strcmp(dataset, 'fashion_mnist') == 1

train_images = loadMNISTImages('train-images-idx3-ubyte');

train_labels = loadMNISTLabels('train-labels-idx1-ubyte');

test_images = loadMNISTImages('t10k-images-idx3-ubyte');

test_labels = loadMNISTLabels('t10k-labels-idx1-ubyte');

train_y = zeros(length(train_labels), 10);

for i = 1 : length(train_labels)

train_y(i, train_labels(i)+1) = 1;

end

test_y = zeros(length(test_labels), 10);

for i = 1 : length(test_labels)

test_y(i, test_labels(i)+1) = 1;

end

train_x = double(reshape(train_images,28,28,60000));

test_x = double(reshape(test_images,28,28,10000));

train_y = double(train_y');

test_y = double(test_y');

% Load a trained ANN model

load cnn_fashion_mnist_91.35.mat;

elseif strcmp(dataset, 'mnist') == 1

load mnist_uint8;

train_x = double(reshape(train_x',28,28,60000)) / 255;

test_x = double(reshape(test_x',28,28,10000)) / 255;

train_y = double(train_y');

test_y = double(test_y');

% Load a trained ANN model

load cnn_mnist_99.14.mat;

end

test_x = test_x(:, :, 1:2000);

test_y = test_y(:, 1:2000);

%% Spike-based Testing of a ConvNet

lifsim_opts = struct;

lifsim_opts.t_ref = 0.000;

lifsim_opts.threshold = 1.0;

lifsim_opts.rest = 0.0;

lifsim_opts.dt = 0.001;

lifsim_opts.duration = 0.100;

lifsim_opts.report_every = 0.001;

lifsim_opts.max_rate = 200;

%% Test the original SCNN

scnn = lifsim_scnn(cnn, test_x, test_y, lifsim_opts);

%% Test the Evolutionary Rule

evol_ops.beta = 0.6;

evol_ops.initial_E = 1;

evol_ops.learning_rate = 0.01;

evol_scnn = lifsim_evol_scnn(cnn, test_x, test_y, lifsim_opts, evol_ops);

adap_evol_scnn = lifsim_adap_evol_scnn(cnn, test_x, test_y, lifsim_opts, evol_ops);

% plot_cnn_spikes(scnn);

% plot_cnn_spikes(evol_scnn);

% plot_cnn_spikes(adap_evol_scnn);

%% Show the difference

figure; clf;

time = lifsim_opts.dt:lifsim_opts.dt:lifsim_opts.duration;

plot(time * 1000, scnn.performance);

hold on; grid on;

plot(time * 1000, evol_scnn.performance);

hold on; grid on;

plot(time * 1000, adap_evol_scnn.performance);

legend('SCNN', 'Evol-SCNN', 'Adap-Evol-SCNN');

ylim([00 100]);

xlabel('Time [ms]');

ylabel('Accuracy [%]');

🎉3 参考文献

部分理论来源于网络,如有侵权请联系删除。

[1]邹洪建,栾茹.基于FNN的SRM调节器参数自整定的研究[J].微电机,2022,55(11):75-81.DOI:10.15934/j.cnki.micromotors.2022.11.008.

[2]乔楠.基于SSA-FNN的光伏功率超短期预测研究[J].光源与照明,2022(10):98-100.

[3]王韬. 基于卷积神经网络的超短脉冲测量[D].山东大学,2022.DOI:10.27272/d.cnki.gshdu.2022.002930.

2441

2441

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?