Hadoop安装步骤、启动以及单机部署运行 centos

注:Hadoop是基于Java环境进行运行的,因此在进行安装hadoop前,请先配置安装正确的Java环境

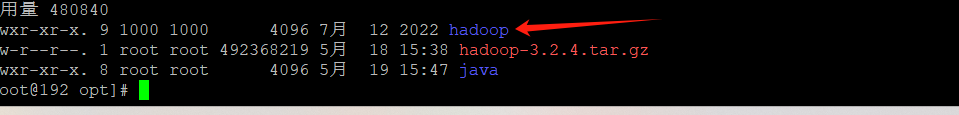

上传安装包并解压

#解压

tar zxvf hadoop-3.2.4.tar.gz

#重命名

mv hadoop-3.2.4 hadoop

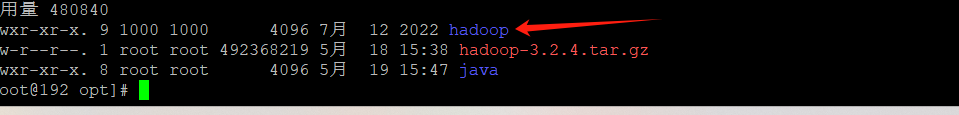

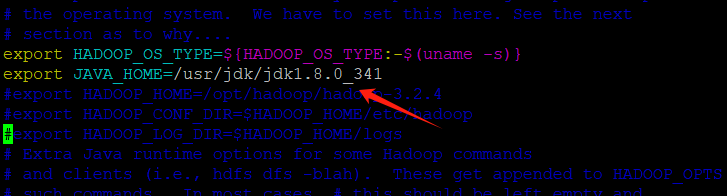

进行环境配置

#修改配置文件

vim /etc/profile

#添加环境配置

export HADOOP_PATH=/opt/hadoop

export PATH=$PATH:$HADOOP_PATH/bin

export PATH=$PATH:$HADOOP_PATH/sbin

#文件生效

source /etc/profile

#查看是否安装成功

hadoop version

注:至此完成了集群中一台机器的环境配置

注:在多台服务器进行通信时建议关闭防火墙,已经同步时间

#查看防火墙的状态

sudo systemctl status firewalld

#关闭防火墙

sudo systemctl stop firewalld

#启动防火墙

sudo systemctl start firewalld

#重启防火墙

sudo systemctl restart firewalld

#永久关闭防火墙

sudo systemctl disable firewalld

#查看日期时间

date

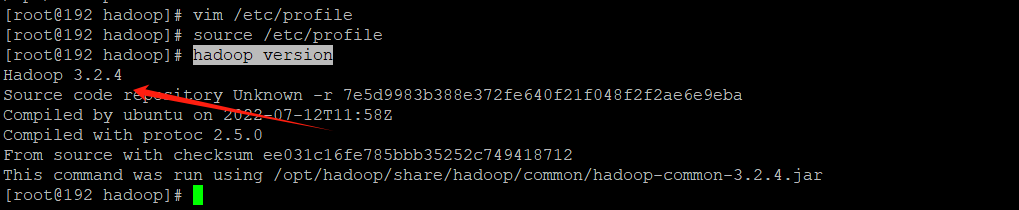

部署

- 修改hadoop-env.sh

export JAVA_HOME=/usr/jdk/jdk1.8.0_341

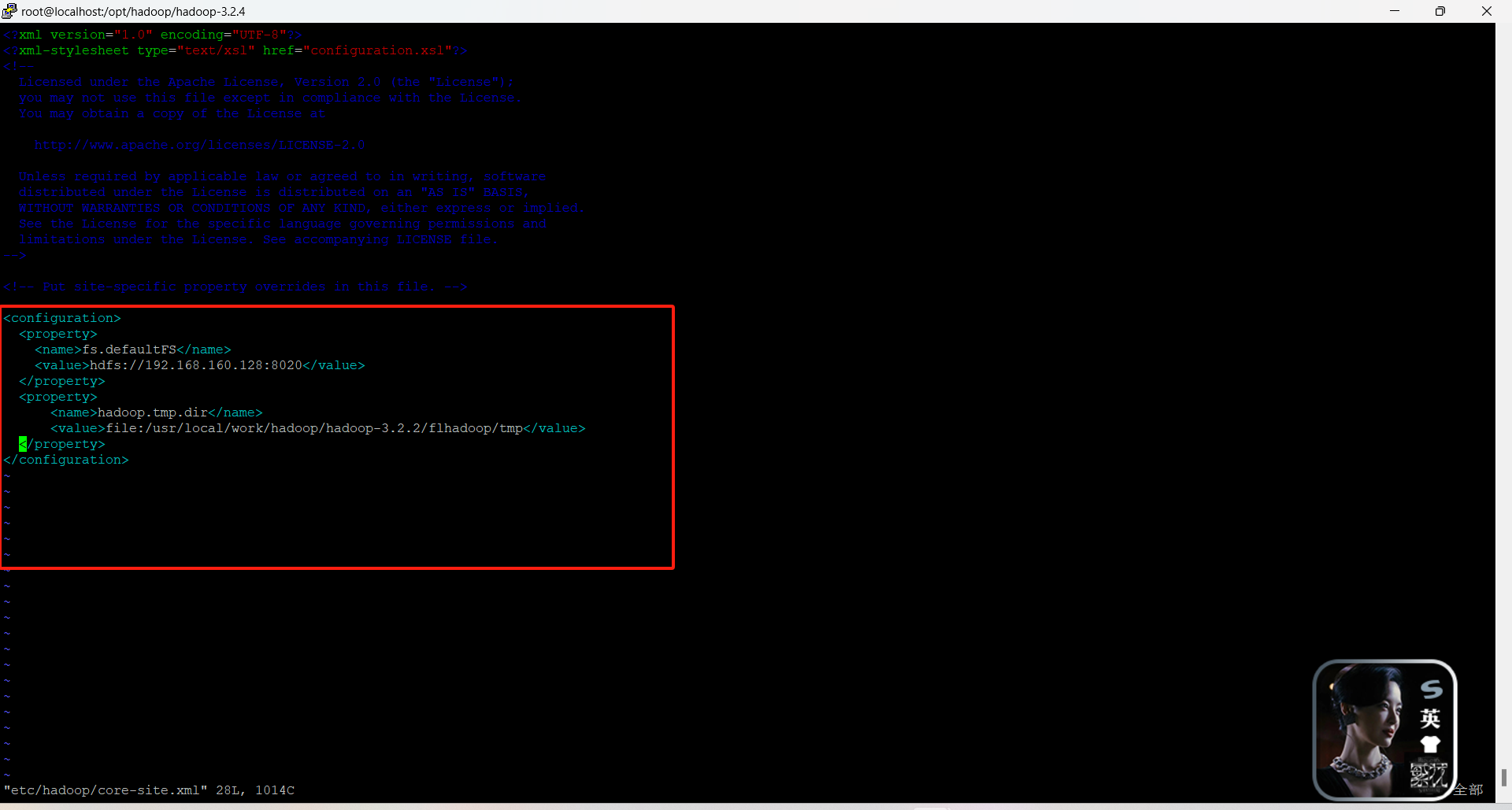

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://10.26.118.120:9001</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/work/hadoop/hadoop-3.2.2/flhadoop/tmp</value>

</property>

</configuration>

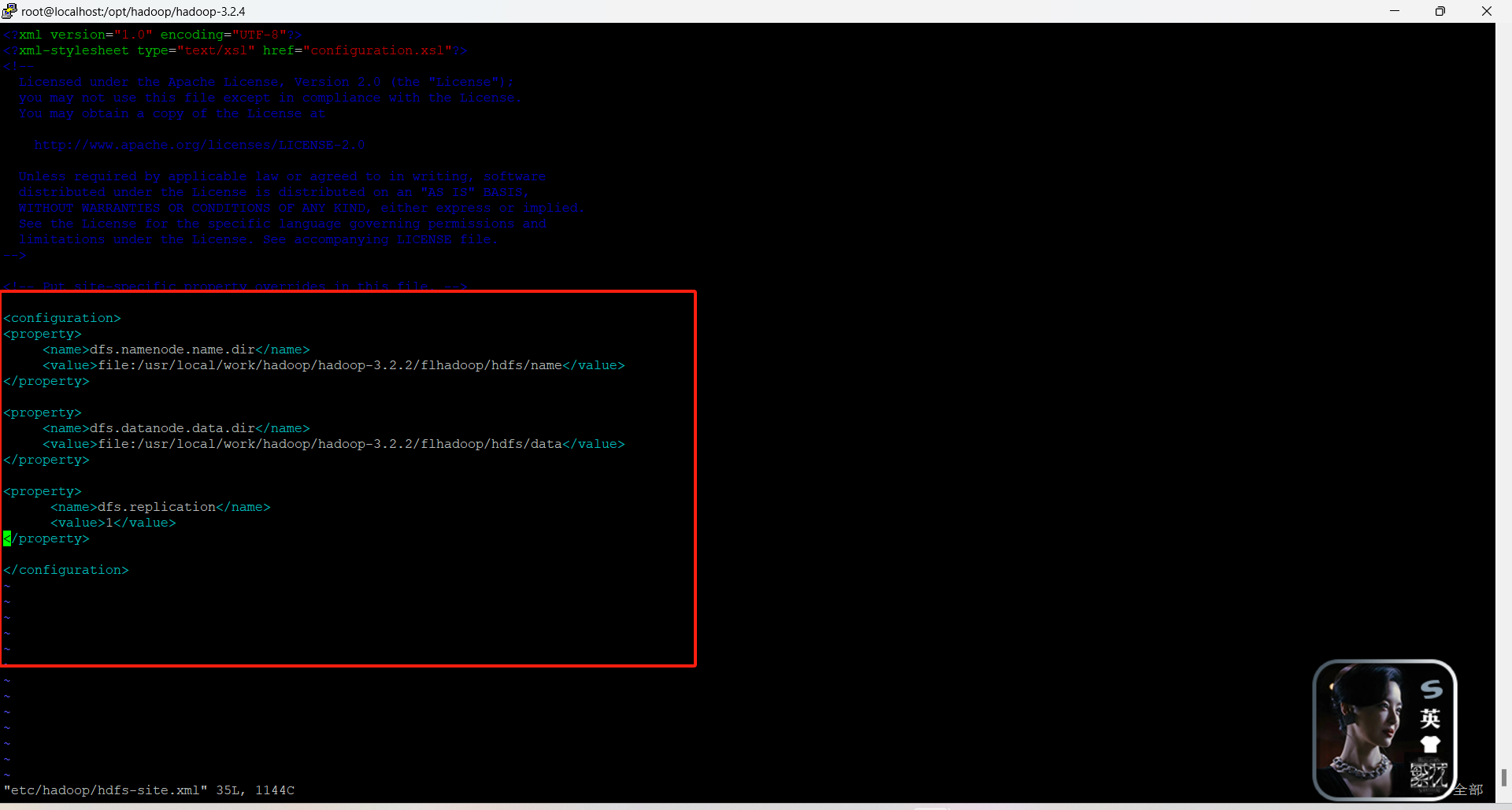

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/work/hadoop/hadoop-3.2.2/flhadoop/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/work/hadoop/hadoop-3.2.2/flhadoop/hdfs/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

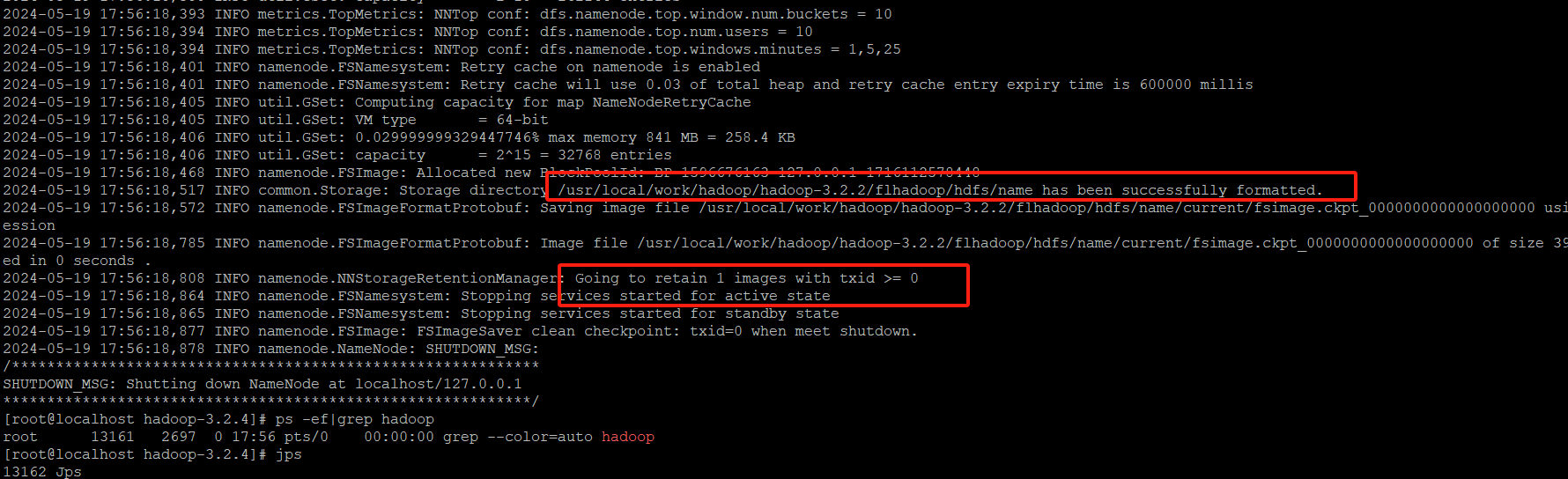

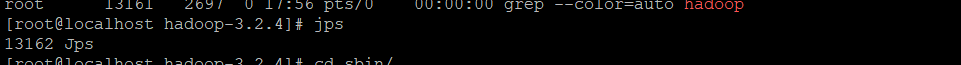

cd /opt/hadoop/hadoop-3.2.4/bin

hdfs namenode -format

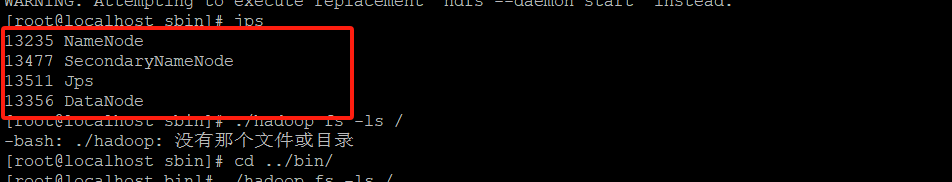

注:此时jps查看是没有namenode,需要去启动

分别启动namenode,datanode,secondarynamenode。在 sbin 目录下执行

./hadoop-daemon.sh start namenode

./hadoop-daemon.sh start datanode

./hadoop-daemon.sh start secondarynamenode

- 验证:输入 ./hadoop fs -ls / 没报错 说明部署成功。

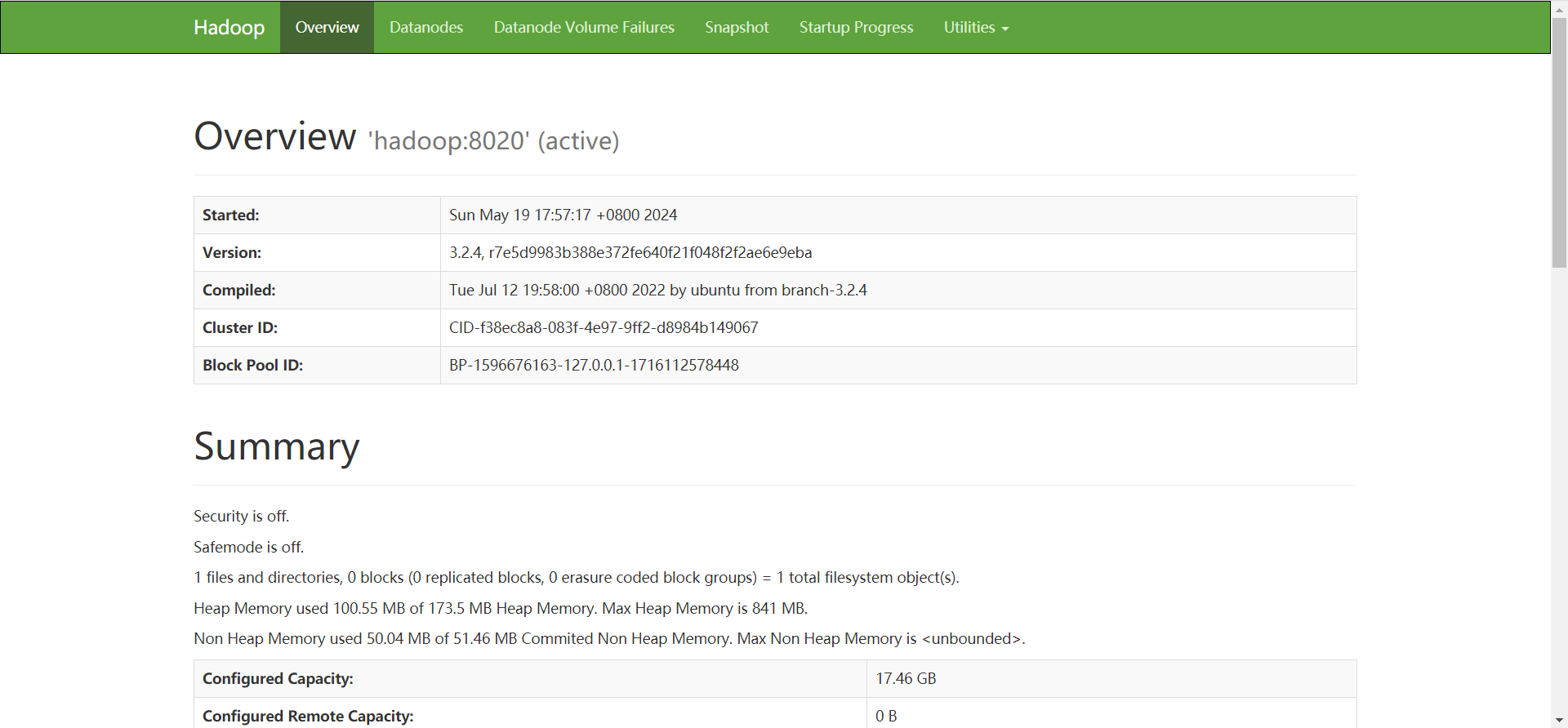

注:特别注意:HaDoop3.0之前web访问端口是50070 hadoop3.0之后web访问端口为9870

转存中…(img-QqU9Pde1-1716123407831)]

- 验证:输入 ./hadoop fs -ls / 没报错 说明部署成功。

注:特别注意:HaDoop3.0之前web访问端口是50070 hadoop3.0之后web访问端口为9870

5302

5302

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?