目录

论文地址: https://arxiv.org/pdf/2304.09121.pdf

代码地址:GitHub - Lilac-Lee/FastNSF: Fast Neural Scene Flow (ICCV 2023)

概要

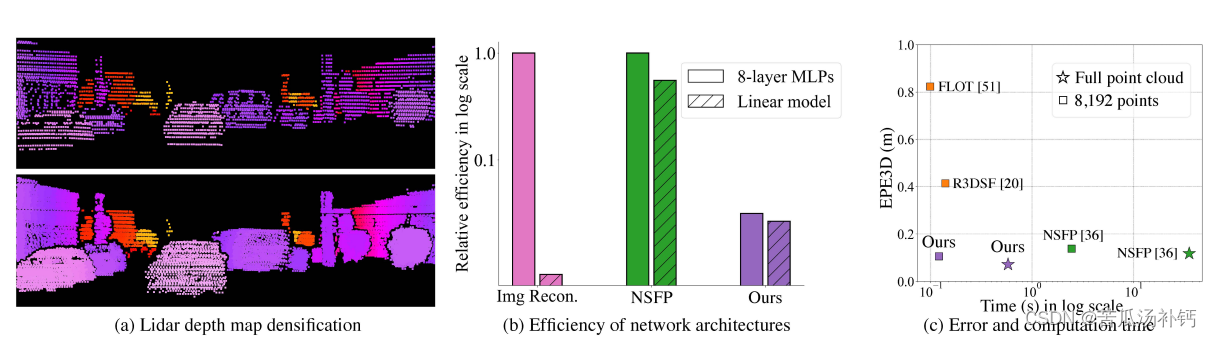

神经场景流先验 (NSFP) 由于其固有的对分布外 (OOD) 效应的鲁棒性以及处理密集激光雷 达点的能力而引起了视觉界的极大关注。该方法利用坐标神经网络在运行时估计场流,无需任何训练。然而,它比当前最先进的学习方法慢 100 倍。在图像、视频和辐射函数重建等 其他应用中,加速坐标网络运行时性能的创新 主要集中在架构变化上。在本文中,证明了场景流是不同的主要的计算瓶颈源于损失函数本身(即切角距离)。此外,重新发现距离变换(DT)作为一种高效、无对应的损失函数,可以极大地加快运行时优化。

方法的关键是使用无对应损失函数——距离变换 (DT) 作为计算成本高昂的 CD 损失的代理。用内存消耗来换取计算时间,从而在运行时显着加速,这在探索更有效的损失函数以进行密集场景流估计时提供了一种替代解决方案。

Motivation

- 场景流是一个重要问题,因为它为许多下游任务提供低级运动线索。最先进的学习方法通常速度很快, 并且可以在域内数据上实现令人印象深刻的性能,但通常无法泛化到分布外(OOD)数据或处理密集点云。

- 与基于监督或无监督学习的方法不同,NSFP 不需要从大型离线数据集中学习,并且对点密度没有限制。

- NSFP 的一个根本缺点是其运行时优化的速度,在某些情况下比其学习对应物慢几个数量级。

整体架构流程

NSFP 是在开放世界感知和场景密化中使用激光雷达的主流方法。它在从稠密激光雷达点云(超过15万点)中实现了最先进的场景流估计,适用于各种传感器设置,几乎无需精细调整。与监督或无监督

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

763

763

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?