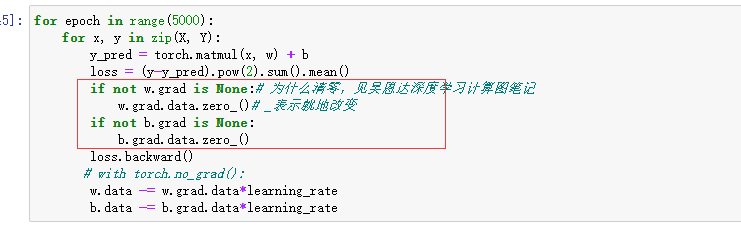

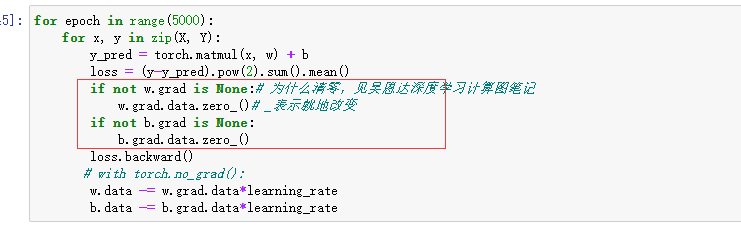

每次做反向传播之前都要归零梯度,optimizer.zero_grad() ---> 原因在于如果不清零,他们的梯度会一直累加造成结果不收敛

相关链接:【PyTorch】PyTorch中的梯度累加 - lart - 博客园 (cnblogs.com)

每次做反向传播之前都要归零梯度,optimizer.zero_grad() ---> 原因在于如果不清零,他们的梯度会一直累加造成结果不收敛

相关链接:【PyTorch】PyTorch中的梯度累加 - lart - 博客园 (cnblogs.com)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?