反事实VQA

数据集:VQA-CP,用于评估VQA模型的泛化能力。训练和测试数据分布不同。

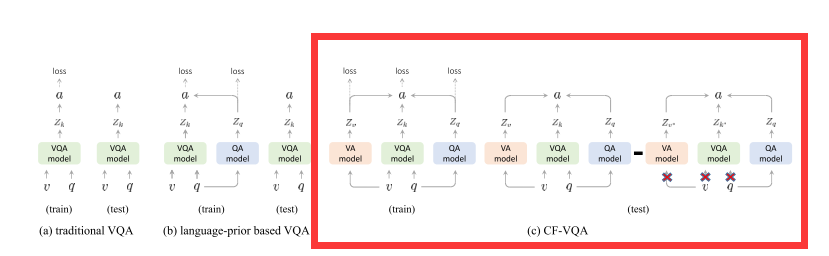

弱化语言先验:使用单独的QA模块,在对抗训练或多任务学习中捕获语言先验。

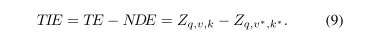

如何在有偏训练下完成无偏的推断

基于语言先验的方法使用了一个单独的分支来学习语言先验,在测试时不使用该分支。这样的做法无法充分利用语言先验中的“好”的知识?

介绍和相关工作

简单地排除额外的分支不能利用良好的上下文。事实上,对于最近的去偏VQA方法来说,从整体中分离出好的和坏的仍然具有挑战性。

传统的VQA无法解开单模态语言相关性和多模态推理,即直接和间接影响。

语言偏差可以通过估计Q对A的直接因果效应,即纯语言效应来识别。

本文的主要贡献有三个方面。首先,我们的反事实推理框架是第一个将VQA中的语言偏差表述为因果效应的框架。 其次,我们为最近的去偏VQA工作提供了一种基于因果关系的新型解释。第三,我们的因果关系是通用的,适用于不同的基线VQA架构和融合策略。

前提知识

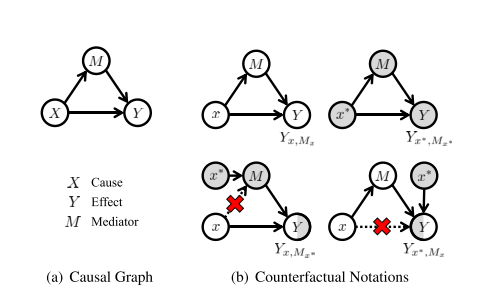

因果图:

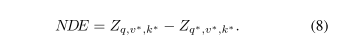

因果效应:

-

总的影响

-

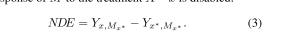

自然直接影响

-

总的间接影响

-

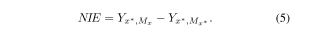

自然间接影响

VQA中的因果效应:

-

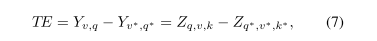

总的影响

-

自然直接影响

-

总的间接影响

因果图:

对问题来说,使用总的间接影响来去除纯语言效应。

研究方法和创新点

- 我们将语言偏见表述为问题对答案的直接因果效应,并通过从总因果效应中减去直接语言效应来减轻偏见。

- 提出了一种反事实推理框架CF-VQA来减少VQA中的语言偏差

- 对于近期的VQA去偏的工作,提供了一种新的因果视角。

- 作者认为基于语言先验的方法,可以统一到我们提出的反事实推理框架中作为特例。

核心思想

从总效应中减去纯语言效应便可完成无偏推理。

总体流程

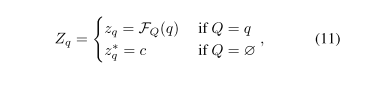

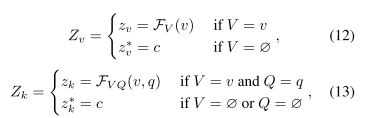

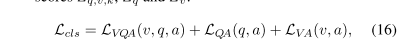

- 公式计算

作者使用一个学习参数c,用来控制Z(q,v*,k*)的锐度(?),我们假设NDE的锐度应该相似于TE的锐度,一个不当的c会导致TIE由TE或是NDE主导,作者使用KL散度来估计c:

- 融合方法

- 损失函数计算

KL散度估计c,最小化Lkl时,仅更新参数c。最终的参数由两者共同决定。

实验设置

- 数据集:

- VQA-CP:用来评估VQA模型的鲁棒性;训练集和测试集上的答案分部完全不同,甚至相反

- VQA v2.0:一个平衡的VQA数据集,用于验证CF-VQA是否过度的修改了语言先验

- Baseline VQA archithectures:SAN, UpDn, and S-MRL

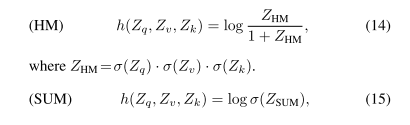

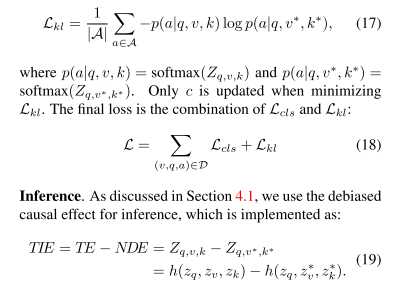

LMH中的因果效应

628

628

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?